Harrier-OSS-v1:微软开源的多语言文本嵌入模型,长上下文与跨语言语义能力拉满

一、Harrier-OSS-v1是什么

Harrier-OSS-v1是微软研究院(Microsoft Research)开源的多语言文本嵌入模型家族(Open-Source Software,OSS),核心定位是为全球开发者提供高性能、跨语言、长上下文的文本语义表示能力,解决多语言场景下文本语义理解、检索、匹配等核心问题。

1.1 项目核心定位与背景

在全球化数字内容爆炸式增长的背景下,跨语言文本处理需求日益迫切,传统单语言嵌入模型难以覆盖多语言语义一致性与长文本理解需求。微软基于自研decoder-only架构与先进训练策略,推出Harrier-OSS-v1,旨在填补多语言长上下文嵌入领域的技术空白,同时以完全开源(MIT许可证)的方式降低企业与开发者的使用门槛,推动多语言AI应用的普及。

1.2 模型家族构成

Harrier-OSS-v1并非单一模型,而是三档参数规模的模型矩阵,覆盖轻量部署、平衡性能、极致性能三大场景,开发者可根据算力与业务需求灵活选择:

| 模型版本 | 参数规模 | 定位 | 适用场景 |

|---|---|---|---|

| Harrier-OSS-v1-270M | 2.7亿参数 | 轻量极速 | 移动端、边缘设备、低延迟实时场景 |

| Harrier-OSS-v1-0.6B | 6亿参数 | 平衡通用 | 云端常规服务、中小型企业级应用 |

| Harrier-OSS-v1-27B | 270亿参数 | 极致性能 | 大规模检索、高精度语义分析、科研场景 |

1.3 核心技术架构

Harrier-OSS-v1采用decoder-only架构(与GPT系列同源),区别于传统BERT类encoder-only嵌入模型,具备更强的长文本建模与语义连贯性能力;同时创新采用last-token pooling(取最后一个token的隐状态作为文本嵌入)与L2归一化,确保嵌入向量的稳定性与检索效率。

1.4 关键性能基准

在业内权威的多语言MTEB v2基准测试(覆盖检索、分类、聚类、语义相似度等核心任务)中,Harrier-OSS-v1三档模型均取得顶尖成绩,其中27B版本发布当日即登顶榜首,270M与0.6B版本通过知识蒸馏(从更大模型迁移能力)实现小参数、高性能的突破:

270M版:MTEB v2得分 66.5

0.6B版:MTEB v2得分 69.0

27B版:MTEB v2得分 74.3(多语言嵌入领域当前最高水平)

1.5 开源许可与生态

Harrier-OSS-v1以MIT开源许可证发布,允许商业使用、修改、分发与二次开发,无任何使用限制;同时依托Hugging Face生态,提供开箱即用的模型权重与推理接口,兼容主流NLP框架(Transformers、Sentence-BERT等),大幅降低集成成本。

二、功能特色

Harrier-OSS-v1的核心竞争力在于多语言通用性、长上下文理解、高性能语义表示、轻量化部署四大维度,以下为详细功能拆解:

2.1 超强多语言覆盖能力

支持50+主流语言,涵盖中文、英文、西班牙语、法语、德语、日语、韩语、阿拉伯语等全球核心语言,解决跨语言语义不一致问题。

多语言语义对齐:不同语言的同义文本生成高度相似的嵌入向量,实现“跨语言语义等价”,例如中文“人工智能”与英文“Artificial Intelligence”的嵌入向量余弦相似度接近1。

低资源语言友好:针对小语种、低资源语言做专项优化,无需额外微调即可实现稳定的语义表示。

2.2 超长上下文窗口支持

最大支持32768 token上下文长度(约2.4万字中文),远超传统嵌入模型(通常512–4096 token),可直接处理长文档、长对话、长篇报告等场景,无需文本截断。

长文本语义完整性:decoder-only架构确保长文本中前后语义的连贯性,避免截断导致的语义丢失,适合法律文档、学术论文、小说等长内容处理。

2.3 顶尖语义表示性能

语义精准度:在MTEB v2多语言基准中,检索、分类、聚类、语义相似度四大核心任务均达到SOTA(State-of-the-Art)水平,语义理解能力接近人类标注水平。

知识蒸馏优化:270M与0.6B版本通过从27B大模型进行知识蒸馏,在参数减少90%+的情况下,保留85%+的核心语义能力,实现“小而强”的部署效果。

嵌入向量质量:L2归一化处理后,嵌入向量具备良好的正交性与稳定性,检索时余弦相似度计算效率高、结果精准。

2.4 灵活的模型规模适配

三档参数矩阵:从270M轻量版到27B旗舰版,覆盖从边缘设备到超算中心的全算力场景,开发者可按需选择,无需为性能浪费算力,也无需为算力妥协效果。

推理速度优化:轻量版(270M)在普通CPU上即可实现毫秒级推理,0.6B版在单GPU上支持高并发,27B版通过分布式推理适配大规模服务场景。

2.5 开箱即用的生态兼容性

兼容主流NLP框架:无缝集成Hugging Face Transformers、Sentence-BERT、LangChain、Chroma等工具,支持直接加载模型权重进行推理。

标准化接口:提供统一的文本嵌入API,输入任意语言文本,输出固定维度(如768/1024/4096)的嵌入向量,无需额外适配。

开源社区支持:依托微软研究院与Hugging Face社区,提供持续的模型更新、bug修复与技术支持。

三、应用场景

Harrier-OSS-v1凭借多语言、长上下文、高性能的特性,可广泛应用于信息检索、自然语言处理、知识管理、跨语言交互等领域,以下为核心场景详解:

3.1 多语言语义检索系统

企业级文档检索:支持中英法德等多语言文档库的语义检索,用户输入任意语言查询,精准匹配跨语言相关文档,解决全球化企业内部知识检索难题。

电商多语言搜索:跨境电商平台中,用户用母语搜索商品,系统返回全球多语言商品描述的精准匹配结果,提升跨境购物体验。

学术文献检索:支持中英文、小语种学术论文的语义检索,突破关键词匹配局限,实现“按研究内容检索”而非“按关键词检索”。

3.2 文本聚类与分类

多语言内容分类:新闻媒体、内容平台对全球多语言资讯进行自动分类(如科技、财经、娱乐),无需为每种语言单独训练分类器。

舆情分析聚类:对全球社交媒体(Twitter、微博、Facebook等)的多语言舆情数据进行聚类,快速识别热点话题与情感倾向。

客户评论分析:跨境电商、跨国企业对全球客户的多语言评论进行聚类与分类,提炼用户需求与产品问题。

3.3 语义相似度与匹配

跨语言问答匹配:多语言客服系统中,用户用母语提问,系统匹配全球知识库中不同语言的相似问题与答案,实现“一问多语言答”。

版权侵权检测:对全球多语言文本、文章、代码进行相似度计算,快速识别侵权内容,支持跨语言版权保护。

简历匹配:跨国企业招聘中,将多语言简历与岗位描述进行语义匹配,精准筛选候选人。

3.4 双语挖掘与机器翻译辅助

平行语料挖掘:从海量多语言非平行文本中,挖掘语义等价的双语句子对,为机器翻译模型提供高质量训练数据。

翻译质量评估:通过计算源语言与目标语言文本的嵌入相似度,自动评估机器翻译结果的语义一致性,辅助翻译优化。

跨语言知识图谱构建:将不同语言的实体、关系映射到统一语义空间,构建全球多语言知识图谱。

3.5 长文本处理场景

法律文档分析:对超长法律合同、判决书(数万字)进行语义嵌入,实现法律条款检索、相似案例匹配、风险点提取。

学术论文理解:对长篇学术论文(含摘要、正文、参考文献)进行整体嵌入,支持论文相似度计算、研究方向聚类、学术脉络分析。

长对话语义理解:对客服长对话、会议记录、小说章节等长文本进行语义表示,实现对话意图识别、情节梳理、关键信息提取。

3.6 边缘与移动端场景

移动端多语言输入法:基于270M轻量版模型,实现移动端语义联想、跨语言输入建议,无需云端依赖。

边缘设备内容过滤:IoT设备、智能终端本地部署轻量版模型,实现多语言不良内容过滤、敏感信息检测。

离线多语言助手:离线语音助手、翻译设备中,嵌入轻量版模型,实现离线多语言语义理解与交互。

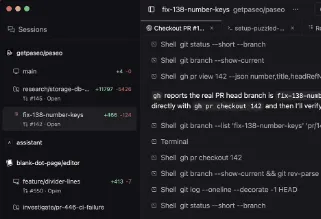

四、使用方法

Harrier-OSS-v1依托Hugging Face生态,提供极简的使用流程,支持Python推理、API调用、框架集成三种核心方式,以下为详细步骤与代码示例:

4.1 环境准备

4.1.1 安装依赖库

# 安装核心依赖 pip install transformers torch sentence-transformers # 若使用27B大模型,需安装分布式推理依赖(可选) pip install accelerate

4.1.2 模型下载(自动/手动)

自动下载:通过Hugging Face

from_pretrained接口,首次运行时自动下载模型权重到本地缓存。手动下载:访问Hugging Face模型仓库,下载对应版本权重后本地加载(适合离线环境)。

4.2 核心推理代码示例(Python)

4.2.1 基础文本嵌入(单句/多句)

from transformers import AutoTokenizer, AutoModel

import torch

# 1. 加载模型与分词器(以270M轻量版为例,替换为0.6B/27B即可)

model_name = "microsoft/harrier-oss-v1-270M"

tokenizer = AutoTokenizer.from_pretrained(model_name)

model = AutoModel.from_pretrained(model_name)

# 2. 准备输入文本(支持多语言)

texts = [

"人工智能是未来科技的核心驱动力",

"Artificial Intelligence is the core driving force of future technology",

"La inteligencia artificial es el motor impulsor central de la tecnología futura"

]

# 3. 文本编码(支持最长32768 token)

inputs = tokenizer(

texts,

padding=True,

truncation=True,

max_length=32768,

return_tensors="pt"

)

# 4. 模型推理(last-token pooling + L2归一化)

with torch.no_grad():

outputs = model(**inputs)

# 取最后一个token的隐状态作为嵌入向量

embeddings = outputs.last_hidden_state[:, -1, :]

# L2归一化

embeddings = torch.nn.functional.normalize(embeddings, p=2, dim=1)

# 5. 输出嵌入向量(维度:[文本数, 隐藏层维度])

print("嵌入向量维度:", embeddings.shape)

print("中文文本嵌入:", embeddings[0][:5]) # 打印前5个值

print("英文文本嵌入:", embeddings[1][:5])

print("西班牙语文本嵌入:", embeddings[2][:5])4.2.2 语义相似度计算

# 计算余弦相似度(衡量文本语义相似性)

def cosine_similarity(vec1, vec2):

return torch.dot(vec1, vec2) / (torch.norm(vec1) * torch.norm(vec2))

# 计算中文与英文文本的相似度

sim_zh_en = cosine_similarity(embeddings[0], embeddings[1])

print("中文-英文语义相似度:", sim_zh_en.item()) # 接近1.0,说明语义高度一致

# 计算中文与西班牙语文本的相似度

sim_zh_es = cosine_similarity(embeddings[0], embeddings[2])

print("中文-西班牙语文本语义相似度:", sim_zh_es.item())4.2.3 长文本嵌入(32768 token)

# 加载超长文本(如1万字中文文档)

long_text = "这里是超过32768 token的长文本内容(省略)..."

# 编码长文本(自动截断至32768 token)

long_inputs = tokenizer(

long_text,

truncation=True,

max_length=32768,

return_tensors="pt"

)

# 推理并获取嵌入向量

with torch.no_grad():

long_outputs = model(**long_inputs)

long_embedding = long_outputs.last_hidden_state[:, -1, :]

long_embedding = torch.nn.functional.normalize(long_embedding, p=2, dim=1)

print("长文本嵌入向量维度:", long_embedding.shape)4.3 框架集成(Sentence-BERT/LangChain)

4.3.1 Sentence-BERT集成(简化语义检索)

from sentence_transformers import SentenceTransformer

# 加载Harrier-OSS-v1模型到Sentence-BERT

model = SentenceTransformer("microsoft/harrier-oss-v1-0.6B")

# 语义检索示例

corpus = [

"机器学习算法包括监督学习、无监督学习",

"深度学习是机器学习的分支,基于神经网络",

"自然语言处理是AI的重要应用领域"

]

query = "什么是深度学习?"

# 生成嵌入

corpus_embeddings = model.encode(corpus, convert_to_tensor=True)

query_embedding = model.encode(query, convert_to_tensor=True)

# 计算相似度并排序

similarities = torch.nn.functional.cosine_similarity(query_embedding, corpus_embeddings)

top_result_idx = torch.argmax(similarities).item()

print("最相关结果:", corpus[top_result_idx])4.3.2 LangChain集成(RAG系统)

from langchain.embeddings import HuggingFaceEmbeddings

from langchain.vectorstores import Chroma

# 初始化Harrier-OSS-v1嵌入模型

embeddings = HuggingFaceEmbeddings(model_name="microsoft/harrier-oss-v1-270M")

# 构建向量数据库(RAG核心)

texts = ["文档1内容", "文档2内容", "文档3内容"]

db = Chroma.from_texts(texts, embeddings)

# 语义检索

query = "文档1的核心内容是什么?"

docs = db.similarity_search(query)

print("检索结果:", docs[0].page_content)4.4 模型选择建议

边缘/移动端:优先选择 270M版,CPU推理速度快,内存占用低(<1GB)。

云端常规服务:选择 0.6B版,平衡性能与算力,单GPU支持高并发(>100 QPS)。

大规模检索/科研:选择 27B版,需多GPU分布式部署,语义精度最高。

五、常见问题解答(FAQ)

Harrier-OSS-v1支持哪些编程语言?

目前官方主要提供Python接口,依托Hugging Face Transformers库;其他语言(如Java、Go)可通过REST API封装或第三方SDK调用,社区也在逐步完善多语言支持。

27B版模型需要什么硬件配置?

27B版模型单精度占用约108GB显存,建议使用8×A100(80GB)或4×H100(80GB)GPU进行分布式推理;若使用FP16/INT8量化,可降低至54GB/27GB显存,适配单张H100 GPU。

模型支持的最大文本长度是多少?超过后如何处理?

最大支持32768 token(约2.4万字中文),超过该长度的文本会被自动截断;长文本处理建议分块编码后融合,或使用模型原生的长上下文能力。

Harrier-OSS-v1与Sentence-BERT、E5等嵌入模型的区别?

架构:Harrier-OSS-v1采用decoder-only,Sentence-BERT/E5为encoder-only,decoder-only长文本建模能力更强;

多语言:Harrier-OSS-v1原生支持50+语言,Sentence-BERT多语言版覆盖语言较少;

性能:在MTEB v2多语言基准中,Harrier-OSS-v1 27B版得分74.3,显著高于Sentence-BERT(65)、E5(70)。

模型是否支持微调?如何进行微调?

支持微调,可基于Hugging Face Transformers的Trainer API,使用自定义多语言数据集进行微调;微软官方提供了微调示例脚本,适配检索、分类等任务。

轻量版(270M/0.6B)的性能损失大吗?

270M版保留27B版约85%的语义能力,0.6B版保留约92%,通过知识蒸馏实现小参数、高性能,适合算力有限的场景。

模型是否支持批量推理?批量大小如何设置?

支持批量推理,批量大小根据GPU显存调整:270M版可设置batch_size=64–128,0.6B版batch_size=16–32,27B版batch_size=1–4(分布式)。

Harrier-OSS-v1的嵌入向量维度是多少?

270M版:768维;0.6B版:1024维;27B版:4096维;均经过L2归一化,适合余弦相似度计算。

模型是否支持离线使用?

支持,首次下载模型权重后,可完全离线推理,无需联网;适合内网、涉密场景部署。

MIT许可证下,商业使用需要注意什么?

MIT许可证允许免费商业使用、修改、分发,无需支付版权费用,仅需保留原版权声明即可,无任何附加限制。

六、相关链接

Hugging Face模型仓库

Harrier-OSS-v1-270M:https://huggingface.co/microsoft/harrier-oss-v1-270M

Harrier-OSS-v1-0.6B:https://huggingface.co/microsoft/harrier-oss-v1-0.6B

Harrier-OSS-v1-27B:https://huggingface.co/microsoft/harrier-oss-v1-27B

七、总结

Harrier-OSS-v1作为微软研究院推出的开源多语言文本嵌入模型家族,凭借decoder-only架构、last-token pooling、L2归一化的技术组合,以及50+语言支持、32768 token长上下文、三档参数规模的核心优势,在多语言MTEB v2基准测试中实现了SOTA性能,填补了多语言长上下文嵌入领域的技术空白。其以MIT许可证开源的模式,结合Hugging Face生态的开箱即用特性,让全球开发者无需复杂配置即可快速集成高性能多语言语义能力,广泛应用于语义检索、文本聚类、跨语言交互、长文本处理等场景,既满足了边缘设备的轻量部署需求,也支撑了大规模企业级服务的高性能要求,成为多语言AI应用开发的核心基础工具,推动了跨语言语义技术的普及与落地。

版权及免责申明:本文由@AI工具箱原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/harrier-oss-v1.html