ID-LoRA:单图短音频驱动,统一音视频身份保真生成开源框架

一、ID-LoRA是什么

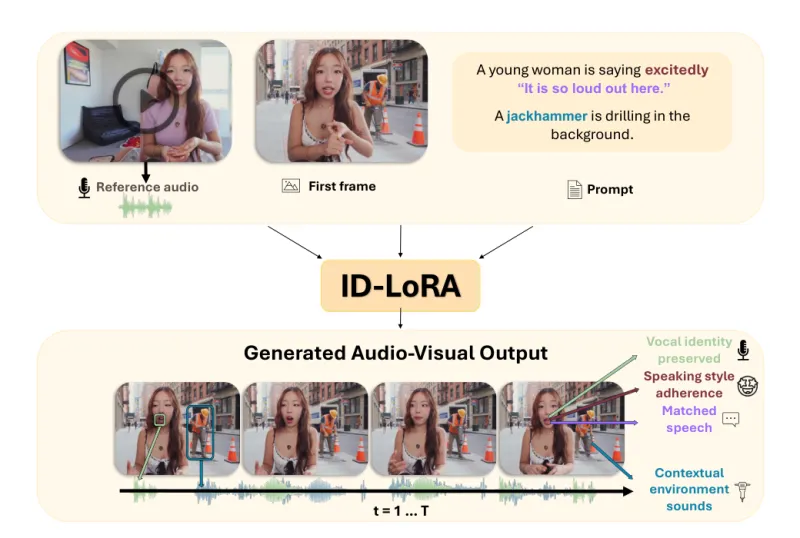

ID-LoRA全称为Identity‑Driven Audio‑Video Personalization with In‑Context LoRA,即基于上下文LoRA的身份驱动音视频个性化生成模型,是特拉维夫大学等机构于2026年发布的开源研究项目,核心目标是用最少参考条件、最低计算成本,实现视觉人脸与听觉音色双重身份精准保留的可控说话视频生成。

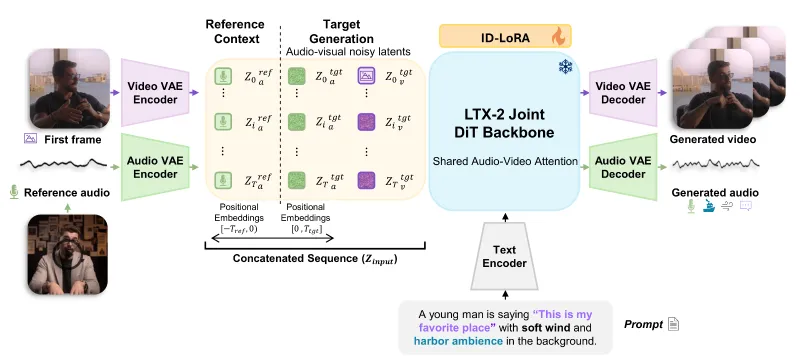

它以Lightricks的LTX‑2(19B参数)/LTX‑2.3(22B参数)联合音视频扩散模型为基座,通过轻量LoRA适配器重构音频自注意力、音视频交叉注意力与音频前馈网络,结合参考音频编码、负时间位置编码、身份引导等创新机制,在单一模型、单一生成流程内同步完成人脸生成、语音合成、口型对齐与环境音效控制,彻底告别“先做视频后配音、先做语音后合成视频”的级联低效方案。

ID-LoRA的核心突破在于:首次实现上下文学习式音视频身份统一迁移,用户无需收集大量素材、无需逐人设训练,仅提供1张清晰人脸图+1段短语音,就能让AI“变成这个人”说出指定台词,同时保持场景、语气、背景音完全可控,生成结果在真实感、一致性、自然度上达到业界领先水平,且开源完整代码、预训练权重、推理脚本与训练流程,降低科研与工程落地门槛。

二、功能特色

ID-LoRA围绕身份保真、统一生成、易用高效、可控性强四大核心打造,具备以下关键功能特色:

1. 双重身份精准保留

视觉身份:通过首帧强条件约束,生成视频人脸与参考图高度一致,姿态、表情、光照自然变化,不崩坏、不换脸。

声音身份:仅5秒参考音频即可复刻说话人声学特征,包括音色、语调、语速、口音,生成语音与真人高度相似。

口型同步:音视频联合生成,唇形与发音严格匹配,无滞后、错位、僵硬问题,自然度接近真人拍摄。

2. 统一音视频扩散生成

摒弃级联 pipeline,音频与视频在同一潜空间联合去噪,文本提示同时控制画面内容、说话内容、语气风格、背景音效,生成过程端到端、无中间环节损耗,整体一致性更强。

3. 零样本推理,无需人设微调

加载预训练LoRA权重即可直接使用,不针对新说话人做任何训练,零样本适配任意说话人,大幅降低使用成本与时间消耗,普通用户也能快速上手。

4. 轻量训练与部署

训练仅需约3000组数据、单GPU、6000步即可收敛,LoRA秩设为128,参数量极小。

推理支持int8量化,显著降低显存占用,24GB以上显存可运行一阶段,48GB以上可流畅运行二阶段高清模式。

5. 三级推理模式,兼顾速度与画质

| 推理模式 | 特点 | 适用场景 | 分辨率 |

|---|---|---|---|

| 一阶段 | 速度最快、显存占用低 | 快速测试、批量生成、低配置设备 | 512×512 |

| 二阶段 | 画质增强、2倍上采样 | 常规高清输出、内容创作 | 512×512→1024×1024 |

| 二阶段HQ | 超高保真、Res2s采样 | 精品内容、演示展示、科研对比 | 1024×1024+ |

6. 结构化提示词,精细可控

采用**[VISUAL]/[SPEECH]/[SOUNDS]**三标签提示格式,分别控制画面、台词、语气与背景音,描述越精准,生成结果越贴合预期,支持批量推理与自动化流程。

7. 完善生态支持

提供LTX‑2与最新LTX‑2.3双版本,LTX‑2.3音质、文本对齐、画质全面升级。

开放ComfyUI自定义节点,支持可视化节点式工作流,适配设计师、非代码用户。

预训练权重、预处理数据集、训练/推理脚本、评估工具完整开源,可直接复现论文结果。

三、技术细节

ID-LoRA的技术创新集中在架构设计、身份迁移机制、训练推理范式三方面,兼顾效果与效率:

1. 基座模型:LTX‑2/LTX‑2.3联合音视频DiT

以LTX系列音视频联合扩散Transformer为基座,内置视频VAE、音频VAE、文本编码器(Gemma 3),统一处理文本、图像、音频多模态信号,在同一潜空间完成去噪生成,保证音视频时序与语义强对齐。

2. 核心创新:上下文LoRA身份迁移

参考音频编码:将参考音频通过音频VAE编码为潜变量,与目标音频潜变量沿序列维度拼接,作为模型输入。

负时间位置编码:为参考音频分配负时序位置,与目标音频(正时序)清晰分离,解决跨视频参考的位置纠缠问题,保留音频内部时序结构。

身份引导机制:音频侧采用无分类器引导变体,对比有无参考信号的预测结果,放大说话人专属声学特征,同时不干扰文本控制的场景内容。

轻量LoRA适配:仅微调音频自注意力、音视频交叉注意力、音频FFN层,秩=128,训练参数极少,单GPU快速收敛。

3. 训练流程:低成本、高泛化

数据集:CelebV‑HQ(2963对)、TalkVid(11470对),提供预处理后视频/音频/文本潜变量。

训练配置:单GPU、AdamW优化器、学习率2e‑4、批大小4、6000步,以0.9概率使用首帧条件。

策略:audio_ref_only_ic,结合负时序位置,专注音频身份迁移,视频保持首帧约束与文本可控。

4. 推理流程:三级高质量 pipeline

一阶段:单分辨率扩散生成,速度快、显存友好。

二阶段:先生成基础分辨率,再用蒸馏LoRA做2倍空间上采样,细节更清晰。

二阶段HQ:LTX‑2.3专属,采用Res2s采样器与重缩放引导,步数更少、保真度更高。

5. 性能指标:领先主流方案

在CelebV‑HQ、TalkVid数据集上,ID-LoRA在说话人相似度、人脸相似度、口型同步LSE‑D/LSE‑C、CLAP音频质量、词错误率WER全面优于CosyVoice+WAN、ElevenLabs+WAN、Kling 2.6 Pro等方案;人工评测中,音色相似度、环境音自然度、说话方式偏好度显著领先。

四、应用场景

ID-LoRA凭借身份保真、零样本、易部署特性,覆盖内容创作、数字人、传媒、教育、交互、科研等多领域:

1. 数字人打造

快速生成专属虚拟主播、虚拟偶像、企业数字员工,人脸与声音高度统一,无需复杂建模与训练。

支持批量生成不同台词、不同场景的播报视频,降低内容生产成本。

2. 音视频内容创作

短视频解说、知识科普、广告配音:用真人形象与声音生成定制化内容,版权可控、风格统一。

影视/动画预览:快速生成角色配音与口型动画,提升前期制作效率。

3. 传媒与出版

新闻播报、资讯解读:用虚拟主播生成多语种、多时段内容,7×24小时更新。

有声书/课件可视化:将文本转为真人形象+原声朗读的视频,提升观看体验。

4. 教育与培训

虚拟教师:用讲师形象与声音生成标准化课程视频,保证教学风格一致。

技能演示:操作指导、语言教学,口型与发音精准同步,提升学习效果。

5. 人机交互与演示

智能客服、展厅导览:生成可交互的虚拟形象,语音回答自然、面部表情生动。

产品介绍:用品牌代言人/设计师形象生成讲解视频,增强信任感。

6. 科研与二次开发

音视频生成、说话人分离、人脸动画、口型同步等方向的基线模型与测试平台。

二次开发:集成到ComfyUI、Stable Diffusion、自研系统,扩展个性化生成能力。

五、使用方法

1. 环境依赖

Python 3.11及以上

CUDA 12.x

显存:一阶段≥24GB,二阶段/二阶段HQ≥48GB

uv包管理器

2. 安装部署

# 克隆仓库 git clone https://github.com/ID-LoRA/ID-LoRA.git cd ID-LoRA # 安装依赖 uv sync --frozen # 下载基础模型与LoRA权重 bash scripts/download_models.sh # 自定义路径:bash scripts/download_models.sh /path/to/models

3. LTX‑2.3版本切换

# 修改pyproject.toml [tool.uv.workspace] members = ["ID-LoRA-2.3/packages/*"] # 重新同步 uv sync # 下载LTX-2.3模型 bash ID-LoRA-2.3/scripts/download_models.sh

4. 提示词规范

必须使用三标签结构:

[VISUAL]:镜头、人物外貌、服装、场景、灯光、动作

[SPEECH]:精确台词,不概括、不省略

[SOUNDS]:语气、音量、麦克风距离、背景音

示例:

[VISUAL]: A medium shot of a young man with curly brown hair, sitting on a beige couch, wearing a light blue shirt, speaking with a calm expression in a warm-lit room. [SPEECH]: We are proud to introduce ID-LoRA, the identity-driven audio-video personalization model. [SOUNDS]: The speaker has a moderate volume, conversational tone, close to the microphone; soft background music creates a calm atmosphere.

5. 推理命令

一阶段推理(快速)

uv run python scripts/inference_one_stage.py \ --lora-path models/id-lora-celebvhq/lora_weights.safetensors \ --reference-audio reference.wav \ --first-frame face.png \ --prompt "三标签提示词" \ --output-dir outputs/

二阶段推理(高清)

uv run python scripts/inference_two_stage.py \ --lora-path models/id-lora-celebvhq/lora_weights.safetensors \ --reference-audio reference.wav \ --first-frame face.png \ --prompt "三标签提示词" \ --output-dir outputs/

二阶段HQ推理(LTX‑2.3超高保真)

uv run python ID-LoRA-2.3/scripts/inference_two_stage_hq.py \ --lora-path models/id-lora-celebvhq-ltx2.3/lora_weights.safetensors \ --reference-audio reference.wav \ --first-frame face.png \ --prompt "三标签提示词" \ --output-dir outputs/hq \ --quantize

6. 批量推理

新建prompts.json,写入多组配置

[

{

"prompt": "...",

"reference_path": "ref1.wav",

"first_frame_path": "face1.png",

"output_name": "output_01"

}

]运行批量脚本

uv run python scripts/inference_two_stage.py \ --lora-path models/.../lora_weights.safetensors \ --prompts-file prompts.json \ --output-dir outputs/batch

7. 训练流程

下载HuggingFace预处理数据集(CelebV‑HQ/TalkVid)

解压并重命名reference_audio_latents

修改配置文件configs/training_celebvhq.yaml

启动训练

CUDA_VISIBLE_DEVICES=0 uv run python packages/ltx-trainer/scripts/train.py configs/training_celebvhq.yaml

六、常见问题解答(FAQ)

Q:运行时报错ModuleNotFoundError: No module named 'ltx_core.model',如何解决?

A:这是因为早期仓库缺少ltx_core.model子包,直接执行git pull origin main拉取最新代码,重新uv sync即可修复。

Q:出现RuntimeError: Could not load libtorchcodec相关错误,怎么处理?

A:项目已将torchaudio.load替换为soundfile,避免FFmpeg依赖问题,更新到最新代码即可解决,无需手动安装系统FFmpeg。

Q:参考音频多长最合适,过短或过长有什么影响?

A:模型训练基于5秒左右音频,此长度音色迁移效果最优;短于3秒可能特征不足,长于10秒会增加计算量并降低相似度。

Q:显存不足无法运行二阶段,有什么优化方法?

A:启用--quantize开启int8量化,显著降低显存占用;优先使用一阶段推理;关闭后台占用显存程序;使用48GB及以上显卡。

Q:生成视频人脸不像参考图,如何提升一致性?

A:确保首帧图清晰、人脸完整、无遮挡、光线均匀;[VISUAL]明确描述人物特征并强调“speaking”;适当提高--identity-guidance-scale。

Q:生成语音音色不像参考音频,如何优化?

A:使用5秒左右清晰、无噪音、无背景音乐的干声;[SOUNDS]准确描述语气与录音条件;保证参考音频为单人说话;尝试LTX‑2.3权重。

Q:口型不同步、不自然,应该调整哪些参数?

A:使用二阶段或HQ模式;保证[VISUAL]明确说明人物正在说话;降低视频/音频CFG尺度,避免过度引导;使用清晰参考音频。

Q:提示词应该怎么写,才能让结果更符合预期?

A:严格遵循[VISUAL]/[SPEECH]/[SOUNDS]结构;[VISUAL]细节拉满;[SPEECH]逐字准确;[SOUNDS]细化语气、距离、背景音。

Q:LTX‑2与LTX‑2.3版本怎么选,两者有什么区别?

A:优先选LTX‑2.3(22B),文本对齐、音频质量、生成稳定性更强,支持二阶段HQ;LTX‑2(19B)适合显存有限、兼容旧环境。

Q:如何在ComfyUI中使用ID‑LoRA?

A:项目提供ID-LoRA-LTX2.3-ComfyUI自定义节点,按文档安装插件后,可通过节点流程加载LoRA、导入图片/音频、编写提示词,可视化生成视频。

Q:训练自己的数据集需要准备哪些数据,格式是什么?

A:需准备视频潜变量、目标音频潜变量、参考音频潜变量、文本嵌入向量;格式与CelebV‑HQ预处理数据一致,按官方目录结构存放,修改配置路径即可。

Q:使用ID‑LoRA生成内容有哪些伦理与合规要求?

A:仅限研究用途;生成他人形象/声音必须获得明确授权;所有AI生成内容必须标注为合成;禁止用于 impersonation、诈骗、造谣、诽谤等违法违规行为。

七、相关链接

GitHub开源仓库:https://github.com/ID-LoRA/ID-LoRA

HuggingFace模型:https://huggingface.co/AviadDahan

HuggingFace数据集:https://huggingface.co/datasets/noakraicer/ID-LoRA-CelebVHQ

八、总结

ID-LoRA是面向身份保真的统一音视频生成开源框架,依托LTX‑2/LTX‑2.3扩散基座与上下文LoRA创新机制,实现仅用单张人脸图+5秒短音频即可零样本生成人脸与声音高度一致、口型自然同步、场景与语气完全可控的说话视频,它以统一潜空间生成替代传统级联方案,兼顾生成质量与计算效率,支持三级推理模式与ComfyUI可视化工作流,在客观指标与人工评测上均优于主流开源与商业方案,同时开放完整代码、权重、数据集与工具链,大幅降低数字人打造、内容创作、虚拟播报、科研探索等场景的落地门槛,是当前音视频个性化生成领域兼具创新性、实用性与开放性的标杆级开源项目。

版权及免责申明:本文由@AI工具集原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/id-lora.html