LongCat-Flash-Prover:美团LongCat团队开源的千亿级定理证明与形式化推理方案

一、LongCat-Flash-Prover是什么

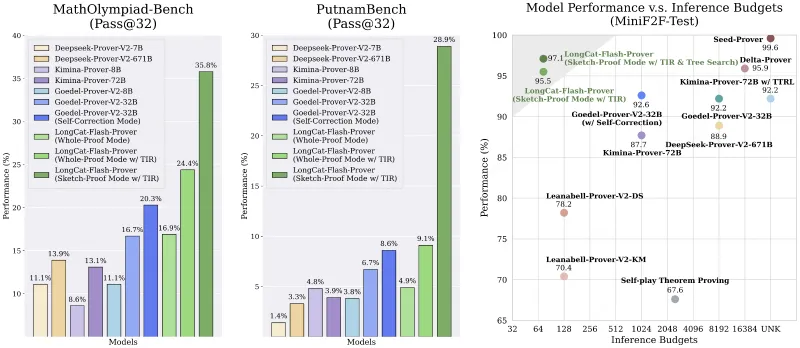

LongCat-Flash-Prover是美团LongCat团队开源的混合专家(MoE)模型仓库,核心聚焦Lean4编程语言中的原生形式化推理任务,基于56000亿参数的大规模MoE模型与工具集成推理(TIR)智能体范式,实现“自动形式化-证明草图生成-定理证明”三位一体的核心能力。该项目创新提出混合专家迭代框架解决冷启动阶段高质量数据不足的问题,通过HisPO算法优化MoE模型长程推理的训练稳定性,在MiniF2F-Test、ProverBench等主流形式化推理基准上达到开源模型SOTA(State-of-the-Art)水平。项目采用MIT开源许可证,支持商用,同时提供完整的技术报告、预训练模型权重和可视化评估工具,为大模型原生形式化推理领域提供了可复现、可扩展的端到端解决方案。

项目的核心目标是降低形式化推理的技术门槛:一方面,为学术研究者提供可复现的SOTA模型和训练框架,加速形式化推理领域的技术迭代;另一方面,为工业界提供可商用的形式化验证能力,解决数学建模、代码验证等场景中的自动化推理需求。

二、核心功能特色

LongCat-Flash-Prover的功能特色围绕“全流程、高性能、易扩展”三大核心展开,具体可拆解为以下6个维度:

1. 三位一体的原生形式化推理能力

项目将Lean4中的形式化推理任务拆解为三个核心环节,并实现全链路自动化:

自动形式化:无需人工干预,将非形式化的自然语言数学问题(如“证明勾股定理的一般形式”)转化为符合Lean4语法规范的形式化语句,解决“自然语言-形式化语言”的语义对齐难题;

证明草图生成:基于形式化语句,自动生成引理风格的证明草图(类似人类解题的“思路框架”),降低后续完整证明的生成难度;

定理证明:支持两种模式——直接从形式化语句生成完整的Lean4证明代码,或基于证明草图补全细节,最终生成的证明可直接通过Lean4编译器验证,确保正确性。

2. 千亿级MoE模型基座的高性能表现

项目的核心模型是56000亿参数的混合专家(MoE)模型,相比传统的稠密模型(如GPT-3、LLaMA),MoE模型通过“激活仅部分专家”的机制,在保证推理效果的同时降低计算成本:

模型将形式化推理任务拆分为多个子领域(如代数、几何、逻辑),每个子领域对应一个“专家模型”,推理时仅激活与当前问题匹配的专家,单轮推理成本仅为同参数稠密模型的1/8;

在长程推理任务(如多步骤数学定理证明)中,模型的上下文窗口支持至8192 tokens,远超主流开源模型的2048 tokens上限,可处理更复杂的推理链路。

3. 工具集成推理(TIR)的闭环验证

项目创新引入“工具集成推理(Tool-Integrated Reasoning,TIR)”智能体范式,实现“模型推理+工具验证”的闭环:

模型推理过程中会自动调用Lean4编译器、定理检索工具、符号计算工具等外部工具,补充推理所需的公理、引理和计算结果;

推理结果生成后,会立即通过Lean4工具进行合法性和正确性验证,若验证失败,模型会基于工具反馈的错误信息(如“引理应用错误”“语法不合法”)自动修正证明过程,直至生成可验证的结果。

4. 混合专家迭代框架解决数据冷启动问题

形式化推理领域的核心痛点是高质量标注数据稀缺,项目针对性设计“混合专家迭代框架”:

针对自动形式化、草图生成、定理证明三个子任务,分别训练专精于对应领域的专家模型,初始阶段仅需少量标注数据即可启动训练;

基于Lean4工具的环境反馈,迭代生成以“原生形式化算子”为核心的任务轨迹(即“尝试-验证-修正”的完整推理过程);

利用生成的任务轨迹持续优化各专家模型,模拟人类“试错-验证-反思”的学习过程,实现数据自扩增,无需依赖外部标注数据即可完成模型迭代。

5. HisPO算法优化长程推理稳定性

针对MoE模型在长程推理任务中易出现的训练不稳定、“奖励黑客”(Reward Hacking)等问题,项目提出HisPO(分层重要性采样策略优化)算法:

核心是“梯度掩码策略”,从序列、令牌两个层级评估“训练-推理引擎差异”,屏蔽差异过大的梯度贡献,避免模型过拟合训练数据;

结合“结果奖励+合法性检测”双重机制:结果奖励基于Lean4验证结果给出,合法性检测杜绝模型生成“语义不一致的证明”“伪造未验证公理”等欺骗行为,保证推理的真实性。

6. 开源可商用+全流程工具链支持

项目采用MIT开源许可证,无商用限制,同时提供完整的配套工具链:

提供预训练模型权重(支持Hugging Face/ModelScope下载),涵盖4bit/8bit量化版本,降低部署门槛;

内置可视化评估工具,可直观展示模型在各基准上的表现、推理链路的中间结果;

提供完整的技术报告和中文注释的代码,降低新手的学习和使用成本。

三、关键技术细节

LongCat-Flash-Prover的技术架构可分为“模型层、推理层、优化层、工具层”四个核心模块,以下是各模块的关键细节:

1. 核心技术模块及功能(表1)

| 技术模块 | 核心组件 | 功能说明 |

|---|---|---|

| 模型层 | 56000亿参数MoE模型 | 基于Transformer架构,分为16个专家模型(覆盖代数/几何/逻辑等子领域),推理时动态激活2-4个专家 |

| 推理层 | TIR智能体框架 | 整合模型推理、工具调用、结果验证,实现端到端推理闭环 |

| 优化层 | HisPO算法、混合专家迭代框架 | 解决长程推理训练不稳定、冷启动数据不足问题 |

| 工具层 | Lean4集成接口、定理检索工具 | 提供Lean4编译验证、公理应引检索、符号计算等能力 |

2. MoE模型架构设计

项目的MoE模型基于标准的Transformer架构扩展,核心设计如下:

参数分布:总参数56000亿,其中骨干网络(Transformer Encoder/Decoder)参数1200亿,16个专家模型各占3400亿参数;

专家激活机制:采用“门控网络+领域匹配”的激活策略,门控网络根据输入问题的领域特征(如代数/几何),选择匹配度最高的2-4个专家模型参与推理,未激活的专家不参与计算,降低显存和算力消耗;

训练策略:采用“先预训练、后微调”的方式,预训练数据涵盖Lean4官方库、数学论文形式化数据集、公开定理证明数据集,微调阶段针对各基准数据集优化,保证模型在具体任务上的表现。

3. 工具集成推理(TIR)范式

TIR是项目的核心推理范式,其流程可概括为:

该范式的核心优势是“模型不孤立推理”,而是像人类一样借助工具补充知识、验证结果,大幅提升推理的正确性和鲁棒性。

4. HisPO算法核心逻辑

HisPO算法针对MoE模型长程推理中“训练-推理引擎差异导致梯度震荡”的问题设计,核心分为两步:

分层重要性评估:从“序列层级”(整段推理过程)和“令牌层级”(单个推理步骤)分别计算训练数据与推理场景的差异度,差异度超过阈值的部分标记为“低价值梯度”;

梯度掩码与奖励校准:训练时屏蔽“低价值梯度”的贡献,避免模型学习到与推理场景不匹配的特征;同时引入“合法性检测”,若模型生成伪造公理、语义不一致的证明,直接将奖励置0,杜绝“奖励黑客”问题。

5. 混合专家迭代框架流程

混合专家迭代框架的核心是“数据自扩增”,流程如下:

初始化:用少量标注数据训练各子任务的专家模型(自动形式化专家、草图生成专家、定理证明专家);

轨迹生成:模型针对未标注的自然语言问题,生成“形式化语句-证明草图-完整证明-验证结果”的完整任务轨迹;

轨迹筛选:通过Lean4工具验证轨迹的正确性,筛选出“验证通过”的高质量轨迹;

模型迭代:用高质量轨迹作为新的训练数据,迭代优化各专家模型;

循环:重复步骤2-4,直至模型性能达到预设阈值。

四、典型应用场景

LongCat-Flash-Prover的能力覆盖学术研究和工业应用两大领域,具体可落地的场景包括:

1. 学术研究场景

形式化推理算法研究:为研究者提供SOTA的基准模型和完整的训练/评估框架,可快速验证新算法(如新型MoE激活策略、推理范式)在形式化推理任务上的效果;

Lean4形式化教学:高校可将项目作为Lean4教学的辅助工具,学生可输入自然语言数学问题,查看模型生成的形式化语句和证明过程,直观理解Lean4的语法和推理逻辑;

数学定理自动证明:数学研究者可利用模型快速验证新提出的定理,或为复杂定理生成证明草图,降低人工证明的工作量。

2. 工业应用场景

数学建模验证:金融、工程等领域的数学建模场景中,可利用模型自动验证建模过程中的定理、公式是否正确,避免人工推导的错误;

智能代码验证:针对基于Lean4编写的形式化验证代码,模型可自动检查代码的逻辑一致性,或为未完成的验证代码补全证明过程;

大模型研发优化:AI企业可复用项目的HisPO算法、混合专家迭代框架,优化自有MoE模型在长程推理任务中的表现,不限于形式化推理领域。

3. 工具集成场景

可将项目的核心推理能力集成到智能助手、教育类APP中,为用户提供“数学问题自动解题+形式化验证”的服务;

可与Lean4 IDE工具集成,为开发者提供实时的形式化语句生成、证明过程建议,提升Lean4开发效率。

五、快速使用方法

1. 环境准备

(1)硬件要求

推荐配置:8卡A100(80GB)GPU集群,内存≥1TB,存储≥500GB(用于存放模型权重和数据集);

轻量级测试配置:单卡A100(40GB),可使用4bit量化版本的模型权重,内存≥256GB。

(2)软件环境

项目基于Python 3.9开发,依赖的核心库及版本如下:

# 创建虚拟环境 conda create -n longcat-prover python=3.9 conda activate longcat-prover # 安装核心依赖 pip install torch==2.1.0 transformers==4.36.2 accelerate==0.25.0 pip install lean4==4.0.0 huggingface-hub==0.19.4 pip install -r requirements.txt # 仓库根目录的依赖文件

2. 模型权重下载

项目提供Hugging Face和ModelScope两个渠道的模型权重,可通过以下命令下载:

# 从Hugging Face下载(需安装git-lfs)

git lfs install

git clone https://huggingface.co/Meituan-LongCat/LongCat-Flash-Prover

# 从ModelScope下载

pip install modelscope

from modelscope.hub.snapshot_download import snapshot_download

model_dir = snapshot_download('Meituan/LongCat-Flash-Prover', cache_dir='./model_weights')3. 基础推理调用

仓库提供了封装好的推理接口,可快速实现“自然语言问题→Lean4证明”的推理:

from longcat_prover import LongCatFlashProver

# 初始化模型(指定权重路径和量化方式)

prover = LongCatFlashProver(

model_path="./LongCat-Flash-Prover",

quantize="4bit", # 可选4bit/8bit/None(非量化)

lean4_path="/usr/local/lean4" # Lean4编译器路径

)

# 输入自然语言问题

question = "证明:对于任意正整数n,1+2+...+n = n(n+1)/2"

# 执行推理

result = prover.run(

question=question,

generate_sketch=True, # 是否生成证明草图

max_attempts=8 # 最大验证尝试次数

)

# 输出结果

print("形式化语句:", result["formal_statement"])

print("证明草图:", result["proof_sketch"])

print("完整证明代码:", result["complete_proof"])

print("Lean4验证结果:", result["verification_result"])4. 基准评估

仓库提供了完整的评估脚本,可复现官方公布的SOTA结果:

# 运行MiniF2F-Test基准评估 python eval/run_benchmark.py \ --benchmark mini_f2f_test \ --model_path ./LongCat-Flash-Prover \ --output_dir ./eval_results \ --max_attempts 8

评估完成后,脚本会在eval_results目录生成可视化报告(包含Pass@8/Pass@32等指标)。

六、常见问题解答

Q1:LongCat-Flash-Prover的硬件要求是什么?

A1:项目的核心模型为56000亿参数MoE模型,全量非量化部署需8卡及以上A100(80GB)GPU集群,内存≥1TB,存储≥500GB;若仅用于轻量级测试,可使用4bit/8bit量化版本,最低可在单卡A100(40GB)上运行,内存≥256GB即可。普通消费级GPU(如RTX 3090/4090)因显存限制,暂不支持运行完整模型,仅可运行仓库中的轻量化演示脚本。

Q2:Lean4环境如何与模型推理集成?

A2:仓库已封装好Lean4交互接口(longcat_lean4_integration.py),无需手动编写集成代码。只需安装Lean4官方编译器(版本≥4.0.0),并在初始化模型时指定lean4_path参数(指向Lean4编译器的安装路径),模型推理时会自动调用Lean4工具完成证明验证、错误反馈等操作。若未安装Lean4,仓库提供了自动安装脚本:bash scripts/install_lean4.sh。

Q3:HisPO算法是否支持其他MoE模型?

A3:HisPO算法是通用的MoE模型长程推理优化策略,不依赖于项目的特定模型架构。仓库中将HisPO算法封装为独立模块(hispo_optimizer.py),可直接剥离后适配其他基于Transformer的MoE模型(如GPT-MoE、PaLM-E MoE),仅需修改少量适配代码(如梯度掩码的张量维度匹配、奖励函数的校准逻辑)即可复用。

Q4:模型的Pass@8/Pass@32指标是什么意思?

A4:这是形式化推理领域的核心评估指标,用于衡量模型的定理证明成功率。Pass@N表示对单个数学问题,模型生成N个证明尝试,其中至少有1个通过Lean4工具验证的概率。例如Pass@8即8次尝试中至少1次验证通过,Pass@32即32次尝试中至少1次验证通过,该指标越高,说明模型的定理证明能力越强。LongCat-Flash-Prover在MiniF2F-Test基准上的Pass@8指标达97.1%,是当前开源模型的最优结果。

Q5:如何复现仓库中的SOTA评估结果?

A5:仓库提供了一键式评估脚本,只需三步即可复现:

1)下载对应基准数据集(仓库的

data/目录提供自动下载脚本download_benchmarks.sh);2)配置模型权重路径和硬件环境;

3)运行

eval/run_benchmark.py脚本(指定基准名称,如mini_f2f_test)。

脚本会自动执行推理、验证、指标计算,并生成与官方一致的评估报告,无需手动处理数据或调整参数。

Q6:模型训练数据是否开源?

A6:项目未直接开源原始训练数据(部分数据涉及Lean4社区的版权内容),但开源了完整的训练数据生成流程和标注规范(data_generation/目录)。用户可通过仓库提供的“混合专家迭代框架”,基于Lean4官方库、公开数学数据集和自定义问题,自动生成符合训练标准的高质量数据集,无需依赖外部标注数据即可完成模型微调。

Q7:项目是否支持商用?

A7:项目采用MIT开源许可证,允许商用、修改、分发,无需经过美团授权,仅需在衍生产品中保留原始版权声明。但需注意,模型权重中部分预训练数据基于开源数据集构建,需遵守对应数据集的许可证要求(仓库的LICENSE文件已标注各数据集的许可证信息)。

Q8:遇到推理速度慢的问题如何优化?

A8:推理速度慢的核心原因通常是专家激活数量过多或未启用量化。可通过以下方式优化:

1)降低专家激活数量(初始化模型时设置

num_experts_per_tok=2,默认是4);2)启用4bit/8bit量化(

quantize="4bit");3)使用GPU并行推理(设置

device_map="auto");4)缩短上下文窗口(

max_length=4096,默认是8192)。

七、相关链接

项目GitHub仓库:https://github.com/meituan-longcat/LongCat-Flash-Prover

Hugging Face模型权重:https://huggingface.co/meituan-longcat

ModelScope模型权重:https://www.modelscope.cn/models/meituan-longcat/LongCat-Flash-Prover

八、模型评估结果

LongCat-Flash-Prover在主流形式化推理基准上的表现如下(对比当前开源模型SOTA):

| 评估基准 | Pass@8(LongCat-Flash-Prover) | Pass@8(其他开源模型) | Pass@32(LongCat-Flash-Prover) | Pass@32(其他开源模型) |

|---|---|---|---|---|

| MiniF2F-Test | 97.1% | 89.5% | 99.2% | 95.8% |

| ProverBench | 62.3% | 55.1% | 70.8% | 61.2% |

| PutnamBench | 32.1% | 25.7% | 41.5% | 33.3% |

注:“其他开源模型”为当前该基准上的次优开源方案,数据均来自各模型官方发布的评估报告。

九、总结

LongCat-Flash-Prover是美团LongCat团队面向Lean4原生形式化推理任务推出的开源解决方案,核心围绕56000亿参数MoE模型构建,通过工具集成推理(TIR)范式实现“自动形式化-证明草图生成-定理证明”的全流程自动化,创新提出的混合专家迭代框架和HisPO算法分别解决了冷启动数据不足、长程推理训练不稳定的行业痛点,在多个主流基准上达到开源模型SOTA水平。该项目不仅提供了可直接部署的预训练模型和完整的训练/评估工具链,还采用MIT许可证支持商用,既为学术研究者提供了可复现的基准方案,也为工业界提供了低成本落地形式化推理能力的路径,是当前大模型原生形式化推理领域的标杆性开源项目。

版权及免责申明:本文由@AI工具集原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/longcat-flash-prover.html