MicroCoder:微软剑桥联合开源的AI 代码模型专属强化学习库

一、MicroCoder是什么

MicroCoder是由微软亚洲研究院、剑桥大学、普林斯顿大学联合开源的AI 代码模型专属强化学习库,聚焦解决现代代码大模型(如Qwen 2.5、Qwen 3系列)训练中的代际断层、数据集适配、强化学习失效三大核心痛点,项目以“算法创新+数据升级+训练经验沉淀”为核心,提供了一套完整的代码模型强化学习训练解决方案,包含优化后的强化学习算法、高难度专属数据集、34条可落地训练经验及配套评估框架,彻底打破传统训练方法在新一代代码模型上“效果骤降、难以收敛”的瓶颈。

MicroCoder并非单一工具,而是集研究成果、训练框架、数据集、实践指南于一体的综合性开源项目,核心目标是让强化学习在Qwen 3等新一代代码模型上重新生效,实现模型代码生成能力的持续、稳定提升,同时为代码大模型训练领域提供可复用的方法论与实践标准。

二、功能特色

1. 核心突破:解决代码模型训练“代际断层”

传统强化学习方法(如GRPO)与主流数据集(如DeepCoder)在Qwen 2.5上效果显著,但在Qwen 3上几乎失效——核心原因是新模型能力远超旧数据集难度上限、输出行为与旧模型根本不同(如输出长度持续增长、方差扩大)。MicroCoder针对性解决这一问题,实现跨代际模型训练效果的一致性提升。

2. 三大核心功能模块

| 功能模块 | 核心价值 | 解决痛点 |

|---|---|---|

| MicroCoder-GRPO算法 | 优化版强化学习策略,适配现代代码模型训练动态 | 传统GRPO在新模型上收敛差、输出长度失控、多样性不足 |

| MicroCoder-Dataset | 13300道高难度、全新编程竞赛题,难度精准分级 | 旧数据集难度过低、重复度高,无法驱动新模型能力提升 |

| MicroCoder-Insights | 30+受控实验总结的34条训练经验,覆盖7大维度 | 代码模型训练无统一标准,经验零散、难以复用 |

3. 关键特色亮点

算法精准适配:在GRPO基础上做3项关键修改,专门适配新模型输出特性。

数据难度驱动:摒弃“海量简单题”思路,以高难度、新颖题目为核心,性能增益是DeepCoder的3倍。

经验体系化:从评估器、温度、数据、上下文长度等7大维度沉淀可直接复用的训练规则。

全链路开源:算法、数据集、训练脚本、实验图表、经验文档全部开源,无商业壁垒。

效果可验证:在最新代码测试集上实现显著性能提升,彻底解决“先涨后跌”的训练困境。

三、技术细节

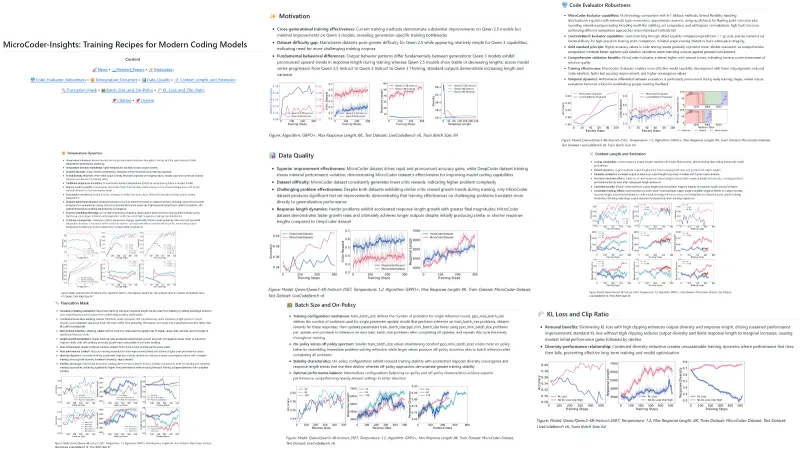

1. MicroCoder-GRPO:优化版强化学习算法(核心技术)

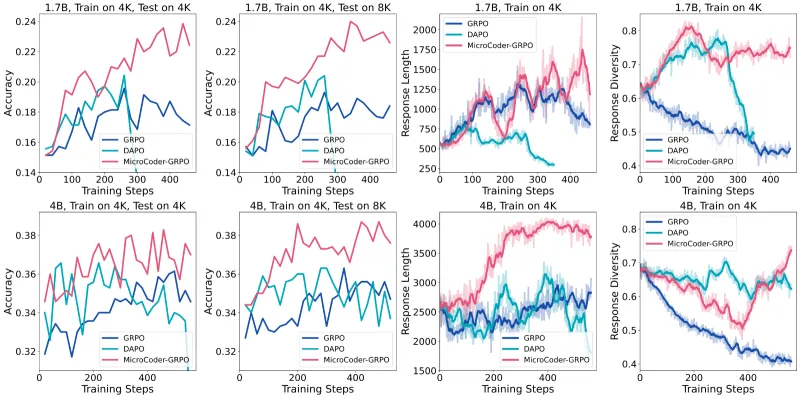

MicroCoder-GRPO在标准GRPO基础上,针对代码模型训练做3项关键技术改进,是项目的核心算法创新:

(1)条件截断掩码(Conditional Truncation Masking)

传统问题:全掩码策略(截断输出优势置零)导致模型输出长度增长受限,无掩码则训练不稳定。

MicroCoder方案:仅对同时满足4个条件的输出执行掩码——达到最大长度、答案非错误、无尾部重复序列、随机概率抽取。

技术效果:解锁长输出潜力,规避训练波动,收敛性能优于全掩码/无掩码方案。

(2)多样性驱动的温度选择(Diversity-Driven Temperature Selection)

传统问题:固定温度导致输出多样性与收敛值偏差大,训练易震荡。

MicroCoder方案:先测量模型初始输出多样性趋势,动态选择能让多样性平稳收敛的温度;采用“先低温稳收敛、后高温探多样性”的策略。

技术效果:避免温度渐变负面影响,确保训练全程输出多样性稳定,提升策略优化效率。

(3)移除KL损失+高裁剪比率(KL Removal + High Clipping Ratio)

传统问题:KL散度惩罚限制模型探索,导致“先涨后跌”,长期性能停滞。

MicroCoder方案:彻底移除KL损失,同时采用更高的裁剪比率(放宽策略更新限制)。

技术效果:模型可自由探索复杂代码生成模式,性能持续提升,无后期回落现象。

2. MicroCoder-Dataset:高难度专属数据集(数据核心)

(1)四阶段数据处理流程

收集:从LeetCode、Codeforces、AtCoder等全球编程竞赛平台,抓取2023-2026年全新题目,确保时效性与新颖性。

处理:去噪、格式标准化,统一输入输出规范,剔除重复、错误题目。

筛选:基于五维难度评估矩阵自动过滤,仅保留高难度题目。

验证:LLM生成测试用例+人工双重验证,确保题目质量与可执行性。

(2)五维难度评估体系(核心技术)

参考Bloom教育目标分类法、McCabe与Halstead复杂度理论,构建5维度难度评分,精准筛选高价值题目:

认知复杂度:从记忆、理解到创造的层级难度

结构复杂度:控制流、分支、循环的复杂度分析

算法复杂度:时间/空间复杂度(O(n)、O(n²)等)评估

代码复杂度:Halstead度量(操作数、操作符数量)

领域知识:是否涉及算法、数据结构、系统设计等专业知识

(3)数据集核心参数

总题量:13300道

难度分布:简单题<25%,中等题≈25%,困难题>50%(高难度占比远超传统数据集)

时效性:90%题目为2023年后新增,无历史重复

覆盖领域:算法、数据结构、系统设计、前端、后端、机器学习等全栈编程场景

3. MicroCoder-Insights:34条训练经验(实践核心)

通过30+组受控实验,从7大维度总结34条可直接复用的训练规则,覆盖代码模型训练全流程:

代码评估器:评估指标选择、阈值设置、多指标融合策略

温度调节:初始温度、动态调整、多样性与收敛平衡

训练数据:难度配比、批次大小、数据清洗、去重标准

上下文长度:最大长度设置、截断策略、长输出优化

截断掩码:条件触发规则、概率控制、掩码时机

批次大小:显存适配、梯度累积、并行训练策略

KL损失/裁剪率:移除KL的条件、裁剪比率阈值、策略更新约束

四、应用场景

1. 学术研究场景

代码大模型强化学习训练方法研究:验证MicroCoder-GRPO在不同模型(如Llama 3、GPT-4o、Qwen 3)上的通用性。

数据难度与模型能力关系研究:探索“高难度数据驱动模型能力边界”的底层逻辑,发表顶会论文(NeurIPS、ACL、ICML等)。

跨代际模型训练规律研究:分析Qwen 2.5→Qwen 3、Llama 2→Llama 3等模型迭代的训练差异,构建通用训练框架。

2. 工业落地场景

企业级代码模型训练:互联网、AI公司训练内部代码助手、自动编程工具,提升代码生成准确率与复杂问题解决能力。

开源代码模型优化:对StarCoder、CodeLlama、Qwen-Code等开源模型进行后训练,突破性能瓶颈,适配企业业务场景。

编程教育与竞赛:基于MicroCoder-Dataset构建AI编程教学平台、竞赛题库,训练学生/模型解决高难度编程问题。

3. 开发者个人场景

个人AI编程助手优化:基于MicroCoder方法微调小参数代码模型,打造专属代码生成工具,提升个人开发效率。

代码能力提升:使用MicroCoder-Dataset练习高难度编程题,快速突破算法瓶颈,适配大厂面试与实际项目需求。

五、使用方法

1. 环境准备

(1)硬件要求

推荐:NVIDIA A100(80GB)/H100 GPU,显存≥40GB(适配7B/13B代码模型训练)

最低:NVIDIA RTX 4090(24GB),可训练3B及以下小模型

(2)软件依赖

# 克隆仓库 git clone https://github.com/ZongqianLi/MicroCoder.git cd MicroCoder # 安装依赖 pip install torch transformers accelerate datasets peft trl tensorboard

2. 核心使用流程

(1)获取MicroCoder-Dataset

from datasets import load_dataset

# 加载完整数据集

dataset = load_dataset("ZongqianLi/MicroCoder-Dataset")

# 按难度筛选(easy/medium/hard)

hard_dataset = dataset["train"].filter(lambda x: x["difficulty"] == "hard")(2)运行MicroCoder-GRPO训练(核心脚本)

# 基础训练命令(以Qwen 2.5-Code-7B为例) python train_grpo.py \ --model_name_or_path Qwen/Qwen2.5-Code-7B-Instruct \ --dataset_name ZongqianLi/MicroCoder-Dataset \ --difficulty_level hard \ --use_conditional_mask True \ --diversity_driven_temp True \ --remove_kl_loss True \ --clipping_ratio 0.3 \ --output_dir ./microcoder_model \ --num_train_epochs 3 \ --per_device_train_batch_size 4 \ --gradient_accumulation_steps 8

(3)应用训练经验(MicroCoder-Insights)

直接参考MicroCoder-Insights.md文档,按7大维度调整训练参数:

温度设置:初始温度0.7,多样性达标后升至1.0

批次大小:根据显存调整,7B模型推荐per_device_batch_size=4+梯度累积8

截断长度:代码模型推荐max_seq_length=2048,开启条件掩码

评估器:使用pass@1、pass@5、pass@10作为核心评估指标

(4)模型推理与验证

from transformers import AutoModelForCausalLM, AutoTokenizer

# 加载训练后的模型

model = AutoModelForCausalLM.from_pretrained("./microcoder_model")

tokenizer = AutoTokenizer.from_pretrained("./microcoder_model")

# 生成代码

prompt = "编写一个快速排序算法,支持整数列表排序,处理边界情况"

inputs = tokenizer(prompt, return_tensors="pt")

outputs = model.generate(**inputs, max_new_tokens=512, temperature=0.8)

print(tokenizer.decode(outputs[0], skip_special_tokens=True))六、常见问题解答(FAQ)

MicroCoder与传统GRPO的核心区别是什么?

MicroCoder-GRPO在标准GRPO基础上,新增条件截断掩码、多样性驱动温度选择、移除KL损失+高裁剪比率三项关键修改,专门适配现代代码模型的输出动态(如长输出、高多样性需求),解决传统GRPO在新模型上收敛差、效果骤降的问题。

MicroCoder-Dataset与DeepCoder等传统数据集有何不同?

核心差异是难度驱动设计:传统数据集以简单题为主(占比>70%),MicroCoder-Dataset通过五维难度评估,将困难题占比提升至50%以上,且90%题目为2023年后全新竞赛题,无历史重复,性能增益是DeepCoder的3倍。

MicroCoder支持哪些代码模型?

支持所有主流开源代码模型,包括Qwen 2.5/3-Code系列、Llama 3-Code、StarCoder、CodeLlama、DeepSeek-Code等,兼容7B/13B/34B等不同参数规模,只需调整训练脚本中的model_name_or_path参数即可。

个人开发者(无A100/H100)能否使用MicroCoder?

可以。个人开发者可使用RTX 4090(24GB)训练3B及以下小参数代码模型(如Qwen 2.5-Code-3B),或采用LoRA微调(降低显存占用),同时可直接使用MicroCoder-Dataset练习编程、参考34条训练经验优化个人模型训练流程。

MicroCoder的34条训练经验是否适用于所有代码模型?

大部分经验(如温度调节、数据难度配比、截断策略)具有通用性,但部分参数(如裁剪比率、KL损失设置)需根据模型规模(7B/13B/34B)、架构(Decoder-only/Encoder-Decoder)微调,建议先做小规模实验验证后再大规模训练。

使用MicroCoder训练后,模型代码生成能力能提升多少?

在Qwen 3-Code系列上,使用MicroCoder-GRPO+MicroCoder-Dataset训练后,**pass@1指标平均提升25%-35%**,复杂算法题(如动态规划、图论)解决能力提升尤为显著,彻底解决传统训练“先涨后跌”的问题。

MicroCoder是否支持多GPU并行训练?

支持。项目基于accelerate库开发,可通过accelerate launch命令启动多GPU训练,自动适配单机多卡、多机多卡场景,大幅缩短训练时间。

七、相关链接

项目GitHub主页:https://github.com/ZongqianLi/MicroCoder

论文(ArXiv):https://arxiv.org/abs/2603.07777

MicroCoder-Dataset Hugging Face地址:https://huggingface.co/datasets/ZongqianLi/MicroCoder-Dataset

八、总结

MicroCoder是微软亚洲研究院、剑桥大学、普林斯顿大学联合推出的,针对现代代码大模型训练痛点的综合性开源解决方案,通过优化后的MicroCoder-GRPO强化学习算法、高难度专属MicroCoder-Dataset、34条体系化训练经验三大核心模块,彻底解决了传统训练方法在Qwen 3等新一代代码模型上的“代际断层”问题,实现了模型代码生成能力的持续、稳定提升。项目不仅提供了可直接复用的算法、数据与训练脚本,更沉淀了代码模型强化学习训练的底层方法论与实践标准,适用于学术研究、工业落地与个人开发者等多场景,为代码大模型训练领域树立了新的技术标杆,推动AI代码生成能力向更复杂、更高效的方向发展。

版权及免责申明:本文由@AI铺子原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/microcoder.html