Mirage:开源AI智能体统一虚拟文件系统,多源资源一键挂载管理

一、Mirage 是什么

Mirage 是由 strukto-ai 开源打造的AI 智能体统一虚拟文件系统(VFS),项目基于 TypeScript 与 Python 双语言开发,遵循 Apache-2.0 开源协议。

它的核心设计理念是抹平异构数据源与第三方服务的接口差异,将对象存储、云盘、即时通讯工具、代码仓库、数据库、缓存中间件等各类异构资源,统一挂载为一套类 Unix 树形文件目录结构。

对于 AI 智能体、大模型应用开发者而言,无需单独学习各类平台的 API、SDK 和接口规范,仅通过熟悉的 Linux Bash 命令,即可完成跨平台、跨服务的数据读取、检索、拷贝、过滤与流转操作,是专为AI 智能体编排、多源数据统一管理而生的底层基础设施工具。

Mirage 打破了传统 AI 应用对接多服务时接口碎片化、适配成本高、逻辑复杂的痛点,把分散的各类业务资源抽象成标准化文件系统,让 LLM 智能体像操作本地文件夹一样,统一管控全网各类数据源与第三方应用服务。

二、功能特色

1. 多类资源统一挂载管理

支持几乎全品类主流资源一键挂载至虚拟文件树根目录,实现万物皆文件的设计理念:

存储类:本地磁盘、内存临时存储、S3 兼容对象存储、各类私有云/公有云对象桶;

协作办公类:Google Drive、Slack、Gmail 等办公与通讯平台;

开发运维类:GitHub 代码仓库、Redis 缓存、常规数据库、SSH 远程服务器;

扩展自定义:支持开发者自定义适配私有业务系统、内部接口服务,灵活扩展挂载节点。

2. 原生兼容 Unix 命令生态

内置完整的类 Linux 命令集,ls、cat、cp、grep、wc、find 等常用命令全量支持,且命令可跨挂载资源全局生效。

支持管道符、数据流重定向、子 Shell 会话、并行任务执行等原生 Shell 能力,跨服务数据流转无需额外开发中间转换逻辑,极大降低 AI 智能体的指令编排难度。

3. 双层缓存架构加速访问

项目内置索引缓存+文件内容缓存双层缓存机制:

索引缓存:缓存目录结构、文件元数据、资源列表,减少远程接口请求次数;

内容缓存:缓存文件实体数据、接口返回内容,支持内存缓存与 Redis 分布式缓存两种后端。

通过缓存策略大幅降低重复请求延迟,提升大模型调用智能体操作多源数据时的响应速度。

4. 可移植版本化工作空间

Mirage 提供独立隔离的工作空间能力,支持工作空间快照创建、版本备份、一键克隆与跨环境迁移。开发者可将配置好的挂载规则、目录结构、权限配置打包保存,在不同服务器、不同 AI 项目环境中快速复用,无需重复手动配置。

5. 多语言多框架无缝兼容

同时提供 Python SDK、TypeScript SDK 双语言开发套件,兼容主流 AI 智能体开发生态:

适配框架:OpenAI Agents SDK、Vercel AI SDK、LangChain、Pydantic AI 等主流大模型应用框架;

部署形态:支持嵌入 FastAPI、Express 等异步 Web 框架,也可独立以 CLI 命令、守护进程方式部署,轻量化无额外环境依赖负担。

6. 低代码自定义扩展能力

支持自定义资源适配器、自定义 Shell 命令重载、挂载权限精细化管控。企业可基于原生框架快速适配内部私有系统、行业专属业务接口,无需修改项目底层源码,二次开发门槛极低。

三、技术细节

1. 项目技术栈

Mirage 采用双语言混合开发,代码结构分工明确,整体技术构成如下:

| 技术分类 | 具体选型 | 占比/版本要求 |

|---|---|---|

| 核心开发语言 | TypeScript、Python | TypeScript 约57.5%,Python 约42.4% |

| 运行环境 | Node.js、Python ≥3.12 | 严格版本约束,保证兼容性 |

| 缓存后端 | 内存缓存、Redis | 支持单机/分布式部署 |

| 开源协议 | Apache-2.0 | 商用、开源项目均可免费使用 |

| 适配生态 | OpenAI Agents、LangChain、Vercel AI SDK | 主流AI智能体框架全兼容 |

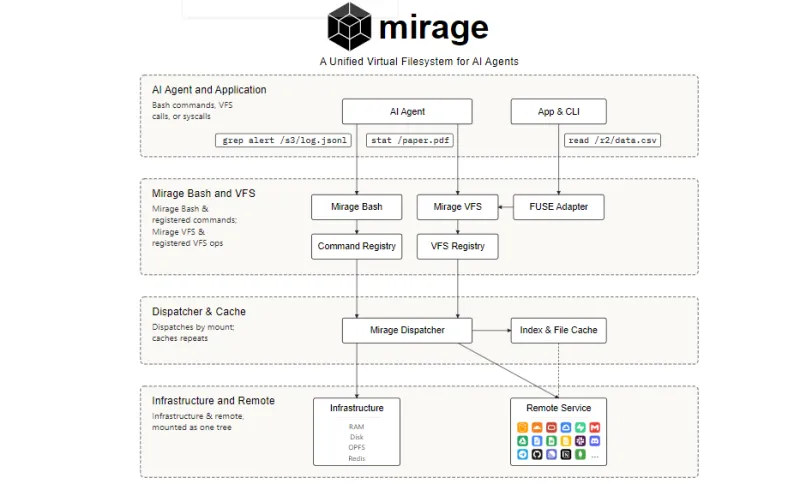

2. 核心架构设计

整体采用三层架构设计,层级解耦、职责清晰:

接入层:提供 CLI 命令行、Python/TS SDK、HTTP 接口三种接入方式,适配开发、运维、智能体调用各类场景;

核心调度层:虚拟文件系统核心引擎,负责目录树管理、命令解析、资源路由、权限校验、任务调度;

资源适配层:各类第三方服务适配器,标准化统一接口,屏蔽不同平台的 API 差异,向上输出统一文件系统操作能力。

3. 核心运行原理

开发者配置各类第三方资源的认证信息、连接地址,注册到 Mirage 工作空间;

核心引擎将各类资源映射为虚拟目录节点,构建统一树形文件系统;

接收 AI 智能体或开发者下发的 Shell 命令,引擎解析命令语义、路由至对应资源适配器;

适配器调用原生第三方接口完成操作,结果以文件流形式返回,支持管道、过滤等二次处理;

双层缓存自动记录元数据与内容,后续重复操作直接命中缓存,提升响应效率。

4. 部署与运行特性

轻量化无依赖:无需部署复杂中间件,单机可直接运行,分布式仅需额外配置 Redis;

异步非阻塞:底层基于异步 IO 开发,高并发场景下可同时处理多智能体、多任务请求;

配置即代码:所有挂载规则、缓存策略、权限控制均可通过代码配置,支持版本化管理。

四、应用场景

AI 智能体开发与编排

大模型智能体需要联动云盘、代码仓库、IM 聊天记录、数据库数据进行任务处理时,借助 Mirage 统一调用能力,无需对接多套 API,直接用 Shell 指令完成数据检索与处理。企业多源数据统一管理

企业内部存在云存储、私有对象存储、办公协作平台、业务数据库等多类数据源,可通过 Mirage 统一抽象为文件目录,实现运维、业务系统的统一数据访问入口。自动化运维与流水线

运维场景中整合 SSH 服务器、对象存储、Redis、日志服务,通过类 Linux 命令编写自动化脚本,完成日志检索、文件同步、批量运维操作。低代码行业应用开发

行业 SaaS、内部管理系统需要对接多第三方服务时,基于 Mirage 快速封装资源层,降低前后端接口适配工作量,缩短项目开发周期。个人 AI 助手定制

个人私有化 AI 助手可挂载本地文件、云盘、备忘录、代码仓库,让私人智能体一键管理个人所有数字资源。

五、使用方法

1. 环境安装

Python 环境安装

uv add mirage-ai

TypeScript 环境安装

npm install @mirage-ai/core

CLI 命令行安装

支持 curl 一键脚本快速安装,也可通过 uvx、npm 全局安装,安装后可直接在终端执行虚拟文件系统相关命令。

2. 基础初始化示例

Python 快速使用示例:

from mirage import Workspace

from mirage.resources import S3Resource, SlackResource

# 初始化工作空间,挂载多类资源

ws = Workspace({

"/s3-bucket": S3Resource(bucket="my-project-data"),

"/slack-team": SlackResource()

})

# 执行跨资源Shell命令,筛选告警信息并统计数量

await ws.execute("grep alert /slack-team/general/*.json | wc -l")3. 自定义资源挂载

开发者可继承官方基础适配器,实现私有业务系统适配,自定义挂载至指定虚拟目录,扩展专属业务资源管理能力。

4. 工作空间版本管理

通过快照命令将当前挂载配置、目录结构保存为版本,支持后续一键恢复、复制到新环境,实现配置复用。

六、竞品对比

选取 Filebase、LakeFS、AgentFS 三款同赛道开源工具,与 Mirage 进行核心维度对比:

| 对比维度 | Mirage | Filebase | LakeFS | AgentFS |

|---|---|---|---|---|

| 核心定位 | AI智能体统一虚拟文件系统 | 去中心化对象存储服务 | 数据湖版本化文件系统 | AI智能体专用文件抽象层 |

| 支持挂载资源 | 存储、IM、云盘、代码库、数据库、Redis | 仅去中心化IPFS/Filecoin存储 | 仅数据湖、对象存储类资源 | 偏向本地与云存储,第三方服务适配少 |

| Unix命令支持 | 完整支持Shell管道、重定向、子Shell | 仅基础文件操作,无完整命令生态 | 基础文件命令,不支持跨服务管道 | 基础命令兼容,生态完整性弱 |

| 缓存架构 | 双层索引+内容缓存,支持Redis分布式 | 仅基础存储缓存 | 数据湖分层缓存,无元数据专项缓存 | 简易单层缓存,无分布式能力 |

| AI框架适配 | 全兼容主流大模型智能体框架 | 无原生AI框架适配 | 面向大数据,无AI智能体优化 | 轻度适配AI框架,扩展能力弱 |

| 适用场景 | AI智能体、多源异构资源统一管理 | 去中心化存储托管 | 大数据数据湖版本管理 | 轻量化AI本地资源管理 |

对比总结:Mirage 最大优势是全品类资源挂载+完整 Unix 命令生态+原生 AI 智能体适配,相比竞品不再局限于单一存储场景,是真正面向多源异构资源、为 AI 智能体量身打造的虚拟文件系统;而其他竞品多聚焦存储单一领域,跨服务编排、大模型适配能力存在明显短板。

七、常见问题解答

Q1:Mirage 适合零基础开发者使用吗?

A1:非常适合。项目核心操作基于大众熟悉的 Linux 基础命令,无需深入学习各类第三方服务 API,只要掌握简单的 ls、cat、grep 等命令,即可快速上手配置与使用;同时官方提供完善 SDK 封装,Python、TS 开发者可低代码快速集成到项目中。

Q2:是否支持私有化部署和企业内部私有系统适配?

A2:支持。Mirage 可完全单机私有化部署,无需依赖官方云端服务;同时提供自定义适配器扩展接口,企业可以基于标准接口适配内部私有业务系统、自研接口服务,实现内部资源统一挂载管理。

Q3:使用过程中是否有商用限制?

A3:项目采用 Apache-2.0 开源协议,个人开源项目、企业商用项目均可免费使用、二次修改与部署,无需支付授权费用,仅需遵守协议基础开源规范即可。

Q4:低版本 Python 和 Node.js 可以运行项目吗?

A4:不可以。项目有严格版本约束,Python 要求 3.12 及以上版本,TypeScript/Node.js 需匹配官方适配版本,低版本会存在语法兼容、依赖缺失等问题,建议严格按照文档版本要求配置环境。

Q5:能否在 LangChain、OpenAI 智能体框架中直接集成?

A5:可以原生无缝集成。Mirage 官方已适配主流 AI 智能体框架,只需引入对应 SDK,即可将虚拟文件系统能力注入大模型智能体,让智能体自主调用 Shell 命令管理多源数据。

Q6:缓存数据是否支持手动清理和策略自定义?

A6:支持。开发者可自定义缓存过期时间、缓存容量上限,同时提供手动清空索引缓存、内容缓存的命令接口,也可配置 Redis 实现多实例共享缓存数据。

八、相关链接

项目 GitHub 开源地址:https://github.com/strukto-ai/mirage

九、总结

Mirage 作为面向 AI 智能体的开源统一虚拟文件系统,以类 Unix 文件系统为核心抽象能力,整合了存储、办公、开发、缓存等全品类异构资源,凭借完整的 Shell 命令生态、双层缓存加速架构、双语言 SDK 支持与全主流 AI 框架适配特性,解决了 AI 智能体对接多服务时接口碎片化、适配成本高、数据流转复杂的行业痛点。项目轻量化部署、扩展门槛低、无商用限制,既适合个人开发者定制私有化 AI 助手,也能满足企业多源数据统一管理、智能体编排、自动化运维等多元业务需求,是 AI 智能体底层基础设施领域极具实用价值的开源项目。

版权及免责申明:本文由@AI工具箱原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/mirage.html