Mobile-Agent-v3.5:阿里通义开源的多模态多平台GUI自动化智能体框架

一、Mobile-Agent-v3.5是什么

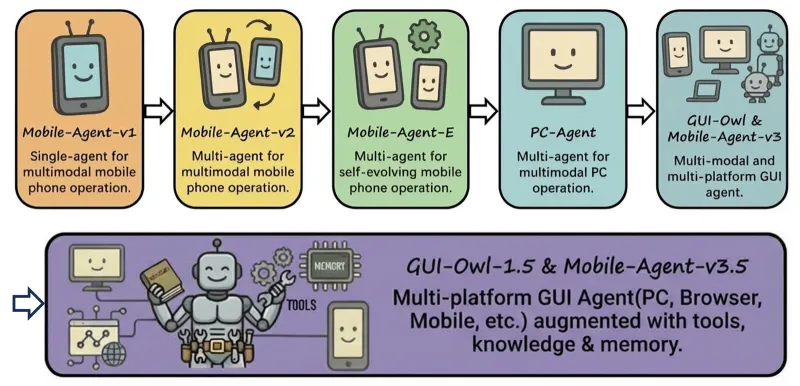

Mobile-Agent-v3.5是由阿里巴巴通义实验室X-PLUG团队研发并开源的多平台基础GUI智能体框架,属于MobileAgent家族的最新稳定版本,核心目标是打造一套可直接工程化使用的跨设备图形界面操作智能体。它以GUI-Owl-1.5多模态视觉语言模型为底层基座,将界面感知、元素定位、任务规划、动作执行、异常反思、信息记忆等能力整合在统一架构中,实现对手机、PC、浏览器三大场景的原生自动化操作,无需针对不同平台单独开发适配逻辑。

作为面向真实场景的GUI智能体,Mobile-Agent-v3.5不只是演示级Demo,而是具备稳定执行、长程任务处理、异常容错、多智能体协作的工业级框架。它既能作为独立端到端智能体直接运行,也能作为组件嵌入更大的多智能体系统中协同工作,为自动化测试、RPA、智能助手、设备控制等场景提供统一底层能力。

该项目完整开源了框架代码、模型权重、部署脚本、评测基准与在线演示环境,支持本地部署、云端调用与端云协同,是当前开源社区中覆盖平台最广、能力最完整、工程化程度最高的GUI智能体方案之一。

二、功能特色

1. 多平台原生统一控制

Mobile-Agent-v3.5实现真正意义上的一套框架、多端运行,无需为不同设备开发独立策略。

支持平台:Android、HarmonyOS、Windows、Web浏览器、iOS

统一动作空间:点击、滑动、输入、长按、返回、截图、工具调用等

跨界面泛化:无需依赖XML/控件树,纯视觉即可完成操作

2. 全尺寸模型家族,覆盖端到云全场景

依托GUI-Owl-1.5模型家族,提供从边缘到云端的完整选型:

| 模型参数 | 模型类型 | 适用场景 |

|---|---|---|

| 2B/4B/8B | Instruct | 端侧轻量化、低延迟、实时交互 |

| 32B/235B | Thinking | 云端复杂规划、长程任务、深度反思 |

Instruct版:轻量快速,不输出思考链,适合边缘设备与隐私场景

Thinking版:内置记忆与思维链,可独立完成复杂长流程,无需外部编排

3. 多智能体协作架构

框架内置四大专业化智能体,分工协作提升任务成功率:

Manager(管理者):任务拆解、规划、进度管理

Worker(执行者):界面感知、定位、基础操作执行

Reflector(反思者):错误诊断、失败重试、策略修正

Notetaker(记录者):关键信息提取、跨页面记忆、上下文保持

4. 强反思与异常处理能力

自动识别弹窗、广告、加载页、权限请求等干扰项

操作失败后自动分析原因并重新规划

支持循环检测,避免重复操作与死循环

长程任务可主动记录中间状态,支持断点续跑

5. 工具调用与MCP兼容

原生支持系统工具、第三方接口、文件操作、网络请求

兼容MCP(Model Control Protocol)生态

可调用计算器、浏览器、文档编辑器、地图等外部能力

支持多工具组合完成复杂任务

6. 端云协同架构

端侧小模型负责高频轻量操作

云端大模型负责复杂规划与反思

动态调度,兼顾速度与能力

保护本地数据隐私,敏感信息不上云

7. 学术SOTA性能

在20+主流GUI自动化基准测试中取得领先结果:

AndroidWorld

OSWorld

WindowsAgentArena

ScreenSpot-v2

MMBench-GUI

Android Control

三、技术细节

1. 核心模型:GUI-Owl-1.5

GUI-Owl-1.5是Mobile-Agent-v3.5的底层视觉语言模型,基于Qwen3-VL架构优化,专为GUI场景设计:

统一感知-定位-推理-规划-执行端到端网络

支持多尺度UI元素识别,适配不同分辨率

混合指令数据与强化学习数据训练

支持屏幕状态预测,具备“世界模型”能力

2. 多智能体闭环架构

Mobile-Agent-v3.5采用循环执行架构,每轮包含:

状态获取:截图、界面信息、设备状态

感知理解:识别元素、文字、布局、可操作区域

规划决策:判断下一步动作或是否需要反思

动作执行:输出标准化操作指令

结果校验:对比预期与实际变化

记忆更新:保存关键信息与执行历史

3. MRPO多平台强化学习优化

为解决多平台训练冲突与不稳定问题,项目提出MRPO(Multi-platform Reinforcement Policy Optimization):

统一设备条件策略πθ(a|o,d),一套模型覆盖多端

在线Rollout Buffer:过采样再子采样,提升有效样本比例

Swap机制:缓解整组样本全成功/全失败导致的训练崩溃

Token-ID对齐:消除训练与推理分词差异,提升动作准确率

4. 统一动作抽象

将不同平台的操作统一抽象为原子动作:

点击(tap)

长按(long press)

滑动(swipe)

输入(input)

回车(enter)

返回(back)

截图(screenshot)

等待(wait)

工具调用(tool call)

这种设计让模型无需关注平台差异,只需学习动作语义。

5. 思维链与记忆机制

Thinking版模型内置:

操作前推理:判断目标、位置、可行性

操作后反思:是否成功、为何失败、如何修正

关键信息记忆:号码、地址、价格、账号等

任务进度跟踪:已完成/待完成/受阻项

6. 部署与推理优化

支持HuggingFace、ModelScope、vLLM

支持Megatron-Core分布式训练

模型权重互转工具

低内存优化,8GB显存可运行基础版本

四、应用场景

1. 移动应用自动化测试

自动遍历APP页面、点击控件、输入测试数据

适配不同分辨率、不同系统版本

自动生成测试报告与异常截图

替代人工完成回归测试、压力测试

2. PC端办公自动化

自动打开软件、编辑文档、制作PPT

数据查询、表格处理、邮件收发

浏览器自动化:搜索、爬取、表单填写

替代传统RPA,更低代码、更强泛化

3. 智能助手与设备控制

语音/文本指令控制手机:发消息、设闹钟、查天气

远程控制设备,无人值守操作

适老化辅助,简化复杂操作

多设备联动自动化

4. 流程自动化与批处理

电商批量下单、价格监控、数据统计

自媒体批量发文、素材处理

教育场景:自动批改、打卡、作业提交

金融场景:行情查询、数据导出、报表生成

5. 研究与二次开发

GUI Agent算法研究、强化学习实验

多模态界面理解、UI目标检测

自定义行业智能体开发

教学与实验平台

五、使用方法

1. 环境准备

Python 3.8+

PyTorch 2.0+

CUDA 11.7+(可选,GPU加速)

ADB工具(移动端控制)

内存≥8GB

2. 下载代码

git clone https://github.com/X-PLUG/MobileAgent.git cd MobileAgent/Mobile-Agent-v3.5

3. 安装依赖

pip install -r requirements.txt pip install qwen_agent qwen_vl_utils numpy

4. 模型下载

从HuggingFace或ModelScope下载GUI-Owl-1.5权重:

GUI-Owl-1.5-2B-Instruct

GUI-Owl-1.5-8B-Instruct

GUI-Owl-1.5-32B-Thinking

5. 移动端部署(Android/HarmonyOS)

开启开发者选项与USB调试

电脑安装ADB

手机连接电脑,开启文件传输模式

运行连接测试:

adb devices

启动智能体:

python run.py --device android --instruction "你的指令"

6. PC端部署

python run.py --device pc --instruction "打开Chrome搜索Mobile-Agent-v3.5"

7. 浏览器部署

python run.py --device web --instruction "打开百度并搜索AI智能体"

8. 在线体验

直接访问官方Cloud Sandbox Demo,无需本地部署。

六、常见问题解答

Mobile-Agent-v3.5支持iOS设备吗?

目前对iOS提供基础支持,完整控制能力优先支持Android与HarmonyOS,PC与浏览器全平台支持。

运行Mobile-Agent-v3.5最低需要什么配置?

最低配置为8GB内存、集成显卡,可运行2B-4B Instruct模型;推荐16GB内存+独立显卡,可流畅运行8B-32B模型。

是否需要Root或越狱手机?

不需要,仅需开启USB调试,无需修改系统权限。

模型支持离线运行吗?

支持,下载模型权重后可完全本地离线运行,不依赖云端API。

Mobile-Agent-v3.5和v3版本有什么区别?

v3.5在PC操作能力提升约50%,新增工具调用、MCP兼容、网页操作、Windows原生支持,Thinking模型内置记忆,采用MRPO训练算法,多平台稳定性大幅提升。

是否支持自定义工具与插件?

支持,可通过配置文件添加自定义工具,支持函数调用、API接入、脚本执行。

处理复杂任务时卡住怎么办?

框架自带反思与超时机制,会自动重试或跳过;也可在指令中加入约束,如“如果遇到广告直接关闭”。

如何提高操作成功率?

优先使用Thinking版大模型;指令尽量清晰具体;避免过于模糊的描述;保持界面光线充足、无遮挡。

是否支持多轮对话式交互?

支持,可连续下达多步指令,智能体保留上下文记忆,完成连贯任务。

七、相关链接

Mobile-Agent-v3.5目录:https://github.com/X-PLUG/MobileAgent/tree/main/Mobile-Agent-v3.5

八、总结

Mobile-Agent-v3.5是阿里通义实验室X-PLUG团队推出的开源多平台GUI智能体框架,以GUI-Owl-1.5为核心模型,通过统一动作空间、多智能体协作、MRPO强化学习优化与端云协同架构,实现对手机、PC、浏览器的原生自动化操作,具备规划、反思、记忆、工具调用与异常处理能力,在20+权威基准测试中达到SOTA水平,提供从2B到235B的全尺寸模型与完整部署方案,可广泛应用于自动化测试、智能办公、设备控制、流程自动化与学术研究,是当前开源社区中工程化成熟度高、跨平台能力强、易用性好的GUI智能体解决方案。

版权及免责申明:本文由@AI铺子原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/mobile-agent-v3-5.html