OpenScholar:AllenAI推出的开源科学文献检索与问答RAG系统

一、OpenScholar是什么

在学术研究领域,随着全球科研产出的指数级增长,科研人员面临“信息过载但知识获取效率低”的核心问题——想要找到某一研究方向的关键文献、验证一个学术假设,往往需要耗费数小时甚至数天检索、阅读、整理文献,且难以快速整合多篇文献的核心观点。

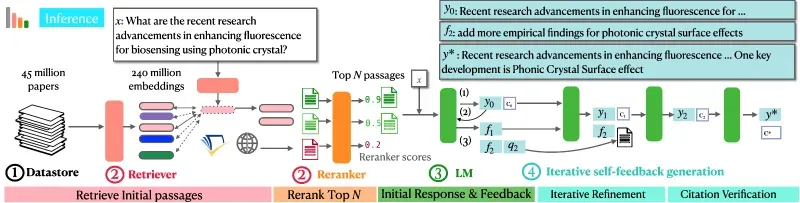

OpenScholar正是为解决这一痛点而生的开源框架,由AllenAI(艾伦人工智能研究所)研发并开源,是一款面向科学文献检索与智能问答的检索增强语言模型(RAG)系统。与传统的文献检索工具(如Google Scholar、Web of Science)不同,OpenScholar并非仅返回文献列表,而是通过“检索+大模型推理”的组合模式,直接基于检索到的相关文献生成精准、结构化的回答,实现从“找文献”到“找答案”的跨越。

简单来说,OpenScholar的核心逻辑是:接收科研人员的学术问题(如“LLM在药物发现中的应用进展如何?”),先通过检索模块从海量文献库中抓取最相关的文献片段,再将这些片段作为上下文输入到大语言模型中,最终生成基于真实文献、可追溯的回答,既保证了回答的准确性,又避免了大模型“幻觉”问题。

二、OpenScholar的功能特色

OpenScholar的核心优势体现在“检索能力全面、推理灵活可控、训练轻量化、部署门槛低”四大维度,具体功能特色如下:

1. 多源异构检索能力,覆盖全场景文献获取需求

OpenScholar打破了单一检索渠道的限制,整合了三种核心检索方式,满足不同场景下的文献获取需求:

离线预生成检索结果:针对高频研究方向,OpenScholar提供预生成的检索结果数据集(可通过Google Drive获取),无需实时调用API,降低检索成本与延迟;

Semantic Scholar Paper API检索:对接全球最大的学术文献数据库之一Semantic Scholar,可精准获取论文的标题、摘要、全文链接、引用关系等核心信息,是OpenScholar的核心检索渠道;

You.com网页搜索API检索:补充非论文类的网页学术资源(如研究博客、机构报告、技术文档),覆盖更广泛的学术信息来源。

2. 多套推理流水线,适配不同精度/效率需求

OpenScholar设计了三套差异化的推理流水线,用户可根据自身需求选择,平衡回答精度与推理速度:

| 推理流水线类型 | 核心逻辑 | 适用场景 | 精度 | 速度 |

|---|---|---|---|---|

| 标准RAG流水线 | 直接将Top-N检索结果输入大模型生成回答 | 快速获取基础答案、低算力环境 | 中 | 快 |

| Retriever+Reranker流水线 | 先检索获取候选文献,再通过重排序模型筛选高相关度文献,最后输入大模型 | 对回答精度要求高的场景 | 高 | 中 |

| 开放式检索自反思生成流水线 | 模型先生成检索关键词,再基于关键词检索,最后结合结果生成回答(支持多轮) | 复杂学术问题、开放式研究问题 | 高 | 慢 |

3. 丰富的模型支持与轻量化训练方案

OpenScholar的训练模块基于修改版torchtune构建,兼顾“模型多样性”与“训练轻量化”:

支持的基础模型:覆盖当前主流开源大模型,包括Llama 3/3.1(8B/70B)、Mistral 7B、Gemma 2B/7B、Microsoft Phi3 Mini、Qwen2(0.5B/1.5B/7B)等;

多样化微调方式:支持全量微调、LoRA/QLoRA(低显存微调)、DPO(直接偏好优化)、RLHF(基于人类反馈的强化学习),其中LoRA/QLoRA方案可在单张RTX 4090显卡上完成8B模型的微调,大幅降低训练门槛;

训练优化策略:集成FSDP分布式训练、激活检查点、梯度累积、混合精度训练、bitsandbytes低显存优化器等,提升训练效率,适配从单卡到多卡A100的硬件环境。

4. 模块化设计,易扩展易定制

OpenScholar的代码架构采用“解耦式设计”,检索、推理、训练三大核心模块相互独立,用户可根据需求灵活调整:

仅用检索模块:单独部署Contriever检索服务器,为自有系统提供文献稠密检索能力;

仅用推理模块:对接自有检索结果,基于OpenScholar的推理逻辑实现问答;

全流程使用:直接基于OpenScholar的端到端方案,快速搭建文献问答系统。

5. 本地化部署,数据安全可控

OpenScholar支持所有核心功能的本地化部署,无需将学术问题或敏感文献数据上传至第三方平台,既符合科研数据安全规范,又避免了API调用的网络延迟问题。

三、OpenScholar的技术细节

要理解OpenScholar的运行逻辑,需从“核心架构”“关键模块技术栈”“核心算法”三个维度拆解:

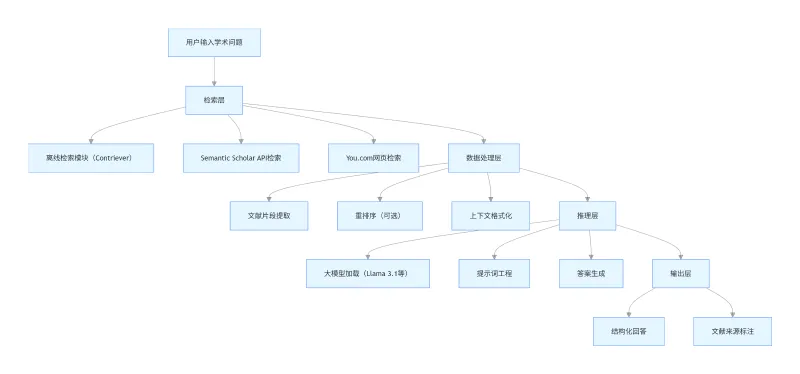

1. 核心架构

OpenScholar的整体架构遵循RAG的经典“检索-增强-生成”逻辑,具体分为四层:

检索层:核心是Contriever稠密检索模型(无监督对比学习训练),支持多语言版本mContriever,可将文献与问题转化为向量,通过向量相似度匹配实现精准检索;

数据处理层:对检索到的文献进行清洗、片段提取、重排序,筛选出最相关的Top-N文献片段;

推理层:基于Llama 3.1等大模型,结合格式化的上下文生成回答,支持零样本(zero-shot)、少样本(few-shot)推理;

输出层:返回结构化的回答,并标注回答对应的文献来源(标题、作者、链接),保证回答的可追溯性。

2. 关键模块技术栈

为了让用户清晰了解OpenScholar的技术依赖,以下梳理核心模块的关键技术栈:

| 模块名称 | 核心技术/工具 | 版本/适配说明 |

|---|---|---|

| 基础开发语言 | Python | 3.10.0(推荐) |

| 深度学习框架 | PyTorch | 支持2.0+版本 |

| 检索模型 | Contriever/mContriever | 基于Hugging Face Transformers加载 |

| 大模型推理 | Hugging Face Transformers、Accelerate | 支持量化推理(bitsandbytes) |

| 训练框架 | torchtune(修改版) | 适配PyTorch生态 |

| 数据处理 | spaCy、NLTK | en_core_web_sm(spaCy模型) |

| 分布式训练 | FSDP(Fully Sharded Data Parallel) | 适配多卡GPU环境 |

3. 核心算法解析

(1)Contriever检索算法

Contriever是OpenScholar检索模块的核心,属于稠密检索模型,其核心原理是:

无监督对比学习训练:将同一文献的不同片段(如标题-摘要、摘要-正文)作为“正样本对”,不同文献的片段作为“负样本对”,训练模型将语义相似的文本映射到相近的向量空间;

向量检索:用户输入问题后,模型将问题转化为向量,与文献库中的文献向量计算余弦相似度,返回相似度最高的文献,相比传统的关键词检索,能更好地理解语义,避免“关键词匹配但语义不符”的问题。

(2)LoRA/QLoRA微调算法

针对科研人员算力有限的问题,OpenScholar采用LoRA(Low-Rank Adaptation)/QLoRA(Quantized LoRA)进行大模型微调:

LoRA:冻结大模型的主权重,仅训练低秩矩阵,大幅减少训练参数(如8B模型仅训练百万级参数),降低显存占用;

QLoRA:在LoRA基础上对模型权重进行4-bit/8-bit量化,进一步降低显存需求,单张RTX 4090(24G显存)即可训练Llama 3.1 8B模型。

(3)重排序算法(Reranker)

在Retriever+Reranker流水线中,OpenScholar采用轻量级重排序模型,对检索到的候选文献再次筛选:

核心逻辑:将“问题+文献片段”作为输入,模型输出该文献与问题的相关度得分,按得分排序后选取Top-K(K<N)文献,提升上下文的精准度;

优势:相比单纯的向量相似度检索,重排序模型能更好地捕捉问题与文献的细粒度语义关联,减少无关文献的干扰。

四、OpenScholar的应用场景

OpenScholar的设计初衷是服务科研场景,其灵活的功能适配多种学术相关需求,核心应用场景如下:

1. 科研选题与文献调研

科研人员在确定研究方向时,可通过OpenScholar快速获取某一领域的核心进展,例如输入“2023-2024年大语言模型在计算生物学中的应用”,OpenScholar会检索近两年的相关文献,生成结构化的进展总结,包括核心研究团队、关键方法、实验结果、待解决问题等,大幅缩短文献调研周期(从数天缩短至数小时)。

2. 学术问答与假设验证

针对具体的学术问题(如“Transformer的注意力机制在长文本处理中的瓶颈是什么?有哪些改进方案?”),OpenScholar可基于相关文献给出精准回答,并标注文献来源,帮助科研人员快速验证自己的研究假设,或解答研究中遇到的技术问题。

3. 论文写作辅助

在撰写论文的“相关工作”章节时,科研人员可输入“XX领域的最新研究进展(2024)”,OpenScholar会整合多篇最新文献的核心观点,梳理研究脉络,避免遗漏关键文献,同时提供文献引用格式参考,提升论文写作效率。

4. 开源大模型微调与定制

AI开发者可基于OpenScholar的训练模块,针对特定学科(如医学、物理学)的文献数据微调Llama 3.1等模型,打造专属的学科文献问答模型,适配垂直领域的学术需求。

5. 学术平台集成

高校、科研机构可将OpenScholar的检索与推理模块集成到自有学术平台(如图书馆文献系统、校内科研平台),为师生提供一站式的文献检索与问答服务,提升平台的智能化水平。

五、OpenScholar的使用方法

OpenScholar的使用分为“环境搭建”“密钥配置”“快速运行”“自定义调整”四个步骤,以下是详细的实操指南:

1. 环境搭建

OpenScholar推荐使用Conda创建独立环境,避免依赖冲突,具体步骤如下:

# 1. 创建Conda环境(Python 3.10.0为推荐版本) conda create -n openscholar_env python=3.10.0 -y # 2. 激活环境 conda activate openscholar_env # 3. 克隆OpenScholar仓库 git clone https://github.com/allenai/OpenScholar.git cd OpenScholar # 4. 安装核心依赖 pip install -r requirements.txt # 5. 安装spaCy英文模型(用于文本处理) python -m spacy download en_core_web_sm # 6. 可选:安装量化推理依赖(降低显存占用) pip install bitsandbytes accelerate

2. 密钥配置

OpenScholar的部分检索功能需要配置第三方API密钥,核心密钥如下:

(1)Semantic Scholar API密钥(必选)

Semantic Scholar是OpenScholar的核心文献数据源,需申请API密钥:

申请地址:https://semanticscholar.org/product/api

配置方式:在终端执行以下命令(临时生效),或写入/.bashrc//.zshrc(永久生效):

export S2_API_KEY="你的Semantic Scholar API密钥"

(2)You.com API密钥(可选)

若需要使用网页检索功能,需配置You.com API密钥:

申请地址:https://you.com/api

配置方式:

export YOUR_API_KEY="你的You.com API密钥"

3. 快速运行(标准RAG流水线)

以Llama-3.1_OpenScholar-8B模型为例,运行标准RAG流水线,实现文献问答:

# 核心命令 python run.py \ --input_file ./examples/query.txt \ # 输入文件(每行一个学术问题) --model_name OpenScholar/Llama-3.1_OpenScholar-8B \ # 模型名称(Hugging Face) --use_contexts \ # 启用检索上下文(核心RAG功能) --output_file ./output/answers.json \ # 输出文件(JSON格式) --top_n 10 \ # 检索返回的Top-N相关文献 --llama3 \ # 指定模型类型为Llama 3/3.1 --zero_shot \ # 零样本推理 --quantization 4bit # 4-bit量化推理(降低显存需求)

输入文件示例(query.txt):

What are the applications of LLMs in drug discovery? What are the limitations of Contriever in multilingual literature retrieval?

输出文件说明:

输出文件为JSON格式,包含每个问题的回答、检索到的文献列表(标题、作者、链接、相似度得分)、生成时间等信息,示例如下:

[

{

"query": "What are the applications of LLMs in drug discovery?",

"answer": "LLMs have been widely applied in drug discovery, including target identification, molecular design, virtual screening...",

"contexts": [

{

"title": "Large Language Models for Drug Discovery: A Review",

"authors": ["Zhang, L", "Li, Y"],

"url": "https://semanticscholar.org/paper/xxx",

"similarity_score": 0.92

},

...

],

"generate_time": "2026-03-23 10:00:00"

}

]4. 自定义调整

(1)更换推理流水线

若需使用Retriever+Reranker流水线,只需在命令中添加--use_reranker参数:

python run.py \ --input_file ./examples/query.txt \ --model_name OpenScholar/Llama-3.1_OpenScholar-8B \ --use_contexts \ --use_reranker \ # 启用重排序 --reranker_top_k 5 \ # 重排序后保留Top-5文献 --output_file ./output/answers_reranker.json \ --top_n 20 \ # 先检索Top-20,再重排序选Top-5 --llama3 --zero_shot

(2)本地化微调模型

以QLoRA微调Llama 3.1 8B为例,进入training目录执行训练命令:

cd training # 微调命令(单卡RTX 4090) python tune run --config llama3_8b_qlora_finetune.yaml \ --dataset_path ./data/scholar_data.json \ # 自定义文献问答数据集 --output_dir ./finetuned_models \ --batch_size_per_device 4 \ --gradient_accumulation_steps 4 \ --max_steps 1000 \ --save_steps 200

六、OpenScholar常见问题解答

Q1:运行OpenScholar时提示“S2_API_KEY not found”怎么办?

A1:该错误表示未配置Semantic Scholar API密钥,解决方法:

前往https://semanticscholar.org/product/api申请API密钥(个人免费版足够测试使用);

在终端执行

export S2_API_KEY="你的密钥",或永久配置到环境变量文件(如~/.bashrc);重新运行命令,确认密钥已生效(可执行

echo $S2_API_KEY验证)。

Q2:本地运行Llama 3.1 8B模型提示显存不足怎么办?

A2:可通过以下方式降低显存占用:

使用量化推理:在命令中添加

--quantization 4bit或--quantization 8bit参数,4-bit量化可将8B模型的显存占用降至8G左右;降低batch size:若自定义推理,调整代码中的

batch_size参数为1;启用梯度检查点:在模型加载时添加

gradient_checkpointing=True参数。

Q3:检索结果的相关性较低,如何优化?

A3:可从以下维度优化检索精度:

使用Retriever+Reranker流水线(添加

--use_reranker参数),通过重排序筛选高相关文献;调整

--top_n参数,适当增大检索数量(如从10增至20),再通过重排序缩小范围;更换检索模型:将Contriever替换为mContriever(多语言版),或自行训练领域专属的检索模型;

优化问题表述:尽量使用学术化、精准的问题描述,避免模糊化表述。

Q4:OpenScholar支持中文文献检索与问答吗?

A4:OpenScholar的核心检索模型Contriever默认适配英文,但若使用mContriever(多语言版),可支持中文等多语言文献检索;此外,需使用支持中文的大模型(如Qwen2 7B)替换默认的Llama 3.1,并准备中文文献问答数据集进行微调,即可实现中文文献问答。

Q5:训练模块提示“torchtune not found”怎么办?

A5:torchtune是OpenScholar修改后的训练框架,解决方法:

确认已进入training目录,且仓库克隆完整(未遗漏torchtune子模块);

若克隆时未拉取子模块,执行

git submodule update --init --recursive;重新安装training目录下的依赖:

pip install -r training/requirements.txt。

Q6:OpenScholar的离线检索结果如何获取?

A6:离线检索结果由AllenAI预生成,可通过以下方式获取:

访问Google Drive链接(具体链接见仓库README);

下载后解压到

retriever/offline_data目录;运行命令时添加

--use_offline_contexts参数,即可使用离线检索结果,无需调用API。

七、OpenScholar相关链接

在线Demo地址:https://open-scholar.allen.ai/

模型权重仓库:https://huggingface.co/collections/OpenScholar/openscholar-v1-67376a89f6a80f448da411a6

评估工具:

ScholarQABench(自动评估):https://github.com/AkariAsai/ScholarQABench/

OpenScholar_ExpertEval(人工评估):https://github.com/AkariAsai/OpenScholar_ExpertEval

Semantic Scholar API申请:https://semanticscholar.org/product/api

You.com API申请:https://you.com/api

八、总结

OpenScholar是AllenAI推出的一款面向科研场景的开源检索增强语言模型框架,以解决科研人员文献获取效率低的核心痛点为目标,整合了离线稠密检索、Semantic Scholar API、网页检索等多源检索能力,设计了标准RAG、Retriever+Reranker、开放式自反思三种推理流水线,支持Llama 3.1等主流开源大模型的轻量化微调与本地化部署。该框架采用模块化设计,检索、推理、训练模块解耦,既适配科研人员快速获取文献答案的基础需求,也支持AI开发者定制垂直领域的文献问答模型,同时本地化部署的特性保障了科研数据的安全性。从环境搭建到自定义微调,OpenScholar提供了完整的实操路径,配套的在线Demo、评估工具与详细文档进一步降低了使用门槛,是科研人员提升文献处理效率、AI开发者构建学术问答系统的优质开源工具。

版权及免责申明:本文由@AI铺子原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/openscholar.html