PrismAudio:阿里通义推出的AI视频自动配音与环境音生成工具

一、PrismAudio是什么

PrismAudio是由阿里巴巴通义实验室自主研发、被国际顶级AI会议ICLR 2026正式收录的开源视频转音频(Video-to-Audio,V2A)生成框架,专注于为无声视频自动生成与画面高度匹配的环境音效、动作音效、场景音效,不包含人声配音,核心解决“声画两张皮”的行业痛点,实现声画同频、音效随行的生成效果。

作为全球首个将分解式思维链(CoT) 与多维奖励强化学习深度融合的V2A框架,PrismAudio打破传统端到端直接生成音频的模式,采用“先推理、后发声”的生成范式,把声音生成拆解为语义理解、时序对齐、美学把控、空间定位四个可解释、可优化的环节,让AI像专业拟音师一样,先分析画面内容、节奏、质感、方位,再精准生成对应音效,彻底解决传统模型单一损失函数导致的目标冲突、人感对齐不足、训练效率低等核心问题。

该模型参数量仅518M,属于轻量化高效能模型,远低于同领域5B+量级的大模型,生成9秒音频仅需0.63秒,兼顾性能、速度与部署成本,在域内标准测试集VGGSound和团队自研的高难度均衡基准AudioCanvas上,语义一致性、时序同步性、美学质量、空间准确度四大核心指标均全面超越现有基线模型,主观MOS评分领先显著,是当前视频转音频生成领域的SOTA方案。

二、功能特色

(一)四维感知协同生成,声画匹配度拉满

PrismAudio围绕视频转音频的四大核心感知维度设计功能,实现全方位精准匹配:

语义一致性:精准识别画面中的物体、动作、场景,生成对应音效,如马匹奔跑生成马蹄声、下雨生成雨声,杜绝“画声不符”;

时序同步性:严格对齐动作与声音的起止时间、节奏变化,如慢步→快跑→停止的声音节奏完全匹配画面动作,无延迟、无超前;

美学高质量:保证音效清晰、自然、无杂音、混响适中、响度均衡,具备专业音频质感,拒绝粗糙失真;

空间高精准:支持立体声生成,精准还原声源位置与移动轨迹,如声音从左到右、由近及远,营造沉浸式空间感。

(二)分解式思维链,可解释、可调控

区别于传统黑箱生成,PrismAudio采用四维分解式思维链,把整体推理拆分为语义CoT、时序CoT、美学CoT、空间CoT四个独立模块,每个模块负责单一维度的推理与规划,模块间协同工作,既保证推理逻辑清晰可解释,又支持开发者单独调控某一维度参数,实现个性化音效生成,大幅提升模型的可控性与实用性。

(三)轻量化高性能,速度与效果双优

模型仅518M参数,远低于HunyuanVideo-Foley(5.31B)、AudioX(1.1B)等同类模型,硬件门槛更低;推理速度达0.63秒/9秒音频,实时性强,可满足批量视频快速配音需求;同时在四大指标上全面超越大参数量模型,实现“小模型、大性能”的突破。

(四)多维奖励强化学习,对齐人类偏好

首创四维专属奖励函数,对应四个思维链模块,从语义、时序、美学、空间四个维度对生成音频打分,通过强化学习持续优化模型,让生成效果更贴合人类听觉偏好;搭配自研Fast-GRPO算法,采用混合ODE-SDE采样,大幅降低训练开销,让多目标优化高效可行。

(五)自研AudioCanvas基准,覆盖复杂场景

团队构建AudioCanvas专业测评基准,包含300个单事件类、501个多事件样本,分布均衡、场景多样且极具挑战性,覆盖日常动作、机械操作、自然场景、动物声音、交通工具等复杂多事件场景,解决现有数据集分布不均、场景单一的问题,让模型在真实复杂环境中仍保持高性能。

(六)兼容主流视频模型,生态适配广

可与Sora2、Veo3等顶尖视频生成模型无缝联动,为AI生成视频自动配套专业音效,也支持本地实拍视频、剪辑视频等各类无声视频素材,适配短视频、影视、虚拟场景等多种创作生态。

三、技术细节

(一)核心技术架构

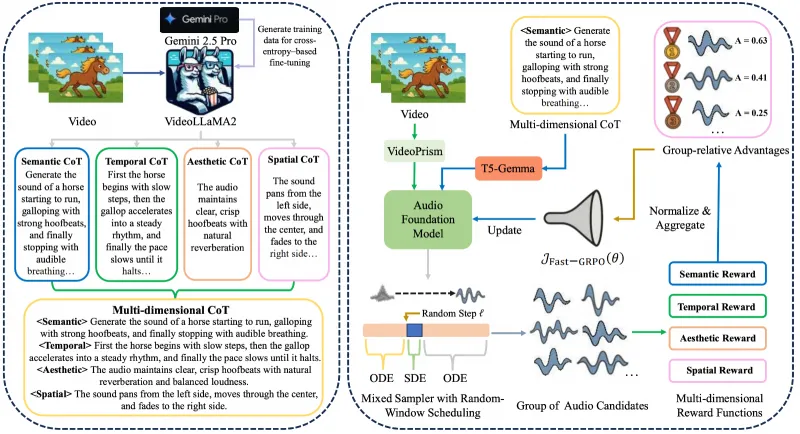

PrismAudio整体架构分为分解式思维链构建与Fast-GRPO多维强化学习优化两大核心模块,形成“推理规划→生成优化→迭代提升”的完整技术闭环:

分解式思维链构建阶段

数据生成:采用Gemini 2.5 Pro大模型生成高质量四维思维链训练数据,覆盖语义、时序、美学、空间四大维度的推理逻辑;

模型微调:用生成的数据微调VideoLLaMA2模型,让其具备精准生成四维分解式CoT的能力,输出结构化的音频生成“行动指南”。

多维强化学习优化阶段

基座模型:以T5-Gemma为音频基础生成模型,接收思维链指令与视频特征,生成初始音频;

多维奖励:语义奖励、时序奖励、美学奖励、空间奖励四大函数独立打分,精准评估各维度质量;

Fast-GRPO优化:通过混合ODE-SDE随机窗口采样,大幅降低强化学习训练成本,实现高效多目标优化,提升音频整体质量。

(二)关键技术创新

分解式思维链(Decomposed CoT)

把传统单一推理过程拆分为四个专项模块,每个模块聚焦单一目标,避免目标纠缠:语义CoT:确定“生成什么声音”,如“马奔跑的马蹄声、停止后的呼吸声”;

时序CoT:确定“声音何时出现、节奏如何”,如“慢步→加速快跑→减速停止”;

美学CoT:确定“声音质感如何”,如“清晰清脆、自然混响、响度均衡”;

空间CoT:确定“声音位置在哪”,如“左→中→右的声像移动”。

Fast-GRPO高效强化学习算法

针对传统GRPO训练效率低的问题,提出混合ODE-SDE采样策略,搭配随机窗口调度,在保证优化效果的同时,显著减少训练时间与算力消耗,让多维强化学习在V2A领域真正落地实用。AudioCanvas均衡测评基准

构建更贴合真实场景的测评数据集,单事件类覆盖300种常见音效,多事件样本包含501个复杂组合场景,解决现有数据集分布失衡、场景简单的问题,为V2A模型提供更严谨、更全面的测评标准。

(三)性能指标表现

以下为PrismAudio在核心测试集上的关键指标对比(核心指标节选):

| 测试场景 | 模型 | 语义CLAP↑ | 时序DeSync↓ | 美学PQ↑ | 空间PC↓ | 主观MOS-Q↑ | 推理时间(s) |

|---|---|---|---|---|---|---|---|

| 域内VGGSound | PrismAudio | 0.47 | 0.41 | 6.38 | 3.24 | 4.21±0.35 | 0.63 |

| 域外AudioCanvas | PrismAudio | 0.52 | 0.36 | 6.68 | 2.82 | 4.12±0.28 | - |

指标说明:CLAP代表语义匹配度(越高越好),DeSync代表时序不同步率(越低越好),PQ代表音频美学质量(越高越好),PC代表空间定位误差(越低越好),MOS-Q为主观音质评分(越高越好)。数据显示,PrismAudio在四大维度均领先基线模型,实现全维度SOTA性能。

四、应用场景

(一)短视频内容创作

为自媒体创作者、短视频博主的无声实拍/剪辑视频,一键生成脚步声、敲击声、自然声、场景音等环境音效,提升视频质感与观看体验,大幅缩短后期音效制作时间,降低创作门槛。

(二)AI视频生成配套

与Sora2、Veo3、HunyuanVideo等AI视频模型联动,为AI生成的无声视频自动生成匹配音效,解决AI视频“有画无声”的痛点,让AI视频内容更完整、更具沉浸感,适配AI影视、AI动画等创作场景。

(三)影视后期与拟音制作

为影视短片、纪录片、广告片等专业内容提供快速拟音服务,生成动作音效、场景音效、环境音效,辅助专业音效师完成基础工作,提升后期制作效率,尤其适合低成本影视项目、独立创作者使用。

(四)虚拟场景与元宇宙

为虚拟直播、虚拟场景搭建、元宇宙空间生成实时环境音效,根据虚拟画面动作与场景变化,同步生成对应音效,增强虚拟世界的真实感与交互体验,适配游戏、虚拟会展、虚拟直播等领域。

(五)教学与科普视频

为教学演示、科普实验、技能讲解等无声视频,精准生成操作音效、实验音效、场景音效,让视频内容更直观、更生动,提升教学与科普效果,适配教育机构、知识博主使用。

(六)音频数据集构建

为视频音频数据集生成高质量标注音效,辅助研究人员构建更丰富、更均衡的V2A训练数据集,推动视频转音频、多模态交互领域的技术研究与发展。

五、使用方法

(一)在线快速体验(新手首选)

打开PrismAudio官方体验页面(https://prismaudio-project.github.io/);

页面支持点击示例视频快速体验,也可上传本地无声视频文件;

佩戴耳机获取沉浸式立体声效果,点击生成按钮,等待模型完成音频生成;

生成完成后,可在线播放试听,支持下载生成的音频文件,直接用于视频剪辑。

(二)本地部署使用(开发者/专业用户)

环境准备

安装Python 3.8+、PyTorch 1.13+、CUDA 11.7+(GPU加速必备);

安装依赖库:ffmpeg、transformers、torchvision、soundfile等;

获取代码与权重

从官方开源仓库下载代码与预训练权重;

解压文件,放置到指定目录,配置模型路径;

推理调用

单视频推理:执行推理脚本,传入视频路径,设置输出格式、采样率等参数;

批量推理:配置视频文件夹路径,批量生成音频,提升效率;

参数调控:可修改思维链权重、奖励函数系数、空间声像参数等,自定义音效效果;

二次开发

支持微调思维链模块,适配特定场景音效(如工业音效、游戏音效);

可集成到视频剪辑工具、AI创作平台,实现一键音效生成。

(三)使用参数说明

输入:支持MP4、MOV、AVI等主流视频格式,建议分辨率720P及以上,时长1-30秒最佳;

输出:支持WAV、MP3格式,默认立体声,采样率44.1kHz,保证高音质;

可调参数:语义权重、时序同步强度、美学混响程度、空间声像宽度、推理速度模式等。

六、常见问题解答

PrismAudio支持生成人声配音吗?

不支持。PrismAudio专注于环境音效、动作音效、场景音效等非人声音频生成,核心解决视频无声场景的拟音需求,人声配音需搭配专用TTS模型使用。

本地部署PrismAudio需要什么硬件配置?

建议配置NVIDIA GTX 1660及以上GPU(显存≥6GB),CPU为i5/R5及以上,内存≥16GB,硬盘剩余空间≥20GB。低配置GPU可启用CPU推理,速度稍慢但可正常运行。

生成的音频声画不同步怎么办?

可通过调整时序CoT权重参数,提升时序奖励系数;确保输入视频画面清晰、动作无模糊,避免画面识别误差;使用官方推荐的视频格式与帧率,提升同步精度。

PrismAudio支持批量处理视频吗?

支持。本地部署版本可通过批量推理脚本,批量导入视频文件夹,自动为所有视频生成对应音频,适合批量短视频创作、数据集制作等场景。

生成的音频音质不佳、有杂音如何解决?

可提高美学CoT权重,增强美学奖励优化;选择高画质输入视频,避免画面模糊导致音效失真;输出格式优先选择WAV无损格式,保证音质完整。

PrismAudio可以用于商业项目吗?

可以。该项目为开源框架,遵循官方开源协议,个人非商用、商业商用均需遵守协议条款,具体可查看官方开源仓库的许可说明。

模型推理速度慢,如何提升生成效率?

启用GPU加速,确保CUDA环境配置正确;降低输入视频分辨率与时长,短片段视频生成速度更快;使用Fast-GRPO优化后的推理模式,提升处理速度。

PrismAudio支持多语言使用吗?

当前核心接口与文档以英文为主,官方体验页面支持基础英文交互,后续会逐步推出中文文档与接口,开发者可自行汉化适配。

如何微调PrismAudio适配特定场景音效?

准备特定场景的视频-音频配对数据,基于官方提供的微调脚本,强化对应场景的四维思维链训练,调整专属奖励函数,即可让模型适配工业、游戏、影视等特定场景的音效生成需求。

生成的立体声效果不明显怎么办?

佩戴专业耳机试听,立体声效果在耳机中呈现更完整;调高空间CoT权重,增强空间定位奖励;确保输入视频包含明显的空间移动画面,提升空间音效生成效果。

七、相关链接

PrismAudio官方项目主页:https://prismaudio-project.github.io/

开源代码仓库:https://github.com/FunAudioLLM/ThinkSound/tree/prismaudio

八、总结

PrismAudio作为阿里通义实验室研发、ICLR 2026收录的开源视频转音频框架,以分解式思维链与多维奖励强化学习为核心技术,精准解决传统V2A模型目标纠缠、声画不同步、音质差、空间感缺失等行业痛点,通过语义、时序、美学、空间四维协同优化,搭配518M轻量化参数、Fast-GRPO高效训练算法与AudioCanvas严谨测评基准,在域内与域外数据集上均实现全维度SOTA性能,既能为普通创作者提供一键式在线音效生成服务,也能为开发者提供本地部署与二次开发能力,广泛适配短视频、影视后期、AI视频生成、虚拟场景等多元场景,以轻量化、高效率、高质感的优势,成为视频转音频领域的标杆级开源方案,为内容创作与多模态AI技术落地提供高效实用的工具支撑。

版权及免责申明:本文由@AI铺子原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/prismaudio.html