SoulX-LiveAct:Soul AILab开源的实时数字人动画生成框架

一、SoulX-LiveAct 是什么

SoulX-LiveAct是由Soul AILab研发并开源的小时级实时人类动画生成框架,核心目标是为实时流式交互场景提供高保真、多模态可控、长时稳定的数字人视频生成能力。该框架聚焦解决传统AI数字人生成技术中时序漂移、显存爆炸、推理延迟高、无法长时运行四大核心痛点,通过底层算法创新与工程优化,实现从秒级、分钟级到小时级连续稳定生成的突破,同时支持服务器级显卡与消费级显卡双部署路径,让实时数字人技术从专业机房走向普通开发者与个人用户。

从技术定位来看,SoulX-LiveAct并非单纯的视频生成模型,而是一套端到端实时动画生成系统,包含算法创新、模型架构、推理引擎、工程优化、界面交互完整链路,可直接对接直播、视频通话、虚拟主播、在线访谈等真实业务场景,生成内容具备人物身份稳定、动作自然流畅、唇形精准同步、表情细腻丰富的特点,满足实时互动对低延迟、高流畅度的硬性要求。

二、SoulX-LiveAct 功能特色

1. 小时级长时稳定生成

传统视频生成模型受限于时序一致性与显存占用,通常只能生成几秒到几分钟的短视频,长时间运行会出现人物变形、动作卡顿、身份漂移等问题。SoulX-LiveAct通过ConvKV Memory轻量压缩机制,实现恒定显存占用,无论生成1分钟还是1小时视频,显存开销几乎无增长,从根本上解决长时生成显存爆炸难题,保障小时级连续稳定运行。

2. 实时流式推理输出

框架针对实时交互场景深度优化,采用端到端自适应FP8精度、序列并行、算子融合等工程手段,在双H100/H200服务器显卡上可达到20FPS实时渲染速度,分辨率支持720×416、512×512、480×832等规格,延迟低、流畅度高,可直接用于直播、视频通话等对实时性要求严苛的场景。

3. 消费级显卡兼容

项目突破专业显卡限制,2026年3月18日更新支持RTX 4090、RTX 5090等消费级显卡,通过FP8 KV缓存与CPU模型块卸载技术,18B大模型(14B Wan2.1+4B音频模块)在单RTX 5090上可实现6FPS推理速度,兼顾画质与硬件兼容性,降低个人与小型团队的使用成本。

4. 多模态精准控制

支持图像、音频、文本多模态联合控制:输入人物图像锁定身份与外观,输入音频自动同步唇形与语气动作,输入文本指令实时调整表情、动作、情绪,实现“所见即所得”的精准可控,满足个性化数字人定制需求。

5. 实时动作与情绪编辑

内置动作与情绪编辑模块,无需重新训练模型,可在实时生成过程中动态调整人物姿态、表情、肢体动作,适配访谈、脱口秀、唱歌、演讲等不同场景的表达需求,保持实时性的同时提升内容丰富度。

6. 轻量化插件式设计

核心创新模块均采用插件式架构,ConvKV Memory、SageAttention、FP8优化等组件可灵活插拔,不破坏原有模型结构,便于开发者二次开发、功能扩展与算法迭代。

7. 可视化GUI演示界面

提供图形化操作界面,无需复杂命令行操作,即可快速启动实时推理、查看生成效果、调整参数配置,降低使用门槛,适合非专业开发者快速上手体验。

三、SoulX-LiveAct 技术细节

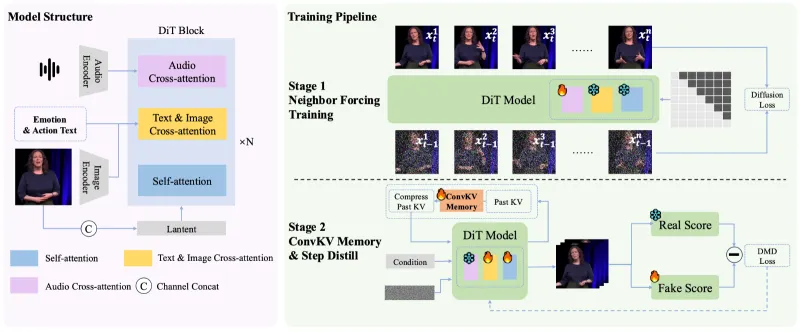

1. 核心算法创新

(1)Neighbor Forcing 时序一致性约束

SoulX-LiveAct将扩散步对齐的相邻隐层向量作为自回归扩散模型的核心归纳偏置,提出理论支撑完善的Neighbor Forcing机制,强制模型在每一步生成时参考相邻帧的隐层信息,保证帧间动作、外观、姿态的连续性,从算法根源解决数字人长时生成的抖动、变形、身份漂移问题,让小时级视频依然保持人物统一、动作流畅。

(2)ConvKV Memory 恒定显存机制

针对长视频生成KV缓存线性增长导致显存溢出的问题,项目设计ConvKV Memory轻量卷积压缩插件,对缓存信息进行高效压缩,实现恒定显存占用,无论视频时长增加多少,显存开销仅小幅波动,开销可忽略不计,为小时级生成提供硬件支撑。

2. 工程优化技术

端到端自适应FP8精度

全程采用FP8混合精度计算,在保证画质几乎无损失的前提下,大幅降低显存占用与计算量,提升推理速度。序列并行与算子融合

通过序列并行拆分计算任务,结合算子融合减少数据传输与计算冗余,充分发挥GPU算力。SageAttention 注意力核优化

集成FP8注意力加速核,提升注意力计算效率,是实现实时推理的关键组件。vllm GEMM核优化

搭载vllm 0.11.0版本的FP8 GEMM核,加速矩阵乘法运算,进一步提升推理吞吐量。LightVAE 轻量解码

使用LightVAE轻量变分自编码器,快速解码生成高清视频,平衡速度与画质。

3. 模型架构与性能

项目核心模型为18B组合模型,包含14B Wan2.1视觉生成模块与4B音频控制模块,配合chinese-wav2vec2-base音频特征提取模型,实现音画同步、唇形精准匹配。

| 硬件配置 | 分辨率 | 帧率 | 核心优化 |

|---|---|---|---|

| 双H100/H200 | 720×416/512×512 | 20 FPS | 自适应FP8、序列并行 |

| 单RTX 5090 | 720×416 | 6 FPS | FP8 KV缓存、CPU卸载 |

| 单RTX 4090 | 720×416 | 兼容运行 | FP8 KV缓存、CPU卸载 |

4. 精度与兼容性规划

项目已支持FP8精度,未来计划支持FP4精度,适配RTX 5090、B100、B200等新一代显卡,进一步降低显存占用,提升推理速度。

四、SoulX-LiveAct 应用场景

1. 实时直播与虚拟主播

支持7×24小时不间断直播,生成高保真虚拟主播,自动同步语音、表情与动作,无需真人出镜,降低直播成本,适用于电商直播、知识分享、娱乐直播等场景。

2. 在线播客与访谈节目

通过音频驱动生成自然流畅的数字人访谈画面,支持多人互动、情绪表达,打造沉浸式音频可视化播客,提升内容吸引力。

3. 实时视频通话(FaceTime)

将用户语音实时转换为数字人视频,实现虚拟形象视频通话,保护隐私的同时增加趣味性,适用于社交软件、在线客服、远程会议等场景。

4. 音乐与脱口秀表演

精准同步音乐节奏与台词语气,生成唱歌、脱口秀数字人表演,动作表情贴合内容,适合短视频创作、舞台表演等场景。

5. 企业虚拟数字人客服

7×24小时实时响应客户咨询,语音问答同步数字人动作表情,提升服务体验,适用于金融、电商、政务等客服场景。

6. 教育与在线授课

生成虚拟教师形象,实时同步授课语音与板书动作,打造沉浸式在线课堂,降低师资成本,适用于K12、职业教育等领域。

五、SoulX-LiveAct 使用方法

(一)环境依赖安装

创建Python虚拟环境

conda create -n liveact python=3.10 conda activate liveact pip install -r requirements.txt conda install conda-forge::sox -y

安装SageAttention(FP8注意力核)

git clone https://github.com/thu-ml/SageAttention.git cd SageAttention git checkout v2.2.0 python setup.py install

可选:安装融合版SageAttention

git clone https://github.com/ZhiqiJiang/SageAttentionFusion.git cd SageAttentionFusion python setup.py install

安装vllm(FP8 GEMM核)

pip install vllm==0.11.0

安装LightVAE

git clone https://github.com/ModelTC/LightX2V cd LightX2V python setup_vae.py install

(二)模型权重下载

从Huggingface或魔搭ModelScope下载以下模型:

SoulX-LiveAct 主模型

chinese-wav2vec2-base 音频模型

(三)推理运行命令

双H100/H200显卡实时流式推理

USE_CHANNELS_LAST_3D=1 CUDA_VISIBLE_DEVICES=0,1 \ torchrun --nproc_per_node=2 --master_port=$(shuf -n 1 -i 10000-165535) \ generate.py \ --size 416*720 \ --ckpt_dir 模型路径 \ --wav2vec_dir chinese-wav2vec2-base路径 \ --fps 20 \ --dura_print \ --input_json examples/example.json \ --steam_audio

实时动作/情绪编辑推理

USE_CHANNELS_LAST_3D=1 CUDA_VISIBLE_DEVICES=0,1 \ torchrun --nproc_per_node=2 --master_port=$(shuf -n 1 -i 10000-165535) \ generate.py \ --size 512*512 \ --ckpt_dir 模型路径 \ --wav2vec_dir chinese-wav2vec2-base路径 \ --fps 24 \ --input_json examples/example_edit.json

最优性能推理

USE_CHANNELS_LAST_3D=1 CUDA_VISIBLE_DEVICES=0,1 \ torchrun --nproc_per_node=2 --master_port=$(shuf -n 1 -i 10000-165535) \ generate.py \ --size 480*832 \ --ckpt_dir 模型路径 \ --wav2vec_dir chinese-wav2vec2-base路径 \ --fps 24 \ --input_json examples/example.json

RTX 4090/5090消费级显卡推理

USE_CHANNELS_LAST_3D=1 CUDA_VISIBLE_DEVICES=0 \ python generate.py \ --size 416*720 \ --ckpt_dir 模型路径 \ --wav2vec_dir chinese-wav2vec2-base路径 \ --fps 24 \ --input_json examples/example.json \ --fp8_kv_cache \ --block_offload \ --t5_cpu

单显卡评估推理

USE_CHANNELS_LAST_3D=1 CUDA_VISIBLE_DEVICES=0 \ python generate.py \ --size 480*832 \ --ckpt_dir 模型路径 \ --wav2vec_dir chinese-wav2vec2-base路径 \ --fps 24 \ --input_json examples/example.json \ --audio_cfg 1.7 \ --t5_cpu

(四)GUI演示界面运行

双H100/H200显卡GUI

USE_CHANNELS_LAST_3D=1 CUDA_VISIBLE_DEVICES=0,1 \ torchrun --nproc_per_node=2 --master_port=$(shuf -n 1 -i 10000-165535) \ demo.py \ --ckpt_dir 模型路径 \ --wav2vec_dir chinese-wav2vec2-base路径 \ --size 416*720 \ --video_save_path ./generated_videos

RTX 4090/5090显卡GUI

USE_CHANNELS_LAST_3D=1 CUDA_VISIBLE_DEVICES=0 \ torchrun --nproc_per_node=1 --master_port=$(shuf -n 1 -i 10000-165535) \ demo.py \ --ckpt_dir 模型路径 \ --wav2vec_dir chinese-wav2vec2-base路径 \ --size 416*720 \ --fp8_kv_cache \ --block_offload \ --t5_cpu \ --video_save_path ./generated_videos

六、常见问题解答

SoulX-LiveAct支持哪些显卡运行?

项目支持两类显卡,一是服务器级显卡H100、H200,二是消费级显卡RTX 4090、RTX 5090,后续还计划支持B100、B200等新型号。

消费级显卡运行时画质会下降吗?

开启FP8 KV缓存后,画质会有极其轻微的损失,肉眼几乎难以察觉,整体流畅度与真实度依然保持高水准。

运行时提示显存不足怎么办?

可添加--fp8_kv_cache、--block_offload、--t5_cpu三个参数,将模型块与KV缓存卸载到CPU,大幅降低GPU显存占用。

首次运行速度很慢是什么原因?

首次启动需要进行模型预热与算子编译,前几帧速度较慢,从第二次运行开始即可恢复正常实时速度。

如何调整生成视频的分辨率与帧率?

通过--size参数设置分辨率,支持416720、512512、480*832等规格;通过--fps参数设置目标帧率,最高支持24FPS。

生成的数字人唇形与音频不同步怎么办?

可调整--audio_cfg参数,默认值为1.0,适当提高数值可增强音频控制强度,提升唇形同步精度。

项目支持Windows系统运行吗?

项目官方提供Linux环境部署方案,Windows系统可通过WSL2虚拟机安装Linux环境运行。

如何实现小时级不间断生成?

无需额外设置,框架自带ConvKV Memory恒定显存机制,自动支持小时级长时生成,只需保证硬件稳定运行即可。

项目会开源训练代码吗?

根据开源计划,训练代码属于后续发布内容,目前已开源推理代码与模型权重,训练代码将在未来更新。

生成的视频可以商用吗?

需遵循项目开源协议,个人非商用可直接使用,商用前请仔细阅读项目许可文件并联系官方确认。

七、相关链接

SoulX-LiveAct GitHub开源地址:https://github.com/Soul-AILab/SoulX-LiveAct

八、项目总结

SoulX-LiveAct是Soul AILab面向实时交互场景打造的里程碑式开源数字人框架,以小时级长时稳定、实时流式推理、消费级显卡兼容、多模态精准控制为核心优势,通过Neighbor Forcing解决时序一致性问题、ConvKV Memory攻克显存瓶颈,配合全链路工程优化,实现高画质与高速度的平衡,覆盖直播、社交、教育、客服、娱乐等多元场景,同时开放完整代码与模型,大幅降低实时数字人技术的使用与开发门槛,为AI数字人从实验室走向规模化商用提供了高效、可靠、低成本的技术方案。

版权及免责申明:本文由@97ai原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/soulx-liveact.html