【保姆级】MM-Diff 本地部署教程:告别单模态,多模态应用轻松搭

如今做内容创作、数据分析或AI应用开发,单模态工具早已不够用——写文案缺视觉素材、做设计少文本说明、处理数据难联动多格式信息,“多模态协同”成了提升效率的关键。而MM-Diff作为轻量化且功能扎实的多模态模型,既能联动文本、图像、音频等多类型数据,又支持本地部署,不用依赖云端接口、不用担心数据隐私泄露,正好解决了多数人“想玩多模态却卡在上手难”的问题。

但不少朋友看到“本地部署”就犯怵,怕要写复杂代码、怕环境配置踩坑。别担心,这篇【保姆级教程】会把每一步拆到最细:从电脑配置检查、所需工具下载,到环境变量设置、模型文件部署,再到最后测试多模态功能,每个操作都附清晰指引,哪怕是零基础的新手,跟着步骤走也能轻松搭好属于自己的MM-Diff多模态应用,彻底告别单模态的局限。

一、MM-Diff简介

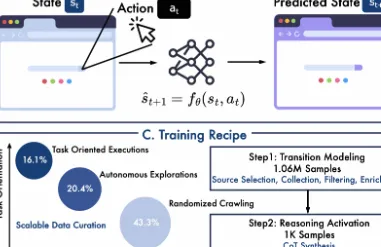

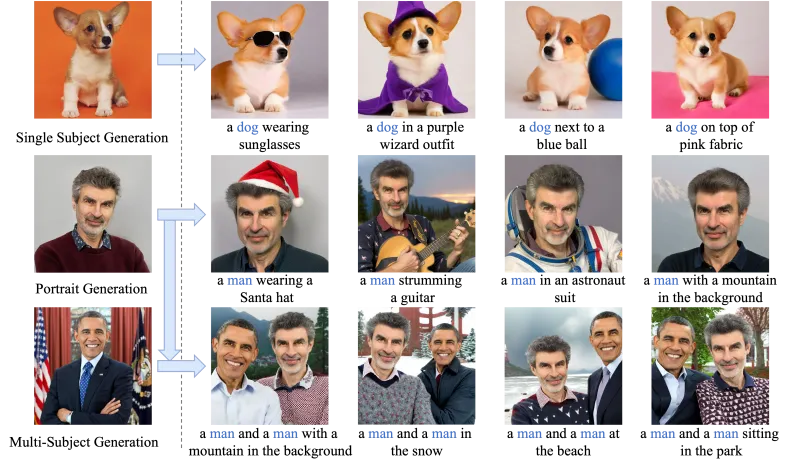

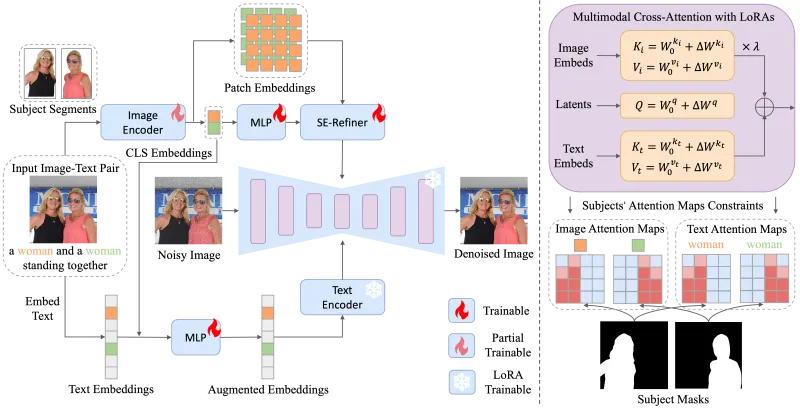

MM-Diff:通过多模态条件集成实现高保真图像个性化

MM-Diff,这是一个统一且无需调整的图像个性化框架,能够在几秒钟内生成单个和多个主题的高保真图像。在左侧,视觉增强文本嵌入和一小组细节丰富的主题嵌入通过精心设计的多模态交叉注意注入扩散模型。在右侧,我们说明了使用 LoRA 创新实现交叉注意力的细节,以及促进多主体生成的注意力约束。

二、本地部署流程

| 环境 | 版本 |

|---|---|

| Python | >=3.9.0 |

| PyTorch | =2.0.0 |

| Ubtuntu | =22.4.0 |

| CUDA | =11.8 |

1.创建虚拟环境

1.1 安装 Miniconda

步骤 1:更新系统

首先,更新您的系统软件包:

sudo apt update sudo apt upgrade -y

步骤 2:下载 Miniconda 安装脚本

访问 Miniconda 的官方网站或使用以下命令直接下载最新版本的安装脚本(以 Python 3 为例):

wget https://repo.anaconda.com/miniconda/Miniconda3-latest-Linux-x86_64.sh

步骤 3:验证安装脚本的完整性(可选)

下载 SHA256 校验和文件并验证安装包的完整性:

wget https://repo.anaconda.com/miniconda/Miniconda3-latest-Linux-x86_64.sh.sha256 sha256sum Miniconda3-latest-Linux-x86_64.sh

比较输出的校验和与.sha256 文件中的值是否一致,确保文件未被篡改。

步骤 4:运行安装脚本

为安装脚本添加执行权限:

chmod +x Miniconda3-latest-Linux-x86_64.sh

运行安装脚本:

./Miniconda3-latest-Linux-x86_64.sh

步骤 5:按照提示完成安装

安装过程中,您需要:

阅读许可协议 :按 Enter 键逐页阅读,或者按 Q 退出阅读。

接受许可协议 :输入 yes 并按 Enter。

选择安装路径 :默认路径为/home/您的用户名/miniconda3,直接按 Enter 即可,或输入自定义路径。

是否初始化 Miniconda :输入 yes 将 Miniconda 添加到您的 PATH 环境变量中。

步骤 6:激活 Miniconda 环境

安装完成后,使环境变量生效:

source ~/.bashrc

步骤 7:验证安装是否成功

检查 conda 版本:

conda --version

步骤 8:更新 conda(推荐)

为了获得最新功能和修复,更新 conda:

conda update conda

1.2.创建虚拟环境

conda create -n mmdiff python=3.9

2.下载 PyTorch

#进入虚拟环境 conda activate mmdiff #下载pytorch pip install torch==2.0.0 torchvision==0.15.1 torchaudio==2.0.1 --index-url https://download.pytorch.org/whl/cu118

3.克隆MM-Diff仓库

自动下载:

git clone https://github.com/alibaba/mm-diff.git

本地下载

网址:alibaba/mm-diff: MM-Diff: High-Fidelity Image Personalization via Multi-Modal Condition Integration

4.安装依赖

由于MM-Diff使用的PyTorch是1.13.1,但是这个版本的torch已经不在维护,并且不能安装,因此使用了torch==2.0.0

为了避免版本冲突,推荐使用下面的requirements.tsx文件来安装相关依赖

分享文件:requirements.txt

链接:https://pan.xunlei.com/s/VOPhbOL9Dc5hNkYvlj1ifMinA1?pwd=z2wu#

复制这段内容后打开迅雷,查看更方便

注意使用时请先删除原本的requirements.txt文件

pip install -r requirements.txt

5.启动MM-Diff

5.1 下载模型

MM-Diff使用的是Hugging Face中的模型由于网络的问题可能会下载不成功,因此推荐下载到本地使用,若是能过自动下载的可以跳过此步骤

若空间足够推荐下载到/mm-diff/wen文件中(大约32GB)

Hugging Face

下面是hugging中模型的网址

ModelScope(推荐)

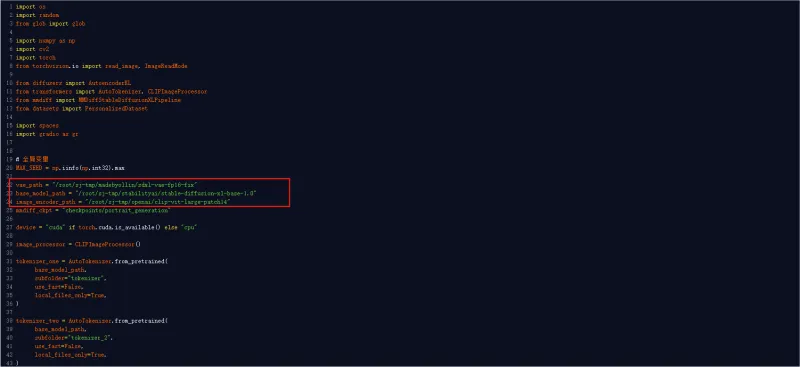

修改模型路径(若下载到的是/mm-diff中可不用修改)

文件路径:/mm-diff/mmdiff_gradio_demo.py

修改以下几行:

5.2 启动

使用下面的命令来启动MM-Diff

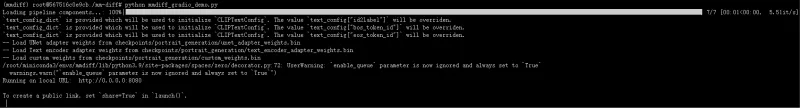

python mmdiff_gradio_demo.py

运行结果

在浏览器中输入一下网址即可进入MM-Diff的gradio页面

http://127.0.0.1:8080

总结

看完这篇教程,你已经掌握了MM-Diff本地部署的核心流程:先确认电脑系统与硬件是否满足基础要求(Windows/macOS/Linux均可适配,显卡配置建议),再通过Git或官方渠道下载源码与依赖包,接着按照步骤配置Python环境、安装必备库,最后导入模型文件并运行测试脚本——整个过程不用复杂编程,跟着指引操作就能完成部署。

更重要的是,部署完成后,你可以直接用MM-Diff实现多模态联动:比如输入文本生成配套图像、给音频文件匹配文本说明、甚至让不同格式的数据相互转换,不管是做自媒体内容、办公效率工具,还是个人兴趣项目,都能打破单模态的限制。如果后续遇到环境报错、模型运行卡顿等问题,也可以回头对照教程中的“避坑提示”排查,真正让多模态应用落地到日常使用中。

版权及免责申明:本文来源于#算家计算,由@AI工具箱整理发布。如若内容造成侵权/违法违规/事实不符,请联系本站客服处理!该文章观点仅代表作者本人,不代表本站立场。本站不承担相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-tutorial/901.html