AngelSlim:腾讯开源的大模型压缩工具包,一站式量化与推理加速

一、AngelSlim是什么

AngelSlim是由腾讯混元AI Infra团队完全开源的大模型压缩与推理加速工具包,定位为“更易用、更全面、更高效”的一站式大模型轻量化解决方案。它以统一框架整合量化、推测解码、推理提前退出、缓存优化、稀疏化等主流与自研前沿压缩技术,支持大语言模型(LLM)、视觉语言模型(VLM)、音频模型(ASR/TTS)、文生图扩散模型等全模态大模型的压缩、训练、加速与部署。

AngelSlim的核心目标是解决大模型落地的三大痛点:显存占用过高、推理速度慢、部署成本昂贵。它让普通开发者能用单张消费级/工业级GPU完成7B~235B规模模型的轻量化,让大模型从“云端专属”走向“端云协同”,从“高成本运行”走向“低成本规模化部署”。

该工具已在腾讯内部混元系列、外部Qwen、GLM、DeepSeek等主流大模型上深度验证,提供开箱即用的配置、预训练压缩权重、标准化部署脚本与完善文档,是面向产业与研究社区的生产级压缩框架。

二、功能特色

1. 全模态全覆盖,统一框架极简使用

AngelSlim从底层设计支持全模态大模型,包括:

大语言模型:混元、Qwen2.5/3、GLM-4.6、DeepSeek-R1、Kimi-K2、Seed-OSS

多模态模型:Qwen3-VL/Qwen3-Omni、混元多模态

音频模型:ASR、TTS

扩散模型:FLUX等文生图模型

所有模态共享同一套压缩接口,无需重复适配,大幅降低开发成本。

2. 一站式压缩能力,算法矩阵完整

覆盖从近无损到极致压缩全档位:

高精度量化:FP8(静态/动态)、INT8、NVFP4

高效量化:INT4(GPTQ/AWQ/GPTAQ/LeptoQuant)

自研极致压缩:TEQUILA三元量化、Sherry 1.25bit硬件友好量化

推理加速:Eagle3全尺度推测解码、SpecExit推理提前退出

缓存优化:DeepCache、TeaCache、TaylorCache

稀疏化:结构化稀疏、Token剪枝(开发中)

3. 自研算法持续创新,性能领先业界

Sherry:硬件高效1.25bit量化,在极低比特下保持高精度

TEQUILA:三元量化,平衡压缩比与效果

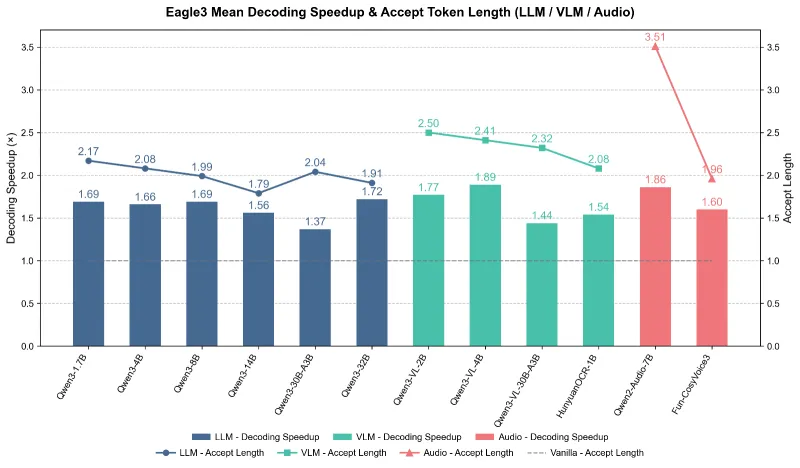

Eagle3:全模态可训练推测解码,推理加速1.4~1.9倍

SpecExit:推理提前退出,减少66%推理计算量,延迟降至原生1/2.5

单GPU支持Qwen3-235B、DeepSeek-R1等超大模型量化

4. 训练即部署,无缝对接主流生态

直接导出适配vLLM、HuggingFace Transformers的压缩模型

提供OpenAI兼容API服务、离线推理、批量评测脚本

支持在线/离线双模式训练、断点续训、多卡并行

5. 工程化完善,开箱即用

标准化YAML配置,一键运行压缩流程

提供大量预量化模型权重(HuggingFace/ModelScope)

完善中英文文档、CI/CD保障、依赖清晰、环境兼容好

三、技术细节

1. 量化技术体系

AngelSlim提供从高位到极低比特的完整量化链路,兼顾精度、速度与硬件友好性。

| 量化类型 | 比特 | 代表算法 | 核心优势 | 适用场景 |

|---|---|---|---|---|

| FP8 | 8 | 静态/动态量化 | 近无损、速度快、显存减半 | 高精度服务端 |

| INT4 | 4 | AWQ/GPTQ/GPTAQ/LeptoQuant | 显存减75%、速度显著提升 | 通用部署、高并发 |

| NVFP4 | 4 | NVIDIA硬件友好 | 适配Hopper架构、低延迟 | NVIDIA云端GPU |

| 三元 | ~1.67 | TEQUILA | 高压缩、推理快 | 边缘设备 |

| 1.25bit | 1.25 | Sherry | 极致压缩、硬件高效 | 端侧/超低资源 |

2. Eagle3 推测解码(核心加速技术)

Eagle3是全模态推测解码训练框架,采用小模型多步预测 + 大模型一步验证架构:

轻量草稿模型快速生成多个候选Token

大模型并行验证,接受合法序列

大幅提升吞吐、降低首词延迟

支持LLM/VLM/Audio,无缝接入vLLM

实测吞吐提升1.4~1.9倍,精度无明显损失。

3. SpecExit 推理提前退出

SpecExit解决大模型“过度推理”问题:

简单问题提前输出结果

复杂问题继续深度计算

推理长度减少66%

延迟降至原生推测解码的1/2.5

不损失任务精度

4. 超大模型单卡压缩技术

通过内存调度、分层量化、动态卸载等技术,AngelSlim实现:

单GPU可运行Qwen3-235B、DeepSeek-R1量化

低显存占用、无需多卡张量并行

降低超大模型轻量化门槛

5. 多模态与扩散模型优化

支持VLM的视觉编码器与大语言模型联合压缩

支持FLUX等扩散模型量化与缓存优化

显著降低文生图显存占用与生成时间

四、应用场景

1. 云端高并发推理服务

降低70%~90%显存占用

提升吞吐1.5~2倍

适合对话API、客服机器人、企业知识库

2. 边缘设备部署

工控机、边缘网关、机器人

INT4/FP8可在中等GPU流畅运行

离线可用、低延迟、高可靠

3. 端侧轻量化(手机/PC/嵌入式)

Sherry 1.25bit、TEQUILA、2Bit量化

模型体积缩至几百MB

支持手机本地对话、智能耳机、智能家居

4. 多模态与AIGC应用

图文理解、视频理解、文生图

压缩后VLM/扩散模型速度提升、成本下降

5. 企业私有化部署

降低硬件门槛

单GPU即可运行7B~70B模型

数据不出域、安全可控

6. 科研与算法开发

快速复现/对比各类压缩算法

统一框架、统一评测、易于扩展

五、使用方法

1. 环境安装

pip install AngelSlim

或从源码安装:

git clone https://github.com/Tencent/AngelSlim cd AngelSlim pip install -r requirements/requirements.txt

2. 一键量化(以Qwen3-1.7B FP8为例)

python tools/run.py -c configs/qwen3/fp8_static/qwen3-1_7b_fp8_static.yaml

所有模型与算法均提供现成YAML,只需选择配置即可运行。

3. Eagle3 推测解码训练与部署

准备数据与目标模型

选择对应YAML配置

启动训练:

python tools/run.py -c configs/eagle3/xxx.yaml

导出后直接在vLLM加载加速

4. 模型导出与推理

支持导出HuggingFace格式

提供离线推理脚本:

python scripts/deploy/offline.py --model 压缩后模型路径

一键启动OpenAI风格API:

bash scripts/deploy/openai.sh --model 压缩后模型路径

5. 快速获取预压缩权重

可在HuggingFace/ModelScope下载已量化权重,直接部署使用。

六、常见问题解答(FAQ)

AngelSlim支持哪些大模型?

支持混元、Qwen2.5/3、GLM-4.6、DeepSeek-R1、Kimi-K2、Seed-OSS、Qwen3-VL/Qwen3-Omni等主流开源模型,同时支持自定义模型接入。

AngelSlim需要什么GPU配置?

从消费级RTX 3090/4090到A10、A100、H100均支持。单卡可量化到235B模型,低显存可通过分层与卸载机制运行。

量化后模型精度会下降多少?

FP8/INT8基本无损;INT4在典型任务下降1%~3%;Sherry/TEQUILA在极低比特下仍保持可用精度,具体视模型与任务而定。

Eagle3推测解码需要训练草稿模型吗?

需要,AngelSlim提供完整训练流程与配置,训练后可无缝接入vLLM获得加速。

SpecExit推理提前退出需要修改原模型吗?

不需要,无侵入式使用,不改变模型结构,直接在推理阶段启用。

压缩后的模型能直接用vLLM部署吗?

可以,支持直接导出vLLM兼容格式,开箱即用。

AngelSlim支持Windows/macOS吗?

主流功能支持Linux;Windows/macOS可使用WSL2或Docker;部分量化依赖CUDA,推荐Linux+NVIDIA GPU。

可以同时使用量化+Eagle3+SpecExit吗?

可以,组合使用可获得速度、显存、吞吐的多重收益,框架已做兼容优化。

是否支持多卡并行?

支持数据并行、张量并行,超大模型可通过多卡进一步提升速度。

有预量化好的模型可以直接下载吗?

有,在HuggingFace、ModelScope的AngelSlim官方账号提供大量可用权重。

商业使用需要注意什么?

主体代码Apache-2.0协议,可自由商用;部分第三方组件遵循各自协议,使用前请核对。

如何添加新的自定义模型?

遵循统一接口规范,实现适配层即可,文档提供详细扩展指南。

七、相关链接

GitHub开源地址:https://github.com/Tencent/AngelSlim

HuggingFace权重库:https://huggingface.co/AngelSlim

ModelScope模型库:https://modelscope.cn/organization/AngelSlim

八、总结

AngelSlim是腾讯混元团队面向大模型产业落地打造的开源压缩工具包,以统一框架整合全模态、全档位轻量化能力,包含成熟量化、自研Eagle3推测解码、SpecExit提前退出等核心技术,具备单卡超大模型压缩、训练即部署、无缝对接vLLM生态、开箱即用等工程优势,可显著降低大模型显存占用、提升推理速度、削减部署成本,覆盖云端服务、边缘计算、端侧设备、多模态AIGC与企业私有化等全场景,是当前功能完整、易用性强、生产级可用的大模型压缩解决方案。

版权及免责申明:本文由@97ai原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/angelslim.html