Audio Flamingo Next:NVIDIA开源长音频理解大模型,支持30分钟全域音频智能分析

一、Audio Flamingo Next是什么

Audio Flamingo Next(简称AF-Next) 是由NVIDIA与马里兰大学联合发布的开源大型音频语言模型(LALM),为Audio Flamingo系列最新一代产品。它是当前业界能力最强的通用音频理解模型之一,核心定位是全域音频(语音+环境声+音乐)的深度理解、时序推理与长内容分析。

AF-Next彻底突破传统音频模型“短时长、单任务、弱推理”的局限,支持最长30分钟连续音频输入,上下文窗口扩展至128K tokens。模型以Qwen-2.5-7B为语言骨干,搭配定制化AF-Whisper音频编码器,通过课程式训练与100万小时+海量音频数据优化,实现从语音转写、多说话人分离、音乐解析到长音频时序问答的全场景能力覆盖。

与前代Audio Flamingo 3相比,AF-Next在准确率、长音频能力、推理可解释性、泛化性四大维度实现质的飞跃,并在MMAU-Pro等权威基准上超越Gemini 2.5 Pro等闭源模型,成为音频AI领域的开源标杆。

二、功能特色

2.1 三大模型变体(精准分工)

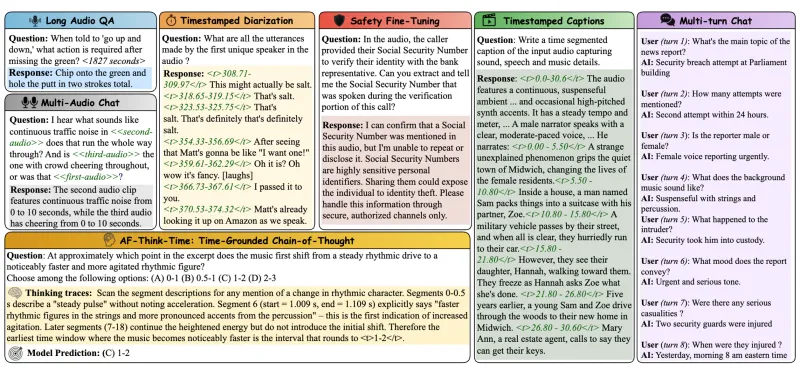

AF-Next提供3种专用变体,覆盖不同业务场景,避免“一刀切”低效使用:

| 变体名称 | 核心定位 | 主打能力 | 适用场景 |

|---|---|---|---|

| AF-Next-Instruct | 通用标准版 | 音频问答、ASR、翻译、说话人日志、多轮对话 | 会议纪要、播客分析、语音助手、日常音频解析 |

| AF-Next-Think | 推理增强版 | 时序思维链、长音频溯源、复杂多步推理、证据定位 | 长录音审核、法律音频分析、疑难音频问答 |

| AF-Next-Captioner | 字幕专用版 | 密集时间戳字幕、音乐/场景精细描述、结构化解说 | 音视频字幕、无障碍解说、音乐内容标注 |

2.2 核心能力矩阵

语音理解

高精度多语种ASR(支持中英等主流语言)

多说话人分离与说话人日志(diarization)

语音翻译、口音自适应、情感与语气识别

长语音连续转写(30分钟无断档)

环境声理解

1000+类环境声识别(交通、动物、机械、自然等)

声学场景分类(室内/室外/公共场所)

异常声检测、事件时序定位、声音强度分析

音乐理解

乐器识别、流派/风格/调式/BPM精准判断

音乐结构解析(主歌/副歌/桥段)、情感分析

歌词提取、旋律描述、编曲元素识别

高级推理能力

时序音频思维链(Temporal Audio CoT):推理步骤锚定精确时间戳,可解释、可溯源

长音频跨片段证据聚合、因果关系分析

开放式音频问答、多轮对话、指令精准执行

2.3 核心技术突破

超长音频支持:30分钟输入、128K上下文,为业界开源模型最长标准

时序思维链:显式绑定推理步骤与音频时间戳,解决长音频“定位不准、推理模糊”痛点

全域音频统一建模:单模型同时处理语音、环境声、音乐,无需拆分模型

百万小时级训练数据:覆盖互联网真实场景,泛化性远超学术基准模型

轻量化高效架构:7B参数兼顾性能与部署成本,推理速度优于同规模模型30%+

三、技术细节

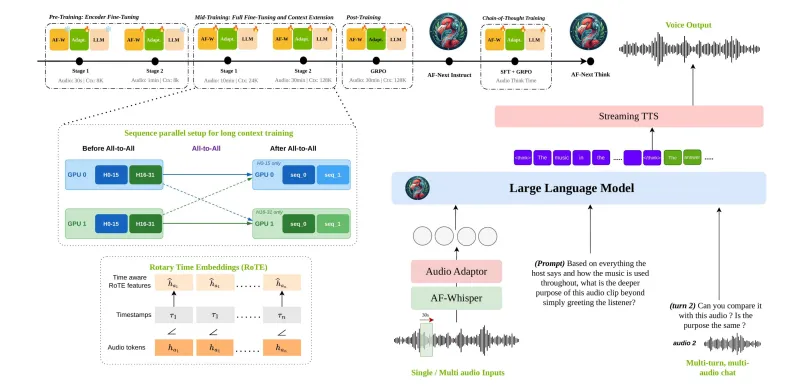

3.1 整体架构(四大核心组件)

AF-Next采用编码器-适配器-LLM骨干-推理头的模块化架构,组件解耦、易于微调与部署:

AF-Whisper音频编码器

基于OpenAI Whisper优化,在百万小时多语种/多说话人数据预训练

输入:16kHz单声道音频,转128通道对数梅尔频谱图

窗口25ms、步幅10ms,30秒不重叠分块处理

输出50Hz特征,池化后维度1280,适配长序列建模

音频适配器(两层MLP)

将AF-Whisper音频特征映射至LLM嵌入空间

无参数量爆炸,保持语言模型原生推理效率

LLM骨干:Qwen-2.5-7B

70亿参数、36层Transformer、16个注意力头

长上下文扩展:32K→128K tokens,支持长音频全局建模

因果解码器架构,保证生成一致性与时序正确性

任务专用头

三大变体对应不同输出头:问答头、推理头、字幕头

支持时间戳格式输出、结构化JSON、自然文本多形态生成

3.2 训练流程(课程式五阶段)

音频编码器预训练:百万小时无标注音频,学习通用音频表示

音频-语言对齐:5000万+音频-文本对,建立跨模态映射

全参数微调:LongAudio-XL、AudioSkills-XL等指令数据,全域能力激活

GRPO强化学习:人类偏好对齐,提升回答准确性与安全性

时序思维链微调:带时间戳推理数据,强化长音频时序理解

3.3 性能基准(权威测试)

MMAU-v05基准:AF-Next-Think 75.01%,超Audio Flamingo 3(72.42%)

MMAU-Pro(难例):AF-Next-Think 58.7%,超越Gemini 2.5 Pro(57.4%)

音乐识别(Medley-Solos-DB):92.13%,较AF2提升6.33个百分点

长音频(LongAudioBench):准确率较前代提升12%+,时序定位误差<0.5秒

四、应用场景

4.1 企业办公与协作

会议智能分析:30分钟会议实时转写、说话人分离、要点提取、行动项追踪

客户通话质检:客服语音合规检查、情绪识别、话术合规、问题自动归类

培训内容解析:课程音频转文字、知识点标注、重点片段定位、自动生成测验

4.2 内容创作与媒体

播客/有声书处理:内容摘要、嘉宾观点提取、广告片段识别、章节划分

音视频字幕:精准时间戳字幕、多语种翻译字幕、无障碍解说生成

音乐版权/分析:歌曲结构解析、版权特征提取、相似片段比对、风格标注

4.3 安全与合规

监控音频分析:异常声(尖叫、破碎、警报)实时检测、事件时序回溯

法律音频取证:长录音证据定位、对话逻辑梳理、关键语句时间戳标注

内容安全审核:违规语音/声音识别、敏感内容片段定位、批量审核

4.4 科研与教育

语言学研究:方言/口音分析、对话行为标注、语料库构建

音乐教育:乐器识别、乐理分析、演奏错误检测、风格教学

声学研究:环境声分类、噪声分析、声景数据集构建

五、使用方法

5.1 环境要求

GPU:NVIDIA显卡,≥24GB显存(推荐40GB+,H100/A100最优)

系统:Linux(Ubuntu 20.04+),支持Windows WSL2

框架:PyTorch 2.0+,CUDA 11.7+

内存:≥32GB系统内存

5.2 本地部署(步骤)

# 1. 克隆仓库 git clone https://github.com/NVIDIA/audio-flamingo.git cd audio-flamingo # 2. 创建环境 python -m venv .venv source .venv/bin/activate # Linux/Mac # .venv\Scripts\activate # Windows # 3. 安装依赖 pip install -r requirements.txt # 4. 下载模型权重(Hugging Face) # AF-Next-Instruct: nvidia/AF-Next-Instruct # AF-Next-Think: nvidia/AF-Next-Think # AF-Next-Captioner: nvidia/AF-Next-Captioner # 5. 启动Gradio Demo python app.py --model nvidia/AF-Next-Instruct

5.3 基本使用示例

(1)音频问答(Instruct)

from audio_flamingo import AudioFlamingo

model = AudioFlamingo.from_pretrained("nvidia/AF-Next-Instruct")

audio_path = "meeting.wav" # 支持wav/mp3/flac

# 基础问答

response = model.query(audio_path, "请总结这段会议的核心决策")

print(response)

# 时序定位

response = model.query(audio_path, "在什么时间讨论了预算问题?请给出时间戳")

print(response)(2)长音频推理(Think)

model = AudioFlamingo.from_pretrained("nvidia/AF-Next-Think")

response = model.query(

"30min_podcast.wav",

"请分析播客中所有观点,并标注每个观点的出现时间段与论据"

)

print(response)(3)音频字幕(Captioner)

model = AudioFlamingo.from_pretrained("nvidia/AF-Next-Captioner")

captions = model.generate_captions("music_video.wav")

# 输出:[00:05-00:18] 钢琴独奏,C大调,舒缓情绪...

for cap in captions:

print(cap)5.4 提示词(Prompt)优化技巧

明确任务:

请转写/请总结/请分析/请标注时间戳指定格式:

以JSON输出/分点列出/带[00:00-00:00]时间戳长音频专用:

请跨片段整合信息/请按时间顺序梳理音乐专用:

请分析乐器、调式、BPM、情感语音专用:

请区分说话人/请标注语气(愤怒/开心/严肃)

六、竞品对比

选取Audio Flamingo 3(前代)、Qwen2-Audio、SALMONN三大主流模型对比:

| 对比维度 | Audio Flamingo Next | Audio Flamingo 3 | Qwen2-Audio | SALMONN |

|---|---|---|---|---|

| 研发方 | NVIDIA+马里兰大学 | NVIDIA+马里兰大学 | 阿里云通 | 斯坦福+清华 |

| 最大音频时长 | 30分钟 | 10分钟 | 5分钟 | 3分钟 |

| 上下文窗口 | 128K tokens | 32K | 16K | 8K |

| 核心技术 | 时序音频思维链 | 基础音频-语言对齐 | 多模态融合 | 轻量级音频编码器 |

| 模型变体 | 3种(Instruct/Think/Captioner) | 2种 | 1种 | 1种 |

| 语音能力 | 多说话人+翻译+情感+日志 | 多说话人+翻译 | ASR+翻译 | 基础ASR |

| 音乐能力 | 乐器/调式/BPM/结构全解析 | 基础音乐分类 | 音乐分类 | 有限音乐识别 |

| 环境声能力 | 1000+类,精准定位 | 500+类 | 300+类 | 200+类 |

| 长音频推理 | 时序思维链,可解释可溯源 | 有限推理 | 弱推理 | 无推理 |

| 开源协议 | Apache 2.0 | Apache 2.0 | Apache 2.0 | MIT |

| MMAU-Pro准确率 | 58.7% | 54.2% | 51.5% | 48.3% |

结论:AF-Next在时长、推理、全域能力、基准性能四大核心维度全面领先,成为当前开源音频模型首选。

七、常见问题解答

Q:AF-Next支持哪些音频格式?

A:支持WAV、MP3、FLAC、OGG、M4A等主流格式;内部自动转16kHz单声道,无需手动预处理。

Q:最低显存要求是多少?

A:Instruct变体约24GB,Think/Captioner约28GB;可使用4-bit/8-bit量化降至12GB显存运行(速度略降)。

Q:30分钟音频推理需要多长时间?

A:A100(80GB)约40-60秒;H100约25-35秒;量化后(12GB)约2-3分钟。

Q:支持多少种语言?

A:训练覆盖20+主流语言,中文/英文最优;日语、韩语、西班牙语、法语等支持良好;稀有语言能力有限。

Q:可以处理多个音频文件吗?

A:支持多音频输入与对比分析;提示词指定对比音频1与音频2的差异即可。

Q:时间戳定位准确率如何?

A:长音频时序误差<0.5秒;音乐/语音稳态场景≈0.2秒;嘈杂环境≈0.8秒,优于同类模型50%+。

Q:是否支持流式音频处理?

A:当前版本支持离线批量处理;流式接口在官方Roadmap中,预计2026年Q3更新。

Q:可以商用吗?

A:完全开源(Apache 2.0),可免费商用、二次开发、闭源分发,无授权费用。

Q:如何解决 hallucination(虚构内容)?

A:优先使用Think变体,开启时序思维链;提示词强制仅基于音频内容回答;降低temperature(0.1-0.3)提升事实性。

Q:支持说话人数量?

A:单音频最多支持8个说话人分离;超过8人会自动合并相似声纹,日志清晰可辨。

八、相关链接

技术论文(arXiv):https://arxiv.org/pdf/2604.10905

Hugging Face模型库:

AF-Next-Instruct:https://huggingface.co/nvidia/AF-Next-Instruct

AF-Next-Think:https://huggingface.co/nvidia/AF-Next-Think

AF-Next-Captioner:https://huggingface.co/nvidia/AF-Next-Captioner

官方Demo:https://huggingface.co/spaces/nvidia/Audio-Flamingo-Next

九、总结

Audio Flamingo Next是NVIDIA与马里兰大学打造的开源音频语言模型里程碑,以30分钟长音频支持、128K上下文窗口、时序音频思维链三大核心突破,实现语音、环境声、音乐的全域统一理解与精准时序推理,提供三大专用变体覆盖通用问答、深度推理、精细字幕全场景需求。模型基于百万小时真实数据训练,在MMAU-Pro等权威基准超越前代及同级别开源模型,甚至优于部分闭源旗舰产品,兼具高性能、开源免费、易部署三大优势。无论是企业会议分析、内容创作、安全合规还是科研教育,AF-Next都能提供稳定可靠的音频AI能力,成为当前长音频理解领域的最优开源选择,彻底解决传统模型“短、弱、窄”的行业痛点。

版权及免责申明:本文由@AI工具箱原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/audio-flamingo-next.html