AutoGen:微软开源的多智能体AI框架,低代码构建自主协作与复杂任务执行

一、AutoGen是什么

AutoGen是微软研究院主导开发的多智能体AI应用开发框架,定位为“AI领域的PyTorch”,专注于简化多智能体系统的构建、编排、执行与优化。它的核心设计理念是:把复杂任务交给一组可对话、可定制、可协作的AI智能体,通过自动对话与分工配合,自主完成代码编写、数据分析、工具调用、流程自动化等高难度工作,同时支持人类随时介入干预、审核与引导,形成“AI+人”闭环协作。

AutoGen不是单一模型调用工具,而是一套完整的多智能体操作系统:从底层通信协议、智能体抽象、对话编排,到上层代码执行沙箱、工具集成、可视化无代码界面,形成全链路开发能力。它兼容几乎所有主流大语言模型(OpenAI、Azure OpenAI、开源本地模型等),支持跨语言、跨平台部署,既能用于快速原型验证,也能支撑企业级生产系统。

简单理解:传统AI是“一个助手帮你做事”,AutoGen是“你组建一支AI团队,它们自己开会、分工、干活、纠错,你只需要下达目标”。

二、AutoGen功能特色

AutoGen的功能围绕“多智能体协同、低门槛开发、强工具能力、高扩展性”四大方向设计,核心特色如下:

1. 多智能体对话协同(核心能力)

支持多种协作模式:双人对话、群聊GroupChat、顺序执行、嵌套对话、Swarm分布式协同、GraphFlow工作流编排。

智能体可自定义角色:程序员、测试员、分析师、管理员、审核员等,各司其职自动配合。

对话自动推进:无需人工逐轮触发,智能体之间自主对话直到任务完成。

2. 人机协同(Human-in-the-loop)

支持人类随时介入、打断、修改指令、提供反馈。

可设置强制审核点:代码执行前、决策前必须经人类确认。

兼顾自动化效率与人工可控性,适合金融、医疗、法律等高安全要求场景。

3. 原生代码执行与沙箱安全

内置Python代码执行环境,支持自动写代码→运行→报错→修复→再运行。

支持Docker隔离沙箱,降低本地执行风险。

可直接处理数学计算、数据可视化、文件处理、爬虫、数据分析等代码型任务。

4. 丰富工具调用能力

支持函数调用、API对接、数据库查询、网页浏览、文件读写。

提供MCP(Model Control Protocol)生态,可接入Playwright、搜索、第三方服务。

工具可动态注册、组合、链式调用,智能体自主判断何时使用工具。

5. 双生态支持:Python + .NET

Python:主力生态,包分为autogen-core、autogen-agentchat、autogen-ext、autogenstudio。

.NET:提供NuGet包,支持C#等语言,适合Windows企业栈集成。

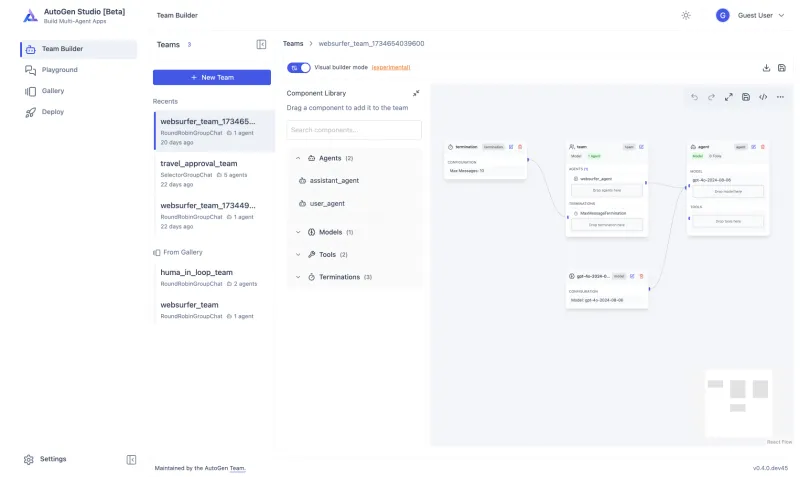

6. 无代码/低代码开发:AutoGen Studio

可视化拖拽构建智能体团队,无需写代码。

内置Playground实时调试、消息流可视化、Gallery社区组件库。

一键导出Python代码,便于生产部署。

7. 增强LLM推理层

统一多模型API适配、请求缓存、失败重试、负载均衡。

支持上下文管理、多配置推理、流式输出、错误处理。

降低模型调用成本,提升稳定性与响应速度。

8. 高度可扩展与模块化

扩展机制支持第三方插件、自定义智能体、自定义工具、自定义编排规则。

社区活跃,样本与组件丰富,可快速复用场景化方案。

三、AutoGen技术细节

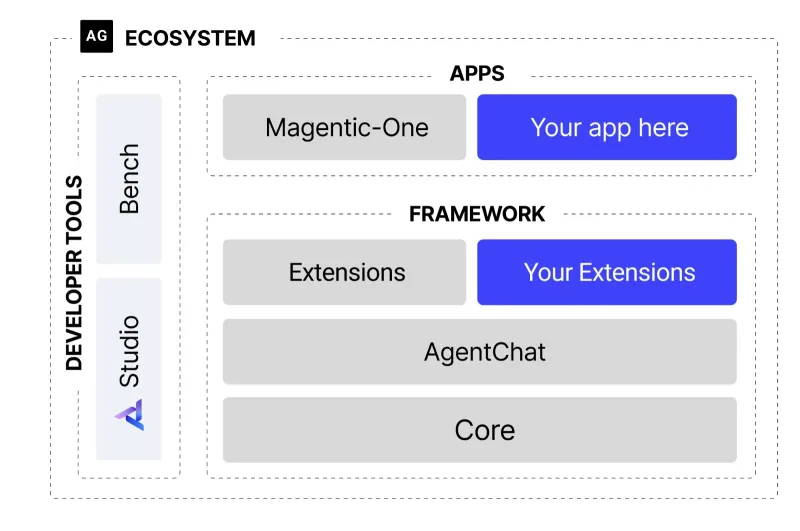

1. 架构分层(核心技术结构)

AutoGen采用清晰分层架构,从底层到上层依次为:

| 分层 | 作用 | 核心能力 |

|---|---|---|

| Core 核心层 | 底层通信、消息协议、智能体基类 | 消息传递、异步机制、状态管理 |

| AgentChat 层 | 对话式智能体封装 | 群聊、顺序对话、角色模板、协作模式 |

| Ext 扩展层 | 模型、工具、代码执行集成 | LLM适配、函数调用、沙箱、MCP |

| Studio 层 | 无代码可视化界面 | 拖拽编排、调试、导出、部署 |

| Bench 层 | 评测与基准测试 | 智能体效果评估、对比、优化 |

2. 核心组件说明

AssistantAgent:基于LLM的助手智能体,负责思考、生成内容、调用工具。

UserProxyAgent:用户代理,模拟人类交互,执行代码、收集反馈。

GroupChat + Manager:群聊与管理员,控制发言顺序、话题走向、终止条件。

Team:智能体团队封装,统一配置、工作流、终止规则。

Model Client:模型适配层,统一对接OpenAI/Azure/开源模型。

Executor:代码执行器,支持本地/Docker,安全隔离。

3. 工作流程原理

用户定义任务目标 → 2. 智能体团队接收任务 → 3. 自动分解子任务 → 4. 对话协作/工具调用/代码执行 → 5. 结果汇总 → 6. 判断是否完成 → 7. 终止或继续迭代。

4. 技术优势

对话优先:用自然语言对话替代硬编码流程,灵活度极高。

异步可扩展:v0.4+全面异步化,支持高并发、分布式智能体网络。

低侵入:可嵌入现有系统,无需重构架构。

安全可控:代码沙箱、人工审核、权限限制,满足企业合规。

四、AutoGen应用场景

AutoGen通用性极强,覆盖研发、办公、数据分析、自动化、教育、企业服务等领域,典型场景如下:

1. 软件开发自动化

需求→代码→测试→调试→修复全流程自动完成。

代码审查、Bug定位、单元测试生成、文档生成。

前后端分离开发、数据库脚本生成、API对接自动化。

2. 数据分析与商业智能

自动拉取数据→清洗→分析→绘图→生成报告。

Excel/CSV/数据库批量处理、指标监控、异常检测。

3. 企业流程自动化(RPA+AI)

表单处理、邮件自动分类、合同审核、报表生成。

客服工单分流、知识库问答、多轮意图理解。

4. 科研与教育

数学推导、论文辅助、实验设计、数据仿真。

编程教学、智能答疑、作业自动批改。

5. 多步骤复杂决策

旅行规划、采购方案、供应链优化、风险评估。

智能体辩论、多观点对比、最优方案推荐。

6. 低代码AI应用搭建

业务人员用AutoGen Studio快速搭建行业助手。

一键部署为API、Web服务、Docker容器。

五、AutoGen使用方法

1. 环境准备

支持系统:Windows/macOS/Linux

Python版本:3.10+

依赖:pip、git(可选)、Docker(可选,用于安全沙箱)

2. 安装方式

# 安装核心对话框架 pip install -U "autogen-agentchat" "autogen-ext[openai]" # 安装无代码Studio pip install -U "autogenstudio"

3. 配置模型API Key

import autogen

config_list = [

{

"model": "gpt-4o",

"api_key": "你的OpenAI Key",

"base_url": "可选,代理地址"

}

]4. 最简示例:双智能体对话

from autogen import AssistantAgent, UserProxyAgent

# 助手智能体

assistant = AssistantAgent(

name="助手",

llm_config={"config_list": config_list}

)

# 用户代理(执行代码)

user_proxy = UserProxyAgent(

name="用户代理",

human_input_mode="NEVER", # 无人工干预

code_execution_config={"work_dir": "coding"},

)

# 启动任务

user_proxy.initiate_chat(

assistant,

message="用Python绘制正弦曲线并保存为图片"

)5. 启动AutoGen Studio(无代码)

autogenstudio ui --port 8080

打开浏览器访问 http://localhost:8080 即可可视化构建。

6. 部署方式

本地运行:直接Python执行

容器化:Docker打包

服务化:导出为API端点

集成:嵌入FastAPI/Flask/Django等

六、常见问题解答(FAQ)

AutoGen和CrewAI、LangGraph有什么区别?

AutoGen以“对话驱动”为核心,更接近自然聊天式协作,代码执行能力原生且强;CrewAI偏向结构化任务流程;LangGraph偏向图编排。AutoGen更适合自由对话、代码型、强交互场景。

AutoGen必须用GPT模型吗?

不是。它支持OpenAI、Azure OpenAI、Anthropic、通义千问、文心一言、Llama、Qwen等开源本地模型,只需在config_list中配置对应参数。

代码执行安全吗?会不会损坏系统?

默认在指定目录执行,可设置文件白名单;生产环境强烈建议开启Docker隔离,从根本避免权限风险。

没有编程基础可以用AutoGen吗?

可以。AutoGen Studio提供无代码界面,拖拽即可搭建智能体团队,适合业务人员快速使用。

AutoGen商用是否免费?

是。采用MIT开源协议,个人与商业均可免费使用、修改、分发。

如何让智能体自动停止任务?

可设置终止条件:关键词(如TERMINATE)、最大轮数、任务完成检测函数、人工手动停止。

AutoGen支持多模态吗?

支持。可对接支持图像/音频的LLM,在消息中传递图片链接或Base64,实现图文多模态协作。

如何对接自己的API/工具?

通过装饰器注册函数,即可让智能体自动调用;也可使用Tool类封装,支持参数校验、返回格式化。

AutoGen可以离线运行吗?

可以。只要对接本地离线LLM,且不依赖联网工具,即可完全内网运行。

从旧版本升级到v0.4+需要注意什么?

v0.4是重构版本,包结构拆分(core/agentchat/ext),部分API有变化,建议按官方迁移指南逐步更新。

七、相关链接

GitHub仓库:https://github.com/microsoft/autogen

Python API文档:https://microsoft.github.io/autogen/stable/reference/

八、总结

AutoGen是微软推出的成熟开源多智能体框架,以对话协同为核心,整合了LLM调用、代码执行、工具链、人机交互与低代码开发能力,提供Python与.NET双生态支持,既能让开发者快速构建复杂AI系统,也能让普通用户通过可视化界面落地自动化任务。它在软件开发、数据分析、企业流程自动化、科研教育等场景具备广泛实用价值,凭借安全可控、灵活扩展、生态丰富的特性,成为当前多智能体领域主流选择,可帮助各类使用者以更低成本实现AI能力落地与效率提升。

版权及免责申明:本文由@人工智能研究所原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/autogen.html