BitDance:字节跳动开源的二进制令牌自回归超快高分辨率AI图像生成模型

一、BitDance是什么

BitDance是由字节跳动等机构联合推出的开源自回归生成模型项目,核心解决传统离散自回归模型在视觉生成中令牌器重建质量低、词汇表过大采样困难、逐令牌生成速度慢等痛点,通过二进制令牌体系+并行预测范式,实现高分辨率、高质量、高速度的图像生成,同时支持统一多模态建模。

该项目于2026年2月正式开源,配套发布论文、预训练模型、在线Demo与完整代码库,核心模型为14B参数文生图模型,同时提供轻量级ImageNet类别条件生成模型,在自回归模型阵营中首次实现对主流扩散模型的性能反超,兼具学术研究价值与工程落地能力。

BitDance的核心定位:

面向高分辨率图像生成的自回归SOTA模型

基于二进制令牌的统一多模态基础架构

开箱即用的生产级图像生成开源工具链

可扩展、可复现、可微调的学术研究平台

与传统自回归模型(如VAR、Emu3、Janus-Pro)和扩散模型(如SD3、FLUX.1-Dev)相比,BitDance在速度、画质、扩展性三者间取得平衡,用更低计算成本实现更高生成质量,是自回归视觉生成路线的里程碑式开源成果。

二、功能特色

1. 极致生成速度:30倍加速,高分辨率秒级出图

采用Next-Patch Diffusion并行预测机制,单步最多生成64个视觉令牌

1024×1024图像仅需64步完成,传统自回归模型需数千步

同等硬件下,生成速度提升30倍以上,支持实时级图像生成

2. 顶级生成画质:SOTA指标,照片级真实感

文生图基准DPG-Bench总分88.28,超越主流开源扩散模型与自回归模型

ImageNet 256×256生成FID低至1.24,达到自回归模型顶尖水平

强语义理解、空间推理与文字渲染能力,复杂提示词还原度高

支持最高1024px超清图像生成,细节丰富、结构稳定

3. 二进制令牌创新:超大词汇表,重建质量飞跃

配套UniWeTok统一二进制令牌器,词汇表规模达2^128

突破传统令牌器词汇表上限,图像重建精度、保真度显著提升

二进制表示降低计算复杂度,采样更稳定、收敛更快

4. 统一多模态架构:文本-视觉原生兼容

文本令牌沿用标准LLM范式,视觉令牌采用二进制高效范式

一套架构同时处理文本与视觉,天然支持多模态理解与生成

易于与现有大语言模型融合,降低多模态系统开发成本

5. 完整模型矩阵:覆盖大模型与轻量场景

项目提供两类核心模型,满足研究与落地不同需求:

| 模型类型 | 代表模型 | 参数规模 | 核心能力 | 适用场景 |

|---|---|---|---|---|

| 文生图模型 | BitDance-14B-64x | 14B | 1024px文生图,64步生成 | 生产级文生图、高质量创作 |

| 文生图模型 | BitDance-14B-16x | 14B | 512/1024px文生图,16步/块 | 通用图像生成、服务部署 |

| ImageNet模型 | BitDance-H-1x | 1.0B | 256px类别条件生成,FID=1.24 | 学术研究、轻量验证 |

| ImageNet模型 | BitDance-L-1x | 527M | 256px类别条件生成,FID=1.31 | 中等算力验证、教学实验 |

6. 全栈开源工具链:训练-推理-评估一站式

提供完整训练代码、FSDP分布式训练支持

开箱即用推理脚本,支持单卡/多卡部署

配套标准评估流程,可复现FID、IS等权威指标

支持Hugging Face Diffusers集成,降低使用门槛

三、技术细节

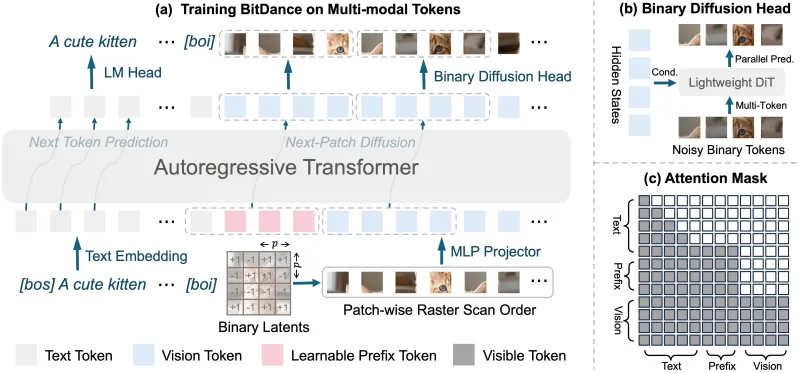

1. 核心技术栈

基础架构:Transformer自回归架构

令牌体系:UniWeTok二进制视觉令牌器

预测头:二进制扩散头(Binary Diffusion Head)

并行范式:Next-Patch Diffusion(下一补丁扩散)

训练框架:PyTorch、FSDP分布式训练

部署支持:原生PyTorch、Hugging Face Diffusers

2. 二进制令牌技术(UniWeTok)

传统视觉令牌器使用固定小词汇表(如8192/32768),重建质量与表达能力受限。BitDance提出UniWeTok统一二进制令牌器:

词汇表规模:2^32 / 2^128 / 2^256,接近“无限词汇表”

编码方式:将图像块映射为二进制向量,而非离散索引

优势:重建精度更高、细节保留更好、泛化能力更强

配套论文:arXiv:2602.14178,独立验证SOTA性能

3. 二进制扩散头

将传统逐令牌分类问题转换为连续空间向量预测:

把大规模整数分类拆解为并行二元分类任务

降低采样难度,提升生成稳定性与收敛速度

天然适配二进制令牌,实现预测-解码全链路优化

4. Next-Patch Diffusion并行生成

突破自回归“逐令牌生成”瓶颈:

一次性预测一个图像补丁(Patch)的所有二进制令牌

单步最大并行预测64个令牌,生成步数断崖式下降

1024px图像仅需64步,速度提升30倍+

并行度可配置(1x/4x/16x/64x),适配不同硬件

5. 模型缩放与Scaling Law

遵循与LLM一致的缩放定律,参数越大效果越好

14B模型在语义、结构、细节上全面超越小模型

训练数据效率更高,更少数据达到闭源模型效果

支持从百万级到百亿级参数平滑扩展

6. 训练与推理配置

训练:14B模型需大规模GPU集群(如64×H100)

推理:14B模型可在单张A100/H100运行,支持低内存优化

轻量模型:242M~1.0B模型可在消费级GPU(3090/4090)运行

四、应用场景

1. 创意设计与内容生产

广告海报、电商主图、宣传物料快速生成

游戏原画、概念设计、场景草图实时创作

自媒体配图、短视频封面、IP形象设计

室内/工业设计效果图快速预览

2. 游戏与元宇宙开发

游戏贴图、材质、场景实时生成

动态NPC形象、道具、场景迭代

低延迟沉浸式视觉内容生产

3. 影视与动画制作

分镜脚本、概念图、关键帧快速生成

背景、道具、特效元素批量制作

动画风格化渲染与预览

4. 学术研究与技术创新

自回归模型架构优化、令牌算法研究

多模态大模型统一建模探索

高效图像生成算法验证与对比

二进制表示在AI生成中的应用拓展

5. 企业级服务与工具开发

私有化部署文生图API服务

设计工具、办公软件AI图像插件

教育、文创、电商行业垂直生成工具

五、使用方法

1. 环境准备

# 克隆仓库 git clone https://github.com/shallowdream204/BitDance.git cd BitDance # 创建Conda环境 conda create -n bitdance python=3.10 conda activate bitdance pip install torch torchvision torchaudio pip install -r requirements.txt

2. 模型下载

从Hugging Face下载预训练模型:

文生图模型:shallowdream204/BitDance-14B-64x

ImageNet模型:shallowdream204/BitDance-ImageNet

二进制令牌器:shallowdream204/UniWeTok

3. 快速推理(文生图)

# 运行示例脚本 python example_t2i.py \ --prompt "A beautiful sunset over the ocean, photorealistic, high detail" \ --model BitDance-14B-64x \ --size 1024 \ --steps 64

4. 使用Diffusers推理

from diffusers import BitDancePipeline

import torch

pipe = BitDancePipeline.from_pretrained(

"shallowdream204/BitDance-14B-64x",

torch_dtype=torch.float16

).to("cuda")

image = pipe(

prompt="A cute cat sitting on a sofa, 8k, ultra realistic",

num_inference_steps=64,

height=1024,

width=1024

).images[0]

image.save("output.png")5. ImageNet类别条件生成

# 采样生成 torchrun --nproc_per_node=8 sample_ddp.py \ --model BitDance-H \ --ckpt models/BitDance_H_1x.pt \ --vae-ckpt models/ae_d16c32.pt \ --sample-dir results/

6. 模型训练

# 分布式训练脚本 bash scripts/train.sh

六、常见问题解答

BitDance与传统自回归模型(如VAR、Emu3)的核心区别是什么?

核心区别在令牌体系与生成范式:BitDance用二进制令牌替代传统离散索引,用Next-Patch Diffusion并行生成替代逐令牌生成,速度提升30倍+,画质与扩展性更强。

BitDance相比扩散模型(SD3、FLUX)有哪些优势?

优势包括:生成步数极少(64步vs数千步)、速度更快、遵循LLM式缩放定律、架构更统一、易于多模态融合,在开源模型中画质达到SOTA。

运行BitDance-14B需要什么硬件配置?

建议最低配置:NVIDIA A100(40GB+)或H100 GPU;消费级GPU可运行轻量级ImageNet模型(242M~1.0B),如RTX 3090/4090。

BitDance支持中文提示词吗?

支持,模型在多语言数据上训练,中文提示词可正常生成,效果接近英文水平,在中文文生图基准中表现优秀。

除了文生图,BitDance还支持哪些任务?

当前开源版本主打文生图与ImageNet类别条件生成;项目团队正在开发图像编辑、图生图、视频生成等能力,未来会逐步开源。

BitDance的模型可以商用吗?

项目采用开源协议,允许学术与商用使用,具体以仓库LICENSE文件为准,建议使用前仔细阅读协议条款。

如何提高生成图像的质量?

可通过以下方式优化:使用更详细的提示词、提高推理步数、调整CFG-Scale、使用64x并行模型、升级到14B大模型。

BitDance支持本地私有化部署吗?

完全支持,所有模型与代码均可本地部署,无在线API依赖,适合企业私有化与安全合规场景。

UniWeTok令牌器可以单独使用吗?

可以,UniWeTok独立开源,可单独用于图像编码、重建、特征提取等任务,与BitDance模型解耦。

有没有在线Demo可以体验?

有,官方提供Hugging Face Spaces在线Demo,无需代码即可测试文生图能力。

七、相关链接

Hugging Face模型库:https://huggingface.co/collections/shallowdream204/bitdance

在线Demo:https://huggingface.co/spaces/shallowdream204/BitDance-14B-64x

八、总结

BitDance是基于二进制令牌的自回归生成模型开源项目,通过UniWeTok超大词汇表二进制令牌器、二进制扩散头与Next-Patch Diffusion并行生成三大核心创新,解决传统自回归模型速度慢、采样难、重建差的痛点,实现30倍生成加速与SOTA级画质,提供14B生产级文生图模型与轻量级ImageNet模型,配套完整训练、推理、评估工具链,支持多场景落地与学术研究,是自回归视觉生成路线的突破性开源方案,兼具速度、质量与扩展性,为AI图像生成提供了全新技术选择。

版权及免责申明:本文由@97ai原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/bitdance.html