DeepSeek-TUI:开源终端AI编程智能体,终端内一站式代码开发运维工具

一、DeepSeek-TUI 是什么

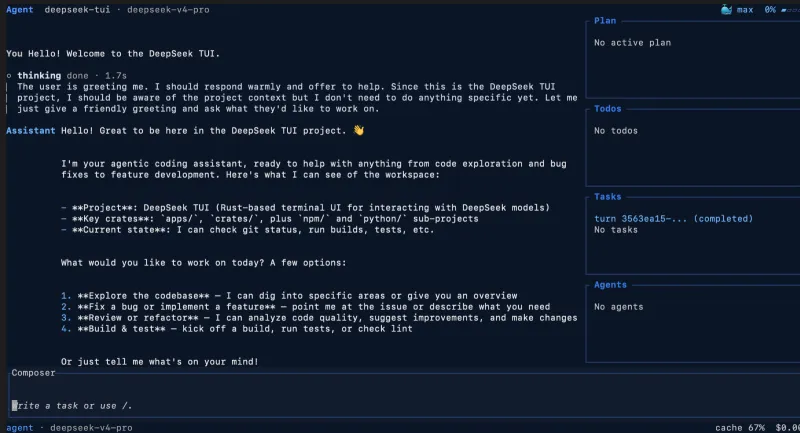

DeepSeek-TUI 是一款基于 DeepSeek 大模型 构建的开源终端交互式 AI 编程智能体,采用 Rust 语言开发,主打纯终端 TUI(Terminal User Interface)交互界面,无需依赖浏览器、桌面客户端,全程在命令行终端内完成 AI 对话、代码开发、项目运维、文件管理、Git 操作、联网检索等全流程工作。

该项目定位轻量化终端 AI 开发助手,非 DeepSeek 官方出品,遵循开源托管规范,支持跨平台部署运行,兼容 Linux、macOS、Windows 主流操作系统,同时适配 x86_64、ARM64 硬件架构。用户只需配置 DeepSeek 系列模型 API Key,即可在本地终端唤醒智能体,依托 DeepSeek V4 系列大模型超强代码理解、逻辑推理、长上下文处理能力,赋能个人开发者、运维工程师、编程爱好者实现终端内一站式 AI 辅助开发。

区别于传统网页版 AI 对话工具和桌面客户端,DeepSeek-TUI 深度贴合开发者终端操作习惯,全键盘操控、无图形界面冗余、低资源占用,完美适配服务器无桌面环境、远程 SSH 运维、本地极简开发等场景,是终端重度使用者专属的 AI 编程生产力工具。

二、功能特色

1. 三种智能运行模式

内置三种工作模式,适配不同使用需求,可自由切换:

Plan 规划模式:只读式项目探索,仅输出代码优化方案、项目架构设计、问题排查思路,不自动修改任何本地文件,适合前期需求梳理和方案评估。

Agent 智能代理模式:默认标准交互模式,模型调用文件读写、Shell 命令、Git 操作等工具时,需人工确认后执行,兼顾智能化与操作安全性。

YOLO 全自动模式:无确认全自动执行,模型可自主调用各类工具完成代码编写、bug 修复、项目部署、命令执行,适合信任模型输出、追求高效自动化的开发场景。

2. 全链路开发工具集成

深度内置开发者常用工具能力,无需切换终端和其他软件:

文件操作:支持本地项目文件读取、写入、创建、删除、批量编辑;

终端指令:直接调用系统 Shell 命令,执行编译、运行、环境配置等操作;

Git 版本管理:集成提交、拉取、合并、分支切换、版本对比等完整 Git 流程;

联网检索:内置网页搜索能力,可实时检索技术文档、报错解决方案、开源项目资料;

补丁应用:自动生成代码补丁并一键应用,精准修复项目漏洞与代码缺陷;

子智能体调度:支持拆分复杂任务,启用子智能体分工协作完成大型项目开发。

3. 模型与性能优势

原生适配 DeepSeek-V4-Pro、DeepSeek-Flash 等主流模型,支持百万级超长上下文窗口;

推理流式输出,终端实时展示 AI 回复内容,无需等待完整响应;

内置调用成本统计,实时展示模型调用次数、消耗额度,方便管控使用成本;

Auto 智能模型调度,可根据任务复杂度自动匹配最优模型与推理强度。

4. 会话与工作区管理

支持会话保存与恢复,历史对话、开发任务可随时断点续接;

工作区快照功能,一键保存项目当前状态,出错可快速回滚还原;

配置文件本地化存储,API Key、界面偏好、默认模式等配置永久留存。

5. 多生态兼容扩展

支持 Docker 容器化一键部署,隔离运行环境,开箱即用;

多安装渠道适配:npm、Cargo、Homebrew 均可快速安装;

兼容主流模型兼容接口:NVIDIA NIM、Ollama、vLLM、Fireworks 等,可对接本地私有化大模型。

6. 交互与体验优化

纯 TUI 终端交互,全键盘快捷键操控,无需鼠标;

原生支持中文交互界面,适配国内用户使用习惯;

低内存、低 CPU 占用,低配服务器、老旧设备也可流畅运行。

三、技术细节

1. 核心开发架构

DeepSeek-TUI 整体基于 Rust 语言 开发,依托 Rust 高性能、内存安全、跨平台编译的特性,保障终端程序低卡顿、无内存泄漏、跨系统一致性运行。项目采用模块化架构设计,拆分交互层、模型调度层、工具调用层、文件管理层、网络请求层,模块解耦度高,便于二次开发和功能扩展。

2. 技术栈组成

核心语言:Rust

TUI 界面框架:基于终端 UI 组件库构建,实现终端分栏布局、快捷键监听、流式内容渲染;

模型通信:采用 HTTP 流式请求对接 DeepSeek OpenAI 兼容接口,支持 SSE 流式数据解析;

配置管理:使用 TOML 格式配置文件,存储 API 密钥、模型参数、界面设置、默认运行模式;

工具调用:内置自研工具调用协议,标准化封装文件、Shell、Git、网络检索等能力;

部署支持:支持 Cargo 源码编译、npm 二进制包分发、Docker 镜像打包。

3. 配置文件结构

项目配置默认存储在用户目录下:

~/.deepseek/config.toml

配置文件包含核心配置项:API Key、默认模型、超时时间、流式开关、成本统计开关、默认运行模式、代理配置等,支持手动编辑修改,也可在终端内交互式配置。

4. 运行原理流程

用户在终端启动 DeepSeek-TUI,加载本地配置文件;

输入任务需求,程序将上下文与任务指令封装请求发送至 DeepSeek API;

大模型解析需求,判断是否需要调用文件、Shell、Git 等工具;

根据当前运行模式,判断是否需要用户确认工具执行;

执行对应操作后,将结果回传给大模型,持续多轮迭代直至任务完成;

自动记录会话日志与工作区状态,支持后续恢复与回滚。

四、应用场景

远程服务器运维开发

无桌面云服务器、SSH 远程连接场景下,无需安装浏览器和桌面软件,直接在终端用 AI 辅助编写脚本、排查服务故障、配置环境、部署项目。程序员本地极简开发

习惯终端开发、使用 Vim/Nvim 编辑器的开发者,可无缝集成日常编码、代码重构、bug 修复、接口文档生成工作,全程不离开终端。编程学习与入门练习

新手学习者可通过终端对话提问语法问题、解析代码逻辑、生成入门案例、排查编译报错,轻量化学习编程知识。开源项目维护

在终端内完成开源项目代码审阅、补丁生成、Git 版本管理、Issue 问题分析,高效维护开源仓库。私有化模型对接使用

支持对接 Ollama、vLLM 本地私有化部署大模型,企业和个人可在内网环境实现离线 AI 终端开发,保障数据安全。低配置设备生产力提升

老旧电脑、低配轻薄本资源有限,无法运行大型桌面 AI 客户端,DeepSeek-TUI 低占用特性可流畅运行,提供同等 AI 编程能力。

五、使用方法

1. 环境前置要求

系统:Linux / macOS / Windows

依赖:终端环境、网络可访问 DeepSeek API、安装 Node.js 或 Rust 编译环境(二选一)

准备:申请 DeepSeek API Key

2. 安装方式

方式一:npm 快速安装

npm install -g deepseek-tui

方式二:Cargo 源码安装

cargo install deepseek-tui

方式三:Docker 部署

docker run -it --rm hmbown/deepseek-tui

3. 初始化配置

首次运行执行命令:

deepseek

按照终端提示输入 DeepSeek API Key,选择默认模型、运行模式,配置自动保存至本地 config.toml。

4. 基础启动命令

# 自动匹配模型启动 deepseek --model auto # 指定 DeepSeek 专业模型启动 deepseek --model deepseek-v4-pro

5. 基础操作流程

进入 TUI 交互界面后,直接输入开发需求;

模型给出方案后,若涉及文件修改、命令执行,按提示选择确认/取消;

可通过快捷键切换 Plan/Agent/YOLO 三种模式;

任务完成后可保存会话,退出终端即可自动留存配置。

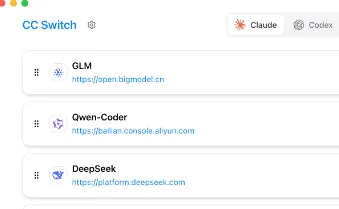

六、竞品对比

选取同类型终端 AI 编程智能体 Claude Code、Codex CLI 两款主流产品做横向对比:

| 对比维度 | DeepSeek-TUI | Claude Code | Codex CLI |

|---|---|---|---|

| 开发主体 | 个人开源非官方 | Anthropic 官方出品 | OpenAI 官方出品 |

| 底层模型 | DeepSeek V4 系列 | Claude 系列 | GPT-4 / Codex |

| 交互形式 | 纯 TUI 终端界面 | 终端命令行交互 | 终端命令行交互 |

| 中文适配 | 原生中文界面+中文优化 | 中文支持一般 | 中文适配较弱 |

| 资源占用 | 极低,适配低配设备 | 中等 | 中等 |

| 私有化部署 | 支持 Ollama/vLLM 对接 | 不支持本地私有化 | 仅官方接口,无私有化 |

| 开源协议 | 开源 MIT 协议 | 闭源 | 闭源 |

| 国内网络适配 | 可配置代理,访问稳定 | 国内访问受限 | 国内访问门槛高 |

七、常见问题解答

Q1:DeepSeek-TUI 是 DeepSeek 官方工具吗?

A1:不是官方产品,是第三方开发者 Hmbown 基于 DeepSeek 大模型开源开发的终端 TUI 工具,仅为个人开源项目,与 DeepSeek 官方无关联。

Q2:运行时报 API Key 错误如何解决?

A2:首先检查 DeepSeek API Key 是否输入正确,确认密钥已开通模型调用权限、账户余额充足;其次检查网络代理配置,若国内网络无法直连,需在配置文件中设置代理地址,重启终端重新加载配置即可。

Q3:是否可以使用本地 Ollama 部署的大模型?

A3:支持。只需在 config.toml 中修改模型接口地址为 Ollama 本地接口,切换兼容模型格式,即可对接本地私有化大模型离线使用。

Q4:Windows 系统能否正常运行 DeepSeek-TUI?

A4:可以,Windows 终端、PowerShell、Git Bash 均可完美适配,安装后命令行直接输入启动命令即可正常使用全部功能。

Q5:如何重置所有配置恢复默认设置?

A5:直接删除用户目录下的 .deepseek 文件夹,重新执行 deepseek 启动命令,即可重新初始化配置,恢复项目默认参数。

Q6:全自动 YOLO 模式会不会误删本地文件?

A6:存在极小风险,建议重要项目先使用工作区快照备份;日常开发优先使用 Agent 确认模式,仅在测试项目、非核心代码场景使用 YOLO 全自动模式。

八、相关链接

九、总结

DeepSeek-TUI 是一款依托 Rust 高性能开发能力与 DeepSeek 大模型强大代码推理能力打造的开源终端 AI 编程智能体,以纯 TUI 终端交互为核心特色,集成多运行模式、全链路开发工具、跨平台兼容、轻量化低占用等多重优势,适配远程服务器运维、终端日常开发、编程学习、私有化模型部署等多元场景,相比同类闭源终端 AI 工具具备中文适配好、国内网络友好、开源免费、支持私有化部署等突出亮点,安装简单、配置便捷,完全贴合终端开发者的操作习惯,能够大幅提升命令行环境下的编程、运维和项目管理工作效率,是终端爱好者与后端运维人员极具实用价值的开源生产力工具。

版权及免责申明:本文由@97ai原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/deepseek-tui.html