DeepSpeed-MII:DeepSpeed 团队推出的大模型推理高性能优化与部署工具

一、DeepSpeed-MII是什么

DeepSpeed-MII是由微软DeepSpeed团队打造的开源Python大模型推理部署专用库,全称为Model Implementations for Inference,是DeepSpeed生态中聚焦于模型推理阶段的核心组件,基于DeepSpeed-Inference的底层优化能力进行上层封装与功能扩展,核心定位是让大模型推理部署更简单、更高效。

在大模型落地过程中,推理部署往往面临诸多痛点:硬件资源利用率低、手动调优难度大、部署流程繁琐、高并发场景下延迟高吞吐量低,且不同模型、不同硬件的适配需要大量底层开发工作。DeepSpeed-MII针对这些痛点设计,将DeepSpeed团队自研的各类推理优化技术进行整合与自动化适配,开发者无需编写复杂的优化代码、无需深入理解CUDA内核、张量并行等底层技术,仅通过几行简单的Python代码,就能实现大模型的高效推理部署,同时充分利用GPU、多机多卡等硬件资源,达到工业级的推理性能。

该项目托管于GitHub开源平台,采用Apache 2.0开源协议,具备完全的商用自由与二次开发权限,无商业使用限制,目前已成为大模型推理部署领域的主流工具之一,广泛应用于企业、科研机构的大模型落地场景,同时持续迭代更新,适配最新的大模型架构与硬件设备。

二、功能特色

DeepSpeed-MII围绕大模型推理部署的核心需求设计,兼具低门槛、高性能、高灵活性、高兼容性四大核心特质,其功能特色可概括为六大方面,覆盖从开发到生产的全流程推理需求:

自动化极致性能优化,无需手动调参

这是DeepSpeed-MII最核心的特色,该库会通过内置的策略匹配引擎,根据模型架构、模型尺寸、硬件配置(GPU型号/数量)、推理批大小、生成参数等信息,自动选择并组合最优的推理优化策略,无需开发者手动调试各类优化参数。无论是小参数量模型的低延迟推理,还是超大模型的高吞吐量生成,都能实现硬件资源的最大化利用,避免因手动调优不当导致的性能损耗。超高推理性能,高吞吐低延迟双优

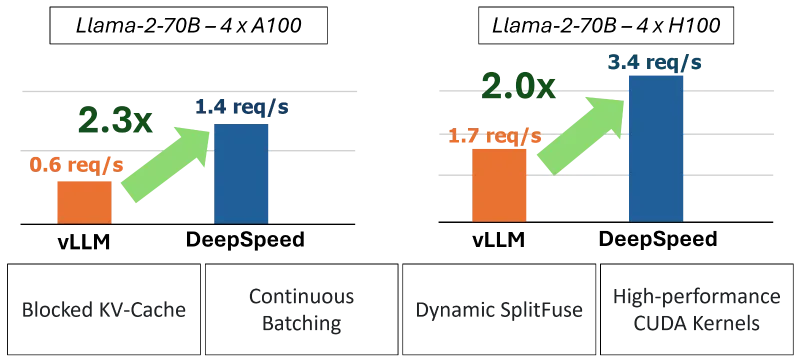

整合了DeepSpeed团队自研的一系列业界领先的推理优化技术,针对大模型文本生成的核心场景做了极致优化。在高吞吐量场景下,最新版本的DeepSpeed-MII相比vLLM等主流推理框架,有效吞吐量最高可提升2.5倍;在低延迟场景下,通过内核融合、张量并行等技术,可大幅降低单条请求的响应时间,同时支持动态批处理,兼顾单条请求低延迟与批量请求高吞吐。部署门槛极低,极简API一键上手

提供高度封装的Python原生API,接口设计简洁直观,开发者无需搭建复杂的底层服务框架,仅通过一行代码即可启动本地推理或远程推理服务,调用生成结果也仅需简单的函数调用,大幅降低了大模型推理部署的技术门槛,即使是不具备底层优化经验的开发者,也能快速实现大模型的推理落地。双推理模式,适配全场景需求

支持本地直连推理与持久化服务部署两种核心模式,可灵活适配不同场景:本地直连推理无需启动服务,直接加载模型并生成结果,轻量化无依赖,适合开发调试、小批量请求、单机部署等场景;持久化服务部署可启动常驻的gRPC推理服务,并支持扩展为RESTful HTTP接口,支持远程调用、负载均衡,适合线上高并发、分布式部署、多客户端调用等生产环境场景。全面兼容主流大模型,无需修改模型代码

对目前工业界与开源社区的主流大模型架构做了深度适配,覆盖从几亿参数到4050亿参数(405B)的全尺寸模型,开发者无需修改模型的原始代码,直接传入模型名称或本地模型路径即可实现部署,大幅提升了开发效率。高扩展性,支持多维度集群部署

原生支持多GPU张量并行,可将超大模型拆分到多个GPU上进行推理,解决单GPU显存不足的问题;同时支持多副本部署,可启动多个推理服务副本实现负载均衡,应对高并发请求;此外,服务端支持与主流的微服务框架、网关工具集成,可轻松扩展为大规模的分布式推理集群,满足企业级的规模化部署需求。

三、技术细节

DeepSpeed-MII的高性能与高易用性,源于其底层整合的多种先进推理优化技术,以及合理的架构设计,其核心技术体系可分为底层核心优化技术、架构设计逻辑、服务部署技术三部分,各部分相互配合,实现推理性能与部署体验的双重提升。

(一)底层核心优化技术

DeepSpeed-MII基于DeepSpeed-Inference构建,整合了针对Transformer架构大模型的专属优化技术,可分为高吞吐量优化与低延迟优化两大方向,分别适配不同的推理场景:

高吞吐量文本生成核心优化

针对大模型连续文本生成的核心场景,采用了Blocked KV缓存技术,通过对键值缓存进行分块管理,减少缓存的重复存储与读取,提升缓存利用率;同时支持连续批处理(Continuous Batching),可将不同时刻到达的推理请求动态组合成批次,避免GPU空闲,大幅提升吞吐量;此外,自研Dynamic SplitFuse技术与高性能CUDA内核,可对模型的前向计算过程进行硬件级加速,减少计算耗时。低延迟推理核心优化

采用DeepFusion for Transformers技术,将Transformer层中的多个算子融合为单个自定义CUDA内核,减少算子之间的数据传输与调度开销,提升计算效率;支持ZeRO-Inference技术,针对资源受限的场景,通过精细化的显存管理,在不损失性能的前提下降低显存占用,实现小显存硬件对大模型的推理支持;同时整合了编译器优化技术,对模型计算图进行优化,减少冗余计算。

(二)核心架构设计

DeepSpeed-MII采用分层架构设计,从上到下分为应用层API、策略匹配引擎、优化核心层、硬件适配层,各层职责清晰,解耦性强:

应用层API:提供给开发者的极简调用接口,包括本地推理、服务启动、服务调用、服务终止等功能,屏蔽所有底层细节;

策略匹配引擎:DeepSpeed-MII的“大脑”,负责收集模型、硬件、请求的相关信息,通过内置的策略库,自动匹配最优的优化组合与并行方案;

优化核心层:基于DeepSpeed-Inference实现,整合了各类推理优化技术,是性能提升的核心载体;

硬件适配层:针对不同的GPU型号(如NVIDIA A100、V100、RTX 3090/4090等)做了针对性的硬件适配,确保优化技术能在不同硬件上发挥最佳效果。

(三)服务部署技术

在服务部署方面,DeepSpeed-MII采用gRPC作为底层通信协议,具备传输速度快、序列化效率高、支持流式传输的特点,适合大模型推理的高数据量传输场景;同时提供RESTful HTTP接口扩展能力,通过封装gRPC服务,对外提供标准的HTTP POST接口,支持curl、Python requests、Postman等通用工具调用,降低客户端的接入门槛。

此外,在多GPU部署时,采用张量并行(Tensor Parallelism) 方案,将模型的层、参数拆分到多个GPU上,每个GPU负责部分计算任务,通过分布式通信实现数据交互,解决单GPU显存不足与计算能力有限的问题;多副本部署时,采用轮询负载均衡策略,将客户端请求均匀分发到各个推理服务副本,提升系统的并发处理能力。

四、应用场景

DeepSpeed-MII凭借其低门槛、高性能、高灵活性的特点,可适配从个人开发调试到企业级生产部署的全场景大模型推理需求,核心应用场景主要包括以下五类:

大模型开发与调试场景

对于算法工程师、大模型开发者而言,在模型微调、效果验证阶段,需要快速实现模型的推理测试,DeepSpeed-MII的本地直连推理模式无需启动服务,几行代码即可加载模型并生成结果,轻量化无依赖,能大幅提升开发调试效率,同时可通过自动化优化,在开发机的有限硬件资源下实现高效推理。小流量线上服务场景

对于创业公司、小型团队的小流量大模型应用,如智能客服、智能问答、文本辅助生成等,无需搭建复杂的分布式推理集群,通过DeepSpeed-MII可快速启动单节点的gRPC/RESTful推理服务,兼顾部署效率与推理性能,同时大幅降低运维成本。高并发工业级生产场景

对于中大型企业的高并发大模型应用,如电商智能推荐、内容平台文本生成、金融智能分析等,DeepSpeed-MII支持多GPU张量并行与多副本负载均衡,可轻松扩展为分布式推理集群,通过连续批处理、动态优化等技术,实现高吞吐量、低延迟的推理效果,满足线上生产环境的高并发、高可用需求。超大模型推理部署场景

对于70B、180B、405B等超大参数量大模型,单GPU无法满足显存与计算需求,DeepSpeed-MII的原生多GPU张量并行能力,可将模型拆分到多个GPU上进行推理,无需开发者手动实现分布式推理逻辑,大幅降低超大模型的部署难度,实现超大模型的工业级落地。大模型应用集成场景

对于需要将大模型推理能力集成到现有业务系统的场景,如企业ERP、CRM系统、移动端应用等,DeepSpeed-MII提供的标准gRPC/RESTful接口,可与主流的微服务框架、网关工具、移动端开发框架无缝集成,业务系统通过简单的接口调用即可获得大模型推理能力,实现大模型与现有业务的快速融合。

五、使用方法

DeepSpeed-MII的使用流程简单易懂,核心分为安装、两种推理模式使用、服务管理三部分,支持PyPI快速安装与源码安装,兼容Python3.8及以上版本,硬件上推荐使用NVIDIA CUDA-enabled GPU(算力7.0及以上),需提前安装CUDA、cuDNN等基础依赖。

(一)安装方式

PyPI快速安装(推荐)

适合大多数开发者,直接通过pip命令安装最新稳定版本,无需处理源码,命令如下:

pip install deepspeed-mii

源码安装(获取最新特性)

适合需要使用最新开发特性、参与项目贡献的开发者,先克隆仓库再本地安装,命令如下:

# 克隆GitHub仓库 git clone https://github.com/deepspeedai/DeepSpeed-MII.git # 进入仓库目录并安装 cd DeepSpeed-MII pip install ./

(二)本地直连推理(开发调试首选)

本地直连推理无需启动常驻服务,直接加载模型并调用生成,代码简洁,适合开发调试、小批量请求场景,核心示例如下:

import mii

# 加载模型,自动适配最优策略,tensor_parallel指定GPU数量

generator = mii.mii_query_handle("mistralai/Mistral-7B-v0.1", tensor_parallel=1)

# 调用模型生成文本,支持单条/多条请求,可自定义生成参数

responses = generator.query(

prompts=["DeepSpeed-MII is a tool for", "大模型推理部署的核心难点是"],

max_new_tokens=128, # 最大生成token数

temperature=0.7, # 生成温度,控制随机性

top_p=0.9 # 核采样参数

)

# 打印生成结果

for prompt, response in zip(["DeepSpeed-MII is a tool for", "大模型推理部署的核心难点是"], responses):

print(f"输入:{prompt}")

print(f"输出:{response}\n")(三)持久化服务部署(生产环境首选)

持久化服务部署会启动常驻的gRPC推理服务,支持远程调用、高并发请求,可扩展为RESTful接口,核心分为服务启动、服务调用、服务终止三步,示例如下:

服务启动与调用

import mii

# 启动gRPC推理服务,返回客户端句柄,tensor_parallel=2表示2卡张量并行

client = mii.serve(

model_name="meta-llama/Llama-2-7b-chat-hf",

tensor_parallel=2,

port=50051 # 指定服务端口

)

# 远程调用服务生成文本

responses = client(

prompts=["你好,请介绍一下DeepSpeed-MII", "Llama2模型的核心优势是什么"],

max_new_tokens=256

)

# 打印结果

for prompt, response in zip(["你好,请介绍一下DeepSpeed-MII", "Llama2模型的核心优势是什么"], responses):

print(f"输入:{prompt}")

print(f"输出:{response}\n")服务终止

当服务不再使用时,需手动终止以释放硬件资源,代码如下:

# 终止常驻的推理服务 client.terminate_server()

RESTful接口扩展

若需要使用HTTP接口调用,可在启动服务时指定enable_rest=True,即可通过POST请求调用,示例curl命令:

curl -X POST http://localhost:50051/generate \

-H "Content-Type: application/json" \

-d '{"prompts": ["你好,DeepSpeed-MII"], "max_new_tokens": 128}'(四)关键参数说明

DeepSpeed-MII的核心调用接口中,有几个关键参数需根据实际场景调整,核心参数说明如下表所示:

| 参数名 | 适用接口 | 核心作用 |

|---|---|---|

| model_name | mii_query_handle/serve | 模型名称(Hugging Face Hub)或本地模型路径,是加载模型的核心参数 |

| tensor_parallel | 所有接口 | 指定张量并行的GPU数量,解决显存不足问题,建议根据模型尺寸与GPU显存调整 |

| max_new_tokens | query/client/POST | 模型最大生成的token数,控制生成文本长度 |

| temperature | 生成接口 | 生成温度,0为确定性生成,数值越大随机性越强,建议0.5-1.0 |

| port | serve | 指定推理服务的端口号,避免端口冲突 |

| enable_rest | serve | 是否开启RESTful HTTP接口,True为开启,False为仅开启gRPC接口 |

六、常见问题解答

问题1:安装DeepSpeed-MII后,运行代码提示CUDA相关错误,如何解决?

答:该问题主要是CUDA环境未配置正确或硬件不兼容导致,解决方案有三点:一是确认本地安装的CUDA版本与DeepSpeed-MII依赖的CUDA版本匹配,建议使用CUDA 11.7/11.8/12.0;二是确认GPU为NVIDIA且算力≥7.0,DeepSpeed-MII暂不支持AMD GPU与CPU推理;三是若使用conda环境,需确保在conda环境中安装CUDA相关依赖,且环境变量配置正确。

问题2:加载大模型时提示显存不足,如何处理?

答:主要有两种解决方案:一是通过tensor_parallel参数增加张量并行的GPU数量,将模型拆分到多个GPU上,减少单GPU显存占用;二是确保使用的是DeepSpeed-MII最新版本,其内置的ZeRO-Inference技术会精细化管理显存,可有效降低显存占用;此外,可适当降低推理的批大小,减少运行时显存消耗。

问题3:调用推理服务时,吞吐量低、延迟高,如何优化?

答:首先确认已根据硬件与模型尺寸设置了合理的tensor_parallel参数,充分利用多GPU资源;其次,对于批量请求场景,可适当增大批大小,DeepSpeed-MII的连续批处理技术会在大批次下发挥更好的性能;最后,确保关闭不必要的程序,释放GPU资源,避免其他进程占用GPU导致推理性能下降。

问题4:能否部署本地微调后的大模型,而非Hugging Face Hub上的模型?

答:可以,只需将model_name参数替换为本地模型的绝对路径即可,DeepSpeed-MII会自动加载本地模型,且无需修改模型的原始代码,适配所有符合Hugging Face Transformers格式的微调模型。

问题5:启动gRPC服务后,远程客户端无法连接,如何排查?

答:首先检查服务端的防火墙是否开放了指定的端口(如50051),确保端口可被远程访问;其次确认远程客户端与服务端在同一局域网,或服务端具备公网IP;最后检查启动服务时的host参数,默认是localhost,若需要远程访问,需将host设置为0.0.0.0。

问题6:DeepSpeed-MII支持多机多卡的分布式推理吗?

答:目前DeepSpeed-MII主要优化了单节点多GPU的张量并行推理,对于多机多卡的分布式推理,需结合DeepSpeed的分布式训练框架与集群管理工具(如K8s)实现,建议在单节点多GPU无法满足需求时,再考虑多机多卡部署。

问题7:使用Llama2等有版权的模型时,提示权限不足,如何解决?

答:对于Hugging Face Hub上需要授权的模型,需先在Hugging Face官网申请模型访问权限,然后在本地通过huggingface-cli login命令登录自己的Hugging Face账号,验证通过后即可正常加载模型。

问题8:推理生成的结果质量不佳,如何调整?

答:可通过调整生成参数优化结果质量:一是降低temperature参数(如0.5以下)提升生成的确定性;二是调整top_p参数(如0.8-0.95)实现核采样,减少无意义的生成内容;三是增加max_new_tokens参数确保生成内容完整;此外,可使用模型的对话格式构造prompt,符合模型的训练习惯,提升生成质量。

七、相关链接

项目GitHub仓库:https://github.com/deepspeedai/DeepSpeed-MII

八、总结

DeepSpeed-MII是微软DeepSpeed团队打造的一款聚焦于大模型推理部署的开源库,基于DeepSpeed-Inference的底层优化能力构建,以自动化性能优化、极简部署接口为核心,解决了大模型推理落地过程中调优难、部署繁、性能低的痛点,该库无需开发者深入掌握底层优化技术,可根据模型特性与硬件资源自动匹配最优策略,支持本地直连推理与gRPC/RESTful远程服务部署两种模式,全面兼容从几亿到4050亿参数的主流大模型,原生支持多GPU张量并行与多副本负载均衡,能适配从开发调试到工业级生产的全场景推理需求,同时遵循Apache 2.0协议,具备完全的商用自由与二次开发权限,其低门槛、高性能、高灵活性的特点,让不同技术水平的开发者都能快速实现大模型的高效推理部署,是大模型从研发到落地的实用化工具,也为大模型的工业级普及提供了轻量化的解决方案。

版权及免责申明:本文由@人工智能研究所原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/deepspeed-mii.html