DLCM:字节跳动开源的动态大概念模型,自适应语义压缩与高效概念级推理

一、DLCM是什么

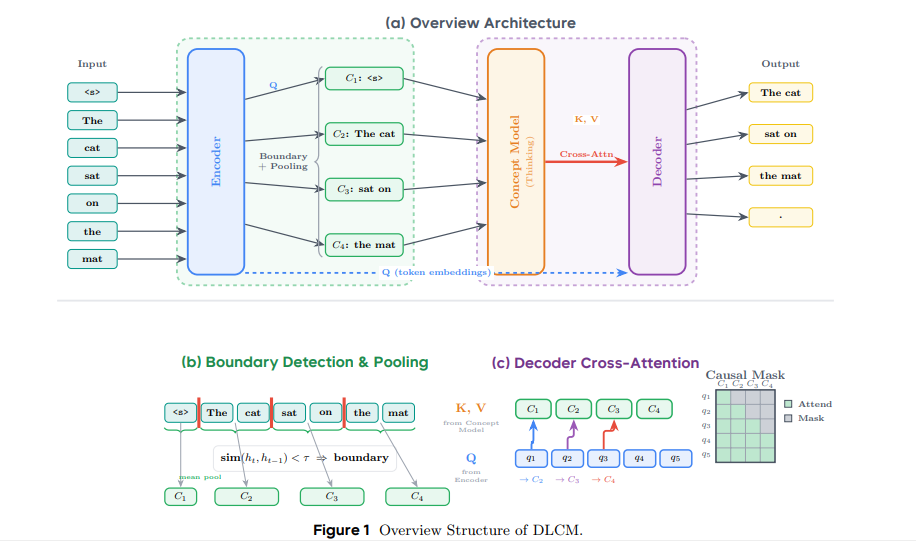

DLCM(动态大概念模型,Dynamic Large Concept Models)是一款开源的分层语言建模框架,由字节跳动、曼彻斯特大学等机构联合研发。它针对传统大型语言模型(LLMs)对所有token均匀分配计算资源的低效问题,提出“token→概念→token”的分层处理流程,通过自动学习语义边界,将变长token序列压缩为语义连贯的“概念”,并在压缩后的概念空间中集中进行深度推理,最终重建token级预测结果。

简单来说,传统LLM像“逐字精读”每一段文字,而DLCM像“抓重点精读+非重点略读”,自动识别语义关键部分并集中算力,既保证推理效果又减少冗余计算,在12个零样本基准测试中平均性能提升2.69%,同时降低34%的计算量(压缩比R=4时)。

二、功能特色

自适应语义分割:无需预定义句子、短语等语言单元,端到端从数据中学习语义边界,自动将token序列划分为变长概念,适配不同领域(文本、代码、数学)的信息密度差异。

高效概念级推理:将70%以上的计算资源集中在高容量概念推理骨干网络,避开冗余token的无效计算,推理类任务性能提升显著(如OpenBookQA提升3.00%、ARC Easy提升2.61%)。

压缩感知与算力优化:支持自定义压缩比R(默认R=4,即平均4个token构成一个概念),通过压缩感知缩放定律实现固定算力下的最优参数分配,推理FLOPs与传统LLM相当但容量更高。

稳定异架构训练:创新解耦μP参数化方案,支持跨模型宽度和压缩机制的零样本超参数迁移,避免异架构训练不稳定问题。

多领域适配性:预训练数据涵盖英文/中文网页、代码、数学等,支持常识推理、代码生成、多语言任务等多场景应用。

三、技术细节

1. 核心架构(四阶段流程)

| 阶段 | 核心操作 | 功能说明 |

|---|---|---|

| 编码(Encoding) | 轻量Transformer处理 | 提取token细粒度表示,为边界检测和解码提供基础 |

| 动态分割(Dynamic Segmentation) | 边界检测+均值池化 | 计算相邻token相似度识别语义断点,将token段压缩为统一概念表示 |

| 概念级推理(Concept-Level Reasoning) | 高容量Transformer运算 | 集中算力在概念序列上进行深度推理,是模型核心计算模块 |

| 解码(Token-Level Decoding) | 因果交叉注意力 | 基于推理后的概念重建token级预测,保证输出连贯性 |

2. 关键技术亮点

边界检测机制:通过计算相邻token投影后的余弦相似度判断语义断点,训练时采用温度锐化采样鼓励探索,推理时用0.5阈值实现高效分割。

全局解析器(Global Parser):通过批次级边界率统计和辅助损失,保证全局压缩比稳定在目标值,同时允许局部内容自适应调整分割粒度。

压缩感知缩放定律:提出公式(L(N, D, R, P)),明确总参数、数据量、压缩比、概念层参数占比的交互关系,为架构设计提供理论指导。

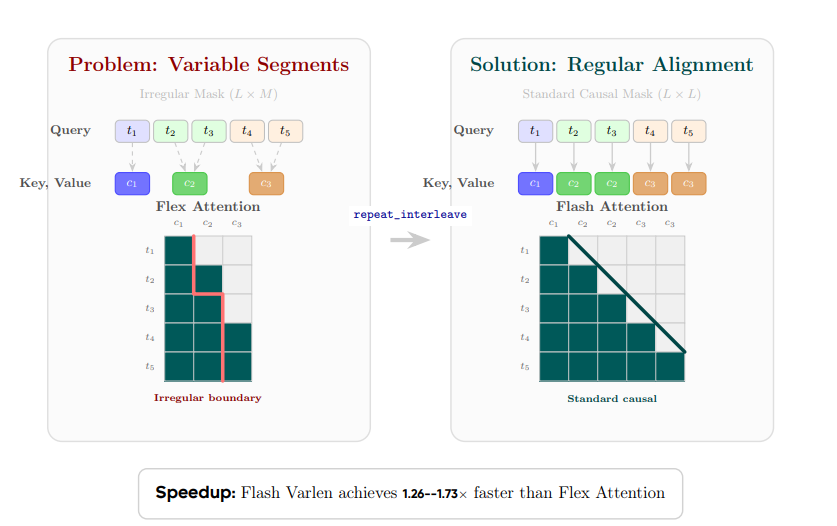

概念复制优化:将概念特征复制适配token长度,使不规则注意力映射转化为硬件友好的标准格式,推理速度比Flex Attention快1.26-1.73倍。

四、应用场景

推理密集型任务:数学解题、逻辑推理、常识问答(如CommonsenseQA、OpenBookQA),模型在语义关键过渡处的算力集中优势明显。

代码生成与理解:结构化代码的语法解析、代码补全,适配代码的高信息密度特性,压缩后推理更高效。

多语言处理:支持英文、中文等多语言文本理解与生成,自适应不同语言的语义结构差异。

长文本处理:长文档摘要、长序列生成,通过概念压缩降低长序列注意力计算成本,提升处理效率。

资源受限场景:边缘设备、低算力环境下的LLM部署,通过压缩冗余计算降低推理成本,兼顾性能与效率。

五、常见问题解答

Q1:DLCM与传统LLM(如LLaMA)的核心区别是什么?

A:核心区别在于计算资源分配方式。传统LLM对所有token均匀分配算力,DLCM通过语义分割将算力集中在概念级(语义关键部分),减少冗余token的计算。例如,对于“简单的日常描述+复杂的逻辑推理”文本,DLCM会压缩日常描述部分,集中算力处理推理部分,既提升推理效果又降低成本。

Q2:DLCM的压缩比R如何选择?

A:压缩比R表示“平均每个概念包含的token数”,R越大压缩程度越高(算力越省但细粒度越弱):

追求速度/低算力:R=8(适合长文本、边缘设备)

平衡性能与效率:R=4(默认配置,适配多数场景)

高精度需求:R=2(适合细粒度文本理解、专业领域任务)

Q3:DLCM在哪些任务上可能表现不佳?

A:在依赖细粒度token级对齐的任务(如句子级蕴涵判断、极性分辨率、文本校对)中可能出现轻微性能退化(如BoolQ任务下降1.47%),这是为提升全局推理能力牺牲局部细粒度精度的合理trade-off。

Q4:DLCM支持中文任务吗?

A:支持。预训练数据包含25%的中文网页文本(MAP-CC数据集,250B tokens),在中文常识推理、文本理解等任务中表现良好,C-Eval基准测试提升1.71%。

六、相关链接

开源代码仓库:待官方发布(基于论文开源承诺,将提供完整实现)

七、总结

DLCM是一款打破传统LLM均匀计算范式的开源分层语言建模框架,通过自适应语义分割、概念级集中推理、压缩感知优化三大核心能力,在降低冗余计算的同时显著提升推理性能,适配多领域、多场景需求。其创新的技术设计(如解耦μP参数化、全局解析器)解决了异架构训练稳定性和自适应压缩等关键问题,提供了从模型架构到工程实现的完整解决方案,是构建高效、高推理能力语言模型的优质开源选择。

版权及免责申明:本文由@AI工具集原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/dlcm.html