FIPO:阿里通义开源的纯RL强化学习框架,突破大模型长文本推理瓶颈

1. FIPO 是什么

FIPO(Future-KL Influenced Policy Optimization,未来KL影响策略优化) 是阿里巴巴通义实验室 Qwen Pilot 团队于2026年3月开源的全新无价值模型(value-free)强化学习算法,核心目标是从干净基座大语言模型中激发更深、更长、更可靠的复杂推理能力。

FIPO 定位为纯强化学习(RL)训练方案,不依赖监督微调(SFT)数据预热、不依赖价值(Critic)模型,仅通过策略优化与可验证奖励机制(ORM),在策略更新中引入折扣未来KL散度(Future-KL),实现从“全局粗粒度奖励分配”到“Token级精细化信用分配”的跨越。

FIPO 基于 VeRL 强化学习框架开发,完整开源训练代码、配置脚本、实验复现流程,支持 Qwen2.5-32B 等主流基座快速接入,核心解决传统 RL(PPO/GRPO/DAPO)中顽固的推理长度停滞与关键Token信用分配模糊两大痛点。

2. 功能特色

2.1 纯RL训练、无额外数据依赖

零SFT预热:直接从干净基座(如 Qwen2.5-32B-Base)启动强化学习,无需指令微调数据

无价值模型:摒弃 PPO 所需 Critic 网络,仅保留策略模型、参考模型、奖励模型(或规则奖励)

轻量化架构:训练流程极简、显存占用更低、工程复杂度显著降低

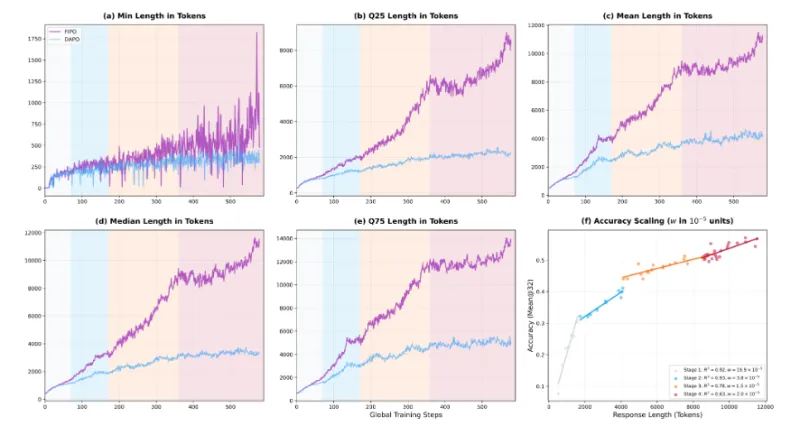

2.2 推理长度突破:4000→10000+ Token

在 Qwen2.5-32B-Base 上,平均思维链(CoT)长度从约4000 Token 提升至10000+ Token,突破传统基线长度天花板

长度增长非冗余填充:FIPO 优化后长推理链逻辑一致性更强、错误率更低、自我修正更频繁

2.3 数学推理性能超越主流模型

AIME 2024 数学竞赛数据集:Pass@1 从50.0%升至峰值58.0%(收敛约56.0%)

32B纯RL设定下超越:OpenAI o1-mini(≈56.0%)、DeepSeek-R1-Zero-Math-32B(≈47.0%)

复杂推理、多步证明、符号运算能力显著增强

2.4 Token级精准信用分配

量化每个 Token 对后续轨迹的因果影响力,强化关键逻辑步、弱化误导性Token

三大稳健机制:软衰减窗口、极端值过滤、影响力权重裁剪,保障训练稳定

2.5 通用适配、易扩展

兼容 VeRL 生态,支持 7B/14B/32B/72B 等主流 LLM 基座

支持数学、代码、科学推理、长文本生成等多任务场景

训练脚本模块化,可快速对接自定义奖励函数、数据集、分布式集群

3. 技术细节

3.1 核心原理:Future-KL 机制

传统 RL(如 GRPO/DAPO)采用全局奖励均匀分配:整条轨迹最终得分相同,无法区分关键Token与冗余Token。

FIPO 创新引入 Future-KL(折扣未来KL散度):

对每个位置 t 的 Token,计算从 t 到序列结束的累积策略偏移(KL散度),并施加指数衰减

Future-KL > 0:Token 引导策略向高奖励轨迹偏移,应强化(加权>1)

Future-KL < 0:Token 引导策略向低奖励轨迹偏移,应弱化(加权<1)

形成稠密优势函数(dense advantage),实现Token级差异化更新

3.2 数学形式(简化)

Future-KL 计算

Future-KL_t = Σ(τ=t+1 to T) γ^(τ-t-1) · KL(π_θ || π_ref | s_τ)

γ:折扣因子(如0.99)

KL:当前策略与参考模型的Token级KL散度

仅关注局部未来(软衰减窗口,约32步),降低远端不确定性影响

Token级权重映射

f_t = clip(exp(α · Future-KL_t), 0.8, 1.2)

α:缩放系数

clip:限制权重范围,防止梯度爆炸

FIPO 损失函数

L_FIPO = -E_t [ f_t · (r_t - β·KL_t) · log(π_θ/π_ref) ]

保留 PPO 裁剪与KL约束,保证训练稳定性

3.3 训练流程

初始化:策略模型π_θ、参考模型π_ref、奖励模型R(或规则)

Rollout:生成多条推理轨迹,计算Token级奖励与KL散度

计算:每条轨迹的 Future-KL、Token权重f_t、优势函数

优化:按 FIPO 损失更新策略,约束KL偏移

迭代:重复多轮直至收敛

3.4 核心技术优势对比(表格)

| 特性 | FIPO | GRPO | DAPO | PPO |

|---|---|---|---|---|

| 价值模型(Critic) | ❌ 无需 | ❌ 无需 | ❌ 无需 | ✅ 必需 |

| 信用分配粒度 | Token级(稠密) | 轨迹级(全局) | 轨迹级(全局) | 轨迹级(全局) |

| 推理长度上限 | 10000+ Token | ~4000 Token | ~4000 Token | ~4000 Token |

| 纯RL性能(AIME2024) | 58.0% | ~52% | ~50% | ~51% |

| 训练稳定性 | 高(三重稳健机制) | 中 | 高 | 中 |

| 显存开销 | 中 | 中 | 低 | 高 |

| 工程复杂度 | 低 | 中 | 低 | 高 |

4. 应用场景

4.1 数学与科学推理

奥数、AIME/IMO、高等数学、物理公式推导、化学方程式、定理证明

长步骤、多分支、符号运算、自我校验场景

4.2 代码与程序理解

复杂算法实现、长代码生成、代码调试、逆向工程、多语言混合代码

要求严密逻辑、依赖追踪、边界条件处理

4.3 长文本深度创作

学术论文、技术报告、长篇小说、剧本、多章节内容

保持全局一致性、逻辑连贯、细节丰富

4.4 专业领域问答

法律案例分析、医疗诊断推理、金融建模、工程计算

多条件约束、证据链构建、风险评估

4.5 基座模型能力激发

从干净基座直接强化学习,不污染预训练知识、保留泛化能力

适合企业私有基座、垂直领域模型二次升级

5. 使用方法

5.1 环境准备

克隆仓库

git clone https://github.com/qwenpilot/FIPO.git cd FIPO

安装依赖(基于VeRL)

pip install -e . # 或按VeRL官方指南安装:https://verl.readthedocs.io/en/latest/start/install.html

集群配置:支持单机多卡、分布式多机,配置

torchrun/slurm脚本

5.2 快速启动(32B示例)

# 进入FIPO训练脚本目录 cd recipe/fipo # 启动Qwen2.5-32B纯RL训练 bash run_fipo_qwen2.5_32b.sh

5.3 核心配置文件(关键参数)

# 训练超参 gamma = 0.99 # Future-KL折扣因子 alpha = 0.1 # 权重缩放系数 clip_range = (0.8, 1.2) # 权重裁剪范围 kl_coeff = 0.02 # KL约束系数 seq_len = 16384 # 最大序列长度 rollout_batch_size = 1024

5.4 模型导出与推理

训练完成后导出 Hugging Face 格式权重,直接用 transformers 加载推理:

from transformers import AutoModelForCausalLM, AutoTokenizer

model = AutoModelForCausalLM.from_pretrained("QwenPilot/FIPO_32B")

tokenizer = AutoTokenizer.from_pretrained("QwenPilot/FIPO_32B")

# 长推理示例

prompt = "证明:当n为大于2的整数时,xⁿ+yⁿ=zⁿ无正整数解。请给出详细步骤。"

inputs = tokenizer(prompt, return_tensors="pt").to("cuda")

outputs = model.generate(**inputs, max_new_tokens=10000, temperature=0.7)

print(tokenizer.decode(outputs[0], skip_special_tokens=True))6. 竞品对比

6.1 FIPO vs GRPO(Group Relative Policy Optimization)

GRPO:组内相对奖励、无Critic、全局均匀分配、长度上限≈4000 Token

FIPO:在GRPO框架上升级,加入Future-KL、Token级加权、长度突破10000+、AIME高6~8个点

6.2 FIPO vs DAPO(Direct Advantage Policy Optimization)

DAPO:纯RL、无Critic、简单优势估计、稳定性高但性能上限低

FIPO:保留DAPO稳定性,新增稠密优势、长度与精度双提升、复杂推理更强

6.3 FIPO vs PPO(Proximal Policy Optimization)

PPO:经典RL、需Critic、显存高、工程复杂、长度瓶颈明显

FIPO:无Critic、显存更低、更易部署、长度与精度显著超越PPO基线

6.4 FIPO vs 闭源模型(o1-mini)

o1-mini:闭源、训练细节未知、依赖大量SFT与人类反馈

FIPO:开源、纯RL、32B规模、AIME性能持平/超越o1-mini、可完全私有化部署

7. 常见问题解答(FAQ)

FIPO 必须用 Qwen2.5-32B 吗?

不是。FIPO 基于 VeRL 框架,支持 7B/14B/32B/72B 等主流 LLM 基座,只需修改配置文件中的模型路径与参数规模即可适配。

训练 FIPO 需要多少显存?

32B模型训练:单机8卡A100(80GB)或H100,混合精度(BF16),最小显存约64GB/卡;7B模型可在单卡A100(40GB)运行。

FIPO 训练速度如何?

32B模型:每轮迭代(1k样本)约30分钟;AIME 2024收敛约需5080轮,总训练时间23天(8卡A100)。

FIPO 会出现奖励作弊(reward hacking)吗?

概率极低。三重机制保障:Future-KL 约束策略偏移、KL惩罚限制分布变化、权重裁剪防止极端更新,实验中未出现明显奖励作弊。

FIPO 生成内容更长,但质量会下降吗?

不会。FIPO 优化的是有效推理长度,长文本逻辑一致性、准确率、自我修正能力均显著提升,无冗余膨胀问题。

可以用规则奖励代替奖励模型吗?

可以。FIPO 支持自定义奖励函数(如代码执行结果、数学答案匹配、格式校验),纯规则奖励也能稳定训练并获得良好效果。

FIPO 与传统SFT相比有什么优势?

SFT依赖大量高质量指令数据,易过拟合、泛化差;FIPO纯RL、无数据依赖、深度推理与长文本能力更强、基座知识保留更完整。

如何复现论文中的实验结果?

仓库提供完整复现脚本、数据集链接、超参配置,直接运行 recipe/fipo/run_fipo_qwen2.5_32b.sh 即可复现 AIME 2024 58% 准确率。

8. 相关链接

GitHub 仓库:https://github.com/qwenpilot/FIPO

Hugging Face 模型:https://huggingface.co/QwenPilot/FIPO_32B

ModelScope 模型:https://modelscope.cn/models/qwenpilot/FIPO_32B

9. 总结

FIPO 作为阿里通义实验室 Qwen Pilot 团队开源的无价值模型强化学习方案,通过创新引入 Future-KL 机制实现 Token 级精细化信用分配,在纯 RL 训练设定下成功突破大语言模型长期存在的推理长度停滞瓶颈,将 Qwen2.5-32B 基座的平均思维链长度从约 4000 Token 大幅提升至 10000+ Token,同时在 AIME 2024 数学推理任务上实现 50.0% 到 58.0% 的准确率跃升,性能超越同规模的 DeepSeek-R1-Zero-32B 与 OpenAI o1-mini 模型。FIPO 具备无需 SFT 数据、无需价值模型、训练稳定、显存高效、工程简洁等优势,全面兼容主流大模型基座与多任务场景,不仅为数学、代码、科学推理等复杂任务提供了高效训练方案,也为大模型深度推理能力激发开辟了全新技术路径,其完全开源的特性更让私有化部署与二次创新变得简单可行,是当前大语言模型强化学习领域极具代表性与实用性的前沿技术成果。

版权及免责申明:本文由@dotaai原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/fipo.html