FireRedASR2S:小红书开源的工业级一站式语音识别系统

一、FireRedASR2S是什么

FireRedASR2S是FireRedTeam(小红书智能创作基础技术团队) 于2026年2月正式开源的SOTA(业界领先)工业级一体化语音识别系统,名称中“2S”代表第二代FireRedASR升级为全功能语音系统(System)。它不是单一的语音识别模型,而是将ASR语音识别、VAD语音活动检测、LID口语语言识别、Punc标点预测四大模块深度整合的一站式解决方案,所有模块均在公开基准测试中达到SOTA水平,可独立使用也可协同工作,支持本地私有化部署,无外部API依赖,兼顾高精度、高效率与工程化可用性。

FireRedASR2S面向真实产业场景设计,核心解决传统语音系统方言识别差、多语言切换难、无自动标点、端到端链路长、部署复杂、隐私不安全等痛点,专为中文环境优化,覆盖普通话、20余种汉语方言/口音、英语、中英混读、歌唱歌词等复杂语音场景,识别精度、鲁棒性、处理效率均达到工业级标准,既可用于二次开发集成,也可直接用于生产环境。

该项目完全开源,提供模型权重、推理代码、部署脚本、示例程序,遵循宽松开源协议,支持学术研究与商业使用,是目前中文语音领域功能最完整、精度最高、工程化最成熟的开源一体化语音系统之一。

二、功能特色

1. 四大SOTA模块一体化,开箱即用

FireRedASR2S最核心的特色是全链路语音能力集成,无需组合多个第三方工具,单一套系统完成从音频输入到带标点、带语种、带时间戳的文本输出,四大模块均为自研并达到SOTA:

FireRedASR2:核心语音识别,支持普通话、20+方言/口音、英语、中英混读、歌词识别,输出字级别时间戳与置信度;

FireRedVAD:语音活动检测,支持100+语言的语音/歌唱/音乐检测,流式/非流式兼容,支持音频事件检测;

FireRedLID:口语语言识别,支持100+语言、20+汉语方言/口音,自动判断语音语种;

FireRedPunc:中英双语标点预测,自动为纯文本输出添加逗号、句号、问号等标点,可读性大幅提升。

2. 超广语言与场景覆盖,中文场景极致优化

系统对中文语音的支持广度与深度远超通用开源模型:

汉语:普通话 + 20+方言/口音(粤语、四川话、上海话、闽南语、河南话、湖南话、河北话等);

外语:英语、中英混说;

特殊场景:歌唱歌词识别(opencpop测试集CER低至1.12%);

音频类型:清晰语音、会议语音、对话语音、带噪语音、流式语音均稳定适配。

3. 行业顶尖识别精度,全面超越主流方案

FireRedASR2在24个公开测试集(4个普通话+19个方言+1个歌唱)上全面领先,核心指标如下:

| 测试场景 | FireRedASR2-LLM | FireRedASR2-AED | 对比方案最优值 |

|---|---|---|---|

| 普通话平均CER | 2.89% | 3.05% | 3.69%(Doubao-ASR) |

| 方言平均CER | 11.55% | 11.67% | 11.85%(Qwen3-ASR) |

| 全场景平均CER | 9.67% | 9.80% | 10.12%(Qwen3-ASR) |

FireRedVAD的F1值达97.57%,优于Silero-VAD、FunASR-VAD;FireRedLID准确率97.18%,超越Whisper、SpeechBrain-LID;FireRedPunc的F1值78.90%,大幅领先FunASR-Punc的62.77%。

4. 双架构设计,兼顾极致性能与高效推理

FireRedASR2提供两种架构版本,满足不同场景需求:

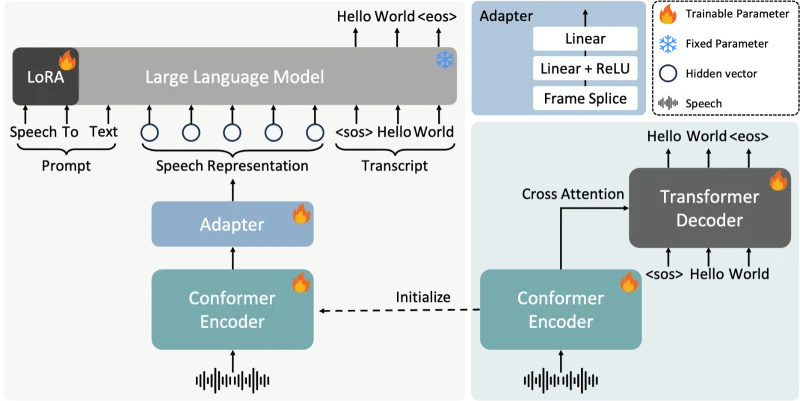

FireRedASR2-LLM:Encoder-Adapter-LLM架构,追求极致识别精度,适合对准确率要求极高的场景;

FireRedASR2-AED:注意力编码解码架构,平衡精度与计算效率,支持词级时间戳,可作为LLM语音模型的表征模块,更适合端侧与实时场景。

5. 高性能推理加速,单卡提速12.7倍

项目已支持TensorRT-LLM推理加速(NVIDIA官方贡献),在单张H20显卡上,FireRedASR2-AED相比PyTorch基线实现12.7倍推理提速,实时性大幅提升,满足高并发、低延迟的工业场景需求。

6. 丰富输出与灵活处理模式

输出信息:文本、语种、置信度、字级别时间戳、语音片段时间戳;

处理模式:支持流式(实时)与非流式(离线)处理;

音频事件:可检测语音、歌唱、音乐三类事件;

格式兼容:支持标准16kHz 16bit单声道PCM音频,可通过FFmpeg快速转换常见格式。

7. 完全开源可私有化,安全无依赖

所有模型权重、推理代码、脚本全部开源;

无外部API调用,本地离线运行,数据隐私安全;

环境配置简单,依赖清晰,支持Linux/Windows/macOS多平台。

三、技术细节

1. 整体系统架构

FireRedASR2S采用模块化松耦合架构,四大核心模块可独立调用,也可通过系统封装类一键完成全流程处理:

音频输入 → FireRedVAD(切分有效语音) → FireRedLID(判断语种) → FireRedASR2(转文字) → FireRedPunc(加标点) → 带格式文本输出;

每个模块均独立封装,可单独集成到其他项目中,未来将进一步拆分为独立开源库。

2. 核心模块技术原理

(1)FireRedASR2

基于FireRedASR升级版,优化编码器与语言模型适配;

LLM版:Encoder-Adapter-LLM框架,利用大语言模型提升语义理解与纠错能力;

AED版:Attention Encoder-Decoder架构,轻量化高效,支持时间戳与置信度;

训练数据覆盖海量普通话、方言、英语、混读、歌唱数据,泛化性极强。

(2)FireRedVAD

基于DFSMN(深度前馈序列记忆网络)架构;

同时支持流式与非流式检测,低延迟、高召回;

可区分语音、歌唱、音乐三种音频事件,适用于复杂音频内容分析。

(3)FireRedLID

基于FireRedASR2的表征能力构建;

直接从语音频谱识别语种与方言,无需先转文字;

支持100+语言与20+汉语方言,单模型多分类。

(4)FireRedPunc

基于BERT架构的标点预测模型;

专门针对ASR输出的无标点文本优化;

同时支持中文与英文标点,F1值领先业界。

3. 输入输出规范

音频格式:16kHz、16bit、单声道、PCM WAV;

最大时长:AED版支持≤60s,超过200s会出现位置编码错误;LLM版支持≤30s;

输出字段:语音时间戳、语种、语种置信度、识别文本、字级别时间戳、文本置信度、标点文本。

4. 部署与加速技术

原生PyTorch推理,兼容CPU/GPU;

支持TensorRT-LLM加速,显著降低推理时延;

提供命令行工具、Python API、批量处理脚本三种调用方式;

环境要求Python 3.10,依赖库在requirements.txt中完整列出。

四、应用场景

1. 智能办公与会议

会议录音实时转写,支持多方言、中英混读;

自动生成带标点、分角色的会议纪要;

离线部署,保障企业会议数据隐私。

2. 智能客服与呼叫中心

客服语音实时转文字,用于质检、存档、关键词提取;

方言口音友好,覆盖全国各地区用户;

低延迟流式识别,配合对话系统实时交互。

3. 语音交互与智能硬件

智能音箱、车载语音、手机助手的语音入口;

本地离线识别,无网络也可使用;

支持实时打断与流式输出。

4. 内容创作与媒体处理

播客、短视频、直播音频自动转字幕;

歌唱音频自动识别歌词,效率远超人工;

多语言内容自动标注语种,方便后期处理。

5. 方言保护与语言研究

方言语音数字化转写,助力方言保护;

支持20+方言高精度识别,研究级精度;

自动判断方言类型,降低标注成本。

6. 音频内容审核与分析

语音内容关键词检索、敏感信息检测;

自动区分语音/歌唱/音乐,适配内容分类;

私有化部署,满足合规要求。

7. 教育与学习

口语作业自动转写、发音评估;

多语言学习材料语音转文字;

方言教学音频自动字幕。

五、使用方法

1. 环境准备

创建Python 3.10环境(推荐Conda)

conda create --name fireredasr2s python=3.10 conda activate fireredasr2s

克隆代码仓库

git clone https://github.com/FireRedTeam/FireRedASR2S.git cd FireRedASR2S

安装依赖

pip install -r requirements.txt export PATH=$PWD/fireredasr2s/:$PATH export PYTHONPATH=$PWD/:$PYTHONPATH

2. 模型下载

支持ModelScope(国内推荐)与Hugging Face两种渠道:

ModelScope下载

pip install -U modelscope modelscope download --model xukaituo/FireRedASR2-AED --local_dir ./pretrained_models/FireRedASR2-AED modelscope download --model xukaituo/FireRedVAD --local_dir ./pretrained_models/FireRedVAD modelscope download --model xukaituo/FireRedLID --local_dir ./pretrained_models/FireRedLID modelscope download --model xukaituo/FireRedPunc --local_dir ./pretrained_models/FireRedPunc

Hugging Face下载

pip install -U "huggingface_hub[cli]" huggingface-cli download FireRedTeam/FireRedASR2-AED --local-dir ./pretrained_models/FireRedASR2-AED huggingface-cli download FireRedTeam/FireRedVAD --local-dir ./pretrained_models/FireRedVAD huggingface-cli download FireRedTeam/FireRedLID --local-dir ./pretrained_models/FireRedLID huggingface-cli download FireRedTeam/FireRedPunc --local-dir ./pretrained_models/FireRedPunc

3. 音频格式转换

所有音频需转为16kHz 16bit单声道WAV:

ffmpeg -i 输入音频路径 -ar 16000 -ac 1 -acodec pcm_s16le -f wav 输出wav路径

4. 快速推理(全流程一体化)

直接调用ASR System接口,自动完成VAD+LID+ASR+Punc:

python examples_infer/asr_system/inference_system.py

输出结果包含:语音时间段、语种、识别文本、置信度、字时间戳、带标点文本。

5. 模块独立使用

ASR单独调用:examples_infer/asr/

VAD单独调用:examples_infer/vad/

LID单独调用:examples_infer/lid/

Punc单独调用:examples_infer/punc/

6. TensorRT-LLM加速部署

项目已支持TensorRT-LLM加速,适用于需要极致性能的生产环境,具体部署脚本与配置在runtime/triton_tensorrt/目录下,单卡推理速度提升12.7倍。

六、常见问题解答(一问一答)

FireRedASR2S支持哪些音频格式?

FireRedASR2S只支持16kHz、16bit、单声道的PCM WAV格式,其他格式(MP3、M4A、OGG、FLAC等)可以用FFmpeg一键转换为标准格式。

音频输入最长支持多长时间?

FireRedASR2-AED版本最长支持60秒,超过60秒可能出现幻觉,超过200秒会触发位置编码错误;FireRedASR2-LLM版本最长支持30秒,更长时长未做测试,不建议使用。

必须同时使用四个模块吗?可以单独用其中一个吗?

不需要同时使用,四个模块完全独立,可以单独调用任意模块,比如只使用VAD做语音切分,或只使用Punc做标点预测。

FireRedASR2S支持Windows/macOS系统吗?

支持,项目基于Python与PyTorch开发,兼容Linux、Windows、macOS系统,只需正确配置Python环境与依赖即可运行。

需要GPU才能运行吗?CPU可以用吗?

CPU可以运行,只是推理速度较慢;推荐使用NVIDIA GPU,支持CUDA加速,也支持TensorRT-LLM进一步提速。

支持实时流式语音识别吗?

支持,FireRedVAD提供流式检测接口,FireRedASR2-AED也支持流式推理,可用于实时语音交互场景。

支持哪些方言和口音?

支持粤语、四川话、上海话、闽南语、安徽话、福建话、甘肃话、贵州话、河北话、河南话、湖北话、湖南话、江西话、辽宁话、宁夏话、陕西话、山西话、山东话、天津话、云南话等20余种汉语方言/口音。

识别结果带时间戳吗?

带,FireRedASR2输出字级别时间戳(每个字的开始与结束时间),VAD输出语音片段时间戳,方便做字幕、对齐、剪辑等。

可以商用吗?开源协议是什么?

项目开源,可用于学术研究与商业使用,具体协议以仓库LICENSE文件为准,允许私有化部署与二次开发。

模型文件很大吗?下载慢怎么办?

模型为工业级轻量化设计,大小适中;国内用户推荐使用ModelScope下载,速度更快、更稳定。

为什么识别结果没有标点?

需要开启FireRedPunc模块,一体化System接口默认会自动添加标点;单独使用ASR时输出纯文本,需手动调用Punc模块添加标点。

带噪音的音频识别效果如何?

模型在训练时加入了大量带噪数据,具备一定的噪声鲁棒性;噪音过大时建议先做音频降噪处理,再输入ASR可提升精度。

七、相关链接

FireRedASR2S GitHub仓库主页:https://github.com/FireRedTeam/FireRedASR2S

FireRedTeam 官方主页:https://fireredteam.github.io

FireRedASR2-AED Hugging Face地址:https://huggingface.co/FireRedTeam/FireRedASR2-AED

FireRedVAD Hugging Face地址:https://huggingface.co/FireRedTeam/FireRedVAD

FireRedLID Hugging Face地址:https://huggingface.co/FireRedTeam/FireRedLID

FireRedPunc Hugging Face地址:https://huggingface.co/FireRedTeam/FireRedPunc

FireRedASR2 ModelScope地址:https://www.modelscope.cn/models/xukaituo/FireRedASR2-AED/

FireRedVAD ModelScope地址:https://www.modelscope.cn/models/xukaituo/FireRedVAD/

FireRedLID ModelScope地址:https://www.modelscope.cn/models/xukaituo/FireRedLID/

FireRedPunc ModelScope地址:https://www.modelscope.cn/models/xukaituo/FireRedPunc/

八、总结

FireRedASR2S是小红书智能创作基础技术团队面向产业场景开源的一站式、高精度、全功能工业级语音识别系统,将ASR、VAD、LID、Punc四大SOTA模块融为一体,针对中文普通话、20余种方言/口音、中英混读及歌唱场景做了深度优化,在公开测试集上全面超越主流开源与商用方案,同时提供双架构选择与TensorRT-LLM推理加速,支持离线私有化部署、流式/非流式处理、字级别时间戳输出,环境配置简单、调用方式灵活,可广泛应用于会议转写、智能客服、语音交互、内容创作、方言保护、音频分析、教育教学等场景,是目前中文语音领域最具实用价值的开源一体化语音系统之一,为企业与开发者提供了无需依赖外部服务、安全可控、高精度高效率的语音处理解决方案。

版权及免责申明:本文由@AI工具箱原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/fireredasr2s.html