FramePack:开源低显存AI长视频生成工具,长视频抗漂移与上下文压缩

一、FramePack是什么

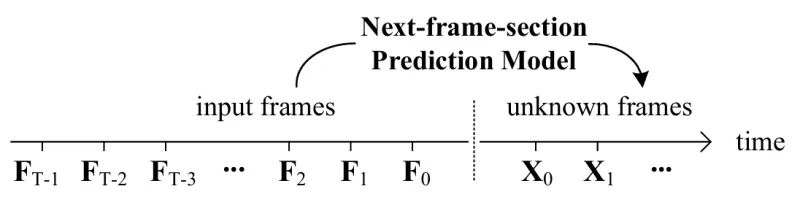

FramePack是一款面向下一帧/下一帧段预测的视频扩散模型开源实现,由斯坦福大学学者、知名AI项目ControlNet的作者Lvmin Zhang(张吕敏)主导研发,核心解决传统视频扩散模型在长视频生成中显存爆炸、内容漂移、时序遗忘、训练低效四大痛点。

该项目以“让视频扩散变得实用”为目标,通过帧上下文打包(Frame Context Packing)与抗漂移采样(Drift Prevention)两大原创技术,将任意长度的视频帧上下文压缩为固定长度,使生成负载不再随视频时长线性增长,最终实现:消费级GPU(6GB显存)即可流畅运行13B大模型,生成长达60–120秒的30fps高清视频。

FramePack同时支持图生视频(Image2Video)与文生视频(Text2Video),提供开箱即用的Gradio可视化界面,兼顾普通创作者的易用性与AI研究者的可扩展性,是当前开源社区中少有的、真正能在个人电脑上稳定生成高质量长视频的AI框架。

二、功能特色

1. 极致显存优化,6GB显存即可生成长视频

FramePack最具颠覆性的能力,是将视频生成的显存门槛从数十GB降至6GB。

支持13B参数视频扩散模型在笔记本/桌面端RTX 3060/3070Ti/4060等消费级显卡运行。

生成1分钟30fps(1800帧)视频全程稳定占用不超限。

显存占用与视频长度无关,突破传统模型“越长越吃显存”的瓶颈。

2. 强抗漂移+抗遗忘,长视频内容高度一致

传统视频扩散生成超过50帧后,常出现人物变脸、场景崩坏、颜色偏移、动作断裂等“漂移”问题。FramePack通过原创抗漂移方案彻底解决:

逆时序生成:从终点帧倒推中间帧,避免误差累积。

双向上下文参考:同时保留近端与远端关键帧信息。

历史离散化与计划性抗漂移(P1版本):纯文生视频也能保持全程稳定。

长视频生成1000+帧仍保持人物、物体、场景高度一致。

3. 训练效率接近图像扩散,支持超大Batch Size

传统视频扩散训练Batch Size极低、速度慢、成本高。FramePack通过固定长度上下文压缩:

训练Batch Size可提升至图像扩散同级水平。

单8卡A100/H100节点可支持Batch Size=64微调13B模型。

可直接微调现有视频扩散模型并提升画质。

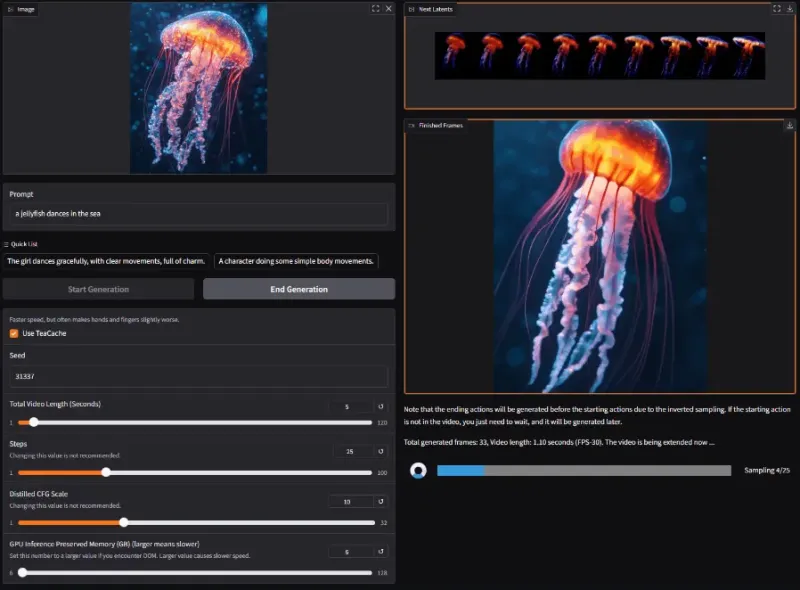

4. 渐进式生成+实时预览,边生成边看结果

FramePack采用逐帧/逐段预测生成,而非全视频一次性推理:

生成过程实时预览,可随时观察画面变化。

每段生成后自动保存,无需等待全部完成。

支持中途调整参数、中断重生成,提升创作效率。

5. 开箱即用Gradio界面,零代码快速上手

项目提供完整Web UI:

支持上传单图/首帧+提示词生成视频。

可调节分辨率、时长、帧率、步数、CFG、TeaCache加速。

支持视频导出MP4,内置画质压缩控制。

6. 跨平台兼容,Windows/Linux均可运行

支持NVIDIA RTX 30XX/40XX/50XX系列GPU。

支持FP16/BF16混合精度。

官方提供Windows一键整合包,Linux支持pip手动部署。

7. 开源免费,Apache 2.0协议可商用

项目完全开源,允许个人学习、二次开发、商业使用,无高额API费用,适合工作室、企业私有化部署。

三、技术细节

FramePack的核心竞争力来自底层技术创新,而非简单的模型封装。以下为通俗易懂的技术解析。

1. 核心问题:视频生成的“遗忘-漂移困境”

传统视频扩散模型存在无法回避的矛盾:

遗忘:视频越长,模型越记不住早期画面。

漂移:逐帧迭代生成导致误差不断累积,画面崩坏。

增强记忆会加剧漂移,抑制漂移会削弱记忆。FramePack是业内首个同时解决这两个问题的通用架构。

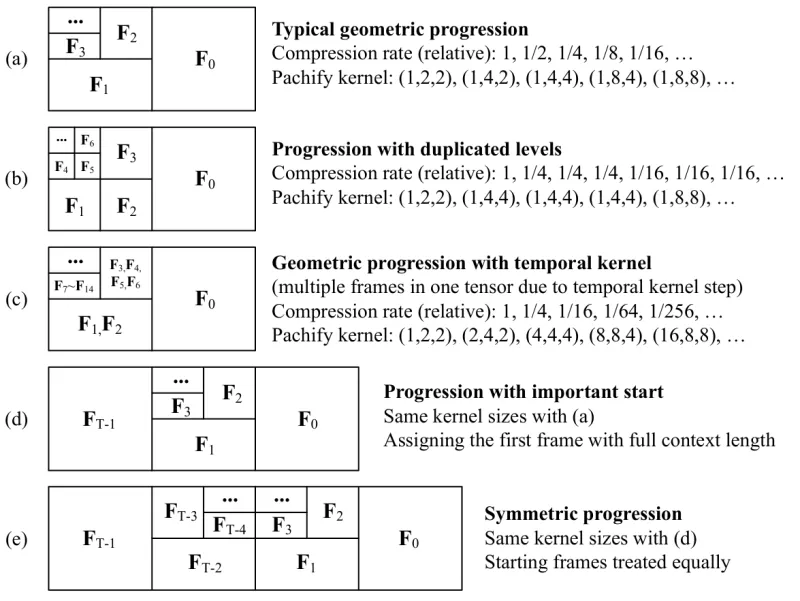

2. 核心技术1:固定长度帧上下文压缩

这是FramePack最底层的创新:

将输入的所有历史帧按重要性加权压缩。

近帧高保真保留,远帧深度压缩。

最终输入Transformer的上下文长度固定不变,与视频时长无关。

计算量、显存占用被“锁死”,实现任意长视频生成。

3. 核心技术2:抗漂移采样策略

官方论文提出三种抗漂移机制:

逆时间顺序生成

先生成结尾,再倒推生成中间帧,阻断误差正向累积。端点固定与双向约束

首尾帧作为锚点,中间帧同时参考前后上下文,像“双向导航”校准画面。离散化历史记忆

将连续帧转为关键帧记忆,减少冗余信息,提升一致性。

4. 模型架构与依赖栈

FramePack基于HunyuanVideo视频扩散模型构建,依赖栈清晰:

PyTorch

HuggingFace Diffusers/Transformers

CLIP/Siglip视觉编码器

Gradio

OpenCV、 Pillow等图像处理库

5. 速度与性能指标(官方实测)

| 硬件 | 未优化速度 | TeaCache加速后 |

|---|---|---|

| RTX 4090 | 2.5秒/帧 | 1.5秒/帧 |

| 笔记本RTX 3060/3070Ti | 10–20秒/帧 | 6–12秒/帧 |

生成10秒视频(300帧):4090约7.5分钟。

生成60秒视频(1800帧):4090约45分钟。

显存占用全程稳定在6GB左右。

6. 版本迭代

FramePack-F1:基础版,图生视频为主,核心上下文压缩。

FramePack-P1:进阶版,强化纯文生视频抗漂移能力。

7. 内存管理机制

项目内置自研显存调度模块:

动态加载/卸载模型权重。

自动分配显存、避免OOM。

低显存设备也能稳定运行大模型。

四、应用场景

1. 短视频/内容创作

静态海报/插画→动态短视频。

人物照片→自然动作动画。

游戏CG、动漫、影视二创。

2. 教育与演示

教学图表→步骤讲解动画。

产品说明书→动态演示视频。

课程PPT→自动生成讲解短片。

3. 广告与营销

商品图→360°旋转展示视频。

品牌海报→动态广告短片。

低成本批量生成营销素材。

4. 动画与影视预演

动画分镜→动态预览。

影视概念图→场景动态演示。

独立动画师轻量化生产。

5. 游戏开发

角色静图→动作预览。

场景概念→动态氛围视频。

快速产出宣传素材。

6. AI研究与二次开发

视频扩散模型轻量化研究。

长视频生成、时序一致性算法研究。

私有化视频生成服务搭建。

五、使用方法

1. 环境要求

GPU:NVIDIA RTX 30XX/40XX/50XX ≥6GB显存。

系统:Windows 10+/Linux。

驱动:支持CUDA 12.1+。

Python:3.10–3.11。

2. Windows一键部署(推荐)

下载官方整合包:framepack_cu126_torch26.7z。

解压到无中文路径文件夹。

运行update.bat更新依赖。

运行run.bat启动Gradio界面。

浏览器打开http://localhost:7860。

3. Linux手动部署

# 安装PyTorch(CUDA 12.6) pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu126 # 克隆仓库 git clone https://github.com/lllyasviel/FramePack.git cd FramePack # 安装依赖 pip install -r requirements.txt # 启动GUI python demo_gradio.py

4. 基本使用流程

上传一张图片作为首帧。

输入英文提示词,描述动作与场景。

设置视频时长、分辨率、帧率。

选择是否开启TeaCache加速。

点击生成,实时预览画面。

完成后自动导出MP4。

5. 提示词写法建议

官方推荐简洁、动作明确的描述:

结构:主体 + 动作 + 风格/画质

示例:

The girl dances gracefully, with clear movements, full of charm.

The man runs fast, realistic, high detail, smooth motion.

六、常见问题解答

FramePack必须使用NVIDIA显卡吗?

是的,目前仅支持NVIDIA RTX 30/40/50系列GPU,不支持AMD、Intel核显或Apple Silicon。

6GB显存真的能跑吗?会崩溃吗?

可以稳定运行。官方已在3060 6GB、3070Ti 8GB等显卡上完成测试,生成1分钟视频不会OOM。

生成视频最长能到多少秒?

官方支持最长120秒(2分钟),30fps,共3600帧,显存仍保持稳定。

生成速度太慢怎么办?

可开启TeaCache加速,速度提升约40%;同时降低分辨率、步数、时长,或使用更高规格显卡。

纯文生视频效果不如图生视频?

FramePack-F1更擅长图生视频;P1版本强化了文生视频抗漂移能力,可升级体验。

支持中文提示词吗?

官方模型基于英文训练,中文效果不稳定,建议使用英文提示词。

可以商用吗?

可以,项目采用Apache-2.0开源协议,允许商业使用,需保留版权声明。

生成的视频有水印吗?

无水印、无内置logo,完全干净输出。

为什么画面会出现闪烁或抖动?

通常是提示词不清晰、步数过低、CFG scale不合理导致,适当增加步数、调低CFG可改善。

如何提高视频画质?

提高采样步数、关闭TeaCache、提高分辨率、使用更精准的提示词、增强参考图质量。

Windows启动报错缺少CUDA/CUDNN?

请使用官方整合包,已内置完整CUDA 12.6环境,无需手动安装。

模型文件自动下载失败怎么办?

可手动从HuggingFace下载lllyasviel/FramePack_F1_I2V_HY_20250503,放入模型目录。

七、相关链接

八、总结

FramePack是ControlNet作者Lvmin Zhang推出的革命性开源视频扩散框架,以固定长度上下文压缩与抗漂移采样为核心技术,彻底解决长视频生成中的显存爆炸、内容漂移、时序遗忘等难题,实现仅6GB消费级GPU即可稳定生成1–2分钟高清视频,同时支持图生视频与文生视频,提供开箱即用的Gradio界面与完善的开发接口,兼顾普通创作者的易用性与研究者的可扩展性,凭借低门槛、高效率、高一致性、开源免费等优势,成为当前AI视频生成领域极具实用价值的轻量化解决方案。

版权及免责申明:本文由@AI工具箱原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/framepack.html