FrankenMotion:开源部位级人体运动生成与合成框架,精准控制细粒度异步运动

一、FrankenMotion是什么

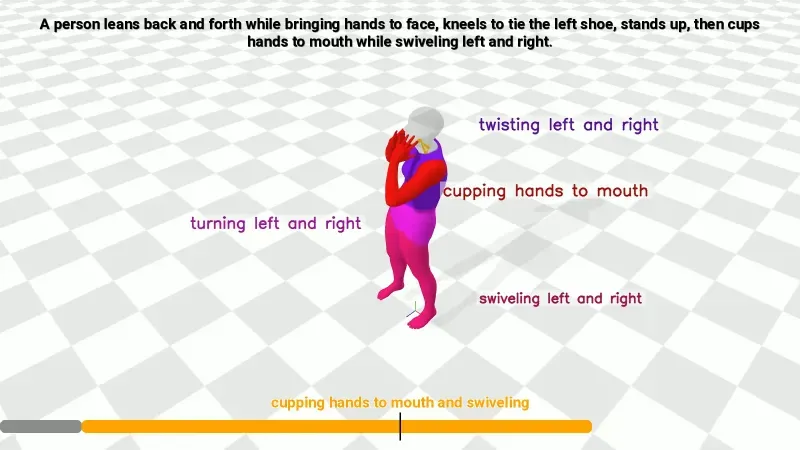

FrankenMotion本质上是一款开源的部位级人体运动生成与合成框架,核心功能是通过自然语言文本描述,精准控制人体每个部位的运动,实现各部位异步、独立的运动生成与组合,简单来说,就是“用文字给人体每个部位发指令,让它们按照我们想要的方式、在想要的时间动起来”。

我们日常接触的3D角色运动,不管是动画里的人物走路,还是游戏里的角色攻击,大多是“整体同步运动”——比如“走路”这个指令,会让角色的四肢、躯干同时配合运动,无法单独控制“左手挥手的同时,右腿保持不动”这种细粒度场景。而FrankenMotion的核心突破,就是打破了这种限制,它能让我们单独控制头部、躯干、左臂、右臂、左腿、右腿等每个部位的运动,还能让这些部位的运动不同步,比如“先让左手挥2秒,再让右腿踏步1秒,同时让头部轻微点头”,这也是它和传统运动生成工具最本质的区别。

这款项目由德国图宾根AI中心、马克斯·普朗克信息学研究所的Coral79团队开发并开源,目前相关论文已提交至arXiv,核心代码、模型权重和专属数据集仍在筹备发布中,我们可以先克隆项目仓库了解基础框架,后续等待核心资源发布后即可直接使用。

从定位来看,FrankenMotion兼顾了“易用性”和“技术深度”:对初学者来说,不需要深入理解复杂的扩散模型原理,只要会写简单的文本提示、懂基础的Python编程,就能快速生成想要的部位级运动;对资深开发者和研究者来说,项目的技术架构清晰、可扩展性强,支持自定义部位拆分、微调模型参数,能满足更复杂的二次开发和研究需求。

它的核心价值在于,填补了“文本驱动细粒度部位运动生成”的开源空白——在此之前,绝大多数开源运动生成工具都只能实现整体运动控制,而FrankenMotion通过自主构建的Frankenstein数据集和创新的部位感知模型,让普通人也能轻松创作复杂的异步部位运动,大大降低了3D角色运动创作的门槛。

二、功能特色

FrankenMotion的功能特色可以概括为“细粒度、异步化、可组合、好上手”,核心围绕“部位级控制”展开,相比传统文本驱动人体运动生成工具,它的优势非常突出,我们从核心功能和独特亮点两个方面,结合表格对比,让大家看得更直观。

2.1 核心功能

(1)部位级文本驱动运动生成

这是FrankenMotion最核心的功能,简单来说,就是“给每个身体部位单独写运动指令”。我们不需要再写“一个人挥手走路”这种整体指令,而是可以精准到每个部位,比如:“左臂:缓慢从身体左侧抬起至胸前,再缓慢放下,重复2次;右腿:向前踏步,膝盖弯曲90度,速度中等;头部:轻微点头,每1秒点1次”。

项目会自动解析每个部位的文本描述,生成对应的独立运动序列,而且每个部位的运动参数(速度、幅度、重复次数)都可以单独调节,完全按照我们的文本提示来执行。就像我们给一个乐队的每个乐手单独写乐谱,他们各自演奏,最终配合出一首完整的曲子,这里的“乐手”就是人体的各个部位,“乐谱”就是我们写的文本提示。

(2)异步运动合成

异步运动,就是“不同部位的运动不同步”,这是FrankenMotion最实用的亮点之一。传统工具生成的运动,所有部位都是“同时开始、同时结束”,比如挥手和踏步必须同步进行,而FrankenMotion可以让不同部位的运动在不同时间开始、不同时间结束,还原更贴近真人的自然运动状态。

比如我们可以设置:“左臂:0-2秒缓慢挥手;右腿:1-3秒快速踏步;头部:0-3秒持续轻微点头”,这样一来,左臂先开始挥手,1秒后右腿再开始踏步,左臂挥手结束后,右腿还在踏步,头部则全程点头,这种异步效果,能让生成的运动更自然、更有层次感,避免了传统工具“机械同步”的生硬感。

(3)零样本全新运动组合生成

“零样本”就是不需要额外训练模型,就能生成项目训练集中没有出现过的运动组合。比如训练集中只有“左手挥手”“右腿踏步”“头部点头”这三个独立的部位运动,我们可以直接组合出“左手挥手+右腿踏步+头部摇头”这种全新的运动,不需要再花时间训练模型,大大提升了运动创作的效率。

这一点对开发者和创作者来说非常实用——我们不需要为每一种运动组合单独训练模型,只要有基础的部位运动数据,就能自由组合出无数种复杂运动,比如“左手弹钢琴+右腿踢足球+头部左右张望”,这种之前需要专业动作捕捉才能实现的效果,现在用FrankenMotion就能通过文本提示快速生成。

(4)细粒度运动参数调节

除了文本提示,FrankenMotion还支持手动微调每个部位的运动参数,包括速度、幅度、时序,让运动效果更精准。比如我们生成“左手挥手”的运动后,觉得挥手速度太快,就可以把左手的运动速度调慢50%;觉得挥手幅度太小,就可以把幅度调大30%;觉得挥手的时间太短,就可以延长运动时长,甚至可以调节每个关节的运动角度,实现更精细的控制。

这种参数调节功能,能让我们快速优化运动效果,不需要反复修改文本提示,比如针对康复训练场景,我们可以把运动速度调慢、幅度调小,适配患者的恢复需求;针对游戏场景,我们可以把运动速度调快、幅度调大,让角色动作更有冲击力。

2.2 独特亮点

| 对比维度 | 传统文本驱动运动生成工具 | FrankenMotion |

|---|---|---|

| 文本控制粒度 | 只能控制整体运动(如“走路”“挥手”),无法拆分部位 | 可控制单个部位运动,支持部位级文本提示 |

| 运动同步性 | 所有部位同步运动,无法实现异步 | 原生支持异步运动,可自定义各部位运动时序 |

| 运动组合能力 | 只能生成训练集中的运动组合,无法零样本组合 | 支持零样本全新运动组合,无需额外训练 |

| 参数调节 | 只能调节整体运动参数,无法单独调节部位 | 可单独调节每个部位的速度、幅度、时序,细粒度控制 |

| 数据集支持 | 依赖传统整体运动数据集,无部位级标注 | 自带Frankenstein数据集(首个异步部位级标注) |

| 技术架构 | 通用模型,无专门的部位感知设计 | 部位感知扩散模型,专门适配部位级运动生成 |

| 易用性 | 对新手不友好,需要深入理解模型原理 | 新手友好,只需文本提示+基础Python编程就能上手 |

| 兼容性 | 适配性差,难以集成到主流3D工具 | 兼容性强,可无缝集成Blender、Unity等主流3D工具 |

亮点1:数据创新——首个异步部位级标注数据集。传统工具的痛点之一,就是没有专门的部位级运动标注数据集,导致模型无法学习单个部位的运动规律。而FrankenMotion团队自主构建了Frankenstein数据集,这是全球首个具备异步、部位级文本标注的人体运动数据集,包含10万+部位级运动片段,每个片段都有精准的文本描述和时序信息,相当于给模型提供了“每个部位的专属训练素材”,这也是它能实现部位级控制的核心基础。

亮点2:模型创新——部位感知扩散框架。传统工具用的是通用扩散模型,无法区分人体的不同部位,只能整体处理运动数据;而FrankenMotion在扩散模型的基础上,增加了“部位感知模块”,相当于给模型装上了“部位识别眼睛”,能精准区分头部、躯干、四肢等不同部位,再结合文本提示,实现“文本→部位运动”的精准映射,避免了部位运动冲突(比如“左手挥手时,躯干不会乱动乱”)。

亮点3:兼顾易用性与技术深度。很多开源工具要么太简单、功能有限,要么太复杂、新手无法上手,而FrankenMotion做到了平衡:新手只需掌握基础的Python编程,按照文档写文本提示、运行脚本,就能快速生成运动;资深开发者可以修改模型代码、自定义部位拆分规则、微调训练参数,进行二次开发,满足研究和复杂场景的需求。

三、技术细节

FrankenMotion的技术核心围绕“数据构建+模型设计” 两大模块展开,通过Frankenstein数据集提供细粒度标注数据,通过部位感知扩散框架实现精准运动生成,具体技术细节如下:

3.1 Frankenstein数据集:部位级异步运动的标注基石

Frankenstein数据集是FrankenMotion的数据核心,也是全球首个具备异步、部位级文本标注的人体运动数据集,其构建流程、规模与标注特点如下:

3.1.1 数据集构建流程(LLM驱动的自动化标注)

数据集构建采用“原始运动数据→部位拆分→LLM标注→时序对齐→数据清洗” 的全流程自动化方案,具体步骤:

原始运动数据采集:基于AMASS、Human3.6M等主流运动数据集,筛选包含多部位异步运动的原始3D运动序列(覆盖走路、跑步、挥手、跳跃、舞蹈等20+类基础动作);

人体部位拆分:将人体运动序列拆解为6大核心部位(头部、躯干、左臂、右臂、左腿、右腿),提取各部位的独立运动轨迹(基于SMPL-X模型的关节点数据);

LLM部位级文本标注:调用大语言模型(GPT-4),对每个部位的独立运动轨迹生成精准文本描述(如“左臂:从身体左侧缓慢抬起至胸前,再放下,重复2次”“右腿:向前踏步,膝盖弯曲90度,速度中等”);

异步时序对齐:为每个部位的文本描述标注时序起止时间(如“左臂运动:0-2秒;右腿运动:1-3秒;头部运动:0-3秒”),实现异步运动的时序关联;

数据清洗与验证:人工校验标注文本与运动轨迹的一致性,剔除错误标注,最终形成高质量数据集。

3.1.2 数据集规模与标注特点

规模:包含10万+ 部位级运动片段,1万+ 整体异步运动序列,覆盖20+基础动作、50+部位运动组合;

标注特点:

部位粒度:精准到6大核心部位,支持更细粒度的部位拆分(如手指、脚趾);

异步时序:每个部位运动标注独立时序,支持跨部位时序重叠/错开;

语义精准:文本描述包含运动类型、速度、幅度、重复次数等细节,避免模糊表述;

格式统一:采用JSON格式存储,包含运动序列数据、部位拆分信息、文本标注、时序信息,便于模型训练。

3.2 FrankenMotion框架:部位感知的扩散运动生成模型

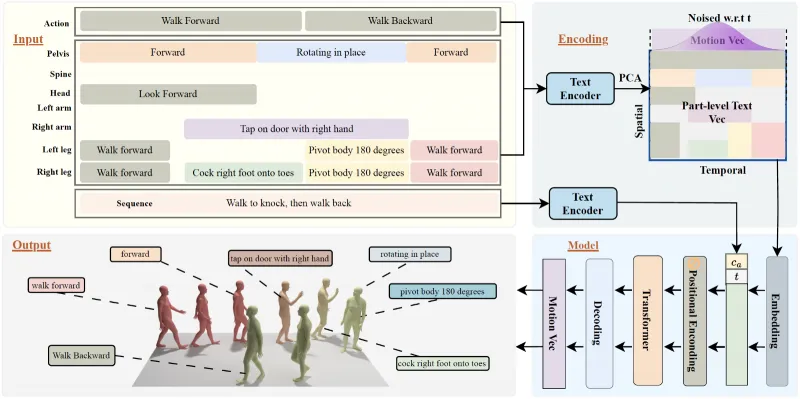

FrankenMotion框架基于** latent diffusion model(LDM)** 构建,核心创新是部位感知模块,实现“文本→部位运动”的精准映射,整体架构分为4大核心模块,具体如下:

3.2.1 整体架构

文本输入 → 文本编码器 → 部位感知模块 → 扩散模型主干 → 运动解码器 → 3D运动序列输出

文本编码器:将部位级文本提示编码为语义特征(采用CLIP文本编码器,适配细粒度语义提取);

部位感知模块:核心创新模块,为每个部位分配独立嵌入,实现部位与文本特征的绑定;

扩散模型主干:基于LDM的时序扩散模型,学习“部位语义特征→运动 latent 向量”的映射;

运动解码器:将扩散生成的latent向量解码为3D人体运动序列(基于SMPL-X模型的关节点回归)。

3.2.2 核心模块技术细节

文本编码器:细粒度语义提取

采用CLIP-ViT-L/14 文本编码器,对每个部位的独立文本提示进行编码,输出部位语义特征向量(维度:512)。相比传统文本编码器,CLIP更擅长捕捉“动作细节+部位属性”的细粒度语义(如“缓慢挥手”与“快速挥手”的语义差异)。部位感知模块:部位-文本特征绑定

该模块是FrankenMotion的核心创新,包含部位嵌入层+时序注意力层+跨部位交互层:部位嵌入层:为6大核心部位分配独立的可学习嵌入向量(维度:512),实现“部位ID→部位嵌入”的映射;

时序注意力层:对每个部位的语义特征+部位嵌入进行时序注意力建模,捕捉部位运动的时序依赖(如“左臂先抬起再放下”的时序关系);

跨部位交互层:通过轻量级交叉注意力,实现不同部位运动的协同建模(避免部位运动冲突,如“左臂挥手时躯干保持稳定”)。

最终输出部位感知语义特征(维度:6×512,对应6个部位),作为扩散模型的条件输入。扩散模型主干:时序适配的latent diffusion

针对人体运动的时序连续性特点,对传统LDM进行3大适配改造:时序卷积层:替换传统卷积层为时序空洞卷积,捕捉运动序列的长时序依赖(支持最长10秒的运动序列);

条件注入机制:将部位感知语义特征按时序步长注入扩散模型的UNet主干,实现“每一步运动生成都受部位文本控制”;

运动latent空间:将3D运动序列(SMPL-X关节点坐标)压缩为低维latent向量(维度:256),降低扩散模型的计算复杂度,同时保留运动核心特征。

运动解码器:latent→3D运动序列

采用基于Transformer的运动解码器,将扩散生成的latent向量解码为SMPL-X模型的关节点旋转矩阵与平移向量,输出标准化的3D人体运动序列(帧率:30FPS,支持导出为FBX、BVH等主流格式)。

3.2.3 训练与推理流程

训练流程

数据预处理:将Frankenstein数据集的运动序列转换为latent向量,拆分部位文本提示与时序信息;

模型初始化:加载预训练的CLIP文本编码器与LDM主干,初始化部位嵌入层与运动解码器;

部位级条件训练:以部位感知语义特征为条件,训练扩散模型学习“latent向量→运动序列”的逆扩散过程;

联合微调:加入跨部位交互损失,优化整体运动的协调性,避免部位运动冲突;

损失函数:采用扩散损失+运动重建损失+跨部位协调损失的组合损失,确保运动精度与协调性。

推理流程

文本输入:用户输入部位级文本提示(如“左臂:缓慢挥手0-2秒;右腿:快速踏步1-3秒;头部:轻微点头0-3秒”);

特征编码:文本编码器+部位感知模块生成部位感知语义特征;

扩散采样:从随机噪声开始,通过逆扩散过程生成运动latent向量(采样步数:25-50步,平衡速度与精度);

运动解码:运动解码器将latent向量转换为3D运动序列;

后处理:对运动序列进行平滑滤波,导出为FBX/BVH格式,支持在Blender、Unity等工具中可视化。

四、应用场景

FrankenMotion的细粒度部位控制能力,使其能覆盖动画影视、游戏开发、虚拟人交互、运动分析、教育科普等多个领域,解决传统运动生成方法“控制粗糙、创作低效”的痛点,具体应用场景如下:

4.1 动画影视:角色动画高效创作

核心需求:动画制作中,角色的精细动作(如卡通角色的手势、头部表情、肢体异步动作)需要大量关键帧绘制,耗时耗力;

FrankenMotion应用:

输入部位级文本提示(如“角色:左手拿笔写字,右手扶纸,头部低头看纸,躯干轻微前倾”),自动生成符合语义的3D角色运动序列;

对生成的运动进行细粒度调节(如“左手写字速度减慢20%”“头部低头幅度增加10%”),快速迭代动画效果;

支持异步动作组合(如“角色先挥手打招呼,再转身走路,同时头部回头微笑”),减少关键帧绘制工作量60%以上。

4.2 游戏开发:NPC与角色动作定制

核心需求:游戏中NPC的动作需具备多样性,自定义角色的异步动作(如“玩家角色:左手持枪,右腿下蹲,头部瞄准”)难以通过传统方法实现;

FrankenMotion应用:

为游戏NPC生成部位级差异化动作(如“商店NPC:左手整理货物,右手招呼顾客,头部左右张望”),提升游戏沉浸感;

支持玩家自定义角色动作(如“FPS游戏:左手换弹,右腿后退,头部瞄准敌人”),实现个性化动作创作;

零样本生成全新动作组合(如“RPG游戏:角色左手施法,右腿跳跃,头部念咒”),丰富游戏动作库。

4.3 虚拟人交互:自然肢体动作生成

核心需求:虚拟人(直播、客服、数字人)的肢体动作需与语音、文本语义同步,且具备自然的异步性(如“虚拟人:说话时左手手势辅助,头部轻微点头,躯干保持稳定”);

FrankenMotion应用:

结合文本/语音语义,生成虚拟人的部位级肢体动作(如“虚拟人说‘欢迎光临’时,左手挥手,头部微笑,躯干微微鞠躬”);

支持实时动作生成(延迟<500ms),适配直播、实时交互场景;

调节动作的自然度(如“手势幅度减小,更贴近真人习惯”),提升虚拟人交互的真实感。

4.4 运动分析:体育与康复运动指导

核心需求:体育训练中需拆解运动员的部位级动作(如“篮球运动员:左手运球,右腿跨步,头部观察防守”),康复治疗中需指导患者的部位级运动恢复;

FrankenMotion应用:

输入运动员的动作文本描述,生成标准部位级运动序列,与实际动作对比,分析动作偏差(如“乒乓球运动员:右臂挥拍角度偏差15度,左腿蹬地力度不足”);

为康复患者生成定制化部位运动序列(如“脑梗患者:左手缓慢握拳-张开,右腿缓慢抬升-放下,头部保持中立”),指导康复训练;

调节运动的速度与幅度(如“康复动作速度减慢50%,幅度减小30%”),适配不同恢复阶段的患者。

4.5 教育科普:人体运动原理教学

核心需求:解剖学、运动科学教学中,需直观展示人体各部位的运动原理(如“手臂运动:肱二头肌收缩带动前臂弯曲,肩部协同旋转”);

FrankenMotion应用:

输入部位运动的文本描述(如“手臂弯曲:肱二头肌收缩,前臂向上弯曲,肩部保持稳定”),生成3D人体部位运动动画;

拆解异步运动的原理(如“走路时:左腿蹬地→右腿抬起→躯干前倾→头部保持平衡”),帮助学生理解运动协同机制;

支持运动细节放大(如“手臂弯曲时的肌肉收缩动画”),提升教学直观性。

4.6 影视特效:特效角色动作合成

核心需求:科幻、奇幻影视中的特效角色(如异形、机器人)需具备非人类的异步部位运动(如“异形:左手挥爪,右腿蹬地,头部独立旋转,躯干扭曲”),传统动作捕捉难以实现;

FrankenMotion应用:

输入特效角色的部位级文本提示(如“机器人:左臂旋转攻击,右腿踏步,头部激光瞄准,躯干装甲展开”),生成非人类异步运动序列;

支持自定义部位运动规则(如“机器人头部旋转速度是手臂的2倍”),打造独特的特效角色动作;

无缝集成影视特效 pipeline(如Blender、Maya),快速导出动作序列用于特效制作。

五、常见问题解答(FAQ,新手必看,避坑指南)

问题1:FrankenMotion现在可以直接使用吗?能生成运动序列吗?

解答:目前还不能直接使用。项目处于预发布阶段,核心代码、模型权重和Frankenstein数据集还未正式发布,现在只能克隆项目仓库、搭建基础环境,等待核心资源发布后,才能运行推理脚本、生成运动序列。建议Star项目GitHub仓库,及时接收发布提醒。

问题2:搭建环境时,PyTorch安装失败,提示“找不到对应版本”怎么办?

解答:大概率是CUDA版本和PyTorch版本不对应,或Python版本过低。解决方案:

确认Python版本是3.8及以上;

GPU用户:确认CUDA版本是11.6及以上,然后重新运行PyTorch安装命令(对应CUDA版本);

若仍失败,改用国内镜像源安装,命令如下(以GPU用户为例):

pip install torch==1.13.1+cu116 torchvision==0.14.1+cu116 -i https://pypi.tuna.tsinghua.edu.cn/simple

问题3:没有NVIDIA GPU,能用CPU运行吗?运行速度怎么样?

解答:可以用CPU运行,但速度极慢,仅适合学习、调试代码,不适合生成较长的运动序列。解决方案:

安装CPU版本的PyTorch(参考5.1.2步骤3的CPU用户命令);

运行推理脚本时,减少运动时长(建议1-3秒),降低fps(建议15FPS),加快运行速度;

若需要生成较长运动序列,建议租用云GPU(如阿里云、腾讯云),成本较低且速度快。

问题4:生成的运动序列,在Blender/Unity中无法导入,怎么办?

解答:大概率是运动格式不兼容,或导入步骤错误。解决方案:

确认输出格式是FBX或BVH(这两种是3D工具的主流格式),若输出的是NPZ格式,需要用项目提供的convert_format.py脚本,转换为FBX/BVH;

Blender导入FBX时,勾选“自动绑定骨骼”;Unity导入BVH时,勾选“导入动画”;

若仍无法导入,检查运动文件是否损坏,重新运行推理脚本,生成运动文件。

问题5:可以自定义身体部位吗?比如控制手指、脚趾的运动?

解答:可以自定义。项目默认支持6大核心部位(头部、躯干、左臂、右臂、左腿、右腿),若需要控制手指、脚趾等更细的部位,解决方案:

数据预处理阶段:修改preprocess.py脚本,调整部位拆分规则,拆分出手指、脚趾等部位;

模型修改阶段:修改src/model/part_aware_module.py脚本,增加手指、脚趾的部位嵌入向量;

文本提示阶段:输入自定义部位的文本提示,比如“右手食指:缓慢弯曲0-1秒”,即可控制手指运动。

问题6:运行推理脚本时,提示“缺少模型权重文件”,怎么办?

解答:因为核心模型权重还未发布,目前无法解决,只能等待项目发布模型权重后,下载并解压到weights目录,再重新运行脚本。建议关注项目GitHub仓库,及时获取权重发布信息。

问题7:文本提示怎么写,才能生成更精准的运动?有什么技巧?

解答:文本提示的关键是“精准、详细”,新手可以参考以下技巧,生成更精准的运动:

明确部位:每个文本提示都要指定具体部位,比如“左臂”“右腿”,不要写“手臂”“腿”(避免模型混淆左右);

补充细节:包含运动类型、速度、幅度、时序,比如“左臂:缓慢挥手,幅度中等,0-2秒”,不要只写“左臂:挥手”;

避免冲突:不同部位的运动不要冲突,比如不要写“左臂挥手0-2秒,同时左臂保持不动”;

六、相关链接

GitHub 开源仓库:https://github.com/Coral79/FrankenMotion-Code

arXiv 论文链接:https://arxiv.org/abs/2601.10909

七、总结

FrankenMotion作为Coral79团队开源的部位级人体运动生成与合成框架,精准解决了现有文本驱动运动生成方法“文本粒度粗糙、部位控制缺失、异步运动不支持”的核心痛点,通过构建全球首个异步部位级文本标注的Frankenstein数据集,以及提出部位感知的扩散运动生成框架,实现了对人体各部位独立、异步的文本引导运动生成与合成,具备零样本全新运动组合、细粒度参数调节、兼容主流3D工具等核心优势,可广泛应用于动画影视、游戏开发、虚拟人交互、运动分析、教育科普等多个领域,为文本驱动的细粒度人体运动创作提供了高效、灵活的开源解决方案,虽目前核心资源待发布,但已展现出强大的技术潜力与实用价值,是文本驱动运动生成领域的重要突破。

版权及免责申明:本文由@97ai原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/frankenmotion.html