HoloCine:开源电影级多镜头长视频叙事生成框架,实现跨镜头视觉与叙事双一致性

一、HoloCine是什么

在AI文本到视频技术快速发展的背景下,传统T2V模型仅能生成高质量的孤立短视频片段,在创作由多个镜头组成的连贯叙事视频时,普遍存在角色形象跳变、场景细节不一致、剧情衔接断裂等问题,无法满足电影级、叙事性的视频创作需求。针对这一行业痛点,香港科技大学与蚂蚁集团等机构联合研发了HoloCine,一款专注于电影级多镜头长视频叙事整体生成的开源T2V框架。

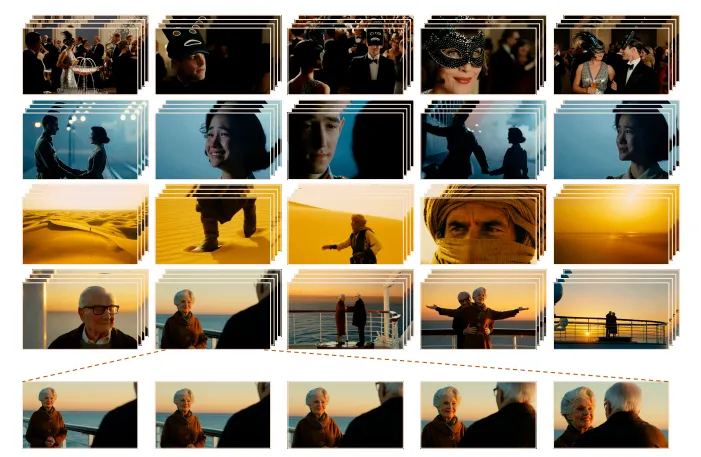

HoloCine基于Python开发,兼容diffsynth框架,以强大的Wan2.2 DiT视频扩散模型为技术底座,通过全新的模型架构和训练方式,打破了传统T2V模型的时长与叙事限制。该项目摒弃了传统的“分镜头独立生成+拼接”模式,采用整体生成策略,将整个多镜头视频序列作为一个整体进行建模,从底层保障视频在角色、场景、风格等视觉层面,以及剧情、动作、镜头转换等叙事层面的双重一致性,可实现分钟级多镜头长视频的高效生成。

HoloCine目前已在GitHub开源完整的推理代码和14B规模的模型版本,后续将持续更新低显存5B版本、长时长1分钟+版本,同时社区已开发出ComfyUI适配节点,让非专业开发者也能快速上手。项目采用CC BY-NC-SA 4.0开源协议,仅限非商业用途使用,使用时需注明出处,修改后分发需遵循相同协议。

二、HoloCine的功能特色

整体生成实现跨镜头双一致性

HoloCine的核心优势是通过整体生成策略,从底层解决多镜头视频的一致性问题,既保证视觉一致性,让角色的外貌、服饰、动作,场景的布局、细节、风格在所有镜头中保持统一,甚至能记住非显著的背景细节;又实现叙事一致性,让镜头间的剧情衔接、动作延续、镜头转换更自然,符合电影的叙事逻辑,区别于传统拼接式生成的视频断层问题。导演级精细化创作可控性

项目通过窗口交叉注意机制,实现文本提示与视频片段的精准局部对齐,支持用户输入分层结构化提示词,既可以用全局提示词定义整个视频的故事背景、核心元素,也可以用逐镜头提示词精准控制每个镜头的画面内容、摄像机运动(上倾、拉出、跟踪拍摄)、镜头尺度(特写、中景、全景)等,实现如真人导演般的精细化创作控制。高效生成突破时长与算力限制

针对长视频生成的计算成本过高问题,HoloCine设计了稀疏镜头间自注意机制,大幅降低计算复杂度,让模型的计算成本随镜头数量呈线性增长,而非传统的二次方增长,成功实现分钟级多镜头长视频的生成,同时该机制对算力要求更友好,普通消费级显卡满足显存要求即可运行。多规格模型适配不同硬件条件

项目目前发布了14B规模的full全注意力和sparse稀疏注意力两个版本,full版本生成质量更高,适合显存充足的硬件;sparse版本显存占用更低,适合中低配显卡。后续还将推出低显存5B版本(适配入门级硬件)和长时长1分钟+版本,满足不同用户的硬件条件和创作需求。通用框架易扩展,兼容主流创作工具

HoloCine并非单一的模型,而是一套通用的多镜头视频生成框架,可适配现有主流的T2V模型,具备良好的扩展性。同时项目兼容当下流行的AI创作工具ComfyUI,社区已开发出专属适配节点,用户可直接在ComfyUI中搭建工作流,无需编写复杂代码,降低上手门槛。结构化提示词设计,兼顾专业与新手

项目支持全局提示词+逐镜头提示词的分层结构化提示词格式,专业创作者可通过精细化的提示词实现复杂的电影级创作,新手也可通过简单的提示词组合生成连贯的多镜头视频,同时支持Gemini 2.5 Pro等大模型辅助生成符合格式的提示词,进一步降低创作难度。

三、HoloCine的技术细节

HoloCine的技术核心围绕“实现精准控制”和“降低计算成本”两大目标设计,同时搭建了专属的大规模训练数据集,为模型性能提供保障,其核心技术模块及作用如下表所示:

| 核心技术模块 | 核心作用 | 技术亮点 |

|---|---|---|

| 窗口交叉注意机制 | 实现导演级精细化控制 | 将文本提示局部化对齐对应视频片段,避免指令“稀释”,精准控制镜头内容与转换时机 |

| 稀疏镜头间自注意机制 | 降低计算成本,实现长视频生成 | 镜头内密集注意保障运动流畅,镜头间稀疏连接保障一致性,计算复杂度线性增长 |

| 40万级多镜头标注数据集 | 为模型训练提供数据支撑 | 基于电影/电视剧加工,分层标注全局+逐镜头信息,覆盖5/15/60秒不同时长 |

| 整体生成架构 | 保障跨镜头双一致性 | 将多镜头序列作为整体建模,共享自注意机制,从底层避免拼接式的断层问题 |

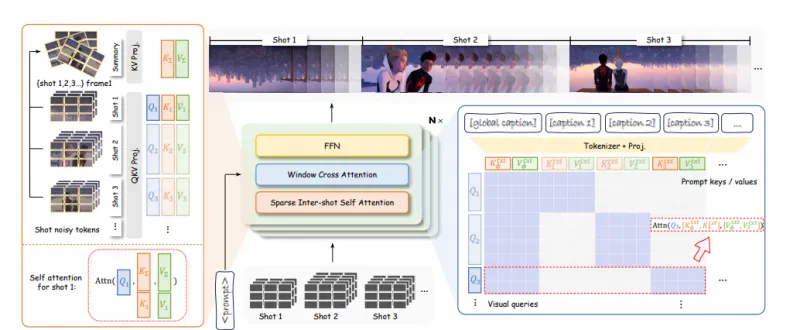

1. 两大核心注意力机制

窗口交叉注意和稀疏镜头间自注意是HoloCine的技术核心,二者相辅相成:

窗口交叉注意机制:打破了传统T2V模型“所有视频标记关注整个文本提示”的模式,通过注意力掩码将注意力场约束为局部对齐,让每个镜头的文本提示仅作用于对应的视频片段,同时能识别镜头切换标签,实现精准的镜头转换控制,让模型能理解并执行“特写转全景”“低角度拍摄”等电影语言指令。

稀疏镜头间自注意机制:基于“镜内与镜间一致性需求不同”的核心洞察设计,在镜头内部使用密集自注意,保障帧与帧之间的运动连续性和画面流畅性;在镜头之间则提取每个镜头的代表性标记(如第一帧)形成全局摘要,通过稀疏连接实现信息交换,既保障了跨镜头的一致性,又大幅减少了计算量,让分钟级长视频生成成为可能。

2. 训练数据集与模型架构

HoloCine的训练数据集是其性能的重要基础,研发团队通过专门的数据策划Pipeline,从公共电影、电视剧资源中提取视频内容,经镜头分割、质量过滤后,组装成5秒、15秒、60秒不同时长的多镜头样本,最终构建了40万个分层标注的多镜头样本数据集,每个样本都包含全局提示词和逐镜头提示词,为模型的叙事能力提供了充足的数据支撑。

模型架构方面,HoloCine基于Wan2.2 DiT视频扩散模型构建,兼容diffsynth框架,核心由T5文本编码器、Wan2.1 VAE、SVD/SDXL版本UNet等组件组成,同时集成了ImageQualityMetric等模块,保障生成视频的美学质量。模型训练在128张NVIDIA H800 GPU上完成,采用完全分片数据并行(FSDP)和上下文并行性(CP)的混合并行策略,解决了长视频序列训练的显存问题。

3. 关键实现优化

为提升运行效率,HoloCine的稀疏镜头间自注意机制基于FlashAttention-3实现,利用其可变长度序列功能,将稀疏关注模式的计算打包成单个张量,避免填充标记的开销,实现速度与显存效率的双重优化;若用户无法安装FlashAttention-3,也可降级使用FlashAttention-2,仅存在小幅速度差异。

四、HoloCine的应用场景

依托电影级的多镜头生成能力和跨镜头双一致性优势,HoloCine可满足不同领域的视频创作需求,核心应用场景主要包括以下五类:

影视行业前期制作

影视制作团队可利用HoloCine快速将文字分镜转化为可视化的多镜头样片,直观呈现剧本的画面效果,同时可快速尝试不同的镜头语言和叙事方式,大幅降低影视前期的制作成本和时间成本,提升剧本打磨和团队沟通的效率。创意内容创作

自媒体博主、短视频创作者、独立设计师可通过HoloCine创作具有电影质感的多镜头短视频,无需专业的拍摄和剪辑能力,即可实现角色、场景一致的叙事性内容创作,同时模型对东方、西方不同风格的元素都有良好的生成效果,能满足多样化的创作需求。教育培训领域

教师和科普创作者可利用HoloCine制作情景化的多镜头教学课件、科普视频,通过连贯的叙事和生动的画面将抽象的知识具象化,提升学生的学习兴趣和理解效率,尤其适合文科故事讲解、理科实验模拟、少儿启蒙教育等场景。虚拟数字人内容创作

在虚拟数字人直播、短视频、品牌宣传等场景中,HoloCine可保障虚拟人形象、服饰的跨镜头一致性,快速生成虚拟人的多镜头叙事视频,同时可灵活控制虚拟人的动作、场景和镜头转换,降低虚拟数字人内容的制作门槛。广告与文创设计

中小企业和文创工作室可利用HoloCine制作电影级的产品宣传广告,通过多镜头叙事突出产品特点;同时可将文创IP、绘本故事转化为连贯的多镜头动态视频,实现IP的故事化、可视化传播,提升IP的吸引力。

五、HoloCine的使用方法

HoloCine的使用主要分为原生Python代码运行和ComfyUI集成运行两种方式,其中ComfyUI方式更适合非专业开发者,整体使用流程简单易懂,核心分为环境搭建、权重准备、模型运行、结果优化四步,具体操作如下:

1. 基础环境搭建

HoloCine基于Python 3.10开发,建议使用Conda创建独立的运行环境,避免依赖冲突,核心命令如下:

# 创建并激活Conda环境 conda create -n HoloCine python=3.10 conda activate HoloCine # 安装项目依赖 git clone https://github.com/yihao-meng/HoloCine.git cd HoloCine pip install -e .

核心依赖需安装FlashAttention-3(最优)或FlashAttention-2(降级替代),实现稀疏注意力的高效运行,安装方式参考官方文档。

2. 模型权重准备

运行HoloCine需要下载两类权重,均需从Hugging Face获取,且仅需核心文件无需完整仓库:

Wan2.2核心权重:下载

models_t5_umt5-xxl-enc-bf16.pth(T5文本编码器)和Wan2.1_VAE.pth(VAE组件),地址为Wan-AI/Wan2.2-T2V-A14B;HoloCine模型权重:下载14B-full/sparse版本权重,地址为hlwang06/HoloCine,将所有权重文件放入项目指定的

checkpoints文件夹。

3. 模型运行

(1)原生Python代码运行

直接运行项目提供的推理脚本,根据硬件选择full/sparse版本:

# 全注意力版本 python HoloCine_inference_full_attention.py # 稀疏注意力版本 python HoloCine_inference_sparse_attention.py

运行前需在脚本中配置提示词和核心参数:提示词需遵循“全局提示词+逐镜头提示词”的分层格式,加入(shot cut)标签标记镜头切换;参数需设置分辨率为832×480,帧数遵循4n+1原则(如201帧、241帧、401帧),避免生成报错。

(2)ComfyUI集成运行

将社区开发的ComfyUI适配节点(ComfyUI-WanVideoWrapper-Multishot)导入ComfyUI,升级至最新版后,直接在工作流中加载HoloCine模型和Wan2.2权重,无需编写代码,仅需在节点中填写提示词、设置帧数和分辨率即可运行,适合新手快速上手。

4. 生成结果优化

为提升视频生成质量和流畅度,可通过以下几点优化:

采样算法选择LCM,采样步数设置为8步及以上,兼顾生成速度和画质;

搭配Wan2.1 LoRA加速模型运行,避免使用Wan2.2 LoRA,提升生成效果;

利用Gemini 2.5 Pro等大模型生成符合格式的结构化提示词,提升叙事和镜头控制的精准度;

8G显存建议运行201帧(约8秒)视频,12G及以上显存可运行401帧(约16秒)视频,减少显存溢出概率。

六、常见问题解答

运行时出现显存不足(OOM)报错怎么办?

首先选择sparse稀疏注意力版本的模型,同时开启4-bit量化加载权重;其次遵循帧数的4n+1原则,8G显存建议跑201帧,12G及以上跑401帧,避免强行生成长时长视频;另外可将虚拟内存设置为物理内存的两倍,缓解显存压力。

生成的视频无分镜效果或跨镜头一致性差?

需检查提示词格式,严格遵循“全局+逐镜头”的分层结构,在镜头之间加入(shot cut)标签明确镜头切换,同时保证核心元素(角色、场景)在提示词中的描述统一;另外确认帧数符合4n+1原则,参数设置错误也会导致分镜效果丢失。

安装FlashAttention时出现编译报错?

首先确认Conda环境为纯净的Python3.10环境,无其他依赖冲突;其次将CUDA版本升级至11.8及以上,FlashAttention对CUDA版本有明确要求;若仍无法编译,可降级使用FlashAttention-2,虽速度稍慢但不影响核心功能。

ComfyUI中无法加载HoloCine模型怎么办?

先将ComfyUI的HoloCine适配节点升级至最新版,同时确认Wan2.2核心权重和HoloCine模型权重的路径配置正确,无文件缺失或路径错误;另外关闭ComfyUI中其他冲突的视频生成扩展,避免插件之间的功能冲突。

生成的视频画质偏低、运动不流畅?

优先选择full全注意力版本的模型,将采样步数提升至8步及以上;分辨率固定为官方推荐的832×480,避免随意修改导致画质下降;同时搭配Wan2.1 LoRA加速,在模型中加入美学过滤模块,提升视频的视觉质量。

输入提示词后模型无响应或生成报错?

检查提示词是否包含特殊字符,建议删除全角符号、乱码等无效内容;确认逐镜头提示词的数量与设定的镜头数量一致,避免数量不匹配;同时检查权重文件的完整性,缺失或损坏的权重文件会导致模型无法运行。

七、相关链接

HoloCine官方GitHub开源仓库:https://github.com/yihao-meng/HoloCine

HoloCine项目论文地址:https://arxiv.org/abs/2510.20822

HoloCine官方演示页:https://holo-cine.github.io/

HoloCine模型权重下载地址:https://huggingface.co/hlwang06/HoloCine

Wan2.2核心权重下载地址:https://huggingface.co/Wan-AI/Wan2.2-T2V-A14B

HoloCine ComfyUI社区适配节点:https://github.com/Dango233/ComfyUI-WanVideoWrapper-Multishot

八、总结

HoloCine是由香港科技大学与蚂蚁集团等机构联合开发的开源电影级多镜头长视频叙事生成框架,以Python为开发基础、Wan2.2 DiT视频扩散模型为技术底座,核心通过窗口交叉注意和稀疏镜头间自注意两大创新机制,从底层解决了传统文本到视频模型多镜头生成时的视觉跳变、叙事断裂等行业痛点,实现了跨镜头的角色、场景、风格视觉一致性和剧情、动作、镜头转换的叙事一致性,同时将计算复杂度优化为线性增长,成功实现分钟级多镜头长视频的高效生成。该项目摒弃了传统的分镜拼接模式,采用整体生成策略,支持导演级的精细化创作控制,可通过分层结构化提示词精准控制镜头内容、摄像机运动等电影语言,同时提供14B规模的full/sparse两种模型版本,适配不同显存的硬件条件,后续还将推出低显存5B版本和长时长版本。HoloCine兼容diffsynth框架和ComfyUI工作流,拥有完整的推理代码和初步的社区生态,采用CC BY-NC-SA 4.0协议仅限非商业使用,其不仅为专业影视制作提供了高效的前期样片生成工具,也为创意内容创作、教育培训、虚拟数字人等领域的普通开发者降低了电影级多镜头视频的创作门槛,是AI文本到视频领域从孤立片段生成向完整叙事场景创作转变的重要开源项目。

版权及免责申明:本文由@dotaai原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/holocine.html