HY-World 2.0:腾讯混元开源的多模态3D世界生成与重建模型

一、HY-World 2.0是什么

HY-World 2.0(混元3D世界模型2.0) 是腾讯混元团队研发并开源的多模态3D世界模型框架,它是全球首个实现SOTA级效果、全开源、工业级可用的3D世界模型,核心突破是将AI能力从“生成单物体/视频”升级为“生成完整可交互3D世界”,直接输出可二次编辑的标准化3D资产,而非传统世界模型的视频片段。

作为腾讯混元3D技术体系的核心迭代产品,HY-World 2.0基于Hunyuan3D-2.0架构演进,以“统一空间理解、生成、重建”为核心设计理念,打通文本/图像/视频到3D世界的全链路,支持与Unity、Unreal Engine、Blender、Isaac Sim等主流工具无缝对接,让3D内容生产从“数天级”缩短至“分钟级”。

简单来说,HY-World 2.0实现了“一句话造3D游戏世界、一张图复刻真实空间、一段视频生成数字孪生”的能力,是AI 3D生成领域从“玩具级”迈向“工业化”的里程碑产品。

二、功能特色

1. 多模态全能输入,覆盖全场景需求

文本输入:简短描述即可生成高精度3D世界,支持写实、卡通、绘本、游戏等任意风格

单图输入:普通照片/插画一键转360°全景+可漫游3D空间,无需相机参数

多图/视频输入:多视角图像或短视频精准重建真实场景,生成数字孪生空间

混合输入:文本+图像组合控制,精准匹配创意需求

2. 双核心能力:世界生成+世界重建

(1)世界生成(Text/Image-to-3D World)

四阶段流水线:全景生成(HY-Pano 2.0)→轨迹规划(WorldNav)→立体扩展(WorldStereo 2.0)→世界合成(WorldMirror 2.0+3DGS)

输出完整3D场景:包含建筑、地形、植被、道具等全要素,支持无限漫游

角色交互模式:第一/第三人称视角,具备物理碰撞、自由探索、场景互动能力

(2)世界重建(Multi-view/Video-to-3D)

单步前向推理:WorldMirror 2.0直接输出深度图、法向、相机位姿、点云、3DGS属性

超高精度:支持50K–500K分辨率点云,几何细节与纹理还原度达SOTA水平

真实复刻:完美保留场景尺寸、材质、光影,适用于数字孪生、文物修复等专业场景

3. 标准化3D资产输出,全流程兼容

多格式导出:Mesh(OBJ/FBX/GLB)、3DGS(3D高斯溅射)、高密度点云

引擎无缝对接:直接导入Unity、UE、Blender、Isaac Sim,支持二次编辑与物理仿真

持久化存储:生成资产可永久保存、跨平台迁移,解决传统世界模型“仅能播放、无法复用”痛点

4. 工业级性能与易用性

速度优势:单场景生成仅需3–10分钟,传统3D建模需数天

硬件友好:支持消费级RTX 3090/4090显卡,无需超算集群

开箱即用:提供Gradio网页Demo、命令行工具、Python API,降低开发门槛

完全开源:代码、权重、训练数据、工具链全面开放,支持二次开发与商业化

三、技术细节

1. 核心架构:四阶段3D世界生成流水线

HY-World 2.0采用“2D全景代理+3D升维”创新架构,避免直接文生3D的质量不稳定问题,通过成熟2D模型保证内容质量,再精准升维至3D:

HY-Pano 2.0(全景生成模块)

端到端隐式学习:无需相机内参/外参,普通图像直接生成360°高保真全景

混合训练策略:真实全景+UE合成数据,覆盖室内/室外/写实/风格化全场景

WorldNav(空间智能导航模块)

空间Agent技术:结合VLM(视觉语言模型)与NavMesh导航网格表征

智能轨迹规划:自动生成合理漫游路径,确保覆盖场景关键区域,无死角探索

WorldStereo 2.0(立体扩展模块)

跨层深度对齐:解决全景图分层深度冲突问题,保证3D空间几何一致性

场景无限扩展:单张全景扩展为大规模连续3D世界,无边界限制

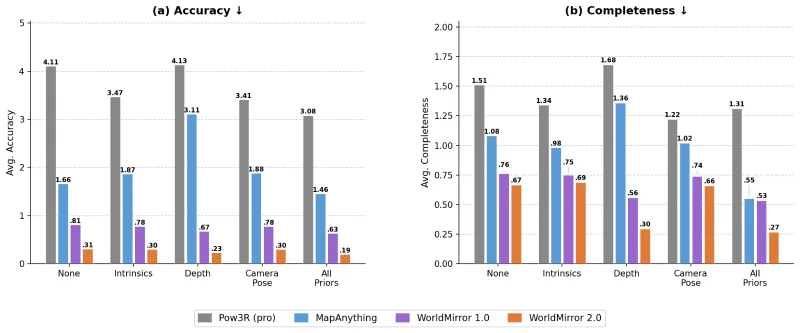

WorldMirror 2.0(世界合成与重建模块)

多任务统一输出:同时生成深度、法向、相机参数、点云、3DGS属性

3DGS加速渲染:基于3D高斯溅射技术,实现实时高保真渲染,性能较NeRF提升100倍+

2. 关键技术突破

(1)无参数全景生成

传统方法需精确相机参数才能生成全景,现实中难以获取;HY-Pano 2.0通过端到端隐式空间映射,让模型自主学习2D→3D空间转换,普通手机照片即可生成高质量360°全景。

(2)几何与纹理分离生成

采用“几何先构、纹理后精”两阶段机制:先生成精准Mesh/点云几何结构,再通过纹理模型还原真实材质细节,大幅提升精细度与真实感,解决传统端到端模型“几何模糊、纹理失真”问题。

(3)空间语义理解与物理一致性

引入空间语义标注:模型理解“墙/地/天花板/家具”等空间关系,生成符合物理逻辑的场景

物理碰撞约束:自动生成碰撞体,角色移动、交互符合真实物理规律

(4)高效3DGS渲染管线

基于3D高斯溅射(3D Gaussian Splatting) 技术,替代传统NeRF/体渲染

实时渲染:1080P分辨率可达60FPS,支持交互式探索与大规模场景仿真

3. 模型规格

核心模型:WorldMirror 2.0(约1.2B参数)、HY-Pano 2.0(约0.8B参数)

训练数据:千万级文本-3D配对数据、百万级全景图像、十万级多视图视频

支持分辨率:输入1024×1024,输出最高8K全景、500K点云

硬件要求:推荐CUDA 12.4、Python 3.10、PyTorch 2.4.0、RTX 4090/3090显卡

四、应用场景

1. 游戏开发(核心场景)

快速原型:10分钟生成游戏关卡/地图原型,替代传统数周建模工作

资产生成:批量生成场景、建筑、道具资产,降低美术成本

开放世界:大规模连续场景生成,支持开放世界游戏快速开发

独立游戏:个人开发者零门槛制作3D游戏场景

2. 数字孪生与智慧城市

实景复刻:视频/多图生成高精度城市/园区/建筑数字孪生体

规划仿真:城市规划、园区设计可视化预览与物理仿真

智慧文旅:景区3D数字化,打造线上虚拟游览、VR导览系统

3. VR/AR与元宇宙

沉浸式内容:快速生成VR/AR虚拟场景、虚拟展厅、虚拟演唱会场地

社交空间:元宇宙平台3D社交场景、虚拟家园批量生成

教育培训:VR实训场景、虚拟实验室、历史文化场景复原

4. 工业设计与建筑可视化

室内设计:户型图/照片生成3D装修方案,实时预览不同风格

建筑表现:建筑效果图快速转3D模型,支持动态视角展示

工业仿真:工厂、生产线3D重建,用于设备运维、安全培训

5. 文化遗产与影视动画

文物修复:文物/古建筑3D数字化存档、虚拟修复、线上展示

影视场景:电影/动画虚拟场景快速生成,缩短制作周期

电商展示:商品3D建模、虚拟展台、AR试衣/试妆场景

6. 具身智能与机器人仿真

仿真环境:生成多样化3D训练场景,用于机器人导航、操作算法训练

强化学习:无限场景生成,解决仿真环境多样性不足问题

五、使用方法

1. 环境部署(本地开源版)

# 1. 克隆代码 git clone https://github.com/Tencent-Hunyuan/HY-World-2.0 cd HY-World-2.0 # 2. 创建conda环境 conda create -n hyworld2 python=3.10 conda activate hyworld2 # 3. 安装PyTorch(CUDA 12.4) pip install torch==2.4.0 torchvision==0.19.0 --index-url https://download.pytorch.org/whl/cu124 # 4. 安装依赖 pip install -r requirements.txt # 5. 下载模型权重(自动/手动) # 首次运行自动下载,或手动下载至 ./checkpoints

2. 快速使用(三种方式)

(1)Gradio网页Demo(推荐新手)

# 启动网页界面 python -m hyworld2.worldrecon.gradio_app

访问 http://localhost:7860,可视化操作:

选择模式:世界生成(文本/单图)或世界重建(多图/视频)

上传输入:输入文本描述或上传图片/视频

调整参数:分辨率、风格、细节程度

生成导出:等待完成后,下载Mesh/3DGS/点云文件

(2)命令行工具(批量处理)

# 世界生成(文本) python -m hyworld2.worldgen.pipeline \ --text "生成一个原神风格的空中花园,有喷泉、石桥、藤蔓" \ --style "游戏风" \ --output ./output/garden # 世界重建(多图) python -m hyworld2.worldrecon.pipeline \ --input_path ./images/room \ --output ./output/room_3d \ --format "glb,3dgs"

(3)Python API(二次开发)

from hyworld2 import WorldGenerator, WorldReconstructor

# 1. 世界生成

generator = WorldGenerator()

result = generator.generate(

text="温馨的日式小木屋,有榻榻米、落地窗、绿植",

style="写实",

resolution="4K"

)

result.export("./output/cabin.glb")

# 2. 世界重建

reconstructor = WorldReconstructor()

result = reconstructor.reconstruct(

image_paths=["./img1.jpg", "./img2.jpg", "./img3.jpg"],

output_format="3dgs"

)

result.export("./output/scene.3dgs")3. 在线体验(无需部署)

官方Demo:https://3d.hunyuan.tencent.com/sceneTo3D

支持文本/单图生成,在线预览3D场景

支持下载低分辨率Mesh文件

适合快速体验与创意验证

六、竞品对比

主流3D世界/场景生成工具核心对比

| 产品 | 开发商 | 核心技术 | 输入类型 | 输出格式 | 开源/商用 | 优势 | 局限 |

|---|---|---|---|---|---|---|---|

| HY-World 2.0 | 腾讯混元 | 全景+3DGS+四阶段流水线 | 文本/单图/多图/视频 | Mesh/3DGS/点云 | 完全开源 | 多模态全能、引擎兼容、工业级质量、角色交互 | 本地部署需中高端GPU |

| Luma AI (Genie) | Luma AI | NeRF/3DGS | 单图/视频 | NeRF/3DGS/Mesh | 商用(付费) | 移动端支持、云渲染、易用性强 | 输出质量有限、无法商用导出、闭源 |

| NVIDIA Instant-NGP | 英伟达 | NeRF/Instant NeRF | 多视图图 | NeRF/点云 | 开源(研究) | 速度极快、实时渲染、学术SOTA | 仅支持重建、无文本生成、无角色交互 |

| Google Genie 3 | Google DeepMind | 视频世界模型 | 文本/视频 | 视频文件 | 闭源(未开源) | 视频流畅、动态效果好 | 仅输出视频、无法编辑3D资产、无实用价值 |

核心差异总结

HY-World 2.0 vs Luma AI

HY-World 2.0:全开源、支持文本生成、输出标准3D资产、角色交互、工业级

Luma AI:闭源商用、仅图/视频输入、云服务依赖、个人非商用

HY-World 2.0 vs Instant-NGP

HY-World 2.0:生成+重建双能力、多模态输入、完整世界、引擎兼容

Instant-NGP:仅重建、多视图输入、单一场景、研究导向

HY-World 2.0 vs Genie 3

HY-World 2.0:输出可编辑3D资产、可持久化、可导入引擎、可交互

Genie 3:仅输出视频、无法编辑、无法复用、纯演示

七、常见问题解答

Q:HY-World 2.0本地部署需要什么硬件配置?

A:推荐配置:RTX 4090/3090(24GB显存)、32GB内存、i7/R7以上CPU、Windows/Linux系统;最低配置:RTX 3080Ti(12GB显存),可生成低分辨率场景。

Q:生成的3D资产可以商用吗?

A:完全可以。HY-World 2.0采用Apache 2.0开源协议,允许个人/商业使用、修改、二次分发、商用部署,无版权限制。

Q:支持哪些3D格式导出?可以直接导入Unity/UE吗?

A:支持GLB/FBX/OBJ(Mesh)、3DGS(3D高斯)、PLY(点云);GLB/FBX可直接拖入Unity/UE使用,自动保留材质、纹理、层级结构。

Q:文本生成支持哪些风格?效果稳定吗?

A:支持写实、卡通、动漫、游戏、绘本、科幻、古风等任意风格;通过HY-Pano 2.0与混合训练策略,生成质量稳定,场景结构合理、细节丰富。

Q:世界重建需要多少张图片?对拍摄有什么要求?

A:推荐10–50张多视角图片(覆盖场景70%+区域),或10–30秒环绕视频;拍摄时保持光线稳定、避免剧烈运动、清晰对焦即可,无需专业设备。

Q:生成速度如何?影响速度的因素有哪些?

A:文本生成:3–8分钟/场景;图片/视频重建:5–15分钟/场景;影响因素:显卡性能、分辨率、场景复杂度、细节等级。

Q:可以生成动态/动画场景吗?

A:当前版本主要生成静态3D场景;角色可移动交互,但场景物体无内置动画;可导入Unity/UE后添加动画、粒子、物理效果。

Q:模型权重有多大?下载需要多久?

A:核心权重约5GB(WorldMirror 2.0+HY-Pano 2.0);首次运行自动下载,带宽100MB/s约1分钟完成。

Q:支持Mac系统吗?

A:当前仅支持Windows/Linux(CUDA);Mac(MPS)版本正在开发,预计2026年Q2更新。

Q:生成的场景有版权问题吗?

A:HY-World 2.0生成的所有3D资产版权归用户所有,可自由用于商业项目、个人创作、学术研究,无侵权风险。

八、相关链接

官方技术报告:https://3d-models.hunyuan.tencent.com/world/world2_0/HY_World_2_0.pdf

腾讯混元3D官网:https://3d.hunyuan.tencent.com/

Hugging Face模型库:https://huggingface.co/Tencent-Hunyuan/HY-World-2.0

九、总结

HY-World 2.0作为腾讯混元开源的多模态3D世界模型,凭借世界生成+场景重建双核心能力、文本/图像/视频全模态输入、标准化3D资产输出与主流引擎无缝兼容的特性,彻底解决了传统3D内容生产效率低、门槛高、复用性差的痛点,实现了AI 3D生成从实验室演示到工业化应用的跨越。它不仅是游戏开发、数字孪生、VR/AR领域的高效工具,更通过完全开源的模式,为全球开发者提供了可二次开发、可商用的3D世界生成基础设施,推动AIGC技术与3D内容产业深度融合,成为当前3D世界模型领域最具实用性与竞争力的开源方案。

版权及免责申明:本文由@97ai原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/hy-world-2-0.html