ImageCritic:南开大学开源的AI生成图像细节纠错工具

一、ImageCritic是什么

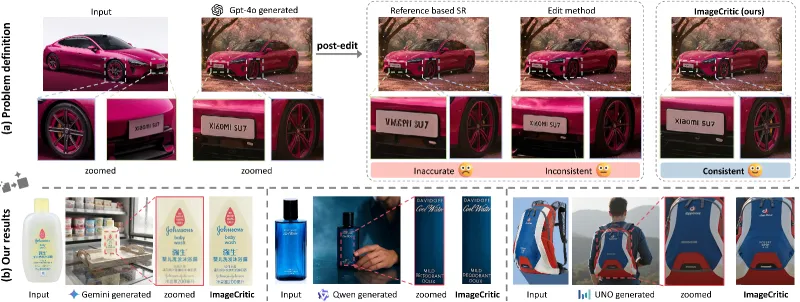

ImageCritic是一款面向AI生成图像一致性修复的开源工具,由南开大学HVision实验室研发,对应学术论文为《The Consistency Critic: Correcting Inconsistencies in Generated Images via Reference-Guided Attentive Alignment》。它的核心定位是AIGC后处理环节的“细节医生”,专门处理当前主流扩散模型(如FLUX、Stable Diffusion、Xverse、DreamO等)在生成过程中容易出现的细节错乱、纹理错位、结构不统一、局部特征失真等问题。

随着DiT(Diffusion Transformer)架构成为图像生成的主流,参考引导生成(Reference-guided Generation)被广泛用于虚拟试衣、图像编辑、主体定制等场景,但这类方法普遍存在细节不一致的痛点:例如生成的汽车轮毂纹理错乱、人物服饰花纹错位、产品局部特征与参考图不匹配、多视角生成结构不统一等。传统超分或修复方法只能提升分辨率,无法从语义与结构层面修正不一致;而通用图像编辑工具又缺乏针对性的细节对齐能力。

ImageCritic正是为解决这一痛点而生。它不重新生成整张图像,而是以局部修复(Inpainting)为基础,通过参考引导的注意力对齐技术,让待修复区域主动“学习”参考图像的正确细节,在保留原图整体结构与风格的前提下,精准修正局部不一致,让AI生成图像从“能用”变成“精致可用”。

该项目完全开源,提供本地Gradio交互界面、单图推理脚本、模型下载工具、训练数据集与训练代码,支持学术研究与二次开发,采用CC BY-NC 4.0协议,非商业用途可自由使用。

二、功能特色

ImageCritic的功能围绕“精准、轻量、易用、可扩展”四大核心设计,相比其他图像修复/编辑工具,具备鲜明的差异化优势。

1. 专注生成图像不一致修复,针对性极强

专门解决AI生成图像的细节错位、纹理不匹配、结构失真、局部特征错误等一致性问题;

不破坏原图整体构图、色彩与风格,只修正错误区域;

对轮毂、花纹、文字、装饰等精细结构的修复效果显著优于通用工具。

2. 参考引导注意力对齐,修复逻辑更智能

采用参考图+待修复图双输入机制,让模型以参考图为“标准答案”进行修正;

创新注意力对齐损失,强制模型在修复时对齐参考图的空间特征与纹理分布;

搭配细节编码器,强化对微小纹理、边缘、结构的捕捉能力,修复精度达到像素级。

3. 局部修复为主,效率与效果兼顾

基于局部Inpainting机制,只处理需要修正的区域,速度远快于重绘整张图;

支持手动绘制黑色掩码指定修复区域,可自由控制修复范围;

低分辨率区域也可通过扩大框选范围实现有效修复。

4. 开箱即用,多场景推理方式齐全

提供本地Gradio网页界面,拖拽上传即可可视化测试,无需代码基础;

支持单案例推理脚本,方便批量处理与集成到工作流;

提供完整模型/数据集自动下载脚本,一键配置环境。

5. 兼容主流生成模型,扩展性强

原生适配FLUX.1系列基座,同时兼容Xverse、DreamO、MOSAIC、OmniGen2、UNO等主流模型的输出结果;

可集成到Agent框架,实现自动检测不一致→定位区域→多轮局部编辑的全自动修复流程;

支持多语言、多视角、多风格图像的一致性修复。

6. 提供专用训练数据集,支持二次训练

开源Critic-10K数据集,包含1万组“参考图-失真图-目标图”三元组,专门用于图像不一致修复训练;

提供训练代码与多GPU配置文件,支持研究者在自有数据上微调模型。

三、技术细节

ImageCritic的技术核心是参考引导的注意力对齐机制,整体基于DiT架构与FLUX.1-Kontext-dev基座,通过细节编码器、注意力对齐损失、局部修复流水线三大模块实现精准修复。

1. 基础架构:基于DiT与FLUX.1-Kontext-dev

项目选择FLUX.1-Kontext-dev作为基座模型,原因在于其DiT架构对参考信息与注意力的建模能力更强,在细节生成与空间对齐上优于传统UNet架构扩散模型。ImageCritic以LoRA方式对基座进行微调,rank=128,学习率1e-4,训练效率高且不会破坏基座原有能力。

2. 核心模块1:细节编码器(Detail Encoder)

细节编码器是ImageCritic捕捉精细特征的关键,设计灵感来自PhotoMaker与DreamO:

将参考图(IMG1)与待修复图(IMG2)分别编码为隐层特征;

把图像隐层与触发词(IMG1/IMG2)的文本隐层耦合,让模型明确区分“参考”与“输入”;

融合CLIP图像特征,增强语义级别的细节理解,避免修复后语义错位。

该编码器让模型能够捕捉轮毂纹路、织物纹理、文字笔画、物体边缘等微小但关键的细节,解决传统模型“看不清细节”的问题。

3. 核心模块2:参考引导注意力对齐(Reference-Guided Attentive Alignment)

这是ImageCritic的核心创新点,直接解决不一致问题:

在DiT的注意力机制中,同时建模参考分支与输入分支的注意力分布;

对需要修复的噪声区域,强制输入分支的注意力向参考分支对齐;

对不需要修复的区域,保持原有注意力分布,避免过度修改。

4. 核心模块3:注意力对齐损失函数

项目设计了两组专用损失,确保修复效果稳定:

LG损失:约束修复区域的注意力与参考图对齐;

LR损失:约束非修复区域保持原有特征,不被干扰。

损失函数基于MSE(均方误差)计算,逐层对注意力分布进行优化,让模型在训练时就学会“正确复制参考细节、保留原有合理内容”。

5. 推理流水线:局部修复+掩码引导

推理阶段采用轻量化流程:

输入:参考图(正确细节)+ 待修复图(有不一致)+ 掩码/框选区域;

模型定位需要修复的局部区域;

细节编码器提取双图特征;

注意力对齐模块修正局部特征;

输出:保留整体风格、仅修正不一致的结果图。

6. 训练配置

环境:Python 3.10 + PyTorch + CUDA;

硬件:2×GPU,单卡batch size=4,总batch size=8;

训练步数:20,000步;

优化器:AdamW;

数据集:Critic-10K(1万组专业标注三元组)。

7. 核心文件结构

| 目录/文件 | 作用 |

|---|---|

| app.py | 启动Gradio交互式本地演示 |

| infer.py | 单案例推理脚本 |

| train.py | 模型训练入口 |

| src/ | 核心源码(注意力、编码器、流水线等) |

| download_kontext.py | 下载FLUX.1-Kontext-dev基座 |

| download_imageCritic.py | 下载ImageCritic修复模型 |

| download_dataset.py | 下载Critic-10K训练数据集 |

| test_imgs/ | 内置测试图像 |

| figure/ | 项目效果展示图 |

四、应用场景

ImageCritic聚焦AIGC后处理,可落地于内容创作、数字资产、电商设计、视觉研究、工业设计等多个领域,凡是需要高质量、高一致性AI生成图像的场景都能适用。

1. AI绘画与内容创作

修复Midjourney、FLUX、Stable Diffusion生成图像的细节错乱;

提升插画、海报、动漫角色的纹理一致性,让作品更精致;

多视角角色/场景生成时,保证各视角结构统一。

2. 电商与产品设计

生成商品展示图时,修复logo、花纹、文字、材质细节错误;

服装、鞋包、3C产品的AI可视化,确保局部特征与实物一致;

批量生成商品图时,统一细节质量,降低人工修图成本。

3. 数字资产与元宇宙内容

3D模型前置的2D生成图修复,保证纹理与结构可用于建模;

虚拟人、虚拟道具生成,修复服饰、配饰、五官细节;

游戏场景、道具生成,提升视觉一致性与真实感。

4. 图像编辑与二次创作

对编辑后的图像做细节校准,避免编辑后出现纹理断裂、结构错位;

局部替换物体时,保证新物体与原图风格、纹理自然融合;

老图修复、风格迁移后的细节一致性优化。

5. 学术研究与算法开发

作为AIGC一致性修复的基线模型,用于论文对比实验;

基于Critic-10K数据集开展图像质量增强、细节生成研究;

集成到多模态Agent,实现全自动图像生成→检测→修复闭环。

6. 工业视觉与设计可视化

工业零件、建筑效果图的AI生成图细节校准;

设计方案快速迭代时,保证细节一致性,提升方案可信度。

五、使用方法

ImageCritic的使用流程极简,分为环境配置→模型下载→推理测试三步,新手也能快速上手。

1. 环境配置

推荐使用Conda创建独立环境,避免依赖冲突:

# 创建环境 conda create -n imagecritic python=3.10 conda activate imagecritic # 安装依赖 pip install -r requirements.txt

依赖包含PyTorch、Transformers、Gradio、Diffusers等常用库,无需手动编译插件。

2. 模型下载

项目需要两个模型:基座FLUX.1-Kontext-dev + 修复模型ImageCritic,提供一键下载脚本:

# 下载FLUX.1-Kontext-dev(需替换脚本中的HF_TOKEN) python download_kontext.py # 下载ImageCritic修复模型 python download_imageCritic.py # (可选)下载训练数据集Critic-10K python download_dataset.py

也可通过Git LFS直接克隆Hugging Face仓库:

git lfs install git clone https://huggingface.co/ziheng1234/ImageCritic git clone https://huggingface.co/datasets/ziheng1234/Critic-10K

3. 快速推理(两种方式)

方式1:Gradio交互式界面(推荐新手)

启动本地网页界面,可视化操作:

python app.py

启动后打开浏览器访问本地地址,上传参考图(正确细节)与待修复图,框选/绘制需要修复的区域,点击运行即可看到对比效果。

方式2:单案例命令行推理

适合批量处理或集成到脚本:

python infer.py

脚本内置测试案例,可修改代码指定自己的图像路径、掩码路径、输出路径。

4. 使用技巧(官方建议)

低分辨率区域修复:扩大框选范围,包含目标区域+周边上下文,提升修复效果;

物体整体替换:先手动用黑色掩码覆盖待替换区域,再输入模型;

精细结构修复:尽量让参考图的对应区域清晰、无失真,提升对齐精度。

5. 训练(可选)

如果需要在自有数据上微调模型:

# 配置多GPU vim multi_gpu.yaml # 启动训练 python train.py

训练前确保已下载Critic-10K数据集,并修改配置中的数据路径。

六、常见问题解答

ImageCritic只能修复FLUX生成的图像吗?

不是。它以FLUX.1为基座,但可以修复Xverse、DreamO、MOSAIC、OmniGen2、UNO等主流扩散模型生成的图像,只要图像存在细节不一致问题都可尝试。

使用ImageCritic需要显卡什么配置?

建议显存≥10GB(如RTX 3080/3090/4080/4090、A10等),在消费级显卡上可正常运行推理,低显存显卡可开启模型半精度加速。

修复一张图需要多长时间?

单张图像局部修复通常在1-5秒内,取决于区域大小与显卡性能,远快于重新生成整张图像。

可以批量修复大量图像吗?

可以。基于infer.py脚本简单修改,编写循环即可实现批量处理,适合工业化流程。

为什么修复低分辨率小区域效果不好?

因为小区域可提取的特征有限。官方建议扩大框选范围,把目标区域与周边上下文一起选中,模型能更好地理解结构关系,修复效果会明显提升。

可以直接把一个物体换成另一个完全不同的物体吗?

不能直接替换差异过大的物体。ImageCritic基于局部修复与细节对齐,更适合“修正错误”而非“凭空创造”。如果需要替换物体,必须先用黑色掩码覆盖原物体,再引导模型生成。

参考图必须和待修复图内容完全一样吗?

不需要完全一样,但待修复的局部区域应与参考图对应区域语义一致。例如修复汽车轮毂,参考图需要提供清晰的轮毂样式,而车身、背景可以不同。

ImageCritic支持商业使用吗?

不支持。项目采用CC BY-NC 4.0协议,仅限非商业用途(学术研究、个人创作);商业使用需联系作者获得正式授权。

没有Hugging Face Token可以使用吗?

下载FLUX.1-Kontext-dev基座需要HF Token,这是模型版权要求。可免费注册Hugging Face账号并生成Token,替换到下载脚本中即可。

可以把ImageCritic集成到自己的项目/软件中吗?

可以。项目代码结构清晰,推理接口简单,可集成到Web应用、桌面软件、ComfyUI、工作流平台等,非商业用途可直接二次开发。

七、相关链接

Hugging Face模型:https://huggingface.co/ziheng1234/ImageCritic

Hugging Face数据集:https://huggingface.co/datasets/ziheng1234/Critic-10K

Hugging Face在线演示:https://huggingface.co/spaces/ziheng1234/ImageCritic

八、总结

ImageCritic是南开大学HVision实验室推出的专注于AI生成图像细节不一致修复的开源工具,基于参考引导注意力对齐技术,以FLUX.1-Kontext-dev为基座,通过细节编码器与注意力对齐损失,实现对局部区域的精准修复,有效解决扩散模型生成图像中常见的纹理错位、结构失真、细节错误等问题。项目提供完整的环境配置、模型下载、推理演示与训练流程,支持交互式可视化操作,兼容主流生成模型输出,可广泛应用于内容创作、电商设计、数字资产、学术研究等场景,以轻量高效的方式提升AI生成图像的细节质量与一致性,是AIGC后处理环节的实用开源方案,为研究者与开发者提供了可直接落地的图像一致性修复能力。

版权及免责申明:本文由@AI工具集原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/imagecritic.html