IntentOrch:开源意图驱动MCP编排引擎,自然语言一键自动化工具链执行

一、IntentOrch是什么

IntentOrch 是由 MCPilotX 团队开源的意图驱动型 Model Context Protocol(MCP)编排引擎,采用 TypeScript 编写,定位为应用与MCP服务之间的智能中间层。它的核心价值是把用户模糊的自然语言需求,自动转化为结构化、可执行、高可靠的多工具协同工作流,彻底解决传统LLM工具调用中步骤冗余、参数不匹配、执行容错差、开发成本高等痛点。

与传统指令式开发不同,IntentOrch遵循“只说要什么,不说怎么做”的设计理念,开发者无需手动编写API调用、参数解析、分支判断、异常捕获等代码,只需传入一句自然语言,引擎即可完成意图理解、流程规划、工具选择、参数映射、任务调度与结果返回全链路自动化。

它面向AI应用开发者、低代码平台、智能助手、自动化运维系统等使用者,以轻量化、高性能、强兼容的特性,降低MCP生态接入门槛,让自然语言驱动的复杂工具协同变得简单可控。

二、功能特色

IntentOrch围绕意图解析、流程编排、工具调度、执行保障四大核心环节,提供多项差异化能力,兼顾智能性、稳定性与易用性。

1. 混合意图解析引擎

采用规则启发式+LLM深度推理双路径解析,简单意图走高速规则通道,复杂意图调用大模型精准理解

支持歧义识别与主动澄清,低置信度场景自动向用户确认,避免错误执行

内置意图分类与实体抽取,自动提取时间、地点、对象、数值等关键参数

2. 极简流程分解策略

智能过滤冗余步骤,生成最短可执行DAG,减少LLM调用次数与Token消耗

自动合并重复操作、优化执行顺序,显著降低延迟与成本

支持分支判断与条件跳转,适配复杂业务逻辑

3. 自适应参数映射能力

跨MCP服务Schema智能对齐,自动匹配不同工具的参数命名差异(如path/filename、id/targetId)

支持类型自动转换、缺省值填充、参数校验与合法性修正

无需手动配置映射规则,降低集成调试成本

4. 高韧性DAG执行引擎

基于有向无环图实现任务编排,支持拓扑排序与依赖追踪

内置重试机制、降级策略、断点恢复,提升复杂流程稳定性

实时执行日志与状态追踪,便于问题定位

5. 多模型与多MCP兼容

支持OpenAI、DeepSeek、Ollama、通义千问等主流LLM提供商

可同时对接多个异构MCP服务器(GitHub、Slack、12306、数据库、云服务等)

提供标准化SDK,快速接入自定义MCP工具

6. 轻量化开箱即用

纯TypeScript实现,无 heavy 依赖,支持Node.js环境直接运行

提供完整示例工程与快速启动模板

支持npm一键安装,3步完成配置初始化

三、技术细节

IntentOrch采用分层架构设计,代码结构清晰,扩展性强,核心技术栈与运行原理如下。

1. 技术栈

开发语言:TypeScript(强类型保障,减少运行时错误)

运行环境:Node.js ≥16

依赖管理:npm/yarn/pnpm

测试框架:Jest

代码规范:ESLint + Prettier

构建工具:标准TSC编译

2. 核心架构分层

意图接入层:接收自然语言输入,完成清洗、分词、初步意图判定

解析决策层:选择规则/LLM解析器,输出结构化意图与参数

流程编排层:生成最简DAG,处理依赖、分支、循环逻辑

参数映射层:对接MCP工具Schema,完成参数对齐与校验

执行调度层:并发控制、重试、降级、断点恢复

结果聚合层:收集工具返回,格式化输出并支持多轮交互

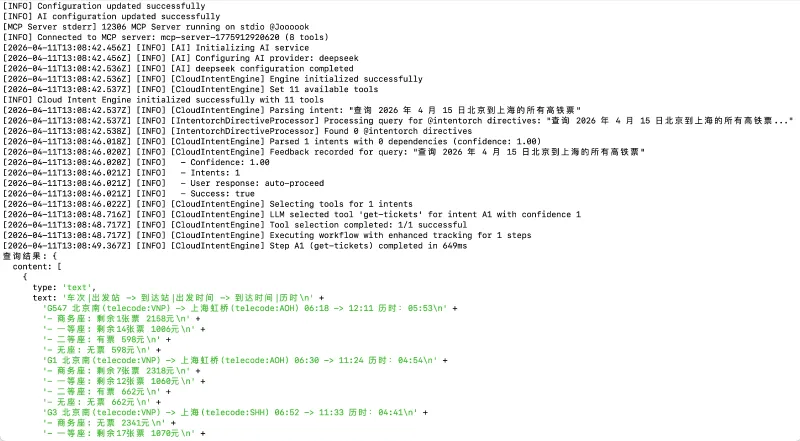

3. 核心执行流程

用户自然语言输入 → 意图解析 → 最简步骤分解 → DAG生成 → 参数映射 → MCP工具调用 → 执行监控 → 结果返回

4. 关键代码结构

// 核心初始化示例

import { IntentOrch } from '@mcpilotx/intentorch';

const engine = new IntentOrch({

llm: { provider: 'openai', apiKey: 'sk-xxx' },

mcpServers: [

{ name: 'github', endpoint: 'http://localhost:8080' },

{ name: 'slack', endpoint: 'http://localhost:8081' }

]

});

// 执行意图

const result = await engine.run('列出本仓库最新PR并发送到Slack #dev频道');

console.log(result);5. 性能优化点

意图解析缓存,重复请求直接命中,减少LLM调用

批量工具调用与并发调度,提升执行效率

增量参数传递,避免全量数据传输

轻量内存DAG,低资源占用

四、应用场景

IntentOrch适用于需要自然语言驱动多工具协同的各类场景,覆盖个人开发者、中小企业与企业级系统。

智能助手开发

办公助手:邮件收发、文档整理、日程安排、会议总结

出行助手:车票查询、酒店预订、导航规划

客服助手:自动查询订单、处理退款、同步物流信息

自动化运维

一句话执行服务器巡检、日志分析、服务重启

自动拉取代码、构建部署、发送部署通知

数据库备份、清理、权限检查

业务流程自动化

电商:订单同步、库存查询、售后自动处理

金融:账单查询、转账提醒、报表生成

教育:作业批改、成绩统计、通知推送

低代码与AI应用平台

作为编排能力插件,快速为平台添加自然语言自动化

支持自定义工具接入,扩展平台能力边界

开发者效率工具

代码审查、Issue管理、PR合并、文档生成一键完成

多项目批量操作,提升研发效率

五、使用方法

IntentOrch提供极简接入流程,开发者可快速完成集成与使用。

1. 环境准备

安装Node.js 16及以上版本

准备LLM API Key(OpenAI/DeepSeek等)

启动需要对接的MCP Server

2. 安装依赖

npm install @mcpilotx/intentorch # 或 yarn add @mcpilotx/intentorch

3. 基础配置与初始化

import { IntentOrch } from '@mcpilotx/intentorch';

// 配置引擎

const orch = new IntentOrch({

llm: {

provider: 'openai',

config: { apiKey: 'your-api-key', model: 'gpt-3.5-turbo' }

},

// 对接MCP服务

mcpServers: [

{ name: 'github', url: 'http://127.0.0.1:8080' },

{ name: 'slack', url: 'http://127.0.0.1:8081' }

],

// 执行策略

execution: { maxRetries: 2, timeout: 30000 }

});4. 执行自然语言意图

// 单意图执行

async function runTask() {

const res = await orch.run('查询GitHub上IntentOrch仓库的Star数并发送到Slack');

console.log('执行结果:', res);

}

runTask();5. 高级用法

批量意图队列执行

自定义解析规则与映射表

开启交互式确认模式

接入自定义MCP工具

执行日志持久化

六、竞品对比

下表对比IntentOrch与主流同类工具,突出其在MCP原生支持、意图分解、参数自适应等方面的优势。

| 对比维度 | IntentOrch | LangGraph | AutoGPT |

|---|---|---|---|

| 核心定位 | MCP原生意图编排引擎 | 通用LLM工作流编排框架 | 自主AI智能体框架 |

| 开发语言 | TypeScript | Python | Python |

| MCP协议支持 | 原生深度支持 | 需扩展适配 | 无原生支持 |

| 意图解析 | 规则+LLM混合解析 | 纯LLM驱动 | 纯LLM自主决策 |

| 流程分解 | 极简步骤优化 | 手动定义+LLM生成 | 自主迭代易冗余 |

| 参数映射 | 自适应Schema对齐 | 需手动配置 | 无内置映射 |

| 执行容错 | DAG+重试+断点恢复 | 有限恢复能力 | 易失败中断 |

| 上手成本 | 低,3步快速接入 | 中,需学习工作流语法 | 高,需配置复杂Prompt |

| 适用场景 | MCP工具链自动化 | 复杂多步骤LLM应用 | 开放式自主任务 |

七、常见问题解答

IntentOrch必须依赖OpenAI吗?

不是,它支持OpenAI、DeepSeek、Ollama、通义千问、文心一言等主流大模型,只需在配置中切换provider即可。

对接MCP服务需要编写大量代码吗?

不需要,只需在初始化时传入MCP Server地址,引擎自动发现工具并完成适配,无需手动编写调用逻辑。

执行失败后可以恢复吗?

可以,引擎内置断点恢复机制,支持失败重试、步骤跳过与手动干预,保障流程韧性。

可以在浏览器环境使用吗?

当前版本主要面向Node.js服务端环境,浏览器版本正在规划中,目前可通过Node.js中间层提供接口调用。

个人非商业使用需要授权吗?

IntentOrch采用开源协议,个人非商业使用可免费自由使用,商业使用请遵循仓库LICENSE文件说明。

如何添加自定义MCP工具?

可通过官方SDK注册自定义工具Schema,引擎会自动纳入编排体系,支持参数解析与调用。

执行速度慢如何优化?

可开启缓存、使用轻量模型、减少MCP服务数量、调整并发数,同时升级Node.js版本提升运行效率。

八、相关链接

九、总结

IntentOrch作为一款面向MCP生态的意图驱动编排引擎,以TypeScript为技术底座,通过混合意图解析、极简流程分解、自适应参数映射与高韧性DAG执行,将自然语言需求高效转化为稳定可靠的工具链执行流程,大幅降低LLM工具调用与MCP生态集成的开发成本,同时提升执行效率与稳定性,广泛适配智能助手、自动化运维、业务流程编排、低代码平台等场景,为开发者提供轻量化、高性能、易扩展的自然语言自动化编排能力,是MCP协议生态中实用且高效的开源工具组件。

要不要我帮你把这篇文档精简到2000字左右,同时保留所有核心模块和格式?

版权及免责申明:本文由@dotaai原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/intentorch.html