JoyAI-Image:京东开源的统一多模态图像基础模型,支持精准空间操控与长文本渲染

一、JoyAI-Image是什么?

JoyAI-Image是京东科技JoyAI大模型体系下的开源多模态图像基础项目,定位为面向产业级应用的统一图像大模型基座,彻底打破传统图像模型“理解、生成、编辑”相互割裂的技术瓶颈,通过MLLM与MMDiT的闭环协同,实现AI对图像空间关系、布局结构、文本语义的深度理解与精准操控。

该项目核心解决行业三大痛点:一是传统模型空间推理能力薄弱,难以完成视角变换、物体定位等精准操作;二是长文本与复杂排版渲染失真,无法满足海报、漫画、说明书等场景需求;三是多模型部署成本高,理解与生成模块无法互通导致效果割裂。JoyAI-Image以一套架构支撑全链路图像任务,兼顾技术先进性与工程实用性,模型权重同步开放至Hugging Face,支持本地部署与API调用,为中小企业、开发者、研究机构提供零门槛的多模态视觉能力。

项目核心技术路线为“理解驱动生成”,通过增强空间感知的多模态大语言模型解析图像语义与空间结构,再由高性能扩散Transformer完成生成与编辑,配合京东自研的空间数据集与训练策略,在空间编辑、文本渲染、多视角一致性等核心指标上超越主流开源图像模型,是国内少数具备企业级商用能力的开源多模态图像项目。

二、功能特色

JoyAI-Image构建了“理解-生成-编辑”三位一体的能力体系,所有功能基于统一架构实现,无需切换模型即可完成全流程操作,核心特色可归纳为六大维度:

1. 统一多模态任务支撑

覆盖图像视觉理解:支持图像问答、物体检测、空间关系推理、文本提取与语义解析

覆盖文本到图像生成:支持中文原生创意生成、商品图生成、场景图生成、多视角同步生成

覆盖指令引导图像编辑:支持局部修改、物体增删、视角变换、风格迁移、长文本排版优化

支持多图像协同编辑,保持角色、场景、品牌视觉一致性,避免内容漂移

2. 顶尖空间智能能力

支持相机视角精准控制:可通过自然语言指定偏航角(yaw)、俯仰角(pitch)、缩放比例,生成高保真新视角图像

支持空间物体精准操控:指定物体位置、旋转角度、大小比例,编辑后保留场景光照与结构完整性

支持空间歧义消除:通过诊断性视角生成,解决复杂场景空间关系识别错误问题

支持三维空间感知,突破平面编辑局限,实现类3D操控效果

3. 长文本与复杂排版渲染

支持密集多行文本、多语言混合、手写风格、艺术字体的高可读渲染

适配漫画分镜、海报文案、产品说明书、表单表格等复杂布局场景

解决传统模型文字错乱、重叠、缺失、语义失真问题,文本识别准确率提升显著

支持实景文字嵌入,保持与场景透视、光照、材质一致性

4. 高保真场景保留能力

编辑过程中完整保留场景布局、光影效果、透视关系,无突兀篡改痕迹

多轮编辑仍保持物体形态、角色特征、场景风格稳定

支持局部精细化编辑,不影响图像其他区域内容

生成图像具备4K及以上超高分辨率输出能力

5. 轻量化高效部署

模型架构优化,推理速度优于同等参数规模开源模型

支持Flash-Attention加速,降低GPU显存占用

提供开箱即用推理脚本,无需复杂二次开发即可部署

支持CPU/GPU混合推理,适配不同硬件环境

6. 开源开放与产业适配

采用Apache 2.0开源协议,允许商用、修改、分发

模型权重、推理代码、训练策略全开源,无隐藏限制

深度适配电商、传媒、教育、工业等场景,内置中文优化与行业先验

提供完整技术文档与示例,降低开发者接入成本

三、技术细节

JoyAI-Image采用双核心闭环架构,技术栈以Python为主,依托PyTorch、Transformers、Diffusers等主流AI框架,核心技术设计如下:

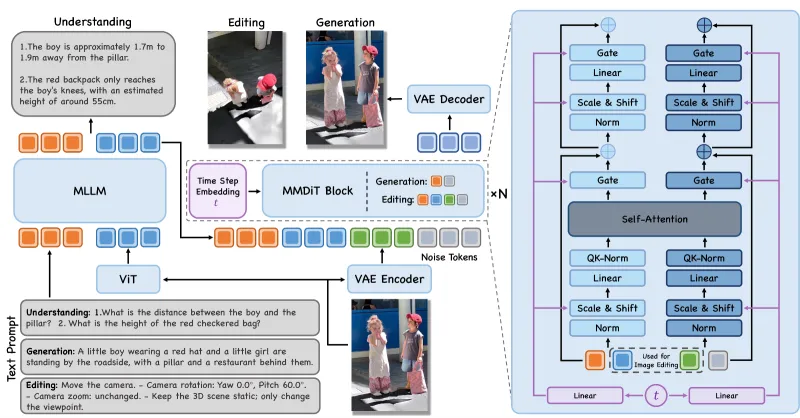

1. 整体架构组成

项目由三大核心模块构成,实现理解与生成的双向联动:

空间增强MLLM(80亿参数):多模态大语言模型,专项优化空间关系推理、文本语义理解、编辑指令解析,作为整个系统的“大脑”

多模态扩散Transformer MMDiT(160亿参数):双流架构设计,共40层Transformer层,负责图像生成与编辑的核心计算,兼顾生成质量与速度

高性能VAE编码器:负责图像隐空间编码与解码,保障图像高清还原与细节保留

2. 关键技术创新

MLLM-MMDiT统一接口

两套模型共享语义编码空间,理解结果直接作为生成条件,避免多模型特征错位,提升空间操控精准度。空间感知训练体系

基于OpenSpatial空间理解数据集、SpatialEdit编辑数据集、长文本渲染数据集,总量超300万标注样本,多阶段训练强化空间推理能力。双流扩散生成机制

MMDiT采用双流结构,分别处理语义特征与空间特征,在生成时同步约束内容准确性与布局合理性,解决文本扭曲、空间错乱问题。视角合成与空间校准

内置相机参数建模模块,可根据文本指令计算空间变换矩阵,生成的新视角图像符合物理透视规则,无伪影与畸变。

3. 模型家族与版本

| 模型名称 | 核心任务 | 参数规模 | 开源状态 |

|---|---|---|---|

| JoyAI-Image-Und | 图像理解、空间推理 | 8B MLLM | 已开源 |

| JoyAI-Image-Edit | 指令引导图像编辑 | 8B+16B | 已开源 |

| JoyAI-Image-Edit-Plus | 多图协同编辑、一致性生成 | 8B+16B | 待发布 |

| JoyAI-Image | 文本到图像生成 | 8B+16B | 待发布 |

4. 技术依赖与环境要求

# 核心依赖版本 torch>=2.8.0 transformers>=4.57.0,<4.58.0 diffusers>=0.34.0 flash-attn>=2.8.0 accelerate>=0.27.0 pillow>=10.0.0

系统:Linux(推荐Ubuntu 20.04+)

Python:3.10及以上

GPU:支持CUDA 11.7+,显存≥24GB(推荐40GB+)

内存:≥32GB

四、应用场景

JoyAI-Image的空间智能与全链路能力,可覆盖商业设计、内容创作、工业视觉、教育出版、零售电商等多个领域,具体场景如下:

1. 电商商品设计

商品主图批量生成与编辑,快速替换背景、调整摆放角度

商品详情图长文本渲染,参数说明、功能标注清晰可读

多视角商品图自动生成,提升用户浏览体验

店铺海报、活动banner快速制作,支持复杂排版与艺术字

2. 创意内容创作

漫画、分镜脚本生成,支持多格布局与对话文本渲染

影视概念图、场景图设计,精准控制空间布局与视角

自媒体封面、短视频配图制作,高效产出高质量视觉内容

艺术创作与风格化生成,保留创意同时优化空间结构

3. 工业与视觉检测

设备图纸标注与空间解析,辅助工程师理解结构关系

产品缺陷图像编辑与视角还原,提升检测准确性

三维场景二维化呈现,降低工业视觉建模成本

安防监控图像增强与关键区域编辑

4. 教育与出版场景

教材插图生成与修改,支持公式、文字、图表精准渲染

绘本、儿童读物内容制作,多视角画面保持角色一致

教学PPT、课件配图快速生成,适配课堂展示需求

古籍、文档图像修复与文本还原

5. 企业办公与设计

企业宣传物料快速制作,品牌视觉统一可控

数据图表与图像结合生成,提升报告可读性

产品演示图视角优化,突出核心功能

内部培训材料配图自动化生产

五、快速使用方法

1. 环境搭建步骤

# 1. 创建并激活虚拟环境 conda create -n joyai python=3.10 -y conda activate joyai # 2. 克隆项目代码 git clone https://github.com/jd-opensource/JoyAI-Image.git cd JoyAI-Image # 3. 安装项目依赖 pip install -e . # 4. 下载模型权重 # 从Hugging Face下载JoyAI-Image-Edit、JoyAI-Image-Und权重至本地ckpts目录

2. 图像理解推理

python inference_und.py \ --ckpt-root ./ckpts \ --image-path ./test_images/demo.jpg \ --query "请描述图像中的物体位置与空间关系"

3. 图像编辑推理

python inference.py \ --ckpt-root ./ckpts \ --image-path ./test_images/demo.jpg \ --prompt "将相机向右旋转30度,保持场景完整性" \ --output-path ./output/result.jpg

4. 部署与调用说明

本地推理:直接运行脚本,支持单张图像批量处理

服务化部署:可封装为FastAPI接口,支持HTTP调用

批量处理:编写循环脚本,批量处理文件夹内图像

参数调优:可通过修改prompt、温度系数、采样步数优化生成效果

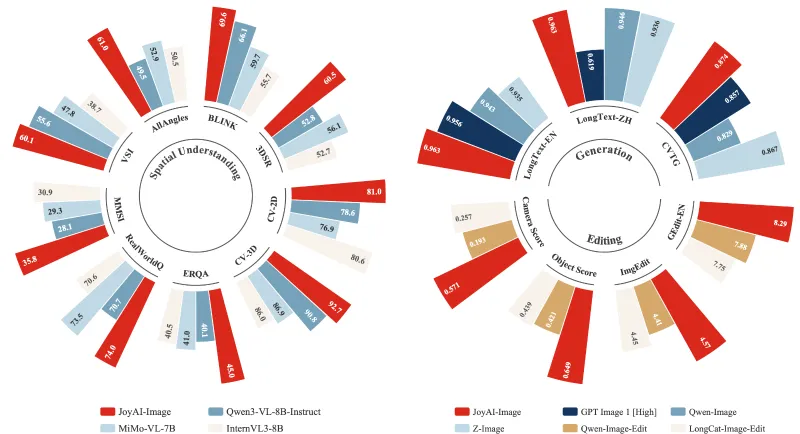

六、主流竞品对比

JoyAI-Image与Qwen-Image-Edit、Nano Banana Pro为当前开源图像编辑领域代表性模型,核心对比如下:

| 对比维度 | JoyAI-Image | Qwen-Image-Edit | Nano Banana Pro |

|---|---|---|---|

| 核心优势 | 空间智能、长文本、统一架构 | 文本生成、中文适配 | 速度快、轻量级 |

| 空间编辑能力 | 极强,支持精准视角操控 | 中等,平面编辑为主 | 较弱,基础变换 |

| 长文本渲染 | 优秀,复杂排版无失真 | 良好,密集文本易错乱 | 一般,易出现重叠 |

| 多视角一致性 | 顶尖,场景结构完整 | 一般,易出现畸变 | 较差,易内容漂移 |

| 模型架构 | 理解+生成统一闭环 | 生成为主,理解较弱 | 纯生成模型 |

| 开源协议 | Apache 2.0(可商用) | 开源商用友好 | 部分功能受限 |

| 产业适配 | 电商、工业深度优化 | 通用内容创作 | 轻量化创意场景 |

对比结论:JoyAI-Image在空间操控、场景保留、长文本渲染、任务统一性上全面领先,更适合需要精准视觉控制的企业级场景;Qwen-Image-Edit擅长通用文本图像生成,Nano Banana Pro侧重轻量化快速生成,三者定位形成明显差异。

七、常见问题解答

JoyAI-Image是否完全开源?

是的,项目代码、推理脚本、模型权重均采用Apache 2.0协议开源,支持个人学习与商业使用,仅需保留版权声明。

运行JoyAI-Image需要什么配置的GPU?

推荐使用显存≥24GB的NVIDIA显卡(如RTX 4090、A10、A100),最低配置为16GB显存,可通过降低分辨率与采样步数运行。

该模型支持Windows系统吗?

官方主要支持Linux系统,Windows可通过WSL2或Docker容器运行,部分依赖需手动编译适配。

如何解决生成图像文字错乱的问题?

可优化prompt,明确文本内容、位置、字体风格;同时提高采样步数,使用官方提供的长文本专用推理参数。

JoyAI-Image支持4K分辨率输出吗?

支持,模型可输出4K及以上超高分辨率图像,需更高显存配置,推理时间会相应增加。

模型推理速度较慢如何优化?

可开启Flash-Attention加速,降低采样步数,使用FP16半精度推理,或选用更高规格GPU。

可以用于商业产品开发吗?

可以,Apache 2.0协议允许商用,无需支付授权费用,建议遵守开源协议条款。

JoyAI-Image与JoyAI其他模型的关系?

JoyAI-Image是JoyAI大模型体系的视觉子模块,可与JoyAI-LLM语言模型联动,构建全模态智能应用。

八、相关链接

GitHub项目地址:https://github.com/jd-opensource/JoyAI-Image

Hugging Face模型仓库:https://huggingface.co/jdopensource/JoyAI-Image-Edit

京东JoyAI官方平台:https://jdai.jd.com/portal

项目技术论文:https://joyai-image.s3.cn-north-1.jdcloud-oss.com/JoyAI-Image.pdf

九、总结

JoyAI-Image作为京东开源的企业级多模态图像基础模型,以空间智能为核心突破点,通过80亿参数MLLM与160亿参数MMDiT的统一架构,实现图像理解、文本生成图像、指令引导图像编辑三大任务的无缝协同,解决了传统模型空间推理薄弱、长文本渲染失真、多任务部署复杂的行业痛点,在空间编辑精准度、场景结构保留、多视角一致性、复杂排版渲染等关键指标上达到开源模型领先水平,同时以Apache 2.0协议全面开源,提供简洁易用的推理脚本与完善技术文档,适配电商设计、内容创作、工业视觉、教育出版等多元产业场景,既满足科研机构的研究需求,也为中小企业与开发者提供低成本、高可用的AI视觉解决方案,是当前开源图像领域兼具技术先进性与工程实用性的优质项目。

版权及免责申明:本文由@dotaai原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/joyai-image.html