Gemma 4 12B:谷歌开源的多模态大模型,8GB内存即可本地运行图文音全模态AI助手

Gemma 4 12B是Google DeepMind开源的稠密架构多模态大模型,隶属于Gemma 4全系产品线,参数规模约11.95B(统称120亿参数),分为google/gemma-4-12B预训练基座(Base)、goog...

Gemma 4 12B是Google DeepMind开源的稠密架构多模态大模型,隶属于Gemma 4全系产品线,参数规模约11.95B(统称120亿参数),分为google/gemma-4-12B预训练基座(Base)、goog...

Mellum2是JetBrains开源的MoE架构大模型,总参12B推理仅激活2.5B参数,支持128K超长上下文,分Base/Instruct/Thinking三大版本,主打离线IDE编程、企业私有化RAG、AI智能体...

Qwen‑VLA是阿里通义千问推出的开源通用视觉‑语言‑动作统一具身智能模型,基于Qwen多模态基座构建,通过四阶段训练实现视觉感知、语言理解与连续动作生成的端到端融合,单...

Step‑3.7‑Flash是阶跃星辰开源的生产级Agent专用多模态大模型,采用稀疏MoE架构,总参数198B、激活参数11B,最高生成速度400 Tokens/s,支持256K上下文与三级推理级别。模...

Keye-VL-2.0-30B-A3B是快手开源的30B级旗舰多模态大模型,采用DSA稀疏注意力架构,支持256K超长上下文无损推理,长视频理解性能领先同级别模型;原生集成Code/Tool/Search全...

Command A+是CohereLabs推出的Apache2.0协议开源稀疏混合专家大模型,拥有2180亿总参数,支持128K超长上下文、图文多模态交互、48种语种处理与智能工具调用,提供多精度量化...

Confucius4也被称作子曰4,是网易有道人工智能研发团队依托通义千问Qwen3.5-27B基座模型深度二次开发打造的开源多模态大语言模型,整体参数规模达到27B,该模型核心研发方向...

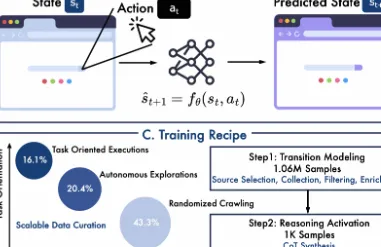

WebWorld 是由阿里通义千问QwenLM团队重磅开源的大规模网页世界模型,依托通义千问3大模型底座构建,是专门为网页智能体(Web Agent) 量身打造的浏览器仿真模拟环境框架。

Ling-2.6-1T 是蚂蚁集团旗下 inclusionAI 团队推出的万亿参数开源旗舰大语言模型,隶属于百灵Ling大模型家族,是面向真实复杂业务场景打造的即时执行型通用大模型。模型整体...

HY-Embodied-0.5-X 是腾讯混元Hunyuan团队联合腾讯Robotics X实验室共同研发并正式开源的具身多模态基础大模型,项目完整托管于GitHub开源社区,全程开源开放,面向全球开发...

Hy3 preview是腾讯混元大模型团队重建预训练和强化学习基础设施后推出的首个混合专家模型,总参数量295B,激活参数21B,最大支持256K上下文长度,主打快慢思考融合与高性价...

Qwen3.6-27B是阿里云通义千问团队于2026年4月推出并开源的270亿参数稠密多模态大模型,以“小参数、强性能”为核心定位,在智能体编程领域实现旗舰级突破,全面超越前代397...

DeepSeek-V4是深度求索(DeepSeek)于2026年4月推出的新一代开源混合专家(MoE)大语言模型,分为V4-Pro(1.6T总参数)与V4-Flash(284B总参数)双版本,全系标配100万Toke...

Qwen3.6-35B-A3B是阿里云通义实验室(通义千问团队)开源的稀疏混合专家(MoE)架构多模态大语言模型,是Qwen3.6系列的首款开源权重版本,采用Apache-2.0开源协议,可免费商...

GLM-5.1是智谱AI推出的旗舰级开源大模型,定位为"高阶推理旗舰",主打"超长文本+高阶推理+强代码能力"三大核心能力,是全球首个能独立完成8小时级复杂工程任务的开源模型。