LongCat-Next:美团原生全模态大模型,统一离散Token实现图文声全域交互生成

一、LongCat-Next简介

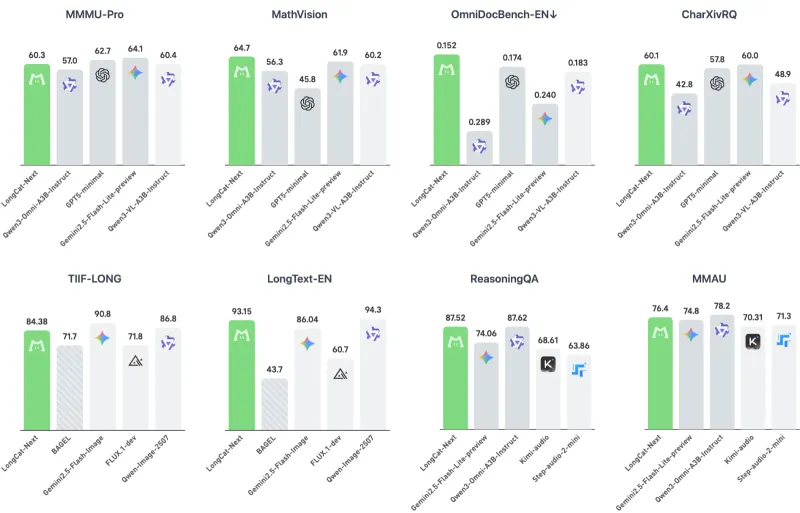

LongCat-Next是美团旗下LongCat(龙猫)团队开源的工业级原生多模态基础大模型,核心摒弃传统多模态模型“语言基座外挂视觉、音频模块”的拼凑式架构,创新性打造纯离散自回归底层逻辑,将文本、图像、音频三类物理世界信号统一转化为同源离散Token,依托单一“下一个Token预测(NTP)”通用目标完成全模态建模。

该模型定位为通用型全模态AI基座,基础激活参数约3B,配套开源专属分词器、技术报告、部署脚本及可视化资源,同时搭载自研LoZA稀疏注意力机制与DiNA离散原生自回归架构,兼顾超长上下文处理能力、多模态理解生成精度与推理算力效率。区别于市面多数拼接式多模态模型,LongCat-Next实现了视觉、语音与文本的深度原生融合,让图像、音频信号成为AI的“原生母语”,而非后期适配的附加功能。

从版本划分来看,项目提供两类适配落地的核心版本,覆盖科研高精度与工程轻量化双重需求:

| 模型版本 | 核心定位 | 适配场景 | 性能亮点 |

|---|---|---|---|

| Flash-Exp版 | 高精度复杂科研任务 | 学术研究、多模态深度推理、专业内容生成 | 保留全量模态精度,适配极致效果需求 |

| 轻量化通用版 | 工程落地、普惠部署 | 企业轻量化应用、低算力场景开发、常规交互生成 | 算力损耗更低,推理速度更快,适配主流硬件 |

整体而言,LongCat-Next不仅是一款可实现图文声输入输出的生成模型,更是一套完整的全模态离散AI底层解决方案,为开发者提供从模型基座、分词工具到部署落地的全链路开源支撑。

二、LongCat-Next功能特色

2.1 全域原生多模态融合能力

LongCat-Next彻底打破模态隔阂,支持文本、图像、音频三大模态的双向交互:输入可兼容纯文字、图片、语音,输出可生成流畅文案、高清图像、定制化语音。依托统一离散Token空间,模型理解图像语义、解析语音内容时,无需额外跨模态映射适配,从根源避免传统模型“理解偏差、生成割裂”的问题。即便图像信号压缩比例达到28倍,依旧能保留细腻视觉细节与精准语义逻辑,生成画质、语音流畅度均达到开源顶尖水准。

2.2 超强超长上下文推理性能

搭载自研LoZA(LongCat ZigZag Attention)稀疏注意力机制,是项目标志性功能亮点。系统可自动智能筛查注意力模块重要性,将50%低价值计算模块替换为流式稀疏注意力,在零明显精度损耗的前提下大幅降低算力消耗。实测数据显示,128K上下文场景下,模型解码速度较传统Transformer架构提升10倍,整体算力成本节省30%,最高可支持100万Token(1M)超长上下文处理,完美适配长文档解析、长篇图文创作、大段语音转写理解等复杂场景。

2.3 语义完备的离散化生成能力

解决行业长期痛点:传统离散视觉建模易出现细节丢失、语义模糊的问题。LongCat-Next结合语义对齐编码器(SAE)与残差向量量化(RVQ)技术,构建分层离散视觉Token,既保留高层语义抽象能力,又兼顾底层像素级细节;搭配dNaViT离散原生分辨率视觉Transformer,打造标准化“视觉词典”,让图像像文字一样可分词、可推理、可生成。同时强化中文场景适配,文本渲染能力突出,覆盖八千余个常用汉字,中文图文生成、文字嵌入图像的精度表现优异。

2.4 轻量化开源易用生态

项目全量开源核心代码、模型权重、分词器工具及配套技术文档,遵循MIT开源协议,开放商用适配空间。仓库内置完整环境配置文件、部署脚本、测试案例与可视化素材,开发者无需深度自研底层模块,即可快速调用多模态能力。同时适配主流深度学习框架与推理加速工具,兼容二次开发、模型微调、定制化部署等拓展需求。

2.5 低延迟实时交互能力

针对语音对话、实时图文编辑等落地场景优化推理链路,实现低延迟响应。支持定制化语音克隆、低时延语音交互、实时图像修改编辑,兼顾实用性与个性化;无论是智能客服语音交互、实时图文创作,还是短视频音频配文,均可实现流畅稳定的实时输出。

三、LongCat-Next技术细节

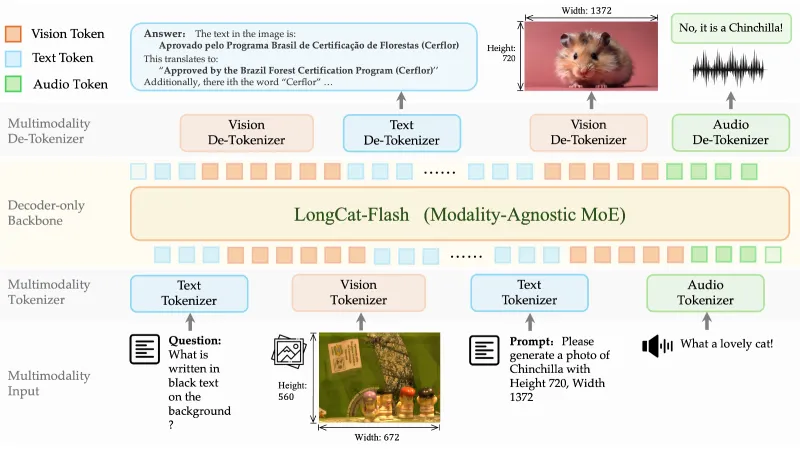

3.1 核心架构:DiNA离散原生自回归架构

DiNA(Discrete Native Autoregressive)是整个项目的底层核心架构,彻底重构多模态建模逻辑:

统一建模目标:全程仅沿用大语言模型成熟的“下一个Token预测”单一目标,不新增复杂跨模态适配分支,简化整体模型逻辑;

模态通用分词:研发模态专属分词器-反分词器组合,将图像、音频、文本全部编码为共享空间内的离散Token,实现“万物皆可Token化”;

原生推理贯通:视觉理解、图像生成、语音解析、语音生成均依托同一推理链路完成,消除传统架构中“理解模块与生成模块割裂”的缺陷,保障全模态能力协同统一。

该架构最大优势在于可完全复用现有大语言模型的训练、优化、部署基础设施,大幅降低多模态模型的研发与落地门槛,同时保障模型性能无衰减。

3.2 视觉核心模块:dNaViT离散原生分辨率视觉Transformer

dNaViT是专为视觉模态打造的标准化离散接口,类比文字分词器实现图像结构化拆解:

动态分词适配:可根据图像分辨率、内容复杂度灵活调整视觉Token粒度,兼顾全局语义与局部细节;

分层特征提取:构建多级视觉Token体系,高层Token把控整体场景语义,低层Token保留纹理、色彩、轮廓等细节;

无缝跨模融合:提取的视觉Token可直接接入主模型自回归推理,与文本、音频Token无障碍交互,无需额外特征转换。

搭配SAE语义对齐编码器,彻底解决离散化带来的信息损耗问题,让视觉离散Token的语义精准度比肩连续特征建模方案。

3.3 效率核心:LoZA稀疏注意力优化机制

作为超长上下文能力的技术支撑,LoZA机制分为两大核心执行步骤:

第一步,智能重要性筛查:为每一个注意力计算模块配置可学习权重,模型自动识别低相关性、低价值的冗余模块,全程无需人工设置规则;

第二步,交错稀疏替换:将筛选出的50%低价值模块,替换为轻量化流式稀疏注意力(SSA),形成ZigZag交错计算结构,大幅减少冗余算力消耗。

该优化无需改造模型主体架构,仅通过注意力层轻量化调整,即可实现超长文本、长图文内容的高效推理,大幅降低高端硬件依赖。

3.4 训练与优化体系

模型采用阶梯式渐进训练策略:先完成单模态预训练(文本、图像、音频独立学习),再开展多模态联合对齐训练,最后通过指令微调强化交互与生成能力。同时引入美学奖励模型、OCR精度优化策略,针对性提升中文图文生成、文字渲染、图像编辑的落地效果。训练全程依托统一离散Token空间,保障不同模态学习进度协同,避免出现单模态能力强弱失衡的问题。

四、LongCat-Next应用场景

4.1 AIGC内容创作领域

可支撑全品类智能内容生成,包括文生图、图改图、图文结合创作、语音文案生成、短视频音频配文等。自媒体创作者、设计从业者可依托模型快速产出原创图文素材、定制化配音、创意图片编辑内容;企业宣传物料、营销图文、短视频文案均可实现AI一键生成,大幅提升内容创作效率。

4.2 智能交互与客服领域

凭借低延迟语音交互、超长上下文理解能力,可搭建全模态智能客服系统:支持用户文字提问、图片反馈问题、语音咨询需求,模型同步解析多模态信息,精准回复并生成图文解决方案;同时适配智能家居语音交互、智能终端实时对话,实现自然流畅的全域人机交互。

4.3 教育与科研领域

科研团队可基于开源基座开展多模态AI底层研究,探索离散Token建模、超长上下文推理、跨模态融合的创新方向;教育场景中,可实现图文课件智能生成、语音知识点讲解、错题图文解析、长篇学习资料总结梳理,依托百万级上下文能力,完成整本教材、长篇文献的深度解析与知识提炼。

4.4 企业数字化办公领域

适配长文档智能解析、图文报告自动生成、会议语音转写总结、海量资料图文归档梳理等办公场景。针对企业长篇合同、技术文档、项目资料,模型可快速提炼核心信息、生成摘要、制作图文简报;会议录音可实时转写、梳理重点、生成结构化文案,赋能办公数字化升级。

4.5 图像音频定制化开发领域

支持二次开发定制化图像编辑工具、语音克隆工具、个性化配音系统。开发者可基于模型轻量化接口,搭建专属AI修图、图文嵌入、定制语音合成应用,覆盖电商图片优化、个人影音创作、小众个性化音频制作等细分场景。

五、LongCat-Next使用方法

5.1 前置硬件环境要求

为保障模型稳定运行与推理效率,官方明确基础硬件门槛:

最低配置:3张80GB显存GPU(H100、A100 80GB及以上型号);

推荐配置:多卡集群部署,适配超长上下文推理与批量生成任务;

轻量化测试:普通算力设备仅可运行简易demo,复杂多模态生成需严格匹配显存要求。

5.2 软件环境依赖配置

严格适配以下版本依赖,避免兼容性报错:

Python版本:≥3.10;

PyTorch版本:≥2.6;

Transformers版本:≥4.57.6;

Accelerate版本:≥1.10.0;

附加工具:ffmpeg<7、soundfile==0.13.1,保障音频、视频相关功能正常运行。

5.3 环境快速安装步骤

克隆官方GitHub仓库至本地:

git clone https://github.com/meituan-longcat/LongCat-Next.git cd LongCat-Next

通过conda快速创建专属虚拟环境,一键加载配置:

conda env create -f environment.yml -v conda activate LongCat-Next

手动校验附加依赖版本,补装指定工具库,确保音频、图像处理组件完整。

5.4 基础调用与推理实操

加载预训练模型与dNaViT视觉分词器,接入推理脚本;

输入支持多格式数据:纯文本指令、本地图片文件、音频录音文件;

选择生成模式:文本续写、图像生成、语音合成、图文联动编辑;

执行推理命令,等待输出结果,支持实时预览生成内容与导出本地文件;

进阶开发者可基于仓库内config配置文件,自定义生成分辨率、上下文长度、推理速度等参数,适配个性化需求。

5.5 二次开发与微调拓展

仓库开放模型微调接口与数据集适配模块,开发者可导入专属行业数据集,开展垂直领域模型微调;同时支持集成至WebUI、第三方AI平台、本地应用程序,通过API接口实现快速功能嵌入。

六、LongCat-Next常见问题解答(FAQ)

问题1:LongCat-Next是否完全开源,支持商用吗?

答:该项目核心代码、模型权重、分词器工具均已全量开源,遵循MIT开源协议,普通商用场景可直接适配使用;若涉及大规模商业化落地、模型二次封装售卖,需提前查阅仓库内开源细则,确认授权范围后再落地。

问题2:普通家用显卡能不能运行LongCat-Next完整功能?

答:不能。完整多模态生成、超长上下文推理必须满足3张80GB及以上显存的专业GPU;家用消费级显卡仅可运行极简demo查看基础效果,无法支撑高清图像、长语音、百万级上下文的复杂生成任务。

问题3:LongCat-Next和传统拼接式多模态模型有什么核心区别?

答:传统模型是“大语言模型+外挂视觉/音频模块”,模态融合生硬,易出现生成割裂、理解偏差;LongCat-Next采用原生离散自回归架构,所有模态统一Token化、统一推理,从底层实现深度融合,精度更高、算力效率更优,架构也更简洁。

问题4:部署过程中出现ffmpeg版本报错该怎么解决?

答:严格按照官方要求降级ffmpeg至7以下版本,同时锁定soundfile版本为0.13.1;卸载本地高版本音视频工具库,重新匹配环境配置文件内的依赖参数,重启虚拟环境后即可修复报错。

问题5:模型支持自定义图像分辨率与语音音色调整吗?

答:支持。开发者可通过修改仓库内配置文件,自定义图像生成分辨率、画质压缩比例;语音模块支持音色微调、个性化语音克隆,可适配不同场景的音频定制需求。

问题6:1M超长上下文功能需要额外开启插件吗?

答:不需要。LoZA稀疏注意力机制为模型原生内置功能,无需加装第三方插件,仅需在推理配置中调大上下文参数,即可自动激活超长文本、长图文的高效推理能力。

问题7:中文图文生成的文字渲染精度怎么样?

答:项目针对性优化中文场景,覆盖八千余个常用汉字,搭配OCR与美学奖励模型,中文文字嵌入图像、图文联动生成的精度表现优异,可满足常规商用图文创作需求。

七、相关链接

GitHub开源主仓库:https://github.com/meituan-longcat/LongCat-Next

Hugging Face模型库:https://huggingface.co/meituan-longcat/LongCat-Next

八、总结

LongCat-Next作为美团龙猫团队推出的原生全模态开源大模型,凭借DiNA离散原生自回归架构、dNaViT视觉分词器与LoZA稀疏注意力三大核心技术,彻底革新了传统多模态模型的拼接式设计思路,实现文本、图像、音频的全域原生融合建模,既突破了离散视觉建模的长期性能瓶颈,又大幅提升了超长上下文推理的算力效率与生成精度。项目全链路开源、部署文档完善、适配场景广泛,兼顾学术科研的高精度需求与企业落地的轻量化开发需求,不仅提供了成熟的全模态AI基座解决方案,还开放了丰富的二次开发与微调空间,让普通开发者与企业均可快速落地图文声联动生成、超长内容解析、实时智能交互等多元AI应用,为原生多模态技术的普惠化落地提供了扎实可靠的开源支撑。

版权及免责申明:本文由@AI铺子原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/longcat-next.html