LoRWeB:基于 LoRA 权重基底的视觉类比学习框架,动态组合实现通用图像变换编辑

一、LoRWeB是什么

LoRWeB是由NVIDIA与以色列理工学院联合研发的视觉类比学习开源框架,它的核心定位是:用一组可学习的LoRA基底,动态构建任务专属适配器,让AI像人类一样“举一反三”完成图像类比编辑。

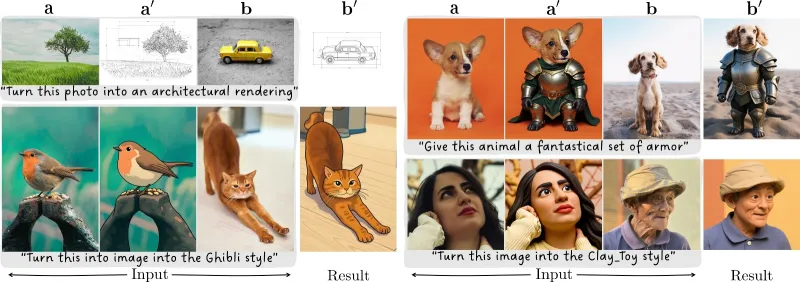

视觉类比学习的核心任务范式为:给定三元组 {a, a', b},模型需要理解a到a'的视觉变换规则,并将同一规则应用到b上,生成满足类比关系 a:a'::b:b' 的目标图像b'。这类任务的价值在于用示例代替文字,解决复杂、细粒度、难以用语言描述的图像编辑需求。

传统视觉类比方法普遍采用单一固定LoRA适配所有变换,导致泛化能力差、难以覆盖多样编辑类型。LoRWeB的核心突破是:不再用一个LoRA应对所有任务,而是为每个任务动态“调配”LoRA。它通过训练一组LoRA基底模块覆盖整个视觉变换空间,再用轻量编码器根据输入类比对实时计算权重、线性组合出专属LoRA,从而实现强泛化、高精度、高保真的图像类比编辑。

简单理解:传统方法是“一把锤子修所有东西”,LoRWeB是“一个工具箱+智能配比器,按需调出最合适的工具”。

二、功能特色

1. 示例驱动,无需文字描述

只需要提供“变化前/变化后”的参考图,即可让模型学会变换规则

支持风格迁移、物体增删、姿态修改、颜色调整、细节美化等无法用Prompt精准描述的编辑

降低AI图像操作门槛,非专业用户也能实现精准可控编辑

2. 动态LoRA组合,强泛化能力

内置可学习的LoRA权重基底,覆盖海量视觉变换类型

推理时自动为每个任务生成定制化LoRA,无需重新训练

在未见过的新变换任务上表现远超单LoRA方案

3. 兼顾编辑精度与原图保真

采用扩展注意力机制保留图像细节

同时使用CLIP语义编码与扩散模型细节编码,平衡语义准确性与结构一致性

编辑定位精准,不破坏无关区域,无伪影、无内容漂移

4. 轻量高效,参数友好

基于LoRA低秩适配,参数量小、训练与推理速度快

支持单GPU运行,消费级显卡可部署

兼容主流扩散模型生态,无缝对接FLUX、Stable Diffusion等

5. 开箱即用,工程化完善

提供完整Conda环境配置

统一训练/推理脚本,命令行一键启动

支持自定义数据集与配置文件微调

配套评估数据集与基准测试流程

三、技术细节

1. 核心架构:两大组件

LoRWeB架构极简且高效,由LoRA权重基底与动态编码器两大模块组成:

(1)可学习LoRA基底(Learnable LoRA Basis)

训练一组N个固定秩r的LoRA模块(默认N=32,r=4)

每个LoRA基底专注学习一类基础视觉变换(颜色、结构、风格、物体等)

所有基底共同张成完整视觉变换空间

为每个LoRA绑定可学习键向量(Key Vector),用于后续加权匹配

(2)动态加权编码器(Dynamic Weight Encoder)

以冻结CLIP-ViT为图像特征提取主干

输入类比三元组{a,a',b},提取特征并投影为查询向量(Query)

通过查询与键向量的相似度计算,输出N个LoRA的加权系数

用Softmax保证权重归一化,线性融合得到任务专属混合LoRA

2. 工作流程(Pipeline)

输入:文本提示词 + 图像三元组{a, a', b}

编码:用CLIP编码三元组,生成查询特征

加权:查询与键向量点积→得到LoRA基底权重

融合:按权重线性组合LoRA基底,生成当前任务LoRA

生成:将混合LoRA注入FLUX.1-Kontext,输出编辑结果b'

3. 训练机制

基座模型:FLUX.1-Kontext(条件流匹配模型)

训练目标:最小化流匹配速度场损失,保证变换精准

联合优化:LoRA基底、键向量、投影层同步训练

数据集:Relation252K(16K类比对、208类任务)

分辨率:训练512×512,推理支持更高分辨率

4. 关键技术创新点

动态LoRA合成:推理时生成任务专属适配器,而非固定适配器

双编码机制:CLIP负责语义理解,扩展注意力负责细节保真

层独立LoRA基底:不同网络层使用独立基底,捕捉多尺度语义

无测试时微调:一次训练,所有新任务零微调直接使用

5. 性能对比(核心指标)

| 方法 | 编辑准确度 | 内容保持度 | 泛化能力 | 未见过任务胜率 |

|---|---|---|---|---|

| 单LoRA基线 | 5.94 | 7.87 | 弱 | 42.1% |

| LoRWeB(N=32,r=4) | 7.87 | 5.94 | 强 | 57.9% |

注:指标来自论文VLM评估,数值越高效果越好;胜率越高代表越符合人类偏好。

四、应用场景

1. 创意设计与内容生产

插画风格统一迁移、角色设定快速迭代

商品图批量风格化、场景替换、细节美化

短视频封面、海报素材自动化生成

2. 智能图像编辑工具

无文字精准修图:用户给示例,AI自动复刻变换

人像编辑:发型、妆容、服饰迁移

物体编辑:给汽车换色、给家具换材质

3. 科研与算法开发

视觉类比学习新算法基准

LoRA组合、参数高效微调研究平台

扩散模型编辑能力增强插件

4. 工业与垂直场景

医疗图像对比增强、结构标注迁移

遥感图像变化模拟、要素迁移

动漫/游戏资产批量标准化处理

五、使用方法

1. 环境搭建

# 克隆仓库 git clone https://github.com/NVlabs/LoRWeB.git cd LoRWeB # 创建并激活Conda环境 conda env create -f environment.yml conda activate lorweb

2. 数据准备

使用官方推荐Relation252K数据集

目录结构必须包含:

control/:存放{a,a',b}三元组图像

target/:存放对应的目标图像b'

用preprocess_data.py预处理原始数据

3. 模型训练

# 基础训练命令 python run.py config/your_config.yaml # 带参数覆盖示例 python run.py LoRWeB_default_PROMPTS.yaml \ --name "my_lorweb" \ --linear 4 \ --linear_alpha 4 \ --loras_num 32 \ --lora_softmax true \ --query_mode "cat-aa'b"

4. 推理(生成图像)

python inference.py \ -w "output/my_lorweb.safetensors" \ -c "output/my_lorweb/config.yaml" \ -a "demo/a.jpg" \ -t "demo/a_prime.jpg" \ -b "demo/b.jpg" \ -o "output/b_prime.jpg"

5. 参数说明

--linear:LoRA秩r

--loras_num:基底数量N

--lora_softmax:是否启用权重归一化

--query_mode:三元组编码模式

-w:模型权重路径

-c:配置文件路径

-a:输入图像a

-t:变换后图像a'

-b:待编辑图像b

-o:输出图像b'

六、常见问题解答

Q1:LoRWeB和普通LoRA图像编辑有什么区别?

A:普通LoRA是一个固定模块适配所有任务,泛化差;LoRWeB是一组LoRA基底,为每个任务动态组合专属LoRA,在新任务上效果更强、用途更广。

Q2:运行LoRWeB需要什么配置的显卡?

A:推荐显存≥10GB;训练建议24GB以上,推理10GB可流畅运行。

Q3:是否支持Stable Diffusion,只能用FLUX吗?

A:官方开源版本基于FLUX.1-Kontext;项目基于Diffusers架构,可通过修改适配SD系列,但需要调整编码与注入逻辑。

Q4:训练自己的数据集需要注意什么?

A:必须严格遵循{control, target}目录结构;保证三元组类比关系清晰;图像分辨率建议统一;避免模糊、错位、无关干扰。

Q5:推理时效果不好,如何优化?

A:1)更换更清晰的参考对{a,a'};2)调整提示词,增强语义引导;3)使用官方推荐模型配置N=32、r=4;4)保证输入图像主体明确、背景干净。

Q6:LoRWeB可以商用吗?

A:项目采用开源协议,允许学术与商用使用,使用时需遵循协议并标注引用。

Q7:是否提供预训练权重?

A:官方计划在Hugging Face发布预训练权重与评估集,目前可按文档自行训练。

Q8:能否同时应用多种不同的类比变换?

A:当前版本单轮推理只支持一组三元组;可通过多轮顺序推理叠加多种变换。

Q9:对输入图像的尺寸和格式有要求吗?

A:支持JPG/PNG;建议正方形或接近方形;长边不超过1024以保证速度与质量。

Q10:LoRWeB的“泛化能力强”具体指什么?

A:可以处理训练集中从未出现过的视觉变换类型,而传统单LoRA只能处理见过的相似任务。

七、相关链接

GitHub开源仓库:https://github.com/NVlabs/LoRWeB

基座模型FLUX.1-Kontext:https://github.com/black-forest-labs/flux

Hugging Face模型与评估集(即将发布):https://huggingface.co/datasets/hilamanor/LoRWeB_evalset

八、总结

LoRWeB是视觉类比学习领域的里程碑式开源项目,它通过可学习LoRA权重基底+动态加权组合的创新方案,彻底解决了传统单LoRA方法泛化能力不足的核心问题,实现了基于示例、无需文字、精准可控、强通用的AI图像编辑。项目依托NVIDIA研究院技术积累,基于FLUX.1-Kontext与Diffusers生态构建,训练推理流程完整、工程化成熟,既能直接用于创意设计、内容生产、智能修图等实际场景,也可作为视觉类比、LoRA组合、参数高效微调等方向的科研基础平台,为下一代示例驱动型AI图像工具提供了通用、高效、可扩展的技术框架。

版权及免责申明:本文由@97ai原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/lorweb.html