Megatron-LM:NVIDIA开源大模型训练框架,极致并行与GPU优化加速千亿参数模型训练

一、Megatron-LM是什么

Megatron-LM是由NVIDIA应用深度学习研究团队于2019年首次推出、持续迭代维护的开源大规模Transformer模型训练项目,核心定位是为GPU集群提供极致优化的大语言模型(LLM)及多模态模型训练能力,是全球大模型训练领域最具影响力的开源框架之一。

该项目采用双组件架构,由Megatron-LM与Megatron Core两部分构成:Megatron-LM是面向研究场景的开箱即用训练框架,内置预配置训练脚本、示例与工具链,适合快速实验、学习分布式训练与复现模型;Megatron Core是模块化、可组合的GPU优化核心库,提供标准化API、底层算子、并行策略与系统级优化,可独立集成到其他训练框架(如PyTorch、NeMo),支持企业级自定义训练流水线开发。

自发布以来,Megatron-LM深刻影响了大模型训练生态,Hugging Face Accelerate、Colossal-AI、NVIDIA NeMo等主流框架均基于其核心思想与技术实现,成为千亿参数模型训练的事实标准之一。项目遵循Apache 2.0开源协议,完全开放商用与研究使用,持续适配最新NVIDIA GPU架构(Hopper、Blackwell)与精度格式(FP8、FP4),在H100集群上可实现最高47%-48%的模型FLOP利用率(MFU),兼顾训练效率与硬件利用率。

二、功能特色

Megatron-LM的核心功能围绕规模化、高效化、通用化、易用化四大方向设计,覆盖模型训练全生命周期,具体特色如下:

1. 双组件架构,兼顾研究与生产

Megatron-LM:轻量化训练框架,无多余抽象层,内置GPT、BERT、T5、LLaMA、MoE、多模态等模型训练示例,支持一键启动预训练、微调、评估、推理,适合研究团队快速验证算法。

Megatron Core:模块化核心库,提供可复用的Transformer构建块、并行策略、优化算子,支持PyTorch原生集成,可定制训练流水线,满足企业级生产需求。

2. 全维度并行策略,突破硬件限制

支持业内最完整的并行组合方案,解决大模型训练的显存与算力瓶颈:

张量并行(TP):拆分模型层内参数,适配单卡显存不足问题;

流水线并行(PP):按层拆分模型,实现多机多卡流水线训练;

数据并行(DP):拆分数据集,提升训练吞吐量;

专家并行(EP):专为MoE模型设计,高效调度专家模块;

上下文并行(CP):优化长序列训练,最高提升1.48倍效率;

序列并行(SP):拆分序列维度,降低显存占用。

3. 全品类模型支持,覆盖主流架构

无需二次开发即可训练主流模型,包括:

decoder-only:GPT、LLaMA、Mistral、Mamba、DeepSeek-V3、Qwen3;

encoder-only:BERT、BioMegatron;

encoder-decoder:T5、BART;

稀疏MoE:Mixtral、DeepSeek MoE;

多模态:LLaVA、Llama-3.1-Nemotron-Nano-VL;

检索增强:RETRO检索增强语言模型。

4. GPU深度优化,极致性能表现

适配NVIDIA全系列Tensor Core GPU,针对Hopper、Blackwell架构专项优化;

支持FP8、BF16、FP16、FP4混合精度训练,大幅降低显存占用、提升训练速度;

集成FlashAttention 2.0、激活重计算、分布式优化器等技术,显存占用最高降低70%;

分布式 checkpointing 速度较PyTorch原生提升26-50倍,支持跨并行配置加载。

5. 完善工具链,打通训练-部署全流程

Megatron Bridge:实现Hugging Face与Megatron权重双向转换,无缝对接开源生态;

模型转换工具:支持并行配置修改、权重格式转换,适配不同推理引擎;

后训练优化:提供量化、蒸馏、剪枝、推测解码能力,降低推理成本;

推理导出:支持导出至TensorRT-LLM,实现生产级高性能推理;

统一分词器:兼容Hugging Face、SentencePiece、TikToken,API简洁易用。

6. 高可扩展性与稳定性

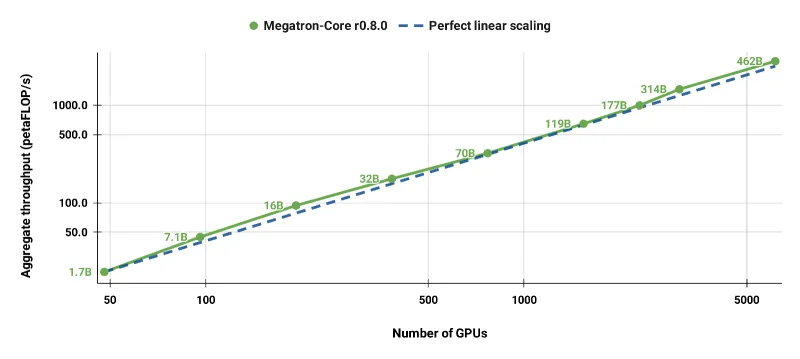

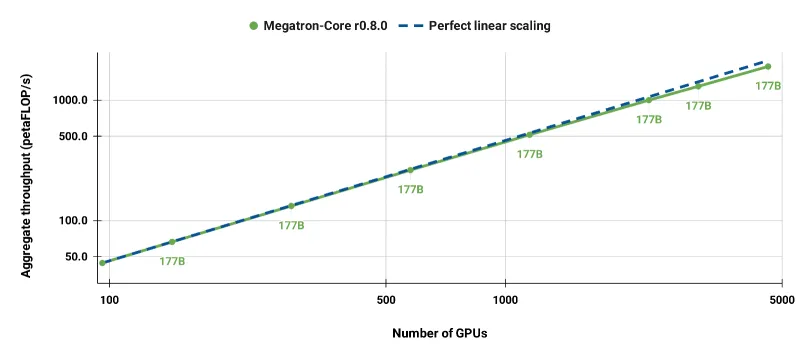

支持数千张GPU集群训练,弱扩展性能呈超线性提升;

异步 checkpoint、断点续训、容错机制,保障长周期训练稳定;

提供Docker镜像、CI/CD流程,简化环境部署与版本管理。

三、技术细节

1. 核心架构与组件分工

Megatron-LM采用核心库+框架的解耦架构,底层依赖PyTorch、CUDA、cuDNN、NCCL,整体结构如下:

底层:GPU算子优化、通信库(NCCL)、精度支持(FP8/BF16);

中间层:Megatron Core(并行策略、Transformer模块、分布式训练、工具函数);

上层:Megatron-LM(训练脚本、示例、数据处理、评估推理)。

2. 关键并行技术原理

| 并行类型 | 核心原理 | 适用场景 |

|---|---|---|

| 张量并行(TP) | 将单层参数按列/行拆分到多卡,单卡只计算部分参数,跨卡通信聚合结果 | 模型参数过大,单卡无法加载 |

| 流水线并行(PP) | 将模型层按阶段拆分到多卡,按流水线顺序执行前向/反向传播 | 模型层数多,跨机训练 |

| 专家并行(EP) | 将MoE模型的专家层分布到多卡,路由器动态分配token到对应专家 | 稀疏MoE大模型训练 |

| 上下文并行(CP) | 将长序列按上下文块拆分到多卡,降低单卡序列长度 | 128K+长上下文模型 |

3. 显存优化技术

激活重计算:不存储中间激活值,反向传播时动态重计算,显存占用降低50%以上;

分布式优化器:将优化器状态分布到多卡,单卡显存占用随数据并行数线性降低;

混合精度训练:FP8训练在Hopper/Blackwell架构上实现速度翻倍、显存减半;

梯度累积与通信重叠:反向传播时同步执行梯度通信,提升集群利用率。

4. 模型训练流程

Megatron-LM的标准训练流程为:

环境准备:安装PyTorch、CUDA、NCCL,部署Megatron-Core;

数据预处理:将文本/多模态数据转为二进制格式,适配高速加载;

配置并行策略:设置TP/PP/DP/EP大小,指定精度与批次参数;

预训练:启动训练脚本,执行分布式训练,自动保存checkpoint;

微调/指令微调:加载预训练权重,在垂直领域数据上微调;

评估:使用WikiText103、LAMBADA、MNLI等数据集评估效果;

部署:转换权重格式,导出至TensorRT-LLM推理。

5. 兼容性与依赖

框架:PyTorch(推荐2.0+);

硬件:NVIDIA Turing架构及以上GPU(A100、H100、L40S最佳);

依赖:CUDA、cuDNN、NCCL、FlashAttention、uv(包管理工具);

系统:Linux(推荐Ubuntu 20.04+)。

四、应用场景

1. 学术研究与算法验证

高校、科研机构可快速复现GPT、LLaMA、MoE等经典模型,验证新的并行策略、注意力机制、训练算法,无需从零搭建训练框架,降低研究门槛。

2. 企业级大模型研发

互联网、AI企业用于训练自研通用大模型、垂直领域模型(金融、医疗、法律),支持从10B到400B+参数规模,依托GPU优化与并行能力,缩短训练周期、降低算力成本。

3. 稀疏MoE模型训练

专门适配Mixtral、DeepSeek-V3等MoE架构,通过专家并行与GroupedGEMM优化,高效训练稀疏大模型,在同等算力下实现更高模型容量与效果。

4. 多模态模型训练

支持图文多模态模型(LLaVA)训练,内置多模态数据加载器、联合训练策略,可训练图像理解、图文生成模型,适配VQAv2、MMMU等评估任务。

5. 检索增强(RAG)模型训练

提供RETRO工具链,支持检索数据库构建、索引训练、邻居查询、检索增强预训练/微调,适合开发知识库增强型大模型。

6. 模型轻量化与推理优化

对训练完成的模型进行量化(INT8/FP8)、蒸馏、剪枝,适配端侧与边缘设备,导出至TensorRT-LLM实现高吞吐、低延迟推理。

7. 教育与技术普及

作为分布式训练教学工具,帮助开发者理解张量并行、流水线并行等核心技术,快速掌握大模型训练全流程。

五、使用方法

1. 环境安装

方式1:PyPI安装Megatron-Core

# 安装最新版 pip install --no-build-isolation megatron-core[mlm,dev] # 安装LTS版本(适配NGC PyTorch 24.01) pip install --no-build-isolation megatron-core[lts,mlm]

方式2:源码编译(推荐)

git clone https://github.com/NVIDIA/Megatron-LM.git

cd Megatron-LM

# 安装uv包管理器

export UV_VERSION=0.7.2

curl -LsSf https://astral.sh/uv/${UV_VERSION}/install.sh | sh

export PATH="$HOME/.local/bin:$PATH"

# 安装依赖

pip install --no-build-isolation .[mlm,dev]方式3:Docker部署

使用NVIDIA官方预构建镜像,内置所有依赖:

docker pull nvcr.io/nvidia/pytorch:24.01-py3 docker run -it --gpus all -v $(pwd):/workspace nvcr.io/nvidia/pytorch:24.01-py3

2. 数据预处理

将JSON格式文本数据转为二进制格式:

python tools/preprocess_data.py \ --input my_corpus.json \ --output-prefix my_gpt \ --vocab-file vocab.json \ --merge-file merges.txt \ --tokenizer-type GPT2BPETokenizer \ --append-eod

3. 启动模型训练(以GPT-8B为例)

bash examples/pretrain_gpt.sh \ --num-layers 24 \ --hidden-size 2048 \ --num-attention-heads 16 \ --seq-length 2048 \ --micro-batch-size 2 \ --global-batch-size 128 \ --tensor-model-parallel-size 2 \ --pipeline-model-parallel-size 2 \ --data-path my_gpt \ --vocab-file vocab.json \ --merge-file merges.txt \ --save-interval 1000 \ --save-checkpoint ./checkpoints \ --load-checkpoint ./checkpoints

4. 模型微调

bash examples/finetune_gpt.sh \ --finetune \ --load-checkpoint ./pretrain_checkpoints \ --data-path ./finetune_data \ --tensor-model-parallel-size 2 \ --pipeline-model-parallel-size 2

5. 权重转换(Hugging Face ↔ Megatron)

python tools/checkpoint/convert.py \ --model-type GPT \ --loader llama_mistral \ --saver core \ --load-dir ./huggingface_llama_8b \ --save-dir ./megatron_llama_8b \ --target-tensor-parallel-size 2 \ --target-pipeline-parallel-size 2

6. 推理与文本生成

bash examples/inference/run_text_generation.sh \ --load-checkpoint ./checkpoints \ --tensor-model-parallel-size 2 \ --pipeline-parallel-size 2

六、常见问题解答

Megatron-LM与Megatron Core的区别是什么?

Megatron-LM是完整的训练框架,包含预配置脚本、示例、工具链,适合直接训练模型;Megatron Core是底层核心库,提供并行策略、算子、模块API,可集成到其他框架,二者互补使用。

Megatron-LM支持哪些GPU?

支持所有NVIDIA Tensor Core GPU,包括T4、A100、H100、L40S、Blackwell系列,其中A100及以上显卡可发挥最佳性能,Hopper/Blackwell架构支持FP8加速。

单张GPU可以使用Megatron-LM吗?

可以,单卡时自动关闭模型并行,仅使用数据并行(单卡),适合小模型(1B以内)训练、调试与学习,大模型需要多卡多机集群。

如何解决显存不足问题?

可开启激活重计算(--recompute-granularity full)、使用混合精度(FP16/BF16/FP8)、减小micro-batch-size、启用张量并行、使用分布式优化器,降低单卡显存占用。

Megatron-LM支持LLaMA、Mistral等开源模型吗?

支持,通过Megatron Bridge可直接加载Hugging Face上的LLaMA、LLaMA-2、LLaMA-3、Mistral、Mixtral权重,支持微调与推理。

训练中断后如何恢复?

项目支持断点续训,只需保持并行配置(TP/PP/DP)不变,启动脚本时指定--load-checkpoint参数,加载最近保存的checkpoint即可继续训练。

如何将Megatron模型用于生产推理?

使用模型转换工具将权重转为TensorRT-LLM支持的格式,通过TensorRT-LLM部署,实现高吞吐、低延迟的生产级推理。

MoE模型训练需要注意什么?

需开启专家并行(--expert-model-parallel-size),设置路由器top-k参数,保证专家负载均衡,建议使用A100/H100显卡提升训练效率。

Windows系统可以运行吗?

不推荐,Megatron-LM依赖Linux环境下的NCCL、CUDA优化与多进程通信,仅支持Linux系统(Ubuntu、CentOS等)。

如何提升集群训练速度?

优化网络带宽(推荐InfiniBand)、开启通信与计算重叠(--overlap-grad-reduce、--overlap-param-gather)、合理配置并行策略、使用FP8精度、增大批次大小。

七、相关链接

官方文档:https://docs.nvidia.com/megatron-core/developer-guide/latest/

Megatron Bridge文档:https://docs.nvidia.com/nemo/megatron-bridge/latest/

NVIDIA NGC模型库(预训练权重):https://catalog.ngc.nvidia.com/models

八、总结

Megatron-LM是NVIDIA打造的面向大模型时代的开源训练基础设施,凭借双组件架构、全维度并行策略、GPU深度优化、全品类模型支持与完善的工具链,成为学术研究与企业级大模型研发的首选框架,其核心技术已成为大模型分布式训练的行业标准,广泛支撑千亿参数模型、稀疏MoE模型、多模态模型与检索增强模型的训练,同时通过与Hugging Face、TensorRT-LLM生态打通,实现从训练到部署的全流程闭环,以高性能、高稳定性、高易用性助力开发者高效完成大模型研发与落地。

版权及免责申明:本文由@AI工具箱原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/megatron-lm.html