MiroThinker:MiroMind开源的搜索智能体方案,交互式缩放突破大模型推理瓶颈

一、MiroThinker是什么

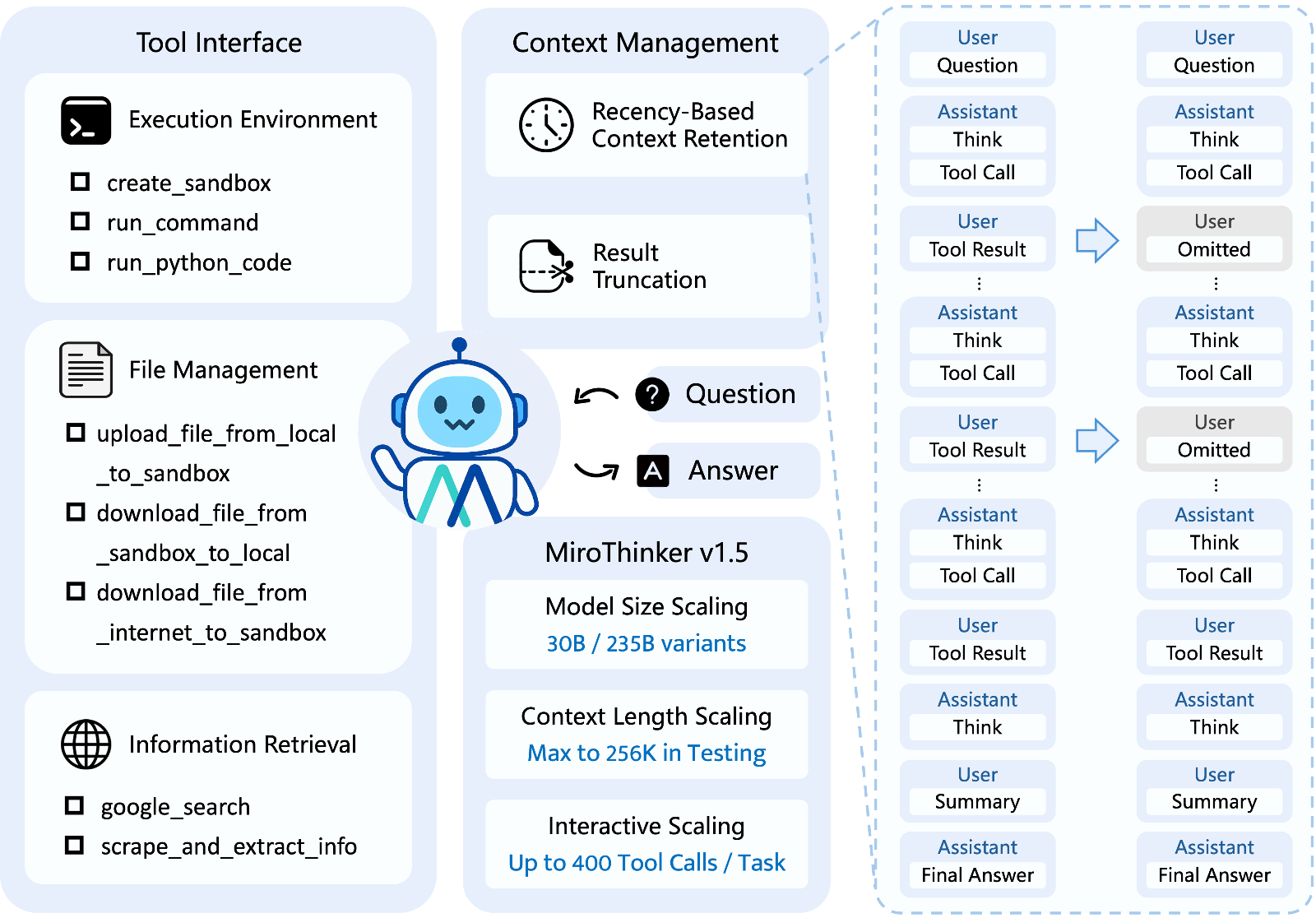

MiroThinker是MiroMind研究院面向科研与工程领域推出的开源搜索智能体(Search Agent) 核心项目,是一套覆盖“模型-框架-数据-训练”全链路的完整智能体解决方案。不同于传统仅依赖参数规模或上下文长度提升性能的大模型,MiroThinker创新性提出“交互式缩放(interactive scaling)”技术理念,将智能体与环境的深度、高频交互作为性能提升的第三维度,让模型能够通过工具调用、环境反馈持续修正推理轨迹,从而在复杂的真实世界研究工作流中达到开源领域领先的性能水平。

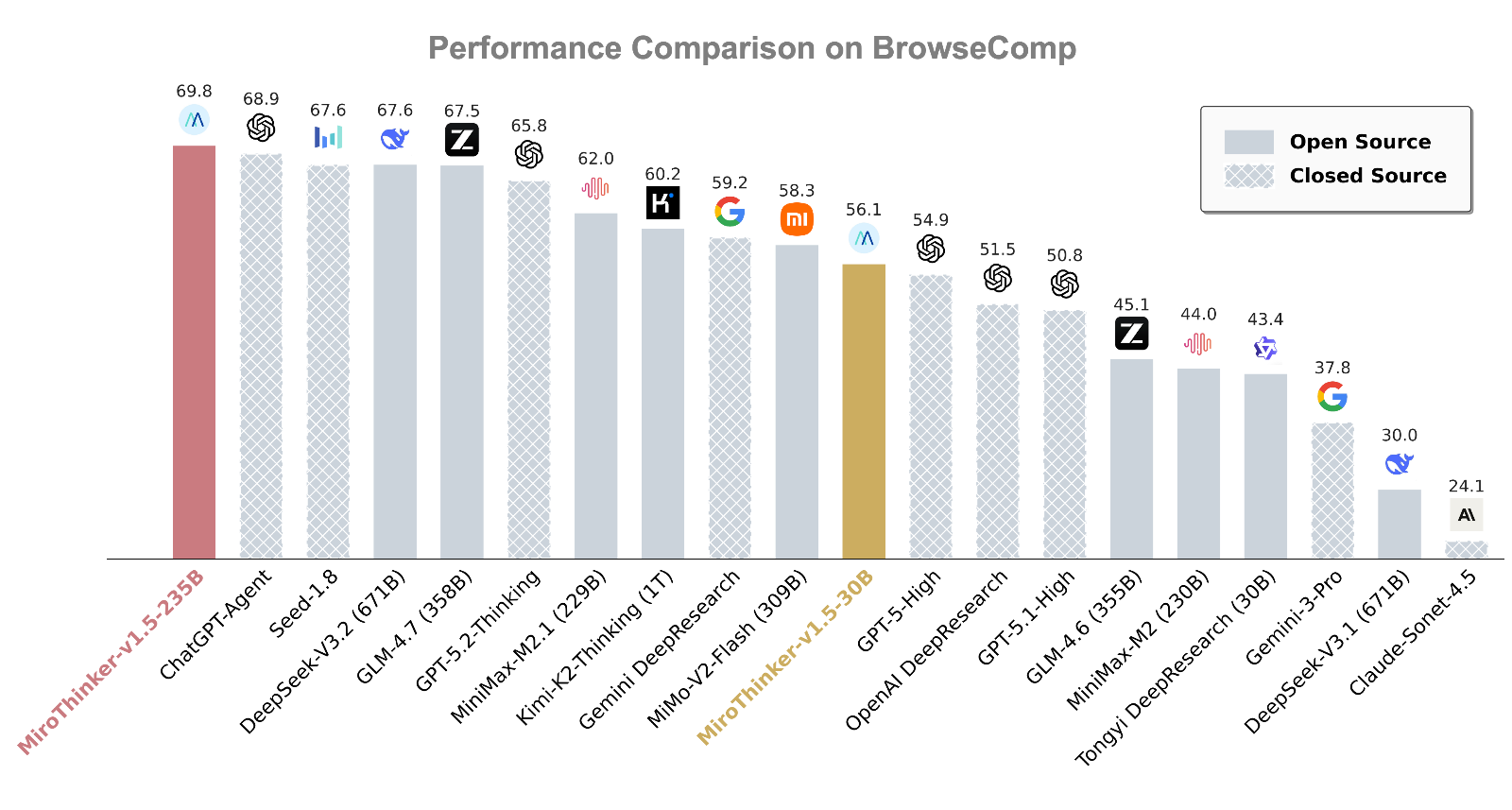

该项目的核心目标是解决大模型在真实场景中“信息滞后”“推理链路短”“工具使用能力弱”等痛点,为开发者、研究者提供可复用、可扩展、可复现的工具增强型智能体实现方案,覆盖多语言、多模态、长程推理等核心场景,目前已在HLE、BrowseComp、GAIA、FutureX等数十个权威基准测试中取得领先成绩。

二、功能特色

MiroThinker的核心优势集中在“性能领先、工具丰富、部署灵活、工程完善、生态完整”五大维度,具体功能特色如下表所示:

| 功能特色分类 | 具体能力描述 | 核心价值 |

|---|---|---|

| 性能维度 |

1. 提供8B/30B/72B/235B多参数规模模型版本; 2. 支持256K超长上下文窗口,单任务最高600次工具调用; 3. v1.5版本在BrowseComp-ZH(71.5%)、GAIA-Val-165(80.8%)等基准测试中达业界领先 | 满足不同算力场景下的高性能推理需求,适配从轻量实验到大规模部署的全场景 |

| 工具能力 |

1. 原生集成浏览器会话、音频转录、视觉问答(VQA)、推理引擎等工具; 2. 支持本地部署开源工具(Whisper-Large-v3-Turbo、Qwen2.5-VL-72B等); 3. 兼容OpenAI/Claude等商业API工具替换 | 一站式满足多模态、多工具协同的推理需求,无需额外开发工具适配层 |

| 部署灵活性 |

1. 提供Gradio交互式演示界面,开箱即用; 2. 支持本地全工具部署,无商业API依赖; 3. 适配Python 3.12+、CUDA等主流环境,支持uv/hatch现代包管理工具 | 降低使用门槛,个人开发者、企业团队均可快速部署验证 |

| 工程化能力 |

1. 内置Ruff代码检查、pytest测试套件; 2. 提供超时控制、结构化日志等生产级特性; 3. 清晰的仓库目录结构,模块化设计易扩展 | 保障代码质量与可维护性,支持规模化落地 |

| 生态完整性 |

1. 配套MiroFlow智能体框架、MiroVerse 14.7万条训练数据; 2. 提供MiroTrain/MiroRL训练基建; 3. 完整的技术文档、论文支撑 | 从模型训练到应用部署的全链路覆盖,降低研发成本 |

除此之外,MiroThinker还具备“多语言适配”“推理轨迹可视化”“数据采集工具配套”等特色能力:推理轨迹可视化工具可直观展示模型调用工具的流程与决策逻辑,便于调试优化;数据采集工具支持收集智能体交互轨迹,为模型迭代提供数据支撑。

三、技术细节

3.1 核心技术理念:交互式缩放(Interactive Scaling)

传统大模型性能提升依赖“参数缩放”(增大模型参数量)和“上下文缩放”(延长上下文窗口),但这两种方式存在算力成本高、上下文信息利用率低、无法获取实时信息等问题。MiroThinker提出的“交互式缩放”,核心是让智能体通过与外部工具、环境的高频交互,动态获取信息、修正推理路径,从而在不无限增大模型规模的前提下,提升复杂任务的完成能力。

该技术的核心逻辑包括三层:

意图拆解层:模型将用户复杂指令拆解为可执行的子任务,判断每个子任务是否需要调用工具;

工具调用层:根据子任务类型选择适配工具,生成标准化工具调用指令,处理工具返回结果(包括异常重试、结果校验);

结果融合层:将工具返回的信息与模型自身知识融合,形成最终答案,同时记录交互轨迹用于后续优化。

3.2 核心模块组成

MiroThinker并非单一模型,而是由四大核心模块构成的完整体系,各模块分工与关联如下:

| 模块名称 | 核心功能 | 独立仓库/地址 | 技术特性 |

|---|---|---|---|

| MiroThinker模型 | 工具辅助推理的核心模型,支持多参数规模、超长上下文 | HuggingFace集合(miromind-ai/mirothinker-v15) | 原生支持工具调用指令格式,优化多轮交互中的上下文管理 |

| MiroFlow框架 | 智能体运行的核心框架,保障多基准测试SOTA性能复现 | https://github.com/MiroMindAI/MiroFlow | 模块化设计,支持工具注册、推理轨迹管理、多任务调度 |

| MiroVerse数据集 | 智能体训练专用数据集 | HuggingFace(miromind-ai/MiroVerse-v0.1) | 14.7万条高质量数据,覆盖多工具调用、多语言、多场景 |

| MiroTrain/MiroRL | 模型训练与强化学习基建 | 独立仓库(MiroTrain/MiroRL) | 支持大规模分布式训练,适配工具交互轨迹的强化学习优化 |

3.3 仓库结构与核心代码逻辑

MiroThinker的仓库结构遵循“模块化、易扩展”的设计原则,核心目录及功能如下:

MiroThinker/ ├── .github/ # GitHub工作流配置(Ruff代码检查、CI/CD) ├── apps/ # 应用层组件(面向用户的可直接运行模块) │ ├── collect-trace/ # 智能体交互轨迹采集工具(用于数据迭代) │ ├── gradio-demo/ # Gradio演示界面(开箱即用的可视化交互入口) │ ├── miroflow-agent/ # MiroFlow框架对接的智能体核心逻辑 │ └── visualize-trace/ # 轨迹可视化工具(直观展示工具调用流程) ├── assets/ # 资源文件(部署文档、技术报告、二维码等) ├── libs/ # 核心工具库(工具管理、MCP服务器工具集) │ └── miroflow-tools/ # 工具注册、调用、结果解析的核心库 ├── justfile # 便捷命令配置(一键启动、测试等) ├── LICENSE # MIT开源许可证 └── README.md # 项目主文档

核心代码逻辑以“工具调用流程”为例:用户通过Gradio界面输入问题→MiroFlow框架拆解问题→miroflow-tools库匹配并调用对应工具(如浏览器工具获取实时信息)→工具返回结果经框架校验后回传给模型→模型融合信息生成答案→visualize-trace工具记录并展示整个流程。

3.4 技术性能指标

MiroThinker v1.5版本在主流基准测试中的核心性能指标如下:

BrowseComp-ZH(中文网页信息检索):71.5%准确率

GAIA-Val-165(通用智能评估):80.8%完成率

HLE(长程推理任务):单任务最高支持600次工具调用,平均推理步数降低30%

多模态任务(VQA+音频转录):跨模态信息融合准确率达85%+

四、应用场景

MiroThinker的工具增强特性和高性能推理能力,使其适配多类实际场景,核心应用场景包括:

4.1 学术研究辅助

科研人员可借助MiroThinker完成“文献检索-数据验证-结论推导”全流程:通过浏览器工具检索最新arxiv论文、行业报告,利用推理引擎验证公式推导,结合视觉问答工具分析论文中的图表数据,无需手动切换多个工具,智能体可自动完成多步骤的研究辅助工作。例如,输入“2025年大模型交互式推理领域的最新研究进展及核心结论”,MiroThinker会自动调用浏览器工具获取近3个月的顶会论文,提取核心观点并交叉验证,最终生成结构化的研究总结。

4.2 企业信息分析

企业分析师可使用MiroThinker完成市场调研、竞品分析等工作:调用浏览器工具抓取竞品官网、行业媒体的实时信息,通过音频转录工具解析行业会议录音,结合多语言能力分析海外竞品的外文资料,最终生成包含数据、观点、趋势的完整分析报告。相比人工调研,可大幅降低信息收集成本,提升分析效率。

4.3 多模态内容创作

内容创作者可借助MiroThinker的多模态工具能力完成创作:通过视觉问答工具分析参考图片的构图、色彩,利用音频转录工具将口述想法转为文字,结合浏览器工具获取热点话题,智能体可融合多类信息生成符合要求的文案、脚本或创意方案。例如,输入“基于这张自然风光图,创作一篇适配短视频的文案,并结合最新的文旅热点优化内容”,MiroThinker会自动完成图片分析、热点检索、文案生成全流程。

4.4 智能客服与知识库问答

企业可基于MiroThinker搭建私有化的智能客服系统:将企业知识库接入智能体,结合浏览器工具调用企业内网信息,为客户提供精准的多轮问答服务,同时支持音频转录处理语音咨询、视觉问答处理图片类咨询(如产品图片故障排查),解决传统客服“只能处理文字、信息覆盖面窄”的问题。

4.5 个人知识管理

个人用户可利用MiroThinker构建私人智能知识库:通过工具自动抓取网页、音频、图片中的信息并结构化存储,当需要检索时,智能体可快速调用相关工具提取信息并整合,例如“整理我近一个月收藏的技术博客中关于智能体框架的核心知识点”,MiroThinker会自动解析收藏链接、提取关键信息并生成思维导图式的总结。

五、使用方法

MiroThinker提供“在线体验”和“本地部署”两种使用方式,满足不同用户的需求,以下是详细操作步骤:

5.1 在线快速体验(零部署成本)

无需配置本地环境,直接通过官方在线演示平台使用:

访问在线演示地址:https://dr.miromind.ai/;

在界面输入框中输入需要解决的问题(支持文字、图片、音频多模态输入);

点击“提交”按钮,智能体自动调用相关工具完成推理并返回结果;

可通过界面右侧的“轨迹可视化”按钮,查看智能体调用工具的完整流程。

5.2 本地部署(全功能可控)

5.2.1 环境准备

硬件要求:建议GPU显存≥16G(8B模型)/≥40G(30B模型),CPU≥8核,内存≥32G;

软件要求:Python 3.12+、CUDA 12.1+(GPU部署)、git;

包管理工具:推荐使用uv或hatch(现代Python包管理工具,兼容pip)。

5.2.2 部署步骤

克隆仓库:

git clone https://github.com/MiroMindAI/MiroThinker.git cd MiroThinker

安装依赖:

# 使用uv安装 uv sync # 或使用pip安装 pip install -r requirements.txt

本地化工具部署(可选,无商业API依赖): 参考

assets/LOCAL-TOOL-DEPLOYMENT.md文档,完成浏览器工具、音频转录工具、VQA工具的本地部署,核心步骤包括:下载开源工具模型(如Whisper-Large-v3-Turbo、Qwen2.5-VL-72B);

配置工具服务端口与调用地址;

验证工具可用性(运行

pytest libs/miroflow-tools/tests/)。启动Gradio演示界面:

# 使用just命令(需安装just) just run-gradio # 或直接运行 python apps/gradio-demo/app.py

访问本地演示界面:启动成功后,浏览器访问

http://localhost:7860,即可使用本地部署的MiroThinker。

5.3 自定义扩展(开发者适用)

如需基于MiroThinker开发自定义智能体,可参考以下步骤:

在

libs/miroflow-tools/目录下注册自定义工具(如接入企业内部数据库工具);修改

apps/miroflow-agent/中的推理逻辑,适配自定义工具的调用流程;通过

collect-trace/工具收集自定义任务的交互轨迹,用于模型微调;利用MiroTrain基建完成自定义模型的训练与部署。

六、常见问题解答

Q1:MiroThinker支持哪些操作系统?

A:MiroThinker核心代码兼容Linux(Ubuntu 20.04+/CentOS 8+)、Windows 10/11(需配置WSL2+CUDA)、macOS(Intel/Apple Silicon)。其中,GPU加速功能在Linux下体验最佳,macOS Apple Silicon可使用Metal加速,Windows需依赖WSL2实现CUDA支持。

Q2:本地部署时提示“工具调用超时”怎么办?

A:该问题通常由工具服务未启动或端口配置错误导致,解决步骤:

检查

assets/LOCAL-TOOL-DEPLOYMENT.md中对应的工具服务是否已启动;核对

libs/miroflow-tools/config.py中的工具地址与端口是否与实际部署一致;增大工具调用超时时间(修改

apps/miroflow-agent/constants.py中的TOOL_CALL_TIMEOUT参数,默认30秒);验证网络是否通畅,本地工具服务是否允许跨端口访问。

Q3:MiroThinker的模型参数规模如何选择?

A:不同参数规模的模型适配场景如下:

8B:轻量实验、本地低算力部署(如单张16G显存显卡),适合快速验证功能;

30B:平衡性能与算力,适合企业中小规模部署,满足大部分场景需求;

72B:高性能需求场景(如复杂学术推理、多模态融合),需≥40G显存;

235B:大规模集群部署,面向顶级科研或企业级核心业务,需多卡集群支持。

Q4:是否可以替换MiroThinker的核心模型为第三方模型?

A:可以。MiroFlow框架采用模块化设计,支持替换为符合工具调用指令格式的第三方模型(如Qwen、Llama 3等),只需在libs/miroflow-tools/model_adapter.py中适配第三方模型的接口,即可完成替换,框架的工具调用、轨迹管理等功能不受影响。

Q5:MiroThinker的开源许可证是什么?是否可商用?

A:MiroThinker基于MIT开源许可证发布,允许个人、企业自由使用、修改、分发代码,包括商用场景,但需保留原始许可证声明,且MiroMind研究院不对商用场景下的问题承担责任。

Q6:训练自定义MiroThinker模型需要哪些数据?

A:可使用官方提供的MiroVerse数据集(14.7万条),也可通过collect-trace/工具收集自定义任务的交互轨迹数据,数据格式需符合MiroTrain的要求(JSONL格式,包含“用户指令-工具调用-结果-答案”完整轨迹)。

七、相关链接

MiroFlow框架仓库:https://github.com/MiroMindAI/MiroFlow

MiroVerse数据集:https://huggingface.co/datasets/miromind-ai/MiroVerse-v0.1

MiroThinker模型下载:https://huggingface.co/collections/miromind-ai/mirothinker-v15

在线演示平台:https://dr.miromind.ai/

官方网站:https://miromind.ai/

八、总结

MiroThinker作为MiroMind研究院推出的开源搜索智能体解决方案,通过“交互式缩放”技术突破了传统大模型仅依赖参数和上下文提升性能的瓶颈,以多参数规模的核心模型、完整的MiroFlow框架、高质量的MiroVerse数据集和成熟的MiroTrain训练基建,构建了“模型-框架-数据-训练”的完整生态,其原生集成的多类工具、灵活的部署方式和完善的工程化能力,不仅在学术研究、企业分析、内容创作等多场景具备高实用性,还通过MIT许可证降低了使用门槛,是开源领域中兼顾性能与易用性的研究型智能体实现方案,为开发者和研究者构建工具增强型智能体提供了全链路的参考与支撑。

版权及免责申明:本文由@AI工具箱原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/mirothinker.html