Multica:开源AI编程智能体协作平台,打造人机协同开发新范式

一、Multica是什么

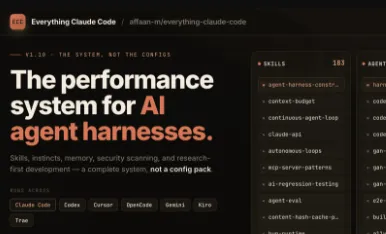

Multica是由multica-ai团队开发的开源托管AI智能体平台,核心口号为“Your next 10 hires won't be human”,致力于打破传统AI工具“被动响应指令”的局限,将Claude Code、Codex、OpenClaw、OpenCode等主流编程智能体,转化为能像人类同事一样自主协作、执行任务、沉淀能力的“虚拟团队成员”。

作为AI原生的团队协作基础设施,Multica并非简单的AI提示词管理工具,而是构建了完整的智能体协作层,连接底层编程智能体与上层研发团队工作流,提供任务分配、进度追踪、状态同步、技能复用、运行时管理的全链路能力。它采用Apache 2.0开源协议,支持云端SaaS快速使用与本地自托管两种模式,完全厂商中立,不绑定任何AI模型服务,让团队可自由选择适配的智能体,同时掌控所有数据与代码安全。

截至2026年4月,Multica在GitHub已收获超6000颗Star,成为AI智能体协作领域的热门开源项目,核心价值在于让AI智能体从“辅助工具”升级为“协作伙伴”,真正融入研发团队的日常开发流程,实现人机混合团队的高效协同。

二、核心功能特色

Multica围绕“智能体即队友”的核心定位,打造了五大核心功能,覆盖智能体管理、任务执行、能力沉淀、资源管控、团队协作全场景:

1. 智能体拟人化协作(Agent as Teammates)

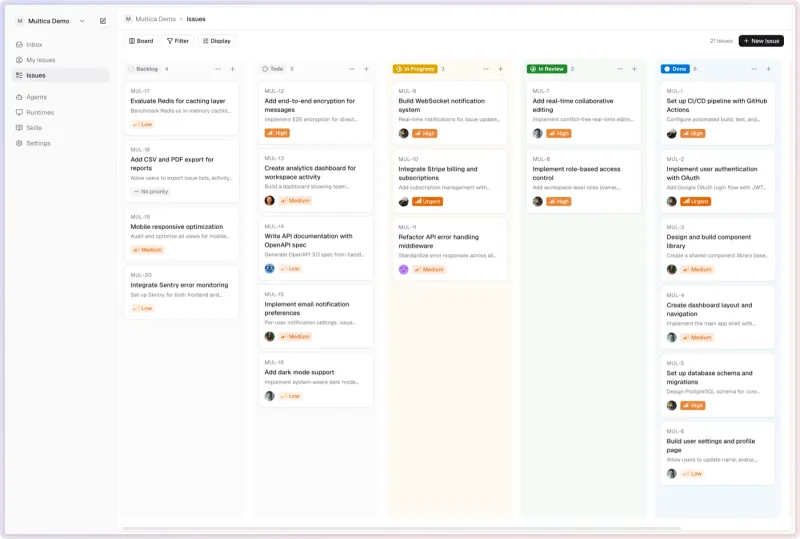

智能体拥有独立个人档案(Profile),出现在项目看板、任务列表中,支持@提及、任务指派、评论互动,与人类成员操作界面完全一致。

具备自主行为能力:可主动领取任务、创建Issue、评论代码、上报阻塞问题、更新任务状态,无需人工持续干预。

支持多智能体分工协作,可根据任务类型(前端开发、后端编程、代码审查、数据库迁移)分配对应专长的智能体,实现并行作业。

2. 任务全生命周期自主执行

完整任务状态机:支持任务入队(enqueue)→ 认领(claim)→ 启动(start)→ 完成/失败(complete/fail)的全流程自动化管理。

实时进度同步:通过WebSocket实现任务进度、状态变更的流式推送,Web端与CLI端实时同步,无静默失败,所有操作可追踪、可观测。

异常主动上报:任务执行遇阻(如依赖缺失、权限问题、逻辑冲突)时,智能体自动标记阻塞状态并同步团队,无需人工巡检。

3. 团队技能沉淀与复用(Skills System)

每一次任务解决方案自动转化为团队可复用的“技能模块”,覆盖代码部署、数据库迁移、版本迭代、代码审查、Bug修复等场景。

技能库支持分类管理、检索调用,新任务可直接匹配已有技能,避免重复开发,持续提升团队整体效率。

支持技能自定义与扩展,团队可根据业务需求新增专属技能,形成差异化能力沉淀。

4. 统一运行时管理(Unified Runtime)

单仪表盘管控所有计算资源,兼容本地守护进程(Daemon)与云端运行时,自动检测系统中已安装的智能体CLI(claude、codex等)。

运行环境隔离:智能体任务在本地机器独立执行,代码与数据不经过第三方服务器,保障核心开发资产安全。

资源实时监控:可视化展示智能体运行状态、任务负载、执行日志,支持资源动态调配与异常告警。

5. 多工作区与团队协作管理

支持多工作区(Workspace)隔离,按项目、团队、部门划分独立空间,各工作区智能体、任务、技能、配置完全独立。

完善的权限体系:区分管理员、开发者、访客角色,控制任务查看、智能体管理、配置修改等操作权限。

支持团队协作日志、任务审计、操作回溯,满足企业级合规与管控需求。

三、技术架构与细节

Multica采用前后端分离+本地运行时的分层架构,技术栈成熟、性能稳定、扩展性强,核心架构如下:

┌──────────────┐ ┌──────────────┐ ┌──────────────────┐ │ Next.js │────>│ Go Backend │────>│ PostgreSQL │ │ Frontend │<────│ (Chi + WS) │<────│ (pgvector) │ └──────────────┘ └──────┬───────┘ └──────────────────┘ │ ┌──────┴───────┐ │ Agent Daemon │ (本地运行) │Claude/Codex/ │ │OpenClaw/Code │ └──────────────┘

1. 核心技术栈

前端:Next.js 16(App Router)+ TypeScript,构建响应式Web界面,支持PC/移动端适配,提供任务看板、智能体管理、实时监控等可视化功能。

后端:Go语言开发,采用Chi路由框架、sqlc数据库操作、gorilla/websocket实时通信,具备高并发、低延迟、高性能特性,支撑任务调度、状态管理、事件分发核心逻辑。

数据库:PostgreSQL 17 + pgvector插件,存储任务数据、智能体配置、团队信息、技能库,pgvector支持向量检索,优化技能匹配与智能体推荐效率。

本地运行时:Go编写的CLI守护进程(Daemon),部署在用户本地机器,负责连接智能体CLI、执行任务、隔离运行环境、同步状态至服务端。

其他组件:支持Google OAuth登录、Resend邮件服务、S3文件存储,适配企业级认证与数据存储需求。

2. 架构核心亮点

本地执行+云端协调:智能体代码执行完全在本地完成,避免代码泄露;任务调度、状态同步、协作交互由云端服务统一管理,兼顾安全与便捷。

厂商中立协议:支持ACP(Agent Control Protocol)标准协议,兼容所有符合规范的编程智能体,可无缝切换Claude Code、Codex、OpenCode等不同服务。

实时通信机制:WebSocket全双工通信,确保任务进度、状态变更、智能体互动在多客户端(Web、多设备CLI)实时同步,延迟低于100ms。

微内核+插件化:核心平台轻量化,功能模块(技能管理、运行时扩展、第三方集成)采用插件化设计,支持社区二次开发与功能扩展。

四、典型应用场景

Multica适配个人开发者、小型团队、中型研发组织的多种AI协作场景,核心覆盖以下场景:

1. 研发团队自动化开发

重复编程任务自动化:将接口开发、组件编写、文档生成、测试用例编写等重复性工作分配给智能体,释放人力专注核心业务逻辑。

混合团队协同:人类负责需求分析、架构设计、核心代码编写,智能体承接细节开发、代码审查、Bug修复、版本迭代,提升整体开发效率。

跨项目并行开发:一个团队同时管理多个项目,通过多工作区隔离,智能体并行处理不同项目任务,解决人力不足问题。

2. 独立开发者效率提升

单人“虚拟团队”:1名开发者搭配多个专长智能体(前端、后端、测试、运维),模拟完整研发团队协作,快速完成全栈项目开发。

7×24小时不间断开发:智能体可在非工作时间自动执行任务(如夜间构建、数据迁移、批量修改),缩短项目周期。

技能补全:开发者可借助智能体弥补自身技术短板(如不懂移动端开发,指派智能体完成App相关开发)。

3. 企业级智能体规模化部署

团队能力标准化:通过技能库沉淀标准化开发流程、代码规范、部署方案,新成员与新智能体可快速复用,降低团队协作成本。

数据安全可控:本地自托管模式下,所有代码、任务、数据存储在企业内部服务器,满足金融、政企等行业数据合规要求。

智能体资产管理:统一管理企业内部所有AI智能体,监控使用状态、执行效率、成本消耗,实现智能体资源的精细化管控。

4. 技术团队技能沉淀与传承

解决方案固化:将复杂问题(如系统迁移、框架升级、性能优化)的解决过程沉淀为技能,避免人员流动导致的能力流失。

新人快速上手:新成员通过调用成熟技能、参考智能体执行案例,快速熟悉项目流程与技术栈,缩短适应周期。

知识体系化:零散的开发经验转化为结构化技能库,形成团队专属的AI驱动知识体系。

五、使用方法与部署教程

Multica提供云端SaaS(快速上手)与本地自托管(生产部署)两种使用方式,操作简单、门槛较低:

方式一:云端SaaS使用(推荐新手)

注册登录:访问官方网站 multica.ai,通过邮箱注册账号,无需任何配置,系统自动创建默认工作区。

安装CLI工具

# macOS/Linux(Homebrew) brew tap multica-ai/tap brew install multica # 通用安装脚本(macOS/Linux/Windows) curl -fsSL https://raw.githubusercontent.com/multica-ai/multica/main/scripts/install.sh | bash

登录并启动本地守护进程

multica login # 浏览器授权登录,生成90天有效Token multica daemon start # 启动本地运行时,自动检测已安装的智能体CLI

创建智能体并分配任务

Web端进入「设置 → Agents → 新建Agent」,填写名称、选择运行时与智能体类型(Claude Code/Codex)。

在任务看板创建Issue,指派给对应智能体(紫色机器人图标),智能体自动领取并执行任务。

方式二:本地自托管部署(生产环境)

前置条件:安装Docker、Docker Compose、Go环境

克隆项目并配置环境

git clone https://github.com/multica-ai/multica.git cd multica cp .env.example .env # 复制环境变量模板,编辑修改JWT_SECRET、DATABASE_URL等核心配置

启动服务端

# 启动Docker服务 docker compose -f docker-compose.selfhost.yml up -d # 执行数据库迁移 cd server && go run ./cmd/migrate up && cd .. # 启动前端服务 make start

访问与配置:访问

http://localhost:3000进入Web界面,后续步骤同云端SaaS使用流程。

核心使用流程

环境准备:安装对应AI编程智能体CLI(Claude Code/Codex等)并配置API密钥。

连接运行时:启动Multica Daemon,确认Web端「设置 → Runtimes」显示本地机器在线。

创建智能体:配置智能体名称、指令(Instructions)、绑定技能、设置执行权限。

分配任务:看板创建任务 → 指派智能体 → 监控执行进度 → 查看结果与日志。

沉淀技能:任务完成后,将有效解决方案保存为团队技能,供后续复用。

六、竞品对比分析

选取Claude Managed Agents、Claude Cowork、AutoGPT三款主流智能体工具,从核心定位、功能特性、部署模式、适用场景等维度与Multica对比:

| 对比维度 | Multica | Claude Managed Agents | Claude Cowork | AutoGPT |

|---|---|---|---|---|

| 项目定位 | 开源托管智能体协作平台 | 闭源企业级智能体托管服务 | Claude专属桌面智能体应用 | 通用自主AI智能体框架 |

| 开源协议 | Apache 2.0(完全开源) | 闭源商业服务 | 闭源免费应用 | MIT开源 |

| 智能体支持 | 多厂商兼容(Claude/Codex/OpenCode等) | 仅Claude系列智能体 | 仅内置Claude智能体 | 支持多模型,需自行适配 |

| 协作模式 | 团队级看板协作、任务指派、状态同步 | 企业级API集成、批量任务管理 | 单用户桌面交互、本地执行 | 单智能体自主迭代、无团队协作 |

| 技能复用 | 完善团队技能库、可检索可扩展 | 基础技能模板、不可自定义 | 会话保存、无结构化技能 | 记忆碎片化、无体系化沉淀 |

| 部署模式 | 云端SaaS+本地自托管 | 仅云端托管 | 仅本地桌面 | 本地部署+云端API调用 |

| 数据安全 | 本地执行、数据完全可控 | 数据存储于Anthropic服务器 | 本地存储、无云端同步 | 本地执行,依赖模型API |

| 适用场景 | 研发团队人机协同、多智能体管理、技能沉淀 | 大型企业规模化智能体部署 | 个人开发者本地AI辅助 | 通用自主任务、非编程场景为主 |

| 成本 | 开源免费,自托管无额外费用 | 按调用量付费,价格较高 | 免费使用,依赖Claude API | 开源免费,需承担模型API费用 |

核心差异总结

Multica vs Claude Managed Agents:两者功能高度重合,但Multica主打开源免费、自托管可控、厂商中立;Claude Managed Agents为闭源商业服务,仅支持Claude智能体,成本更高但企业级服务更完善。

Multica vs Claude Cowork:Claude Cowork是单用户桌面工具,仅支持Claude;Multica是团队协作平台,支持多智能体、多工作区、任务全流程管理,协作能力更强。

Multica vs AutoGPT:AutoGPT聚焦通用自主智能体,无团队协作与编程专项优化;Multica专为编程场景设计,深度适配研发工作流,团队协作与技能沉淀是核心优势。

七、常见问题解答

Multica支持哪些AI编程智能体?

Multica官方支持Claude Code、OpenAI Codex、OpenClaw、OpenCode四款主流编程智能体,所有符合ACP(Agent Control Protocol)协议的智能体均可无缝适配,团队可根据需求自由选择或组合使用。

使用Multica时,代码数据会泄露吗?

不会。Multica采用「本地执行+云端协调」架构,智能体的代码编写、执行、调试全程在用户本地机器完成,仅任务状态、进度、日志等非核心数据同步至服务端,代码文件不会上传至任何第三方服务器,自托管模式下数据完全存储在本地,安全性拉满。

本地自托管需要哪些硬件配置?

基础配置:2核CPU、4GB内存、20GB存储空间,可支撑小型团队(5-10人)日常使用;中型团队(20-50人)建议4核8GB以上,硬件需求主要取决于并发智能体数量与任务复杂度,普通开发机器即可满足部署要求。

没有编程基础可以使用Multica吗?

基础任务分配、进度查看可通过Web界面可视化操作,无需编程基础;但智能体配置、指令编写、技能自定义需要了解基本开发概念,更适合开发者、技术团队使用,非技术人员可参与任务查看与结果验收。

Multica与传统AI代码助手(GitHub Copilot)有什么区别?

GitHub Copilot是编辑器内被动代码补全工具,依赖人工触发;Multica是主动协作平台,智能体可自主领取任务、全流程执行、团队互动、沉淀技能,相当于「Copilot的团队协作升级版」,从单人辅助升级为团队协同。

如何更新Multica到最新版本?

CLI工具:macOS/Linux用

brew upgrade multica,Windows重新运行安装脚本即可。自托管服务:停止现有容器→

git pull拉取最新代码→重新执行docker compose up -d与数据库迁移命令。

Multica可以用于非编程场景吗?

核心定位是编程智能体协作,当前功能围绕研发场景优化;理论上可通过自定义技能适配文档撰写、数据分析等场景,但适配成本较高,非编程场景更推荐通用智能体工具。

八、官方链接

官方网站(云端SaaS):https://multica.ai

九、总结

Multica作为开源AI智能体协作领域的标杆项目,以“智能体即队友”为核心,通过完善的任务管理、拟人化协作、技能沉淀、统一运行时、多团队隔离五大核心能力,成功将AI编程智能体从碎片化辅助工具升级为可深度融入研发流程的团队协作成员,兼具云端SaaS的便捷性与本地自托管的安全性,完全开源免费且厂商中立,适配个人开发者、小型团队、中型企业的多元场景,有效解决了传统AI工具无法规模化协作、能力难以沉淀、数据安全不可控的行业痛点,为研发团队提供了一套成熟、高效、安全的人机协同开发解决方案,是当前AI智能体工程化落地的优质选择。

版权及免责申明:本文由@AI工具箱原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/multica.html