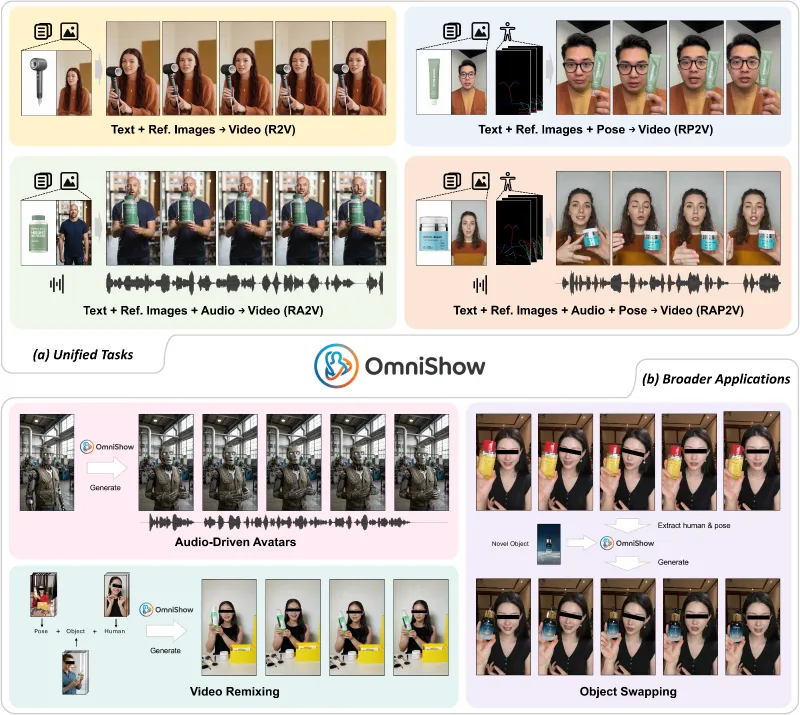

OmniShow:字节跳动和香港中文大学等联合开源的全模态人-物交互视频生成模型

一、OmniShow是什么

OmniShow是由字节跳动、香港中文大学、莫纳什大学、香港大学联合研发并开源的端到端多模态人-物交互视频生成(HOIVG)统一模型。它是业界首个完整支持RAP2V(Reference+Audio+Pose→Video)的单架构模型,以12.3B参数统一处理文本、参考图像、音频、姿态四类条件输入,直接生成最长10秒、高保真、自然流畅的人-物交互视频。

核心定位:解决多模态条件下人物与物体交互视频生成的一致性、同步性、真实性难题,让一张图片+一段语音/姿态序列,即可自动生成人物拿取、操作、展示物体的完整视频,无需多模型拼接、后期剪辑。

二、功能特色

2.1 全模态统一条件支持(四大输入)

参考图像(Reference):单张人物/物体图,精准保留外观、身份、物体细节

音频(Audio):语音/音效驱动口型、表情、动作节奏,毫秒级同步

姿态(Pose):SMPL/XR姿态序列,控制肢体运动轨迹、关节角度

文本(Text):描述交互动作、场景、风格,补充语义约束

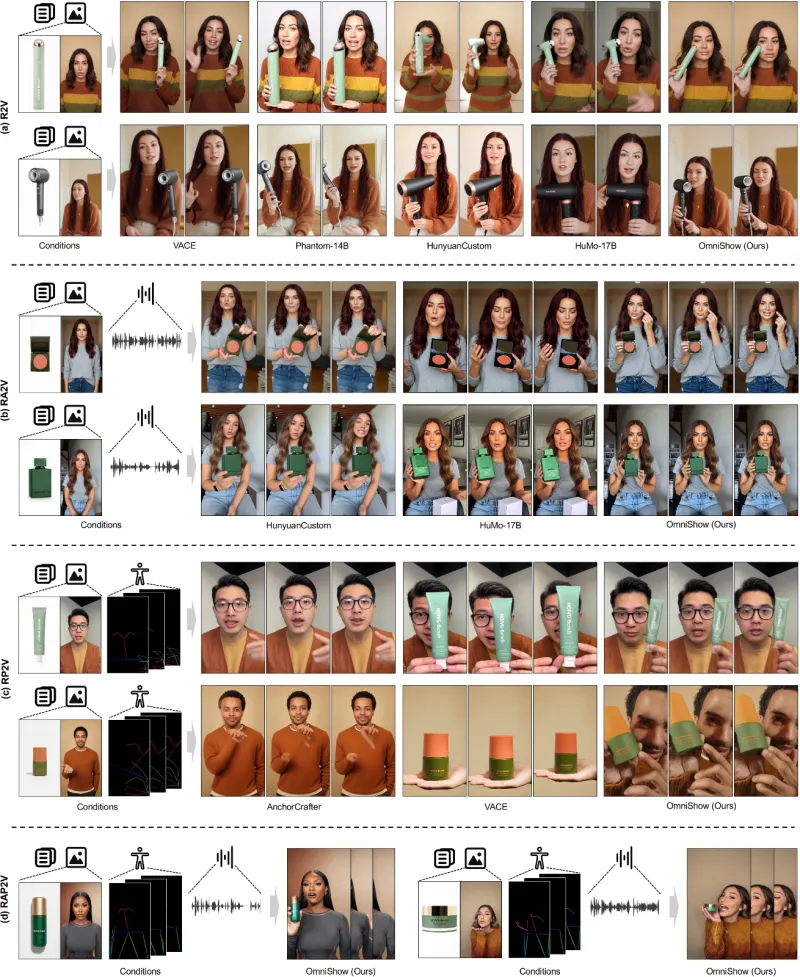

2.2 四大生成模式全覆盖

R2V(参考图→视频):单图生成动态交互视频(如人物拿起杯子、展示商品)

RA2V(参考图+音频→视频):语音驱动人物说话+动作(如主播讲解产品)

RP2V(参考图+姿态→视频):姿态序列控制精准动作(如弹奏乐器、操作工具)

RAP2V(全条件→视频):图+音+姿+文联合驱动,业界唯一完整支持,效果最精准

2.3 核心能力亮点

高保真参考保留:人脸、物体纹理、服饰细节高度一致,无畸变、身份稳定

自然运动动态:肢体、手部、物体交互符合物理规律,无穿模、动作流畅

精准音画同步:口型、表情、动作与音频时间对齐,误差<人类感知阈值

长视频原生支持:最长10秒连续视频,无需分段拼接、动态连贯

人-物交互特化:针对抓取、握持、操作、展示优化,物体稳定性强

端到端一键生成:单模型推理,无中间步骤、无需专业后期

三、技术细节

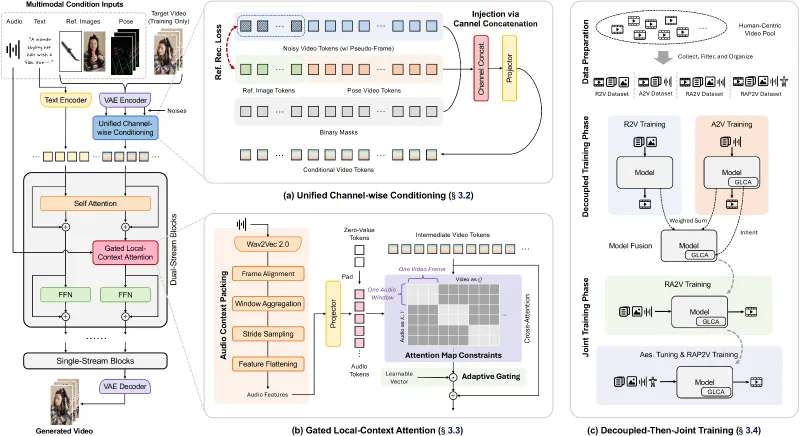

3.1 整体架构(12.3B参数DiT主干)

基于视频扩散Transformer(Video DiT)架构,三大核心模块:

条件编码器:分别编码图像(CLIP+ViT)、音频(Whisper+CNN)、姿态(SMPL Transformer)、文本(T5)

统一条件注入器:通道级拼接(Channel-wise Concatenation),将多模态特征融合为统一条件向量

时空DiT主干:3D卷积+时间注意力,建模视频时序与空间依赖

3D VAE解码器:输出高清视频帧(720P/1080P,30fps)

3.2 三大技术创新

(1)通道式统一条件注入

原理:将参考图、姿态特征沿通道维度拼接,与文本/音频特征融合后注入DiT

优势:不破坏预训练视频先验,高效传递外观+运动+语义信号,兼容性强

(2)门控局部上下文注意力(Gated Local Context Attention)

音频特征打包为上下文向量,通过掩码注意力聚焦面部/手部/物体区域

可学习门控向量:动态平衡多模态特征权重,抑制干扰、强化同步关联

效果:音画同步误差<0.1s,口型自然、动作节奏精准

(3)解耦-联合训练范式

阶段1:专项解耦训练

R2V子模型:学习图像→视频映射

A2V子模型:学习音频→视频映射

阶段2:权重插值融合

两子模型权重线性插值,初始化全模态模型

阶段3:联合微调

混合HOIVG-Bench等数据,优化多模态协同一致性

3.3 评测基准:HOIVG-Bench

135个精标样本:覆盖人物+物体交互、多场景、多模态条件

指标:NexusScore(综合)、AES(动作自然度)、VQ(视频质量)、MQ(物体稳定性)、FaceSim(人脸相似度)、TA(时序对齐)

结果:OmniShow在R2V/RA2V/RAP2V全任务SOTA,NexusScore领先竞品5%~12%

四、应用场景

4.1 电商广告与商品展示

产品演示:单张模特+产品图+讲解音频→生成手持展示、功能演示视频

短视频带货:批量生成商品开箱、试用、对比视频,降本90%+

4.2 AI数字人与虚拟主播

音频驱动数字人:真人/卡通形象+语音→生成口型精准、动作自然的播报视频

虚拟偶像:姿态+音频→生成唱歌、跳舞、互动视频

4.3 内容创作与短视频

静态图转动态:照片→人物互动、场景动态化

视频混剪/修复:参考图+音频→补全片段、替换人物/物体

教育/科普:示意图+讲解→生成操作演示、原理动画

4.4 游戏与元宇宙

角色动画:单张角色图+姿态→生成NPC交互动作

虚拟场景:人物+物体交互视频填充虚拟世界

4.5 企业与营销

企业文化:员工照片+语音→生成致辞、介绍视频

产品教程:步骤图+语音→生成操作教学视频

五、使用方法

5.1 环境部署(代码开源后)

# 1. 克隆仓库 git clone https://github.com/Correr-Zhou/OmniShow.git cd OmniShow # 2. 安装依赖(Python 3.10+,CUDA 11.7+) pip install torch torchvision torchaudio pip install -r requirements.txt # 3. 下载模型权重(Hugging Face) bash scripts/download_weights.sh

5.2 输入准备

参考图:JPG/PNG,人物正面/半身、物体清晰,分辨率≥512×512

音频:WAV/MP3,单声道,16kHz,时长≤10秒

姿态:.npy/.json(SMPL-X),帧率30fps,与音频时长匹配

文本:英文/中文提示词(如:"A woman holding a white mug and speaking clearly")

5.3 推理命令(示例)

# RAP2V 全模态推理 python infer.py \ --mode RAP2V \ --ref_img assets/demo/ref.jpg \ --audio assets/demo/speech.wav \ --pose assets/demo/pose.npy \ --text "A person holding a product and explaining its features" \ --output outputs/demo.mp4 \ --duration 10 \ --resolution 720p

5.4 输出结果

格式:MP4,30fps,720P/1080P

时长:最长10秒

内容:人物+物体自然交互、音画同步、参考高度保留

六、竞品对比

表1:OmniShow vs OmniHuman vs DreaMoving vs Runway Gen-3

| 对比维度 | OmniShow | OmniHuman | DreaMoving | Runway Gen-3 |

|---|---|---|---|---|

| 研发机构 | 字节+港中文+港大+莫纳什 | 字节跳动 | 开源社区 | Runway |

| 核心定位 | 人-物交互视频(全模态) | 人物全身动画(单图+音频) | 姿态驱动人物视频 | 通用文生视频 |

| 模态支持 | 图+音+姿+文(RAP2V) | 图+音 | 图+姿 | 文本为主 |

| 人-物交互 | ✅ 原生特化、最优 | ✅ 支持、一般 | ❌ 弱、无物体优化 | ❌ 差、易穿模 |

| 音画同步 | ✅ 毫秒级(<0.1s) | ✅ 优秀(<0.2s) | ❌ 无音频支持 | ⚠️ 需插件、一般 |

| 最长时长 | 10秒(原生) | 8秒 | 5秒 | 4~6秒 |

| 参考保留 | ✅ 人脸/物体双高保真 | ✅ 人脸高保真 | ⚠️ 人脸一般 | ❌ 低、易形变 |

| 开源状态 | ✅ 已开源(2026.4) | ✅ 已开源 | ✅ 已开源 | ❌ 闭源服务 |

| 参数规模 | 12.3B | 6.7B | 3.4B | 20B+(未公开) |

| 最佳场景 | 电商、产品演示、数字人 | 虚拟主播、肖像动画 | 姿态动画、短视频 | 创意文生视频 |

七、常见问题解答(FAQ)

Q:OmniShow支持中文语音驱动吗?

A:支持。模型采用多语言音频编码器,可处理中文、英文、日语等主流语言语音,口型同步效果一致。

Q:生成10秒视频需要什么硬件配置?

A:推荐NVIDIA RTX 4090/3090Ti(24GB+显存)、CUDA 11.7+;10秒720P视频生成约3~5分钟。

Q:可以生成非真人、卡通/动漫风格视频吗?

A:支持。输入卡通形象参考图+对应条件,可生成卡通风格人-物交互视频;风格一致性取决于参考图质量。

Q:物体交互支持哪些类型?是否稳定?

A:支持抓取、握持、展示、操作、移动等主流交互;模型在HOIVG-Bench上物体稳定性(MQ)达5.885(SOTA),几乎无抖动、掉落。

Q:文本提示词用中文还是英文效果更好?

A:英文提示词精度更高(模型训练数据以英文为主);中文提示词可正常使用,但建议简洁明确(如:"男人手持红色手机,微笑讲解")。

Q:是否支持本地部署、离线使用?

A:支持。模型完全开源,权重可本地下载,无网络、无API调用,隐私数据安全。

Q:与OmniHuman的核心区别是什么?

A:OmniHuman专注人物全身动画(无物体交互);OmniShow原生强化人-物交互,支持姿态+音频全模态,是OmniHuman的场景扩展升级版。

Q:生成视频有水印或版权限制吗?

A:开源版本无水印、无版权限制,个人/商业均可免费使用;需遵循MIT开源协议。

八、相关链接

技术论文(arXiv):https://arxiv.org/abs/2604.11804

九、总结

OmniShow作为业界首个全模态统一人-物交互视频生成开源模型,以单架构整合文本、参考图、音频、姿态四类条件,通过通道式条件注入、门控局部注意力、解耦-联合训练三大技术突破,在人-物交互真实性、音画同步精度、参考保留度、长视频稳定性上全面达到SOTA水平,覆盖R2V/RA2V/RP2V/RAP2V全任务场景,适配电商广告、AI数字人、短视频创作、产品演示等多元落地需求,凭借完全开源、本地部署、无版权限制的特性,为内容创作者、企业开发者、研究人员提供了高效、低成本、高质量的视频生成解决方案,是当前多模态视频生成领域最具实用价值的开源工具之一。

版权及免责申明:本文由@AI工具箱原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/omnishow.html