OmniWeaving:腾讯混元联合浙大等开源的统一视频生成模型

一、OmniWeaving是什么?

OmniWeaving是腾讯混元HunyuanVideo团队主导研发的下一代统一视频生成开源项目,核心定位是打破传统视频生成模型单模态、弱推理、固定生成逻辑的局限,实现文本、图像、视频等多模态信号自由组合输入,并通过预训练获得意图理解与逻辑推理能力,自动完成场景编排、元素组合、时序规划等创作行为。

该项目总有效参数超150亿,训练基于400块NVIDIA H100 GPU完成,支持480P分辨率、最长161帧(约10秒)视频生成,是当前开源领域兼具生成质量、模态灵活性与智能性的标杆级视频生成方案。

与常规视频生成模型不同,OmniWeaving不只是“执行生成指令”,而是能理解模糊需求、推理创作逻辑、整合多源素材,更贴近人类导演的创作思维,同时完全开源可本地部署、可微调、可二次开发,兼顾学术研究与产业落地需求。

二、核心功能特色

自由多模态组合输入

支持文本提示词、单张/多张参考图、视频片段任意交错组合输入,无需固定格式约束,可实现文生视频、图生视频、视频续编、多图转视频、图文视频混合创作等全场景能力。强意图推理与逻辑生成

模型在海量推理增强数据上预训练,可从模糊描述中推断用户真实需求,自动补充场景细节、运镜方式、动作逻辑、元素互动关系,解决传统模型“指令理解死板、画面缺乏逻辑”的问题。高保真长时长视频生成

默认输出480P分辨率、81帧(5秒/16fps),最高支持161帧长视频,搭配3D因果VAE视觉编码,画面细节清晰、时序流畅、无明显闪烁与畸变,生成质量达到开源SOTA水平。统一架构兼容多任务

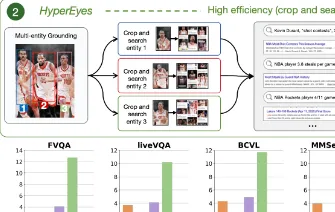

基于MMDiT扩散主干统一建模,无需为不同任务单独训练分支,同时覆盖视频生成、视频编辑、多模态条件生成、内容风格化等任务,降低开发与部署成本。配套专业评测基准

首发IntelligentVBench评测体系,包含复杂组合、意图推理、时序逻辑、多元素控制等专项测试集,填补行业缺乏智能视频生成评测标准的空白。完全开源可商用友好

代码、权重、数据集、评测工具全量开源,支持本地部署、模型微调、API封装与二次开发,授权协议宽松,适合科研机构、开发者与中小企业使用。

三、核心技术细节

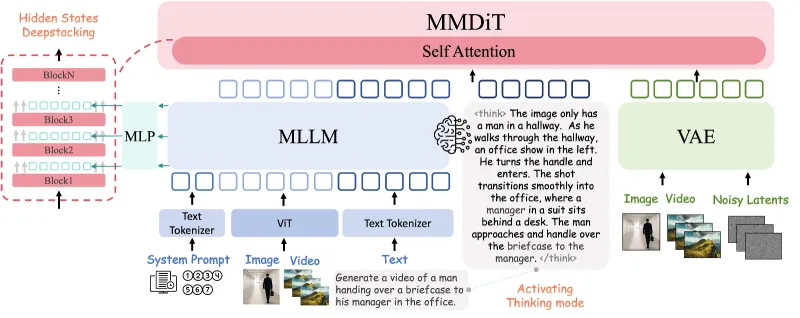

OmniWeaving采用三模块协同架构,从模态理解、时序建模到视觉重建形成完整链路,技术设计兼顾智能性与生成效率。

1. 整体技术架构

多模态大语言理解单元(MLLM):基于Qwen 2.5-VL,负责解析文本、图像、视频混合输入,提取语义、空间、时序信息并编码为统一条件信号。

MMDiT扩散主干网络:以HunyuanVideo-1.5为基座,采用时空联合注意力机制,建模视频帧间因果关系,实现高可控、高流畅度的潜变量生成。

3D因果VAE视觉编码器:对视觉信号进行时空压缩与重建,保留细节同时降低计算开销,保证生成视频的清晰度与稳定性。

2. 关键技术参数

| 技术维度 | 核心参数 |

|---|---|

| 模型总参数 | 15B+ |

| 训练硬件 | 400×NVIDIA H100 |

| 训练分辨率 | 480P |

| 最大生成帧数 | 161帧 |

| 默认帧率 | 16fps |

| 支持模态 | 文本、图像、视频 |

| 显存需求 | 完整加载≥45GB |

3. 训练与推理设计

训练采用全局Batch Size=400,在大规模多模态组合与推理增强数据上迭代优化,强化模型对复杂意图的理解能力。

推理支持CPU Offloading显存优化,可将部分参数卸载至内存,降低单卡显存门槛;同时支持8卡并行推理,提升生成速度。

采用潜空间扩散生成方式,先在低维潜变量中迭代去噪,再通过VAE解码为像素级视频,平衡速度与画质。

四、典型应用场景

内容创作与短视频生产

快速将文案、参考图生成营销短视频、剧情片段、知识科普视频,无需拍摄与剪辑,大幅降低内容生产周期。影视与动画前期预演

导演可通过文字+分镜图组合生成动态预演视频,验证镜头逻辑、场景衔接与叙事节奏,提升前期创作效率。数字内容与AIGC工具开发

开发者基于开源代码封装视频生成API、搭建在线创作平台,或集成到剪辑软件、设计工具中提供AI生成能力。学术研究与模型迭代

为视频生成、多模态大模型、时序扩散模型方向提供研究基座,支持架构改进、微调优化、新评测方法探索。企业宣传与视觉素材制作

品牌方快速生成产品展示视频、活动宣传短片、虚拟场景演示,低成本批量产出高质量视觉素材。教育与虚拟演示内容

生成教学动画、实验演示、虚拟场景讲解视频,适用于在线教育、课件制作、职业培训等场景。

五、快速使用方法

1. 环境准备

# 克隆仓库 git clone https://github.com/Tencent-Hunyuan/OmniWeaving.git cd OmniWeaving # 创建虚拟环境 conda create -n omniweaving python=3.10 conda activate omniweaving # 安装依赖 pip install -r requirements.txt

2. 模型权重获取

从Hugging Face下载tencent/HY-OmniWeaving权重,放置到项目指定目录:

huggingface-cli download tencent/HY-OmniWeaving --local-dir ./weights

3. 基础推理命令

# 文生视频基础推理 python generate.py \ --prompt "A cat walking on a snowy mountain at sunset" \ --model_path ./weights \ --fps 16 \ --frames 81 \ --output ./output/cat_video.mp4

4. 多模态组合推理

# 文本+图像生成视频 python generate.py \ --prompt "A dog running in the park, sunny day" \ --image_path ./ref/dog.jpg \ --model_path ./weights \ --output ./output/dog_park.mp4

5. 显存优化配置

开启CPU卸载降低显存占用:

python generate.py \ --prompt "Your prompt" \ --cpu_offload True \ --output ./output/video.mp4

六、竞品对比分析

当前主流视频生成模型可分为开源与闭源两类,OmniWeaving在开源性、模态组合、智能推理维度具备显著优势。

| 对比维度 | OmniWeaving | Seedance 2.0 | Open-Sora-Plan | Univideo |

|---|---|---|---|---|

| 开源状态 | 完全开源 | 闭源 | 部分开源 | 部分开源 |

| 模态组合 | 文本/图像/视频自由组合 | 多模态受限 | 以文本为主 | 单模态为主 |

| 意图推理 | 强推理能力 | 基础指令跟随 | 弱推理 | 无推理 |

| 生成分辨率 | 480P | 2K | 720P | 480P |

| 本地部署 | 支持 | 不支持 | 支持 | 支持 |

| 模型规模 | 15B+ | 超大闭源模型 | 轻量/中型 | 中型 |

核心优势总结:

对比闭源的Seedance 2.0:OmniWeaving完全开源可本地部署,数据隐私可控,支持微调与二次开发。

对比Open-Sora-Plan、Univideo:OmniWeaving具备原生意图推理与自由模态组合能力,更适合复杂创作需求。

七、常见问题解答

Q:OmniWeaving支持最高多大分辨率和时长?

A:官方默认支持480P分辨率,最长可生成161帧视频,16fps下约10秒;通过参数调整可在显存允许范围内小幅扩展时长与分辨率。

Q:单张显卡可以运行OmniWeaving吗?

A:官方推荐8卡H100并行推理,完整模型加载需≥45GB显存;开启CPU Offloading后,可在24GB及以上显存显卡运行,速度会明显降低。

Q:OmniWeaving支持商用吗?

A:项目遵循开源协议,允许非商用与商用使用,具体授权条款以仓库LICENSE文件为准,使用前建议仔细阅读。

Q:生成视频出现闪烁、卡顿如何解决?

A:可增加生成帧数、提升采样步数、关闭不必要的显存优化、使用官方默认参数配置,同时确保显卡驱动与PyTorch版本为最新稳定版。

Q:如何微调OmniWeaving适配自定义数据集?

A:仓库提供train.py训练脚本与process_data数据处理工具,按照文档格式整理自定义数据,配置训练参数即可启动微调。

Q:IntelligentVBench评测基准如何使用?

A:项目内置intelligentVBench目录,包含测试用例与评测脚本,直接运行对应脚本即可在模型上完成自动化评测并输出结果。

Q:是否支持ComfyUI等可视化工具调用?

A:社区已推出ComfyUI适配节点,可通过第三方插件实现可视化调用,官方仓库会持续更新生态适配方案。

八、官方链接

Hugging Face模型权重:https://huggingface.co/tencent/HY-OmniWeaving

IntelligentVBench评测数据集:https://huggingface.co/datasets/midbee/IntelligentVBench

九、总结

OmniWeaving作为腾讯混元团队开源的统一视频生成模型,以多模态自由组合、强意图推理、高生成质量为核心优势,搭配完整的代码、权重、训练工具与专业评测基准,解决了传统视频生成模型模态单一、逻辑薄弱、部署受限的行业痛点,既为AI视频生成领域提供了可直接使用的研究基座,也为开发者与企业提供了可落地、可定制、可商用的开源方案,凭借开源开放与智能生成的双重特性,成为当前AIGC视频方向极具价值的技术项目。

版权及免责申明:本文由@dotaai原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/omniweaving.html