OpenWork:开源 AI 智能体工作流系统,可视化可控的 Claude Work 平替方案

一、OpenWork是什么

OpenWork是由different-ai团队开发并开源的、面向全品类知识工作者的可扩展AI智能体工作流系统,是一款基于OpenCode引擎构建的原生桌面应用,也是开源社区打造的类“Claude Work”风格平替方案,项目代码托管于GitHub,核心开发语言为TypeScript,目前已提供macOS端开箱即用的安装包,同时支持开发者基于源码二次开发。

该项目的诞生源于现有AI智能体工具的使用门槛与体验痛点:传统的OpenCode工具以CLI和GUI形式为主,核心面向开发者群体,操作需关注文件差异、工具名称等技术细节,且扩展能力受限,非技术人员难以上手;而商业产品Claude Work虽实现了产品化的智能体工作流,但存在闭源、可控性低等问题。OpenWork则精准填补了这一空白,将“智能体化工作(agentic work)”转化为普通用户可直接操作的产品形态,无需依赖终端命令行,让非开发者也能便捷、安全地使用AI智能体完成各类工作任务。

OpenWork的核心定位并非简单的工具复刻,而是打造一套产品化、可扩展、高可控的AI智能体工作体系,其核心设计理念围绕四大维度展开:一是可扩展,支持自由安装技能包(skill)和OpenCode插件模块,按需拓展AI智能体能力;二是可审计,全程记录AI的操作行为,清晰展示操作的时间、内容和执行原因,让AI工作流全流程透明化;三是权限可控,针对AI的特权操作流程设置严格的访问与审批机制,将最终控制权交还给人类用户;四是本地/远程兼容,既支持在个人电脑本地运行处理轻量任务,也可连接远程OpenCode服务器处理高负载的云端任务,兼顾使用灵活性与工作效率。

二、功能特色

OpenWork凭借“可视化、高可控、易扩展、强复用”的核心优势,彻底改变了传统AI智能体工具的使用体验,其功能特色既覆盖了基础的智能体工作流执行,也针对用户核心痛点做了针对性设计,核心特色可分为核心运行模式、可视化工作流、安全权限管理、灵活扩展能力、高效复用机制五大板块,同时搭配了实时更新、会话管理等实用辅助功能,全方位适配知识工作者的办公需求。

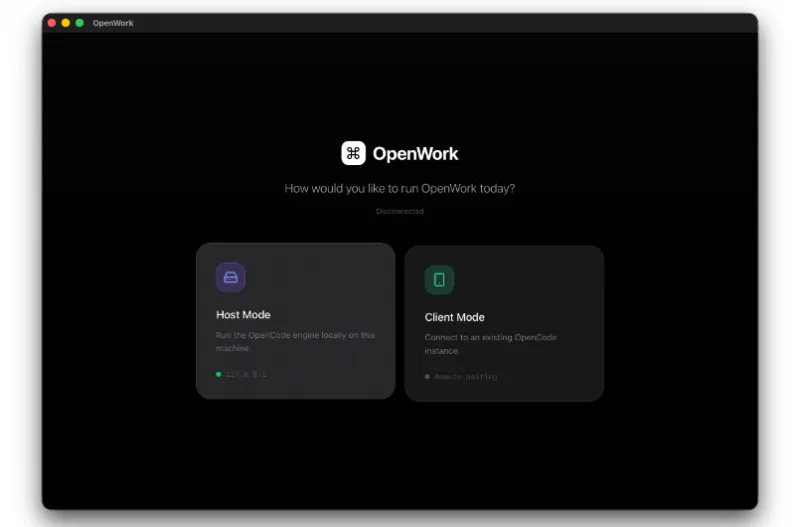

(一)双运行模式,兼顾本地与远程需求

OpenWork支持主机模式(Host mode)和客户端模式(Client mode)两种核心运行方式,用户可根据任务体量、设备性能灵活选择,无需适配不同的工具系统:

主机模式:直接在本地电脑启动OpenCode服务,将用户选定的项目文件夹作为专属工作目录,所有AI操作均在本地完成,数据无需上云,兼顾数据隐私与操作便捷性,适合处理轻量、私密的个人工作任务;

客户端模式:通过网络URL连接已部署的远程OpenCode服务器,将计算任务交由云端服务器处理,本地仅作为操作界面,适合处理高负载、大规模的团队协作任务,有效释放本地设备性能。

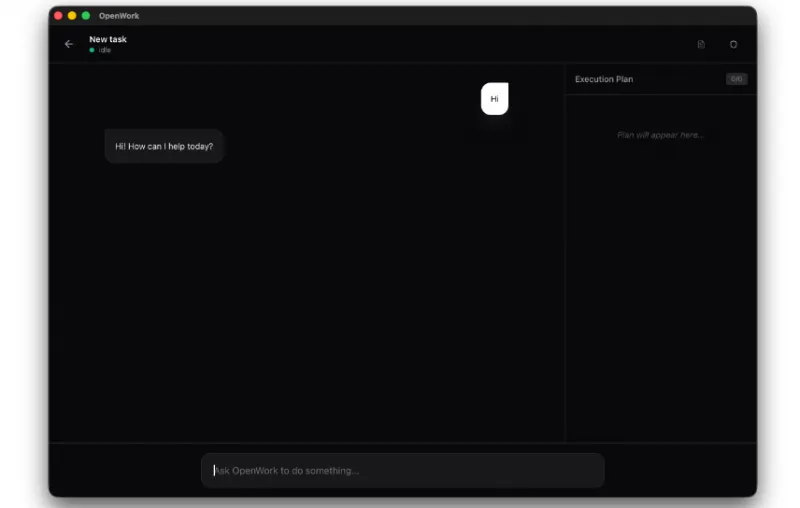

(二)全流程可视化,告别AI黑盒操作

这是OpenWork最核心的特色之一,彻底解决了传统AI智能体“操作不可见、进度无感知”的黑盒问题,通过可视化界面将AI的工作流全程展示给用户:

执行计划可视化:将OpenCode生成的待办事项(todos)转化为清晰的时间轴,用户可直观看到AI的执行计划、任务拆分逻辑和执行顺序,提前预判工作成果;

操作过程可视化:AI的每一步操作、文件修改、命令执行都会在界面实时展示,包括修改的文件内容、执行的系统命令、访问的文件路径等,让用户清晰掌握AI的工作细节;

进度更新可视化:通过SSE(Server-Sent Events)/event接口实现实时事件推送,AI的执行进度、完成状态、异常情况会同步更新至界面,无需用户手动刷新,实时掌握工作动态。

(三)精细化权限管理,筑牢操作安全防线

安全可控是OpenWork的核心设计原则,项目引入了Human-in-the-loop(人在回路)的设计理念,针对AI的所有特权操作设置严格的审批机制,彻底解决了用户使用AI智能体的“失控感”,也是区别于其他同类工具的关键亮点:

精准权限请求:当AI智能体需要执行敏感操作时,会自动向用户发起权限请求,敏感操作涵盖读取私密文件、执行系统命令、访问网络资源、修改核心配置等多个维度;

灵活审批选项:用户收到权限请求后,可根据实际需求选择允许一次、始终允许、拒绝三种操作,既避免了重复审批的繁琐,也能防止AI无限制执行敏感操作,实现“按需授权”;

操作全程审计:所有的权限审批记录与AI的操作行为会被统一记录,用户可随时回溯查看,明确操作的发起方、审批人、执行结果,便于事后审计与问题排查。

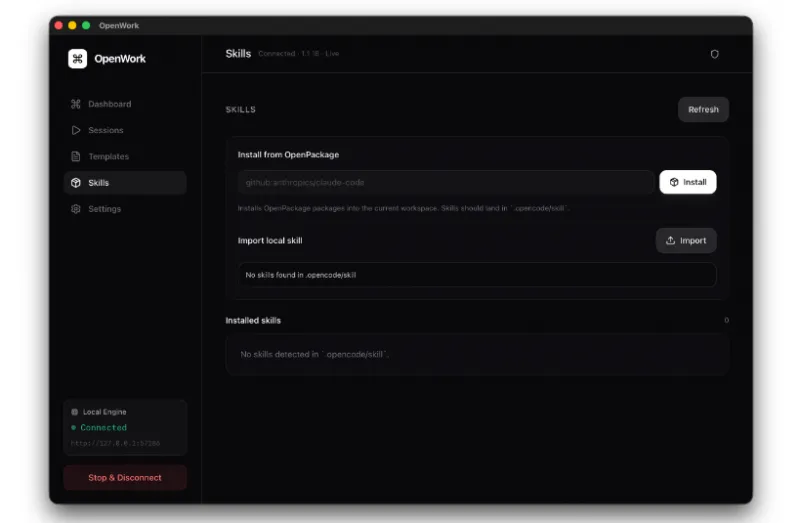

(四)高扩展性技能体系,按需拓展AI能力

OpenWork内置了技能管理器(Skills Manager),其设计逻辑类似VS Code的插件市场,无需修改项目底层源码,普通用户即可轻松拓展AI智能体的能力边界,让AI适配不同的工作场景:

多渠道技能安装:支持直接从OpenPackage(开源AI包管理平台)安装官方/社区开发的技能包,也支持导入本地的

.opencode/skill文件夹,实现自定义技能的快速部署;技能可视化管理:在技能管理器界面可直观看到已安装的所有技能包,包括技能名称、功能描述、安装路径,支持一键启用、禁用、卸载技能,操作简单易懂;

兼容OpenCode插件:无缝兼容OpenCode的插件模块,可直接将OpenCode的插件接入OpenWork系统,实现工具能力的复用,降低开发者的二次开发成本。

(五)高效工作流复用,大幅提升办公效率

针对重复度高的工作任务,OpenWork设计了模板复用机制,支持将验证过的优质工作流保存为模板,避免重复的操作与配置,让AI智能体的使用效率翻倍:

工作流一键保存:当用户完成一次完整的AI智能体工作流操作后,可将本次的会话配置、提示词、权限设置、执行步骤保存为自定义模板,存储于本地;

模板快速复用:后续遇到同类任务时,无需重新设置各项参数,直接调用已保存的模板,选择工作目录后即可一键启动AI执行,大幅缩短任务准备时间;

团队协作共享:模板以本地文件形式存储,可通过文件共享、代码仓库等方式在团队内部流转,实现优质工作流的团队共享,统一团队操作标准。

(六)便捷的基础辅助功能

除核心特色外,OpenWork还搭配了一系列贴合实际使用的基础功能,进一步优化使用体验:

灵活的会话管理:支持创建新会话、选择历史会话,每个会话独立存储配置与操作记录,可随时切换、继续执行,避免不同任务的操作混淆;

个性化提示词发送:在会话中可直接向AI智能体发送自定义提示词,精准下达工作指令,支持提示词的编辑、保存与复用;

轻量化桌面端体验:作为基于Tauri构建的原生桌面应用,OpenWork安装包体积小、运行占用资源少,启动速度快,相比传统的Electron应用,更符合桌面端的使用习惯。

三、技术细节

OpenWork的技术架构围绕“轻量、高效、跨端、易扩展”设计,底层基于OpenCode引擎构建,前端采用现代化的Web技术栈,桌面端通过Tauri实现跨平台打包,核心开发语言为TypeScript,后端依托Rust提升性能,整体架构分为前端UI层、核心服务层、引擎层、能力拓展层四层,各层解耦设计,既保证了系统的稳定性,也为后续的功能迭代与二次开发提供了便利,目前项目已实现macOS端的适配,后续将逐步支持Windows、Linux等系统。

(一)核心技术栈

OpenWork的技术栈选择兼顾了开发效率、运行性能与用户体验,前端以TypeScript为核心,搭配主流的构建与样式工具,桌面端由Tauri+Rust支撑,底层对接OpenCode引擎,具体核心技术栈如下表所示:

| 技术层面 | 核心技术/工具 | 核心作用 |

|---|---|---|

| 核心开发语言 | TypeScript | 前端源码开发,保证代码的类型安全与可维护性 |

| 桌面端框架 | Tauri + Rust | 构建原生桌面应用,实现跨平台兼容,降低运行资源占用,提供系统级文件操作、对话框等能力 |

| 构建工具 | Vite | 前端项目的快速构建与热更新,提升开发效率 |

| 样式工具 | Tailwind CSS | 快速实现前端界面的样式开发,保证界面风格统一 |

| 底层引擎 | OpenCode | 提供AI智能体的核心执行能力,处理任务调度、命令执行、文件操作等核心逻辑 |

| 实时通信 | SSE(Server-Sent Events) | 实现服务端到前端的实时事件推送,展示AI执行进度与操作更新 |

| 包管理器 | pnpm | 项目依赖的安装与管理,相比npm/yarn更节省磁盘空间,提升依赖安装速度 |

(二)整体架构设计

OpenWork采用前后端分离+引擎解耦的架构设计,各模块之间通过标准化的接口通信,核心架构逻辑如下:

前端UI层:基于TypeScript+Vite+Tailwind CSS开发,是用户与系统交互的核心入口,负责实现可视化界面、会话管理、权限审批、实时进度展示等功能,同时通过Tauri对话框插件实现本地文件夹选择、系统级交互等桌面端能力,权限控制定义在

src-tauri/capabilities/default.json文件中;核心服务层:分为本地服务与远程服务,主机模式下由OpenWork自动启动

opencode serve本地服务,绑定127.0.0.1与空闲端口,客户端模式下则连接远程OpenCode服务;该层负责处理前端的请求转发、事件推送、权限校验、会话管理等核心逻辑,通过SSE实现实时事件通信;引擎层:即OpenCode引擎,是OpenWork的核心能力支撑,负责解析用户的提示词、生成执行计划、执行系统命令、处理文件操作、管理待办事项等底层逻辑,所有AI智能体的实际操作均由该层完成;

能力拓展层:包括技能管理器、OpenCode插件模块、模板系统,通过标准化的接口与核心服务层、引擎层对接,实现AI能力的拓展与工作流的复用,该层是OpenWork可扩展性的核心体现。

(三)核心技术实现逻辑

实时事件推送:通过SSE的

/event接口实现,前端页面订阅该接口后,服务端会将AI的执行进度、操作记录、权限请求等事件实时推送给前端,无需前端手动轮询,保证界面更新的实时性;本地/远程服务切换:主机模式下,OpenWork会自动检测本地环境是否安装OpenCode CLI,若已安装则自动执行

opencode serve命令启动本地服务,并随机分配空闲端口,同时将用户选定的文件夹设为工作目录;客户端模式下,用户只需输入远程OpenCode服务器的URL,前端即可通过@opencode-ai/sdk/v2/clientSDK与远程服务建立连接,实现与本地模式一致的操作体验;权限控制实现:Tauri框架为OpenWork提供了系统级的权限管理能力,核心权限定义在

src-tauri/capabilities/default.json中,当AI需要执行敏感操作时,会先向核心服务层发起权限请求,服务层将请求推送给前端,用户审批后,服务层再将审批结果传递给OpenCode引擎,引擎根据审批结果执行/拒绝操作,全程形成“AI请求-用户审批-引擎执行”的闭环;技能包与插件管理:技能包以

.opencode/skill文件夹的形式存在,包含技能的配置、逻辑与执行脚本,技能管理器会扫描本地该路径下的所有文件夹,同时对接OpenPackage的接口获取线上技能包列表,用户安装/导入技能后,技能管理器会将技能信息注册到OpenCode引擎,引擎即可调用该技能完成对应任务;OpenCode插件则通过SDK直接接入引擎,实现能力的无缝复用。

(四)仓库核心结构

OpenWork的GitHub仓库采用清晰的目录结构,核心文件与目录按功能划分,便于开发者理解与二次开发,关键文件/目录的作用如下:

配置类文件:

package.json(项目依赖与脚本配置)、vite.config.ts(Vite构建配置)、tailwind.config.ts(Tailwind CSS样式配置)、tsconfig.json(TypeScript语法配置),是项目构建与运行的基础;源码目录:

src/(前端UI源码,包含页面、组件、状态管理、接口请求等核心逻辑)、src-tauri/(Tauri桌面应用源码,包含Rust代码、桌面端配置、权限定义等);文档类文件:

README.md(项目核心说明与快速上手指南)、design-prd.md(项目产品设计文档)、pr/(产品相关的详细文档);资源类目录:

public/(项目静态资源,包含应用图标、logo、静态页面等);技能/插件目录:

.opencode/skill/(本地技能包存储目录,支持用户自定义添加)。

四、应用场景

OpenWork作为一款面向全品类知识工作者的AI智能体工作流系统,凭借可视化、高可控、易扩展的特性,可适配个人办公、团队协作、研发开发、专业领域处理等多种场景,覆盖从简单的文档处理到复杂的项目开发等不同难度的工作任务,核心应用场景可分为以下六大类,同时适配本地单机使用与远程团队协作两种模式:

(一)个人日常办公自动化

针对职场人的日常办公重复任务,OpenWork可通过AI智能体实现自动化处理,大幅节省时间成本,适合新媒体运营、行政、文员等普通知识工作者:

文档处理:自动完成文档的整理、格式统一、内容提取、多语言翻译,例如将散乱的会议记录整理为结构化的纪要,将PDF文档转换为可编辑的Markdown格式,对英文文档进行实时中译;

数据处理:对Excel、CSV等格式的轻量数据进行清洗、分析、可视化,例如提取销售数据中的核心指标,生成简单的数据分析报表,无需掌握专业的数据分析工具;

办公流程自动化:自动完成邮件的撰写、发送、分类,例如根据模板一键生成工作汇报邮件并发送给指定对象,对收到的邮件进行自动分类归档。

(二)研发开发辅助

作为基于OpenCode构建的工具,OpenWork对开发者极为友好,可作为研发开发的AI辅助工具,适合前端、后端、全栈开发者等研发人员:

代码开发辅助:AI智能体可根据用户提示词生成基础代码片段,对现有代码进行重构、注释补充、bug排查,例如为Python项目的核心函数添加详细注释,重构低性能的JavaScript代码;

项目工程管理:自动完成项目的文件结构梳理、依赖管理、配置修改,例如为TypeScript项目自动安装所需的依赖包,修改项目的Vite/ Webpack配置,梳理项目的文件目录并生成说明文档;

开发流程自动化:自动执行项目的编译、打包、本地测试,例如对前端项目执行

pnpm build打包命令,对Rust项目执行cargo run本地运行命令,无需手动在终端输入指令。

(三)团队协作项目管理

针对小型团队的协作项目,OpenWork可实现工作流的标准化、自动化,提升团队协作效率,适合互联网、创业公司的小型研发、产品、设计团队:

项目进度管理:AI智能体可实时跟踪项目的执行进度,记录团队成员的操作行为,生成项目进度报表,例如对前端开发项目进行进度跟踪,及时反馈未完成的开发任务;

工作成果审计:全程记录团队成员通过AI智能体完成的操作,实现工作成果的可追溯,例如审计AI对项目代码的修改记录,明确代码变更的原因、时间与执行人;

团队工作流复用:将团队的标准化工作流保存为模板,供所有成员复用,例如将项目的初始化流程、测试流程保存为模板,新成员加入后可一键启动,统一团队操作标准。

(四)内容创作与生产

适合新媒体运营、文案策划、设计师等内容创作从业者,OpenWork可通过AI智能体实现内容的快速创作、素材整理与格式优化:

内容生成:根据用户的创作需求生成基础内容,例如生成公众号推文、短视频脚本、产品文案,用户只需在此基础上进行微调即可发布;

素材整理与优化:对创作素材进行统一整理、格式转换,例如将多张图片的说明文字整理为结构化的素材库,将设计稿的标注信息提取为文档;

多平台内容分发:通过安装对应的技能包,实现内容的一键多平台适配与分发,例如将公众号推文自动转换为小红书、抖音的文案格式。

(五)专业领域文档处理与分析

针对律师、财务、咨询等专业领域的工作需求,OpenWork可通过安装专业技能包,实现专业文档的智能化处理与分析,提升专业工作的效率:

法律领域:自动提取合同、诉状等法律文档的核心条款,识别潜在的法律风险点,例如审查劳动合同中的不合理条款,提取借款合同的金额、还款日期等核心信息;

财务领域:对财务报表、发票等文档进行核心信息提取、数据核对,例如提取增值税发票的开票信息、金额、税额,核对财务报表中的数据勾稽关系;

咨询领域:对行业研究报告、市场数据进行信息提取、整合分析,例如从多篇行业报告中提取核心市场数据,整合为一份结构化的分析文档。

(六)本地私密任务处理

针对涉及敏感数据、需要保证隐私的工作任务,OpenWork的主机模式可实现本地全流程运行,数据无需上云,适合金融、医疗、政府等对数据隐私要求高的行业:

敏感数据处理:在本地对客户信息、财务数据、医疗记录等敏感数据进行分析与处理,例如本地分析企业的核心财务数据,生成内部分析报表,避免敏感数据泄露;

私密文档创作:在本地完成商业计划书、项目提案等私密文档的创作与修改,AI的所有操作均在本地执行,保证文档内容的保密性。

五、使用方法

OpenWork提供开箱即用的安装包使用和开发者源码编译运行两种方式,目前v0.1.9版本已提供macOS端的DMG安装包,Windows、Linux端暂未提供官方安装包,可通过源码编译运行;两种使用方式均需提前满足基础的环境要求,整体操作流程简单易懂,非开发者也能快速上手。

(一)基础环境要求

无论是安装包使用还是源码编译,均需提前在本地安装OpenCode CLI并将其加入系统PATH,否则无法启动OpenCode核心服务;若选择源码编译运行,还需额外安装Node.js、pnpm、Rust工具链,具体环境要求如下:

通用要求:安装OpenCode CLI并配置系统PATH,可通过官方文档完成安装与配置;

源码编译额外要求:

Node.js(建议最新稳定版)+ pnpm包管理器;

Rust工具链:包含cargo、rustc,可通过rustup完成安装;

网络环境:可访问GitHub,用于拉取项目源码与安装依赖。

(二)方式一:非开发者开箱即用(仅macOS)

该方式适合非开发者用户,直接下载官方构建的安装包,安装后即可使用,全程无需接触代码,操作步骤如下:

访问OpenWork的GitHub仓库Releases页面,下载最新版本(v0.1.9)的macOS DMG安装包;

双击安装包,按照桌面应用安装指引完成安装,将OpenWork拖入应用程序文件夹;

打开OpenWork应用,首次启动会检测本地是否安装OpenCode CLI,若已安装则直接进入主界面,若未安装则会提示跳转至OpenCode官方安装文档;

进入主界面后,选择运行模式(主机模式/客户端模式),按照界面指引完成后续操作即可。

(三)方式二:开发者源码编译运行(全平台)

该方式适合开发者、技术人员,可基于源码二次开发,支持macOS、Windows、Linux全平台,核心通过pnpm命令完成依赖安装与项目启动,操作步骤如下:

拉取项目源码:打开终端,执行

git clone https://github.com/different-ai/openwork.git,将项目克隆到本地;进入项目目录:执行

cd openwork,切换到项目根目录;安装项目依赖:执行

pnpm install,通过pnpm安装项目所需的所有前端与桌面端依赖;启动运行:

启动完整桌面应用:执行

pnpm dev,会同时启动前端界面与Tauri桌面端,直接进入OpenWork操作界面;仅启动Web界面:执行

pnpm dev:web,仅启动前端Web界面,可通过浏览器访问,适合前端开发调试;首次启动后,按照界面指引选择运行模式与工作目录,即可开始使用。

(四)核心操作流程

无论采用哪种使用方式,OpenWork的核心操作流程均保持一致,遵循选择工作区→选择运行模式→启动AI工作流→实时监控与权限审批→查看结果与复用的步骤,全程可视化操作,具体如下:

选择工作区:在OpenWork主界面选择本地一个文件夹作为工作目录,AI的所有操作均会在该目录下执行,避免误操作其他文件;

选择运行模式:根据需求选择主机模式或客户端模式,主机模式直接下一步,客户端模式需输入远程OpenCode服务器的URL并完成连接;

启动AI工作流:创建新会话,在输入框中向AI智能体发送自定义提示词(即工作指令),点击启动按钮,AI会生成执行计划并开始执行;

实时监控与权限审批:在界面实时查看AI的执行进度与操作记录,若AI发起权限请求,根据需求选择“允许一次/始终允许/拒绝”;

查看结果与复用:AI执行完成后,在工作目录中查看工作成果,若该工作流需要重复使用,可将其保存为模板,后续一键调用。

(五)技能包安装与使用

通过技能管理器拓展AI能力的操作流程简单,支持本地导入和线上安装两种方式,具体步骤如下:

打开OpenWork主界面的技能管理器入口,进入技能管理页面;

线上安装:在技能市场列表中选择需要的技能包,点击“安装”,等待安装完成后即可启用;

本地导入:将自定义的技能包文件夹放入本地

.opencode/skill目录,在技能管理器中点击“刷新”,即可看到并启用该技能;技能使用:安装并启用技能后,在会话中向AI发送提示词时,AI会自动调用对应的技能完成任务,无需额外配置。

六、常见问题解答

问题:启动OpenWork时提示“未找到OpenCode CLI”,如何解决?

解决方案:首先确认已安装OpenCode CLI,可在终端执行opencode --version验证,若未安装则参考OpenCode官方文档完成安装;若已安装仍提示,需将OpenCode CLI的安装路径添加到系统PATH中,重启终端与OpenWork即可。

问题:执行pnpm install时依赖安装失败,提示网络超时/包不存在?

解决方案:一是检查网络环境,确保可正常访问GitHub与npm仓库;二是切换pnpm的镜像源,执行pnpm config set registry https://registry.npmmirror.com/切换为国内镜像源,重新执行安装命令;三是清理pnpm缓存,执行pnpm store prune后重新安装。

问题:安装Rust工具链后,执行pnpm dev仍提示“cargo未找到”?

解决方案:Rust安装完成后,需将cargo的路径添加到系统PATH中,不同系统的路径不同:macOS/Linux为~/.cargo/bin,Windows为%USERPROFILE%\.cargo\bin;添加后重启终端,执行cargo --version验证,再重新启动OpenWork。

问题:macOS端安装OpenWork后,打开提示“无法验证开发者”,无法启动?

解决方案:这是macOS的系统安全设置导致,右键点击OpenWork应用,选择“打开”,在弹出的提示框中再次点击“打开”即可,首次打开需通过该方式绕过验证,后续可直接双击启动。

问题:主机模式下启动后,提示“端口被占用”,无法启动OpenCode服务?

解决方案:OpenWork会自动选择空闲端口启动服务,若提示端口被占用,可关闭本地占用端口的其他程序,或重启OpenWork,系统会重新分配新的空闲端口。

问题:客户端模式下无法连接远程OpenCode服务器,提示“连接超时”?

解决方案:首先确认远程OpenCode服务器已正常启动并对外提供服务,其次检查本地网络是否可访问该服务器的URL,最后确认服务器未设置防火墙/端口屏蔽,开放了对应的服务端口。

问题:AI执行过程中,未收到权限请求,但AI无法执行敏感操作?

解决方案:首先确认OpenWork的权限设置未禁用该类敏感操作,可在src-tauri/capabilities/default.json中检查权限配置;其次检查会话是否为正常状态,若会话中断,可重新启动会话并再次执行任务。

问题:导入本地技能包后,技能管理器中未显示,无法使用?

解决方案:首先确认本地技能包文件夹的路径为.opencode/skill,且文件夹格式符合OpenWork的技能包规范;其次在技能管理器中点击“刷新”按钮,若仍未显示,可检查技能包的配置文件是否存在错误。

问题:保存的工作流模板无法找到,无法复用?

解决方案:OpenWork的模板默认存储在本地会话目录中,若未找到,可在主界面的“会话管理”中查看历史会话,找到对应的会话后即可查看/复用保存的模板;若会话被删除,模板也会同步删除,暂不支持模板单独备份。

问题:OpenWork支持哪些操作系统?

解决方案:目前官方已提供macOS端的开箱即用安装包,Windows、Linux端暂未提供官方安装包,但可通过源码编译的方式运行,项目后续会逐步完善跨平台适配。

问题:OpenWork的AI操作记录如何导出与查看?

解决方案:操作记录默认保存在本地会话文件中,目前暂不支持直接导出,可在OpenWork的“会话详情”页面直接查看,后续版本会新增记录导出功能。

七、相关链接

OpenWork官方GitHub仓库:https://github.com/different-ai/openwork

OpenWork安装包下载页面:https://github.com/different-ai/openwork/releases

八、总结

OpenWork是different-ai团队为解决传统AI智能体工具使用门槛高、可控性低、体验差等痛点开发的开源AI智能体工作流系统,作为类Claude Work的平替方案,它基于OpenCode引擎构建为原生桌面应用,以TypeScript、Tauri、Rust为核心技术栈,实现了AI智能体工作流的可视化、可审计、权限可控与本地/远程兼容,既降低了非开发者使用AI智能体的门槛,也为开发者提供了可扩展、可二次开发的技术框架;该项目的核心特色在于双运行模式的灵活选择、全流程的可视化操作、精细化的权限审批机制、插件化的技能拓展体系与高效的工作流模板复用,同时作为轻量的桌面应用,运行资源占用少、启动速度快,可适配个人办公、研发开发、团队协作、专业领域处理等多种场景,覆盖从简单文档处理到复杂项目开发的各类工作任务;目前项目处于v0.1.9早期迭代阶段,已提供macOS端开箱即用的安装包,支持开发者源码编译运行,虽部分功能仍在完善中,但凭借开源、高可控、易扩展的核心优势,成为了开源社区中极具潜力的AI智能体办公工具,为知识工作者提供了一套安全、便捷、高效的AI工作流解决方案,也为开源社区的AI智能体工具开发提供了优秀的技术参考与实践案例。

版权及免责申明:本文由@AI铺子原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/openwork.html