PersonaLive:开源实时AI人像动画框架,低延迟高帧率数字人直播解决方案

一、PersonaLive是什么

PersonaLive是一款面向实时数字人交互场景的开源AI框架,核心定位是“低门槛、高性能的实时人像动画生成工具”,由澳门大学、dzine.ai与大湾区大学GVC实验室联合研发并开源。它打破了传统数字人直播对专业级昂贵硬件的依赖,通过创新的算法优化和工程实现,让普通用户在配备12GB显存的消费级显卡(如RTX 3060、4070等)上就能实现高质量的数字人驱动效果。

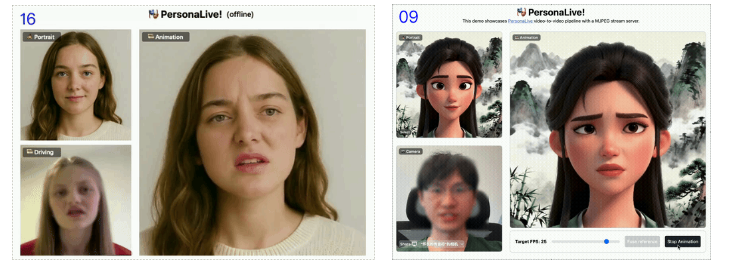

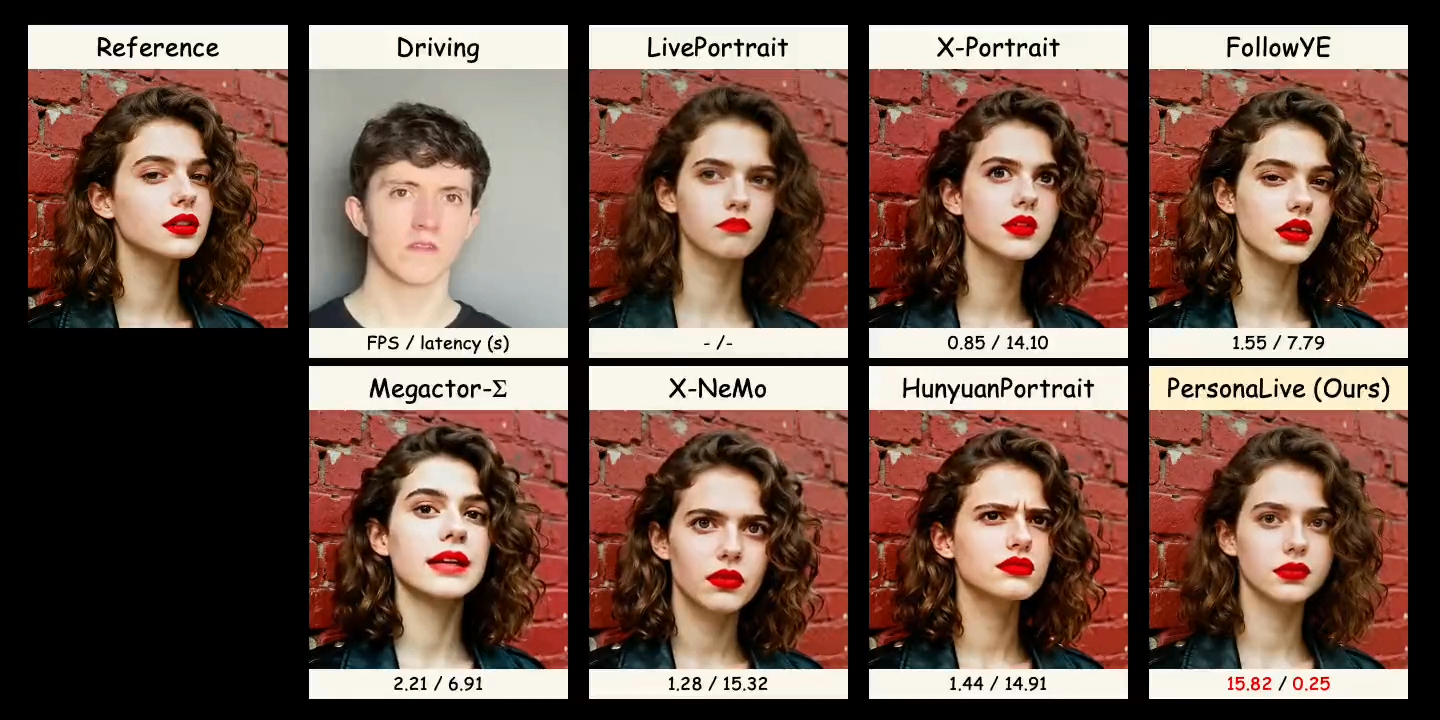

简单来说,PersonaLive的核心能力是“让静态照片活起来”——用户仅需上传一张人物肖像照片,配合摄像头捕捉实时动作与表情,就能生成与真人动作同步、无限时长的流畅动画,且整个过程延迟可低至40-50ms/帧,完全满足直播等实时互动场景的需求。与传统数字人解决方案相比,它无需复杂的3D建模或大量训练数据,仅通过单张参考图即可实现高精度的人像动画生成,同时支持流式传输和长时运行,从技术层面解决了显存溢出、画面崩坏、时序不一致等行业痛点。

作为开源项目,PersonaLive基于Python开发,代码完全公开可访问,支持用户自由下载、使用、修改和二次开发。项目不仅提供了完整的离线推理、在线生成、WebUI交互等功能模块,还兼容ComfyUI扩展和TensorRT加速技术,同时对NVIDIA RTX 50系列显卡进行了前瞻性支持,确保工具的兼容性和实用性。其核心目标是降低数字人技术的使用门槛,让更多开发者和创作者能够轻松接入AI驱动的人像动画能力,推动虚拟交互技术在各行业的普及应用。

从技术本质来看,PersonaLive属于扩散模型(Diffusion Model)在视频生成领域的创新应用,通过“流式Diffusion框架”打破了传统分段式视频生成的局限,实现了连续、无缝的视频流输出。它不只是简单的“AI换脸工具”,而是一套完整的“静态图转实时动画”解决方案,涵盖运动捕捉、特征提取、姿态引导、时序保持等全链路技术,能够在保持人物外观一致性的前提下,精准还原动作和表情的细节,生成自然逼真的动画效果。

二、功能特色

PersonaLive的核心竞争力源于其“低门槛、高性能、全场景”的功能设计,以下是其最具代表性的功能特色,结合技术优势和用户价值展开说明:

1. 极致低门槛:消费级硬件即可运行

这是PersonaLive最核心的突破之一。传统数字人直播解决方案往往需要配备24GB以上显存的专业显卡,甚至多卡集群,硬件成本高达数万元,让普通用户和中小团队望而却步。而PersonaLive通过高效的显存管理策略和模型优化,将硬件需求降至“单张12GB显存显卡”,主流的消费级显卡如RTX 3060、RTX 4070等均可流畅运行。

这一优化不仅降低了硬件采购成本,更扩大了项目的适用人群——无论是个人创作者、小型工作室,还是教育机构、中小企业,都能以极低的硬件投入接入数字人技术。同时,项目对运行环境的要求友好,支持Python 3.10及以上版本,依赖库简洁明了,通过conda虚拟环境即可快速配置,无需复杂的系统级依赖或专业的开发环境。

2. 实时性突出:毫秒级延迟保障互动体验

实时互动是数字人直播、虚拟助手等场景的核心需求,延迟过高会导致“音画不同步”“互动卡顿”等问题,严重影响用户体验。PersonaLive通过三大技术手段实现低延迟:一是集成TensorRT加速技术,推理速度提升近一倍;二是采用自回归微块流式生成范式,避免整段视频渲染的等待时间;三是优化推理流程和显存调度,减少数据传输和处理耗时。

实际测试数据显示,PersonaLive的单帧生成延迟最低可达40-50ms,平均延迟控制在100ms以内,完全满足实时互动的要求——用户通过摄像头做出的表情、动作,虚拟形象能几乎同步响应,互动体验接近真人面对面交流。这种低延迟特性让它在直播带货、在线问答、虚拟社交等场景中具备极强的实用性,避免了传统方案中“动作滞后”“互动僵硬”的问题。

3. 无限长度生成:支持全天候不间断运行

传统视频生成工具受限于显存容量和时序一致性算法,往往只能生成固定时长(如1-5分钟)的视频,超过时长后会出现显存溢出、人物形象崩坏、动作连贯性下降等问题。PersonaLive通过创新的“流式生成”技术和专门的时序模块,彻底突破了时长限制,能够生成无限长度的肖像动画。

这一功能对需要长时间运行的场景至关重要,例如24小时电商直播、不间断新闻播报、全天候智能客服等。在连续运行数小时甚至数十小时的情况下,PersonaLive依然能保持人物形象的稳定性(无崩坏、不走样)和动作的连贯性,有效避免了“分段拼接”带来的画面断层感,为全天候数字人应用提供了技术支撑。

4. 高质量动画输出:兼顾逼真度与稳定性

动画质量是数字人应用的核心竞争力,PersonaLive在这方面实现了“高逼真度”与“长时稳定性”的双重保障。在逼真度上,它通过混合运动信号提取技术,能够精准捕捉真人的表情细节(如皱眉、微笑、眨眼)和动作特征(如头部转动、肢体摆动),并完整还原到虚拟形象上,生成的动画自然流畅,无“僵硬感”或“机械感”。

在稳定性上,项目采用少步数外观蒸馏策略,确保人物形象在长时间运行中保持一致,不会出现“脸崩”“五官移位”“肤色失真”等问题——这是很多同类工具的常见痛点,尤其是在长时生成场景中。此外,PersonaLive支持参考图像替换功能,用户可通过WebUI随时更换虚拟形象的参考图,无需重启程序,灵活满足不同场景的形象需求。

5. 全功能支持:从离线到在线的完整解决方案

PersonaLive并非单一功能工具,而是提供了覆盖“离线创作-在线互动-可视化操作”的完整功能矩阵,满足不同用户的多样化需求:

离线推理:支持批量生成预设动作的动画视频,适用于短视频制作、广告片拍摄等场景,用户可通过配置文件设置生成时长、帧率、分辨率等参数。

在线推理:通过

inference_online.py脚本实现实时生成,支持摄像头实时输入,适用于直播、实时互动等场景。webcam支持:内置摄像头输入处理模块,可直接捕捉用户的动作和表情,无需额外的运动捕捉设备。

WebUI交互:提供基于Svelte框架开发的网页界面,操作直观简洁,用户只需上传参考图、调整参数,即可快速生成动画,无需编写代码。

ComfyUI扩展:支持作为ComfyUI的插件使用,无缝集成到现有工作流中,提升创作效率。

6. 开源灵活:支持二次开发与定制化

作为开源项目,PersonaLive的代码完全公开,用户可根据自身需求进行修改和二次开发。项目的技术架构模块化程度高,核心组件(如运动编码器、姿态引导器、时间模块等)均可独立替换或优化,方便开发者进行定制化改造——例如调整动画风格、增加新的运动捕捉方式、优化生成速度等。

同时,项目提供了详细的文档说明和注释,降低了二次开发的门槛。开发者可基于此项目构建专属的数字人解决方案,例如为特定行业定制虚拟形象模板、开发专属的交互逻辑、集成到现有产品(如直播平台、教育软件、客服系统)中,极大地拓展了项目的应用边界。

三、技术细节

PersonaLive的卓越性能背后,是一套经过精心设计的技术架构和创新算法。以下从技术架构、核心技术、硬件适配三个层面,用通俗易懂的语言解析其技术细节:

1. 整体技术架构

PersonaLive采用模块化的技术架构,核心由6个神经网络组件和3大支撑模块构成,各组件分工明确、协同工作,确保生成流程的高效与稳定。整体架构可分为“输入处理-特征提取-生成渲染-输出传输”四大环节,具体组件如下:

| 核心组件 | 功能作用 | 技术亮点 |

|---|---|---|

| 运动提取器(motion_extractor) | 从摄像头输入中提取人体运动和表情特征 | 支持混合运动信号捕捉,精准度高 |

| 运动编码器(motion_encoder) | 将运动特征编码为模型可识别的向量 | 轻量化设计,推理速度快 |

| 姿态引导器(pose_guider) | 引导生成动画的姿态一致性,避免动作扭曲 | 时序约束算法,保持长时连贯性 |

| 参考U-Net(reference_unet) | 提取参考图像的外观特征(五官、肤色、发型) | 少步数外观蒸馏,保持形象稳定 |

| 去噪U-Net(denoising_unet) | 基于扩散模型进行图像去噪和细节优化 | 微块流式处理,降低显存占用 |

| 时间模块(temporal_module) | 处理视频序列的时序关系,确保流畅性 | 自回归生成策略,支持无限时长 |

| 显存管理模块 | 优化显存分配和释放,避免溢出 | 动态调度算法,适配12GB显存 |

| 加速模块 | 集成TensorRT加速,提升推理效率 | 支持FP16精度,速度提升近一倍 |

| WebUI前端模块 | 提供可视化交互界面 | 基于Svelte开发,轻量化易操作 |

这套架构的核心优势在于“模块化设计”和“流式生成范式”:模块化确保了各组件的可替换性和扩展性,方便后续优化升级;流式生成则打破了传统“整段渲染”的模式,将视频拆分为微块逐帧生成并实时传输,既降低了显存占用,又实现了低延迟输出。

2. 三大核心创新技术

PersonaLive的技术突破集中体现在三个核心算法上,正是这些创新让它在“低硬件门槛”“低延迟”“长时稳定”三个维度实现了行业领先:

(1)混合运动信号捕捉技术

传统运动捕捉技术往往只能捕捉单一类型的运动特征(如肢体动作或面部表情),导致生成的动画不够自然。PersonaLive采用“混合运动信号”技术,能够同时捕捉人体的“宏观动作”(如头部转动、身体摆动)和“微观表情”(如嘴角上扬、眼神变化),并将两类信号融合为统一的特征向量。

这种技术不仅提升了动画的逼真度,还增强了对复杂动作的适应性——例如用户在直播中同时进行“说话+手势+头部转动”等复合动作,模型依然能精准还原。同时,该技术对输入信号的噪声容忍度高,即使在光线较暗或摄像头分辨率较低的环境下,也能稳定提取运动特征,降低了使用场景的限制。

(2)少步数外观蒸馏策略

“保持人物外观一致性”是长时动画生成的核心难点,传统方案往往需要大量的迭代步数来维持外观,导致推理速度慢、显存占用高。PersonaLive创新采用“少步数外观蒸馏”策略,通过预训练模型提取参考图像的核心外观特征(如五官结构、肤色纹理、发型风格),并将这些特征“蒸馏”到生成过程中,仅需少量迭代步数即可保持外观稳定。

这一策略带来两大优势:一是大幅降低了推理时间,为低延迟提供了技术基础;二是减少了显存占用,让12GB显存设备能够支持长时生成。实际测试显示,采用该策略后,模型的外观一致性保持率超过95%,即使连续生成10小时以上,人物形象也不会出现明显变化。

(3)自回归微块流式生成范式

为解决“无限时长生成”和“低延迟输出”的矛盾,PersonaLive设计了“自回归微块流式生成”范式。其核心逻辑是:将视频流拆分为固定大小的“微块”(每块包含数帧画面),模型以自回归的方式逐块生成,前一块生成的同时,后一块的特征提取和预处理工作同步进行,生成后立即通过流式传输输出,无需等待整段视频完成。

这种方式彻底打破了“生成-输出”的串行模式,实现了“生成-传输”并行,既避免了整段生成带来的长时间等待,又通过自回归策略保证了各微块之间的时序连贯性。同时,微块的大小可根据硬件性能动态调整,在12GB显存设备上,默认配置下每块生成延迟仅需20-30ms,完全满足实时传输要求。

3. 硬件适配与优化

PersonaLive在硬件适配方面做了大量优化,确保在消费级硬件上实现高性能运行,具体包括:

显存优化:通过动态显存分配、模型层间复用、低精度推理(FP16)等技术,将峰值显存占用控制在10GB以内,预留2GB显存用于缓存和传输,确保12GB显存设备稳定运行。

显卡兼容:支持NVIDIA CUDA架构的显卡,包括RTX 30系列、40系列、50系列等,对新显卡进行了前瞻性优化,确保兼容性和性能提升。

加速支持:集成TensorRT推理加速引擎,通过模型量化、算子优化等方式,将推理速度提升50%-80%,延迟进一步降低。

跨平台潜力:虽然当前主要支持Windows和Linux系统,但代码结构不依赖特定系统API,具备后续扩展到MacOS平台的潜力。

这些硬件优化让PersonaLive摆脱了对专业显卡的依赖,成为真正“人人可用”的数字人工具——用户无需升级昂贵的硬件,仅用日常办公或游戏的电脑就能体验到前沿的AI动画生成技术。

四、应用场景

PersonaLive的低门槛、高性能特性,使其在多个行业和场景中具备广泛的应用价值。无论是个人创作者的轻量化需求,还是企业用户的规模化应用,都能找到适配的解决方案。以下是其核心应用场景的详细介绍:

1. 虚拟主播与直播带货

这是PersonaLive最核心的应用场景之一。在电商直播、泛娱乐直播、新闻播报等领域,虚拟主播的需求日益增长,但传统方案的高成本让很多中小商家和个人望而却步。PersonaLive提供了低成本的解决方案:

个人主播:仅需一张自己的肖像照片和12GB显存显卡,即可打造专属虚拟形象,实现24小时不间断直播——白天可手动控制互动,夜间可通过预设脚本自动开播,提升直播时长和曝光量。

电商商家:无需聘请真人主播,可定制与品牌风格一致的虚拟主播,用于产品讲解、促销活动播报等,降低人力成本,同时避免真人主播的违约、突发状况等风险。

新闻媒体:可快速生成虚拟新闻主播,实现实时新闻播报、天气预告等,尤其适合突发新闻的快速响应,无需等待真人主播到场。

由于其低延迟特性,虚拟主播能与观众实时互动——观众的留言可通过AI解析后转化为虚拟主播的回应,配合实时动作捕捉,互动体验接近真人直播。

2. 短视频与内容创作

短视频创作者往往需要花费大量时间拍摄、剪辑视频,而PersonaLive能显著提升创作效率:

角色动画生成:创作者可上传虚拟角色的设计图,通过PersonaLive生成动画,用于短视频剧情演绎、科普讲解等,无需手动制作关键帧动画。

表情模仿与角色扮演:支持将真人的表情和动作映射到动漫角色、历史人物等虚拟形象上,丰富短视频的表现形式,提升内容趣味性。

批量内容生产:通过离线推理功能,可批量生成不同场景、不同动作的动画片段,后续仅需简单剪辑即可发布,大幅降低创作周期。

例如,教育类短视频创作者可制作虚拟老师形象,通过真人讲解配合动作捕捉,生成生动的教学视频;娱乐类创作者可打造虚拟偶像,生成唱歌、跳舞的动画内容,吸引粉丝关注。

3. 在线教育与培训

在线教育领域对“互动性”和“趣味性”的需求日益提升,PersonaLive能为其注入新的活力:

虚拟教师:生成个性化的虚拟教师形象,替代传统的PPT讲解模式,通过自然的动作和表情提升学生的注意力,尤其适合K12教育、语言培训等场景。

虚拟实验助手:在理工科实验教学中,可生成虚拟助手形象,演示危险或复杂的实验步骤,既保证安全,又能反复观看学习。

隐私保护教学:对于需要保护教师隐私的场景(如线上一对一辅导),虚拟形象可替代真人出镜,同时不影响教学互动的自然性。

此外,教育机构可定制不同学科、不同风格的虚拟教师模板,实现教学内容的标准化和规模化输出,降低课程制作成本。

4. 广告营销与品牌推广

广告营销领域需要不断创新形式以吸引用户注意力,PersonaLive提供了新颖的营销解决方案:

虚拟代言人:中小企业可定制品牌专属的虚拟代言人,用于广告片拍摄、社交媒体推广等,无需支付高额的真人代言费用,同时可根据需求随时调整形象和风格。

互动式广告:在直播广告、短视频广告中加入虚拟形象互动环节,用户可通过评论、点赞等行为触发虚拟形象的特定动作或回应,提升广告的参与度和转化率。

个性化营销:结合用户数据,为不同用户群体生成定制化的虚拟形象广告——例如针对年轻群体的动漫风格虚拟形象,针对商务群体的专业风格虚拟形象,提升广告的精准度。

某保险企业曾通过类似的个性化虚拟形象营销,将沉睡用户的邮件打开率提升7.67%,点击转化率提升14.33%,单场活动带来超过10万美元的销售额,证明了虚拟形象在营销场景的商业价值。

5. 虚拟客服与智能助手

企业客服场景对“全天候响应”和“标准化服务”的需求强烈,PersonaLive可用于打造智能虚拟客服:

24小时在线客服:生成虚拟客服形象,配合LLM(大型语言模型)实现自然语言交互,为用户提供实时咨询、问题解答、业务办理指引等服务,降低人工客服压力。

多渠道适配:虚拟客服可集成到企业官网、APP、微信公众号等多个渠道,保持形象和服务的一致性,提升用户体验。

行业定制化:可根据行业特点定制虚拟客服形象和专业话术,例如金融行业的专业风格客服、电商行业的亲和风格客服,适配不同场景的服务需求。

6. 游戏开发与虚拟社交

在游戏和社交领域,PersonaLive可用于丰富角色交互和场景体验:

游戏角色动画:游戏开发者可快速生成NPC(非玩家角色)的动画,无需手动制作复杂的动作序列,尤其适合独立游戏团队降低开发成本。

虚拟社交形象:在社交APP、元宇宙平台中,用户可上传自己的照片生成虚拟形象,通过实时动作捕捉实现虚拟社交互动,如虚拟聚会、在线游戏等。

角色定制化:支持用户自定义虚拟形象的服装、发型、表情等元素,配合实时动画生成,提升社交场景的个性化和趣味性。

五、使用方法

1. 前置准备

(1)硬件要求

显卡:显存≥12GB的NVIDIA显卡(推荐RTX 3060、RTX 4070及以上型号,支持RTX 50系列)

内存:≥16GB(推荐32GB,提升运行稳定性)

硬盘:预留≥20GB存储空间(用于安装依赖、下载预训练权重)

摄像头:支持USB摄像头(用于在线生成和实时互动场景)

(2)软件要求

操作系统:Windows 10/11 64位或Linux(Ubuntu 20.04/22.04)

Python版本:3.10.x(推荐3.10.12,避免版本兼容问题)

CUDA版本:11.8及以上(需与显卡驱动匹配,建议通过NVIDIA官网查询适配版本)

Conda:用于创建独立虚拟环境(推荐Miniconda3)

2. 环境配置步骤

(1)克隆仓库

打开终端(Windows用CMD或PowerShell,Linux用Terminal),执行以下命令克隆项目仓库:

git clone https://github.com/GVCLab/PersonaLive cd PersonaLive

如果没有安装Git,可直接访问GitHub仓库下载ZIP压缩包,解压后进入项目目录。

(2)创建并激活虚拟环境

使用Conda创建专门的虚拟环境,避免依赖冲突:

conda create -n personalive python=3.10 conda activate personalive

激活后,终端提示符前会显示(personalive),表示当前处于虚拟环境中。

(3)安装依赖库

项目提供了基础依赖清单,执行以下命令安装核心依赖:

pip install -r requirements_base.txt

如果需要使用WebUI或ComfyUI扩展,需额外安装对应依赖:

# 安装WebUI依赖 pip install -r requirements_webui.txt # 安装ComfyUI扩展依赖 pip install -r requirements_comfyui.txt

安装过程中若出现依赖冲突或安装失败,可尝试更新pip并重新安装:

pip install --upgrade pip

对于Linux用户,可能需要额外安装系统依赖(以Ubuntu为例):

sudo apt-get install libgl1-mesa-glx libglib2.0-0

3. 下载预训练权重

PersonaLive需要预训练权重才能正常运行,项目提供了自动下载脚本和多个手动下载渠道,用户可根据网络情况选择:

(1)自动下载(推荐)

执行以下脚本自动下载预训练权重,默认保存到weights/目录:

python tools/download_weights.py

脚本会自动检测网络环境,选择最优下载源,无需手动干预。

(2)手动下载(网络不稳定时)

若自动下载失败,可从以下官方渠道手动下载权重文件,解压后放入weights/目录:

HuggingFace:https://huggingface.co/huaichang/PersonaLive

ModelScope:https://modelscope.cn/models/huaichang/PersonaLive

Google Drive:项目GitHub README提供的共享链接

百度网盘:项目文档提供的提取码链接

权重文件包含多个核心模型(运动编码器、参考U-Net、去噪U-Net等),总大小约5-8GB,建议使用下载工具加速。

4. 核心功能使用教程

(1)离线推理(批量生成动画)

离线推理适用于生成预设动作的动画视频,步骤如下:

准备参考图像:将需要生成动画的静态照片(建议分辨率≥512×512,支持JPG、PNG格式)放入

data/reference/目录。配置生成参数:打开

configs/offline_inference.yaml文件,修改关键参数:reference_image_path:参考图像文件名(如person.jpg)output_path:输出视频保存路径(如output/offline_video.mp4)duration:生成视频时长(单位:秒,如30表示生成30秒视频)fps:帧率(默认30,建议保持默认以保证流畅度)resolution:输出分辨率(如[1080, 1920]表示1080P)运行离线推理脚本:

python inference_offline.py

运行过程中,终端会显示生成进度(如“生成进度:50%,剩余时间:10秒”),生成完成后可在output/目录查看视频文件。

(2)在线推理(实时生成动画)

在线推理支持摄像头实时输入,适用于直播、实时互动等场景,步骤如下:

连接摄像头:将USB摄像头连接到电脑,确保系统能正常识别(可通过系统自带摄像头软件测试)。

配置在线参数:打开

configs/online_inference.yaml文件,修改关键参数:reference_image_path:参考图像路径camera_id:摄像头ID(默认0,若有多个摄像头可修改为1、2等)output_mode:输出模式(live表示实时预览,save表示保存视频,both表示同时预览和保存)delay_control:延迟控制(low表示低延迟,high表示高质量,默认low)运行在线推理脚本:

python inference_online.py

运行后会弹出实时预览窗口,显示虚拟形象的动画效果,同时摄像头会实时捕捉你的动作和表情,同步映射到虚拟形象上。若选择save模式,视频会保存到output/online_video.mp4。

(3)WebUI使用(可视化操作)

WebUI提供了直观的图形界面,无需修改配置文件,适合非技术用户,步骤如下:

启动WebUI服务:

python webui.py

启动成功后,终端会显示访问地址(如http://127.0.0.1:7860)。 2. 访问WebUI:打开浏览器,输入上述地址,进入WebUI界面,主要分为三个区域:

参考图像上传区:点击“上传参考图”按钮,选择本地静态照片。

参数设置区:可调整帧率、分辨率、延迟模式、生成模式(离线/在线)等。

预览与输出区:实时显示生成效果,支持一键保存视频。

生成动画:设置完成后,点击“开始生成”按钮,即可根据选择的模式(离线/在线)生成动画,操作简单直观。

(4)ComfyUI扩展使用

若已安装ComfyUI,可将PersonaLive作为插件集成,步骤如下:

下载ComfyUI扩展:

git clone https://github.com/okdalto/ComfyUI-PersonaLive custom_nodes/ComfyUI-PersonaLive

复制权重文件:将

PersonaLive/weights/目录下的所有文件复制到ComfyUI/models/custom_nodes/ComfyUI-PersonaLive/weights/。启动ComfyUI:在ComfyUI的节点列表中找到“PersonaLive”相关节点,拖拽到工作流中,连接参考图像、参数设置等节点,即可快速生成动画。

5. 常见参数说明

为了帮助用户更好地调整效果,以下是核心参数的详细说明,避免因参数设置不当导致生成效果不佳:

| 参数名称 | 作用说明 | 推荐设置 |

|---|---|---|

| 参考图像分辨率 | 影响动画的细节精度 | ≥512×512,正方形图像最佳 |

| 帧率(fps) | 影响动画流畅度 | 离线生成:24-30fps;在线生成:30fps |

| 延迟模式 | 平衡延迟和质量 | 直播场景:low;离线创作:high |

| 分辨率 | 输出视频的清晰度 | 1080P(1920×1080)或720P(1280×720) |

| 运动强度 | 虚拟形象的动作幅度 | 日常互动:中等;娱乐场景:偏高 |

六、常见问题解答(FAQ)

Q1:执行pip install -r requirements_base.txt时,出现“torch安装失败”怎么办?

A1:torch是项目的核心依赖,安装失败通常是因为网络问题或CUDA版本不匹配。解决方案如下:

方法1:使用官方镜像源安装,命令如下:

pip3 install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118

方法2:若网络无法访问境外资源,使用阿里云镜像源:

pip3 install torch torchvision torchaudio -i https://mirrors.aliyun.com/pypi/simple/ --trusted-host mirrors.aliyun.com

方法3:确认CUDA版本与torch版本匹配,例如CUDA 11.8对应torch 2.0及以上版本,可通过

nvidia-smi命令查看CUDA版本。

Q2:启动WebUI时,提示“ModuleNotFoundError: No module named 'svelte'”怎么办?

A2:这是因为缺少WebUI专用依赖,执行以下命令安装即可:

pip install -r requirements_webui.txt

若仍报错,可手动安装缺失的模块:

pip install svelte-python fastapi uvicorn

Q3:Linux系统下运行脚本时,提示“找不到摄像头”怎么办?

A3:大概率是摄像头权限问题,解决方案如下:

检查摄像头是否被系统识别:执行

ls /dev/video*,若显示/dev/video0则表示识别成功。赋予摄像头权限:执行

sudo chmod 666 /dev/video0,临时开放权限;若需永久生效,可将用户添加到video组:sudo usermod -aG video $USER,重启后生效。

Q4:运行在线推理时,帧率很低(<10fps),卡顿严重怎么办?

A4:帧率低通常与硬件性能或参数设置有关,可按以下步骤优化:

降低输出分辨率:将分辨率从1080P改为720P,减少显存占用和计算量。

切换延迟模式:在配置文件中设置

delay_control: low,优先保证帧率。关闭其他程序:关闭占用GPU资源的程序(如游戏、视频编辑软件),确保GPU全力运行PersonaLive。

更新显卡驱动:访问NVIDIA官网下载最新驱动,优化GPU性能。

Q5:生成过程中出现“显存溢出(Out of memory)”错误怎么办?

A5:这是12GB显存设备的常见问题,解决方案如下:

降低分辨率:将输出分辨率调整为720P或更低,如1280×720。

关闭高质量模式:在配置文件中设置

quality_mode: normal,减少显存占用。清理显存缓存:在脚本运行前执行以下代码,清理GPU显存:

import torch torch.cuda.empty_cache()

分批生成:若需生成长时间视频,可分段生成后再拼接,避免单次运行时间过长。

Q6:WebUI启动后,浏览器访问http://127.0.0.1:7860提示“无法访问”怎么办?

A6:可能是端口被占用或服务未正常启动,解决方案如下:

检查端口占用:Windows执行

netstat -ano | findstr 7860,Linux执行lsof -i:7860,找到占用端口的进程并关闭。更换端口:修改

webui.py中的端口号,如将port=7860改为port=7861,重新启动服务。检查服务日志:若终端显示“Address already in use”,说明端口确实被占用;若显示其他错误,需根据错误信息排查依赖问题。

Q7:生成的动画中,人物形象出现“崩坏”“五官移位”怎么办?

A7:形象崩坏通常与参考图像质量或参数设置有关,解决方案如下:

优化参考图像:选择五官清晰、光照均匀、正面拍摄的照片,避免侧脸、模糊、遮挡(如戴口罩、戴帽子)的图像。

调整外观保持参数:在配置文件中找到

appearance_preserve_strength,将值从默认的0.8调整为0.9-0.95,增强外观一致性。降低运动强度:若动作幅度过大导致崩坏,可在参数中设置

motion_intensity: low,减少动作对五官的影响。更新预训练权重:确保使用的是最新版本的权重文件,旧版本可能存在效果缺陷,可重新运行

download_weights.py更新。

Q8:虚拟形象的动作与真人动作不同步,延迟明显怎么办?

A8:延迟问题可通过以下方式优化:

切换低延迟模式:在配置文件中设置

delay_control: low,或在WebUI中选择“低延迟”模式。关闭高质量渲染:高质量模式会增加计算时间,导致延迟升高,可适当降低画质参数。

检查摄像头帧率:确保摄像头支持30fps及以上帧率,低帧率摄像头会导致动作捕捉延迟,建议更换高清摄像头。

启用TensorRT加速:确保已安装TensorRT,且在配置文件中设置

use_tensorrt: True,可显著降低延迟。

Q9:生成的动画颜色失真,与参考图像肤色差异较大怎么办?

A9:颜色失真的解决方案如下:

调整颜色校准参数:在配置文件中找到

color_calibration: True,开启颜色校准功能。优化参考图像光照:参考图像的光照过亮或过暗会导致颜色失真,建议选择光照自然的照片。

关闭自动增强:若启用了

auto_enhance参数,可将其设置为False,避免过度增强导致颜色失真。

Q10:如何更换虚拟形象的参考图像?

A10:更换参考图像的方法根据使用模式不同而不同:

离线/在线推理:直接修改配置文件中的

reference_image_path参数,指定新的参考图像路径,或替换data/reference/目录下的旧图像(保持文件名一致)。WebUI:在“参考图像上传区”重新上传新图像,系统会自动替换旧图像,无需重启服务。

ComfyUI扩展:在PersonaLive节点中重新选择“参考图像”输入,即可更换虚拟形象。

Q11:如何将生成的动画推流到直播平台(如抖音、B站)?

A11:可通过OBS Studio实现推流,步骤如下:

运行PersonaLive在线推理,选择

live模式,确保实时预览窗口正常显示。安装并启动OBS Studio,点击“来源”面板的“+”号,选择“窗口捕获”。

在窗口列表中选择PersonaLive的预览窗口,点击“确定”。

在OBS中设置直播平台的推流地址和密钥(从直播平台后台获取)。

点击OBS的“开始推流”按钮,即可将虚拟形象动画推送到直播平台。

Q12:是否支持批量处理多张参考图像,生成多个虚拟形象的动画?

A12:支持批量处理,需通过修改脚本实现:

在

data/reference/目录下创建多个子目录(如person1、person2),每个子目录放入一张参考图像。编写批量处理脚本(可参考项目

tools/目录下的示例脚本),循环读取每个子目录的参考图像,调用离线推理函数生成动画。运行批量脚本,即可自动生成多个虚拟形象的动画,输出到

output/目录的对应子目录中。

Q13:如何基于PersonaLive开发自定义功能(如添加新的动作捕捉方式)?

A13:二次开发的核心步骤如下:

熟悉项目架构:重点了解

motion_extractor(运动提取器)和motion_encoder(运动编码器)模块的代码结构。开发自定义模块:新建自定义运动捕捉模块(如基于骨骼捕捉的模块),实现与原有模块相同的接口(如

extract_motion函数)。替换核心组件:在

inference_offline.py或inference_online.py中,将原有运动提取器替换为自定义模块。测试与优化:运行脚本测试自定义功能的兼容性和效果,根据测试结果调整参数和代码。

参考官方文档:项目的

docs/目录提供了二次开发指南,包含模块接口定义、数据格式说明等,建议优先查阅。

Q14:如何将PersonaLive集成到自己的Python项目中?

A14:集成步骤如下:

将PersonaLive项目复制到自己的项目目录下,或通过

pip install -e .将其安装为可导入模块。在自己的项目中导入核心类:

from PersonaLive.core import PersonaLiveEngine

初始化引擎并设置参数:

engine = PersonaLiveEngine( reference_image_path="path/to/image.jpg", use_tensorrt=True, delay_control="low" )

调用生成函数:

# 离线生成 engine.generate_offline(duration=60, output_path="output/video.mp4") # 在线生成 engine.generate_online(camera_id=0, output_mode="both")

根据项目需求调用其他接口,如获取实时帧数据、调整参数等。

七、相关链接

项目GitHub仓库:https://github.com/GVCLab/PersonaLive

预训练模型下载(HuggingFace):https://huggingface.co/huaichang/PersonaLive

预训练模型下载(ModelScope):https://modelscope.cn/models/huaichang/PersonaLive

八、总结

PersonaLive作为一款由澳门大学、dzine.ai和大湾区大学GVC实验室联合开发的开源实时AI人像动画框架,以“低门槛、高性能、全场景”为核心优势,成功解决了传统数字人直播领域的高硬件成本、高延迟、长时稳定性差等关键痛点。该框架基于Python开发,仅需12GB显存的消费级显卡即可运行,通过混合运动信号捕捉、少步数外观蒸馏、自回归微块流式生成等创新技术,实现了最低40-50ms/帧的低延迟和无限长度的高质量肖像动画生成,同时保持了人物形象的稳定性和动作的自然性。项目提供了离线推理、在线生成、WebUI交互、ComfyUI扩展等完整功能,兼容主流硬件和软件生态,广泛适用于虚拟主播、短视频创作、在线教育、广告营销、虚拟客服等多个场景,既满足个人创作者的轻量化需求,也能支撑企业用户的规模化应用。作为开源项目,PersonaLive的代码完全公开,支持二次开发和定制化改造,配合详细的文档说明和活跃的社区支持,为不同层次的用户提供了便捷的接入路径,成为推动数字人技术普及和应用创新的重要工具。

版权及免责申明:本文由@AI铺子原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/personalive.html