Plano:AI原生代理与数据平面,开箱即用落地生产级智能体应用

一、Plano是什么

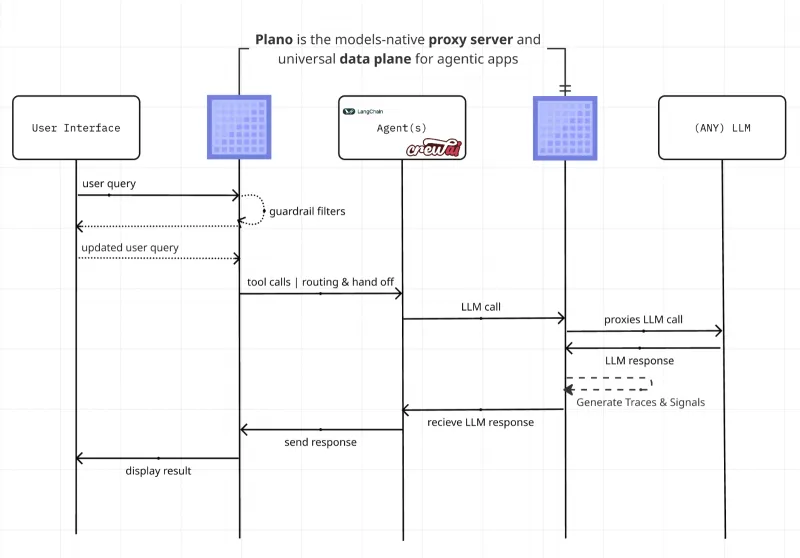

Plano是由katanemo团队开发的开源项目,定位为智能体应用(Agentic Apps)的原生AI代理服务器与数据平面,核心价值是把智能体系统落地时必须处理的“脏活累活”全部抽离成统一的基础设施层,让开发者不用重复编写路由、安全、监控、编排等底层代码,只专注实现智能体的核心业务逻辑。

它不是另一个智能体开发框架,而是所有智能体框架的生产配套底座。无论你用LangChain、LlamaIndex、AutoGen还是自研框架,Plano都能以sidecar或独立服务的形式接入,统一处理流量、策略、观测与安全,让原型系统平稳过渡到高可用、可治理、可扩展的生产环境。

项目由曾构建Envoy的核心工程师主导,底层依托高性能代理架构,内置行业领先的LLM能力支撑,同时提供本地部署与托管服务两种模式,兼顾企业私有化与快速上手需求。

二、功能特色

Plano围绕智能体生产落地的全流程设计功能,覆盖编排、路由、观测、安全、治理五大核心场景,形成完整的生产化能力闭环。

1. 低延迟多智能体编排(Agent Orchestration)

支持多智能体并行/串行协同,智能拆分复杂任务并分发到对应智能体

新增、删除、升级智能体无需修改上层应用代码,配置化完成扩容

内置智能体健康检查、故障转移与负载均衡,保障系统稳定性

提供标准化智能体接口,兼容任意语言实现的智能体服务

2. 智能模型路由(Model Agility)

支持按模型名称、语义类型、任务场景自动路由到最优LLM服务

可自定义路由策略:简单对话走轻量模型,复杂推理走高阶模型,自动降低成本

兼容OpenAI、Anthropic、阿里云、腾讯云等主流模型服务,统一接入层

支持模型别名、灰度切换、故障降级,不影响前端业务连续性

3. Agentic Signals™ 零代码全链路观测

零侵入、零代码采集全链路智能体交互信号

内置OTEL标准追踪与指标,对接Prometheus、Grafana等生态

实时查看智能体调用链、决策过程、工具使用、耗时分布

为强化学习与持续优化提供数据底座,缩短迭代周期

4. 安全审核与记忆钩子(Moderation & Memory Hooks)

通过Filter Chains统一实现越狱防护、内容审核、风险拦截

集中管理智能体记忆,防止敏感信息泄露与上下文污染

支持自定义安全策略,适配企业合规要求

提供请求/响应拦截、改写、过滤能力,灵活扩展安全规则

5. 框架无关、语言无关

不绑定任何AI开发框架,兼容所有主流生态

智能体只需实现OpenAI兼容的Chat API,任意语言均可接入

提供Docker、CLI、K8s多种部署方式,无缝融入现有基础设施

核心能力对比表

| 能力维度 | 传统智能体开发 | Plano 智能体数据平面 |

|---|---|---|

| 多智能协同 | 手动编码调度,耦合严重 | 配置化编排,低延迟协同 |

| 模型管理 | 硬编码接入,难以切换 | 统一路由,动态调度,灰度升级 |

| 可观测性 | 手动埋点,数据碎片化 | 零代码全链路采集,标准协议输出 |

| 安全合规 | 零散实现,难以统一 | 集中式Filter Chains,全局策略 |

| 生产落地 | 周期长、风险高、重复造轮子 | 开箱即用,1天内完成生产化改造 |

三、技术细节

Plano采用云原生、高可扩展架构,核心技术栈与设计理念如下:

1. 技术栈

核心语言:Rust,保证高性能、内存安全与低延迟

代理引擎:基于Envoy架构重构,由原核心贡献者开发

配置格式:YAML声明式配置,易学易用

协议兼容:OpenAI API、gRPC、HTTP/1.1、HTTP/2

可观测:OpenTelemetry(OTEL)标准

部署:Docker容器、Kubernetes、二进制部署

2. 整体架构

Plano采用数据平面与控制平面分离的云原生架构:

数据平面:处理请求转发、智能体路由、模型调度、信号采集、过滤链执行

控制平面:提供配置加载、策略管理、动态更新、健康检查

接入层:兼容标准HTTP接口,降低接入成本

扩展层:支持自定义Filter、自定义路由、自定义信号采集

3. 关键技术亮点

无侵入设计:不用修改现有智能体代码,仅需调整请求地址

高性能转发:Rust+Envoy级别的吞吐量,单实例支持高并发

动态配置:支持配置热更新,不中断服务

内置小模型能力:自带Plano-Orchestrator-4B、Arch-Router等模型,支撑路由与编排决策

可扩展插件:通过Filter机制扩展审核、日志、缓存、限流等能力

部署架构简表

| 部署方式 | 适用场景 | 优势 |

|---|---|---|

| Docker 单机 | 开发测试、小型场景 | 一键启动,快速验证 |

| Kubernetes | 生产高可用 | 弹性扩缩、自愈、负载均衡 |

| 托管服务 | 快速上线 | 免运维,全球节点 |

四、应用场景

Plano适用于所有需要把AI智能体从Demo推向生产的场景,覆盖企业服务、开发者工具、垂直行业AI系统等:

1. 多智能体协同系统

企业客服中枢:路由用户请求到不同领域智能体(订单、物流、售后)

旅行助手:天气智能体、航班智能体、酒店智能体统一编排

研发助手:代码生成、测试、文档、CodeReview智能体协同工作

2. 多模型混合调度平台

内部LLM网关:统一管理公司所有模型调用,按场景自动分配

成本优化系统:简单对话走低成本模型,复杂推理走高精度模型

模型灰度平台:安全测试新模型,不影响线上用户

3. 高合规要求AI应用

金融/医疗/政务智能体:集中审核、内容过滤、行为审计

企业内部知识库助手:防止数据泄露、上下文安全管控

教育类AI:过滤不当内容,保障学生使用安全

4. AI产品SaaS化

AI厂商快速将原型变成可售卖SaaS

提供多租户、权限、观测、计费能力

统一入口、统一安全、统一运维

五、使用方法

Plano遵循低门槛接入、声明式配置、标准化接口的设计,快速上手流程如下:

1. 环境准备

安装Docker(推荐)或准备Rust编译环境

准备模型API Key(OpenAI/Anthropic等)

一个或多个已实现的智能体服务(任意语言)

2. 编写配置文件(plano.yaml)

定义监听端口、智能体列表、模型提供商、路由规则、Filter策略。

version: v0.3.0

listeners:

- name: main

port: 8001

agents:

- name: weather_agent

endpoint: http://host.docker.internal:10510

- name: flight_agent

endpoint: http://host.docker.internal:10520

models:

providers:

- name: openai

api_key: ${OPENAI_API_KEY}

routing:

rules:

- intent: weather → weather_agent

- intent: flight → flight_agent

- default: openai:gpt-3.5-turbo3. 启动Plano

docker run -p 8001:8001 \ -e OPENAI_API_KEY=xxx \ -v ./plano.yaml:/app/plano.yaml \ katanemo/plano:latest

4. 接入应用

把原有直接调用智能体/模型的地址,改为Plano地址:

http://localhost:8001/v1/chat/completions

请求体格式与OpenAI完全一致,无需修改代码。

5. 查看观测数据

开启Dashboard后访问:

http://localhost:12001

查看实时调用、路由结果、智能体状态、信号日志。

六、常见问题解答(FAQ)

Plano和LangChain、LlamaIndex是什么关系?

Plano不是框架替代品,而是它们的生产化搭档。LangChain负责写智能体逻辑,Plano负责上线、运维、路由、安全、观测,一起使用才能快速落地生产。

必须用Rust编写智能体才能接入Plano吗?

不需要。智能体可以用Python、Java、Go、JavaScript等任意语言,只要提供HTTP接口并兼容OpenAI聊天格式,就能接入。

Plano是否会带来性能损耗?

几乎无感知损耗。Plano基于Rust与Envoy架构优化,转发开销在毫秒内,远低于智能体与LLM本身的响应时间。

没有公网IP,能否在本地使用Plano?

可以。Plano支持完全本地部署,所有流量在内网处理,模型也可对接本地Ollama、llama.cpp等服务,实现全离线运行。

如何实现内容审核与安全防护?

通过配置Filter Chains开启内置审核模块,也可编写自定义Filter,在请求或响应阶段做检查、拦截、改写。

是否支持多租户与权限控制?

支持。可在配置中划分租户空间、设置API Key隔离、路由隔离,适合SaaS平台多用户场景。

配置修改后需要重启服务吗?

不需要。Plano支持配置热加载,修改YAML后自动生效,不影响在线流量。

Plano可以管理多少个智能体与模型?

理论无上限。单机可管理数十个智能体,K8s部署可横向扩展,支撑企业级大规模智能体集群。

数据会发送到第三方服务器吗?

本地部署时所有流量完全私有化,不会流出你的环境。托管服务可选择区域与数据留存策略。

有没有现成的Demo可以快速体验?

有。官方提供旅行助手、多模型路由、安全过滤等15+示例,在仓库demos目录可直接运行。

七、相关链接

GitHub 仓库:https://github.com/katanemo/plano

官方网站:https://archgw.com

八、总结

Plano作为面向智能体应用的AI原生代理与数据平面,由Envoy核心贡献者打造,以Rust实现高性能、安全可靠的底层基础设施,通过多智能体编排、智能模型路由、零代码全链路观测、集中式安全审核与记忆治理四大核心能力,系统性解决了智能体从Demo到生产落地过程中的工程化、可靠性、可观测性与合规性难题,它不与现有AI框架竞争,而是作为通用生产化底座兼容所有语言与生态,让开发者专注业务逻辑,大幅缩短上线周期、降低运维成本、提升系统安全性与可扩展性,是构建企业级、SaaS化、高可用智能体系统的标准基础设施选择。

版权及免责申明:本文由@人工智能研究所原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/plano.html