ReMe:阿里通义实验室开源的AI智能体记忆管理工具包

一、ReMe是什么

ReMe全称Remember Me, Refine Me,是阿里巴巴通义实验室AgentScope团队面向AI智能体研发的开源生产级记忆管理工具包,核心定位是为AI Agent提供从短期上下文到长期经验的全生命周期记忆管理能力,彻底解决智能体在长期交互与复杂任务中面临的两大致命问题:

上下文窗口限制:长对话中早期关键信息被截断或丢失,导致智能体逻辑断裂、决策失误;

会话无状态:新会话无法继承历史记忆,每次交互均从零开始,无法形成持续进化的用户画像与任务经验。

ReMe将传统“上下文拼接”升级为可检索、可压缩、可分层、可精炼的结构化记忆系统,让智能体像人类一样沉淀经验、复盘失败、优化策略,实现真正意义上的“持续学习”。项目基于Python开发,遵循Apache-2.0开源协议,支持商用、二次开发与自由分发,可无缝集成AgentScope生态,也可独立接入任意AI Agent框架,是构建生产级智能体不可或缺的记忆基础设施。

二、ReMe核心功能特色

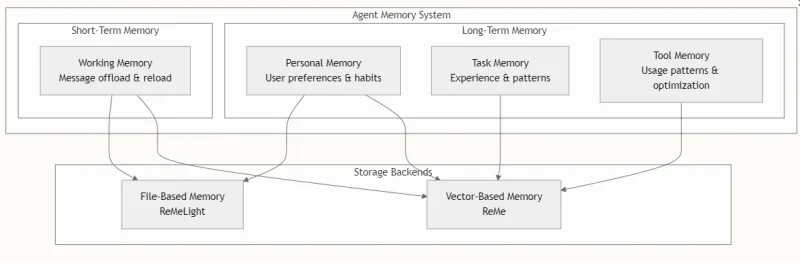

1. 双轨记忆存储体系

ReMe采用文件型轻量存储(ReMeLight)+向量型检索存储双架构,兼顾易用性与高性能,覆盖开发调试到生产部署全场景。

ReMeLight文件记忆:以Markdown/JSONL为载体,记忆可读可编辑,无需数据库依赖,支持快速迁移与人工修正;

向量记忆存储:支持Chroma、Qdrant、ES等多引擎,提供语义检索、元数据过滤、混合搜索,适配大规模记忆检索需求。

2. 全维度记忆分层架构

ReMe构建了覆盖智能体交互全流程的四层记忆体系,实现精准记忆管控:

个人记忆:沉淀用户偏好、习惯、交互风格,支撑个性化连续交互;

任务记忆:记录任务执行策略、成功模式、失败原因,形成可复用经验库;

工具记忆:管理工具调用参数、成功率、执行成本,将静态文档转化为动态执行手册;

工作记忆:处理短期上下文,自动压缩长文本、卸载冗余信息,优化上下文窗口利用率。

3. 记忆自主精炼与迭代

ReMe独创记忆蒸馏-复用-剪枝闭环机制,让智能体自主优化记忆:

多维度蒸馏:提炼成功经验、分析失败诱因,生成高价值洞察;

情境自适应复用:基于场景感知将历史经验适配新任务;

效用剪枝:自动删除过时/无效记忆,维持紧凑高质量记忆池。

4. 开箱即用的基准与记忆库

项目内置预训练记忆库与基准测试能力,降低落地成本:

提供

appworld.jsonl、bfcl_v3.jsonl等行业记忆库;支持LoCoMo、HaluMem等基准测试,快速验证记忆效果;

配套完整示例代码,5分钟即可完成集成调试。

5. 生产级工程化能力

支持多工作区管理、记忆权限隔离、数据持久化;

提供HTTP/MCP/Python多接入方式,适配微服务与单体架构;

记忆可观测、可审计,满足企业合规与调试需求。

核心功能对比表

| 功能维度 | 传统上下文拼接 | ReMe记忆管理 |

|---|---|---|

| 信息保留 | 长对话丢失早期内容 | 自动压缩+持久化,关键信息不丢失 |

| 记忆类型 | 仅原始对话记录 | 个人/任务/工具/工作四层结构化记忆 |

| 检索能力 | 无,仅顺序拼接 | 语义+全文混合检索,精准召回 |

| 经验迭代 | 无自主优化能力 | 蒸馏-复用-剪枝,持续进化 |

| 部署成本 | 低但能力薄弱 | 轻量无依赖,生产可扩展 |

| 可观测性 | 黑盒不可调试 | 可读可编辑,全流程可审计 |

三、ReMe技术细节

1. 技术栈与环境要求

开发语言:Python 3.10及以上版本;

核心依赖:numpy、sentence-transformers、chromadb、qdrant-client等;

部署方式:本地源码安装、PyPI包安装、Docker容器化部署;

开源协议:Apache-2.0,支持商用与二次修改。

2. 核心架构设计

ReMe采用模块化松耦合架构,核心组件包括:

记忆接入层:提供Python API、HTTP接口、MCP协议,兼容各类Agent框架;

记忆处理层:包含上下文压缩、语义嵌入、记忆蒸馏、效用评估模块;

存储引擎层:文件存储引擎+向量存储引擎,支持热插拔切换;

服务管理层:任务记忆服务、个人记忆服务、工具记忆服务,提供CRUD与检索接口。

3. 文件型记忆(ReMeLight)实现

ReMeLight以文件即记忆为设计理念,标准目录结构:

working_dir/ ├── MEMORY.md # 长期结构化记忆(用户偏好、任务经验) ├── memory/YYYY-MM-DD.md # 每日交互日志与记忆摘要 ├── dialog/YYYY-MM-DD.jsonl# 原始对话记录,支持回溯 └── tool_result/<uuid>.txt # 工具输出缓存,自动过期清理

特点:纯文本存储、人类可读、无需数据库、复制即迁移、支持手动编辑修正。

4. 向量型记忆实现

嵌入处理:支持开源Embedding模型,将文本转为向量表示;

存储适配:

开发环境:MemoryVectorStore/LocalVectorStore(无外部依赖);

小规模部署:ChromaVectorStore(轻量开箱即用);

生产环境:QdrantVectorStore/EsVectorStore(高性能、分布式、混合搜索);

检索机制:余弦相似度检索+元数据过滤,支持按时间、用户、任务类型精准筛选。

5. 记忆精炼核心算法

ReMe通过效用评分机制实现记忆自动优化:

为每条记忆分配效用值,基于检索成功率、任务贡献度动态更新;

高效用记忆保留并强化,低效用/过期记忆自动剪枝;

失败经验作为负样本参与对比学习,提升决策鲁棒性。

四、ReMe典型应用场景

1. 个人AI助手

记忆用户饮食偏好、日程习惯、购物清单,跨会话保持上下文连贯;

自动沉淀生活经验,如常用地址、联系人信息、旅行规划,无需重复告知。

2. 企业智能客服

记录用户历史咨询、投诉内容、解决方案,快速定位问题;

沉淀客服话术库与故障处理经验,提升应答准确率与效率;

支持多用户记忆隔离,保障数据安全与隐私。

3. 代码智能助手

记忆开发者编码风格、项目架构、常用函数库;

沉淀调试经验与Bug解决方案,辅助快速排错;

长代码对话中保留关键逻辑,避免上下文丢失导致代码断裂。

4. 自动化任务智能体

记录流程执行步骤、工具调用参数、异常处理策略;

跨任务复用成功经验,优化执行效率与成功率;

长期运行不丢失状态,支持断点续跑与任务复盘。

5. 教育与知识问答

记忆学员学习进度、薄弱知识点、历史问答记录;

构建个性化知识图谱,提供针对性辅导;

长文本学习中压缩冗余信息,聚焦核心知识点。

6. 企业知识库智能体

将企业文档转化为可检索记忆库,支持自然语言问答;

自动更新知识库,沉淀员工经验与业务流程;

混合检索提升答案精准度,降低人工查阅成本。

五、ReMe快速使用方法

1. 安装部署

方式1:PyPI安装(推荐)

pip install reme-ai

方式2:源码安装

git clone https://github.com/agentscope-ai/ReMe.git cd ReMe pip install .

2. 基础使用示例

from reme import ReMe, MemoryType # 初始化ReMe实例 reme = ReMe(working_dir="./agent_memory") # 写入个人记忆 reme.add_memory( content="用户喜欢咖啡,每天上午9点需要提醒", memory_type=MemoryType.PERSONAL, user_id="user_001" ) # 语义检索相关记忆 results = reme.search_memory( query="用户日常习惯", user_id="user_001", top_k=3 ) # 打印检索结果 for res in results: print(res.content)

3. 向量存储配置

from reme.vector import QdrantVectorStore # 初始化向量存储 vector_store = QdrantVectorStore( host="localhost", port=6333, collection_name="agent_memory" ) # 绑定至ReMe reme.set_vector_store(vector_store)

4. 记忆精炼与管理

# 执行记忆精炼 reme.refine_memory(user_id="user_001") # 导出长期记忆 reme.export_memory(output_path="memory_backup.md")

5. 生产部署建议

小规模场景:使用ReMeLight文件存储,无需额外服务;

中大规模场景:搭配Qdrant/ES向量存储,开启分布式部署;

数据安全:开启记忆加密,设置用户权限隔离,定期备份。

六、ReMe与同类竞品对比

当前AI Agent记忆赛道主要产品包括LangChain Memory、LlamaIndex Memory、AutoGPT Memory与ReMe,核心对比如下:

| 对比维度 | ReMe | LangChain Memory | LlamaIndex Memory | AutoGPT Memory |

|---|---|---|---|---|

| 设计定位 | 生产级专用记忆框架 | 通用链上下文管理 | 检索增强记忆 | 实验性简易记忆 |

| 记忆分层 | 四层结构化记忆 | 基础缓冲记忆 | 文档索引记忆 | 扁平对话记忆 |

| 自主精炼 | 支持蒸馏-复用-剪枝 | 无自主优化 | 手动索引优化 | 无 |

| 存储体系 | 文件+向量双引擎 | 仅内存/简单持久化 | 向量为主,较重 | 本地文件简单存储 |

| 生产适配 | 可观测、可审计、可扩展 | 工程化较弱 | 适合知识库场景 | 仅适合原型开发 |

| 生态集成 | 深度绑定AgentScope,独立可用 | 适配LangChain生态 | 适配LlamaIndex生态 | 仅AutoGPT原生 |

| 基准效果 | LoCoMo/HaluMem SOTA | 常规水平 | 检索优秀,交互较弱 | 基础功能 |

| 易用性 | 轻量化,5分钟上手 | 配置繁琐 | 学习成本高 | 开箱即用但能力弱 |

核心优势总结:ReMe兼顾轻量化与生产级能力,在记忆自主迭代、双存储适配、工程化可观测性上全面领先,更适合企业级落地与长期迭代。

七、常见问题解答

ReMe必须依赖AgentScope才能使用吗?

不需要。ReMe是独立开源项目,可作为Python库直接接入任何AI Agent框架,同时与AgentScope深度兼容,获得更优协同效果。

ReMeLight文件存储会占用大量磁盘空间吗?

不会。ReMe会自动压缩对话日志、剪枝无效记忆,工具缓存支持过期自动清理,普通交互场景月占用通常低于100MB。

向量存储需要部署独立服务吗?

开发调试可使用内置LocalVectorStore,无需外部服务;生产环境建议部署Qdrant/Chroma/ES,提升检索性能与并发能力。

ReMe支持多用户记忆隔离吗?

支持。所有记忆操作均支持传入user_id、task_id等元数据,实现用户级、任务级精准隔离,保障数据安全。

如何处理敏感信息,避免隐私泄露?

ReMe支持记忆内容加密存储,可自定义敏感信息过滤规则,同时文件记忆可手动编辑删除敏感内容,满足隐私合规要求。

ReMe的记忆精炼会误删重要信息吗?

不会。精炼基于效用评分机制,高价值记忆会被强化,删除前会生成备份,同时支持手动恢复与调整评分策略。

支持自定义Embedding模型吗?

支持。可通过配置替换默认Embedding模型,适配本地私有化部署需求,提升数据安全性与检索效果。

ReMe可以部署在私有服务器吗?

完全可以。所有组件支持本地私有化部署,无云端依赖,数据不离开私有环境,适合金融、政务等敏感场景。

八、相关链接

AgentScope主框架:https://github.com/agentscope-ai/agentscope

九、总结

ReMe作为阿里巴巴通义实验室推出的AI智能体记忆管理框架,以解决上下文受限与会话无状态为核心目标,通过文件型与向量型双存储架构、四层记忆分层体系、自主记忆精炼机制,将智能体从简单上下文拼接升级为具备持续学习与经验迭代能力的生产级系统,兼具轻量化易用性与企业级扩展性,支持多场景快速落地,在基准测试中表现优异,且完全开源免费、可独立部署、可二次开发,既能无缝融入AgentScope生态,也能适配各类自定义Agent框架,是当前AI Agent开发中构建可靠记忆系统的优选方案,为智能体实现长期连贯交互、自主优化决策提供了关键技术支撑。

版权及免责申明:本文由@dotaai原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/reme.html