SearchClaw:人大开源的AI深度研究智能体,自托管多源检索生成可引用报告

一、SearchClaw是什么

SearchClaw是由中国人民大学信息检索实验室(RUC-NLPIR) 研发的开源、自托管式AI深度研究智能体(AI Research Agent),核心定位是替代传统人工信息搜集、整理、分析流程,通过自主化、多步骤、闭环式的网络检索与内容理解,为用户生成结构清晰、论据充分、附带可验证引用来源的深度研究报告与问答结果。

与普通AI聊天、单次联网搜索工具不同,SearchClaw采用“工具+钩子”双层架构,借鉴Harness Engineering(线束工程)设计理念,不依赖大模型单次生成,而是通过任务拆解、多轮检索、内容抓取、引用校验、质量把关、迭代优化的完整闭环,彻底解决AI“幻觉编造”“引用缺失”“信息片面”“时效性不足”等痛点。

项目基于Python+FastAPI构建,提供开箱即用的Web交互界面,所有核心逻辑本地运行、数据自主掌控,无需依赖第三方云服务即可实现完整研究能力。面向科研人员、分析师、内容创作者、学生、企业调研人员等群体,提供可追溯、可复现、可定制的自动化深度调研服务,是AI时代提升信息处理效率与研究质量的专业工具。

二、功能特色

2.1 自主闭环式深度研究

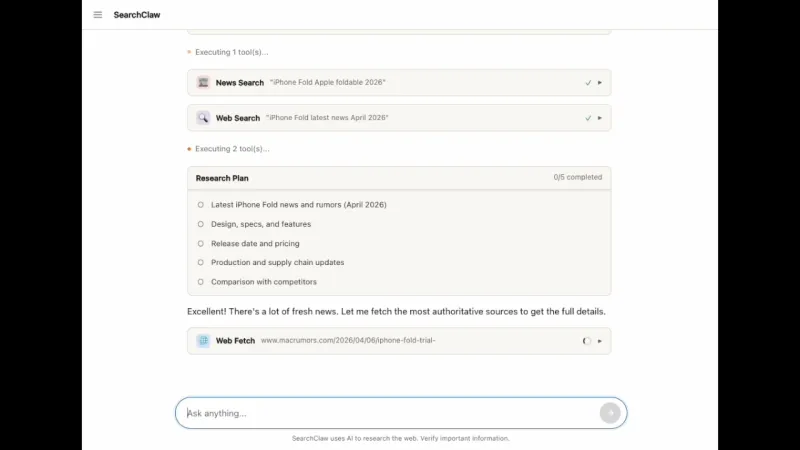

全流程自主执行:自动完成“问题理解→任务拆解→多源搜索→网页抓取→内容解析→信息整合→引用标注→质量评估→迭代补全→报告生成”完整闭环,无需人工干预。

动态迭代优化:内置质量校验机制,若回答引用不足、来源单一、内容不完整,自动启动新一轮检索与补充,直至满足预设质量标准。

交互式需求澄清:面对模糊、开放、歧义问题,主动向用户发起追问,明确研究范围、细节与偏好,确保输出精准贴合需求。

2.2 跨领域多源信息检索

覆盖四大类权威信息源,打破单一搜索局限,实现全域信息整合:

通用网页:Google、Serper、DuckDuckGo,覆盖全球公开网页内容

中英文学术:Semantic Scholar、arXiv、DBLP,支持论文检索、摘要提取、引用溯源

实时新闻:NewsAPI、Google News RSS,获取最新行业动态、时事资讯

中文社媒:微信公众号文章,覆盖国内垂直领域、行业干货、官方通知

2.3 高可靠质量管控体系

多重质量钩子(Quality Gates):强制校验最小引用数、来源域名多样性、回答长度、信息一致性、时效性,拒绝低质量、不可信输出。

双阶段上下文压缩:智能合并冗余信息、提炼核心要点,适配大模型上下文窗口限制,支持超长会话与深度研究。

引用强制规范化:所有结论自动关联原始链接,标注来源标题、发布时间、URL,支持一键跳转验证,杜绝无依据表述。

2.4 灵活技术适配与扩展

多LLM无缝兼容:通过LiteLLM支持Anthropic Claude、OpenAI GPT、Google Gemini、通义千问等全球主流大模型,自由切换、按需选择。

浏览器深度集成:可选Playwright/CDP模式,解析JS渲染页面、模拟登录、抓取需认证内容,解决传统爬虫无法访问的复杂页面。

本地优先+隐私安全:100%自托管,数据不泄露、无第三方采集,支持密码保护、远程部署,适配个人与企业隐私需求。

2.5 易用交互与持久记忆

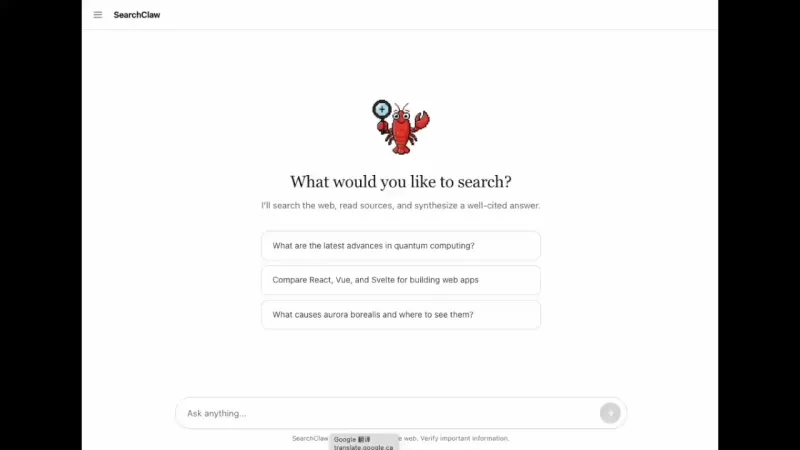

Web UI可视化操作:浏览器直接访问,支持问题输入、研究进度查看、报告预览、引用列表、历史记录管理。

跨会话持久记忆:自动保存研究事实、用户偏好、来源质量评估,下次使用直接复用,无需重复配置。

全配置可定制:核心参数集中在

config/settings.yaml,支持自定义搜索次数、质量阈值、模型参数、抓取规则、浏览器行为等。

三、技术细节

3.1 整体技术架构

SearchClaw采用五层模块化架构,各模块解耦、可独立扩展、易维护:

交互层(Interface)

Web UI:FastAPI+现代前端框架,提供浏览器操作界面

API服务:RESTful接口,支持第三方集成、二次开发

命令行入口:本地调试、批量执行、自动化调用

智能体核心层(Agent Core)

任务拆解引擎:将复杂问题分解为原子化子任务,生成执行计划

推理决策模块:意图理解、上下文感知、链式思考、异常处理

记忆管理系统:短期内存缓存+长期SQLite/文件持久化存储

工具封装层(Tools)

搜索工具:多引擎聚合、结果去重、排序、过滤

抓取工具:HTTP请求+Playwright浏览器,静态/动态页面提取

解析工具:文本清洗、关键词提取、摘要生成、信息结构化

生成工具:LLM调用、提示词优化、报告排版、引用格式化

质量管控层(Hooks)

前置校验:问题合法性、输入范围、权限验证

中置把关:检索结果质量、内容相关性、来源可信度

后置审核:回答完整性、引用合规性、事实一致性、格式规范

配置与存储层(Config/Storage)

配置中心:

settings.yaml统一管理所有参数数据存储:研究历史、报告、记忆、缓存本地持久化

依赖管理:Python虚拟环境、第三方库、模型接口适配

3.2 核心技术实现

3.2.1 多源检索引擎

并行搜索调度:同时调用多个搜索API,异步获取结果,提升效率

智能结果融合:去重、排序、打分(相关性+权威性+时效性)

查询优化机制:自动扩展关键词、修正表述、生成精准检索式

失败兜底策略:主引擎不可用时自动切换备用源,保证可用性

3.2.2 网页内容抓取

双模式抓取:

轻量模式:requests+BeautifulSoup,处理静态页面,速度快

浏览器模式:Playwright+Chromium,渲染JS、处理登录、模拟交互

内容智能提取:

自动识别正文、标题、作者、发布时间、来源域名

过滤广告、导航、侧边栏、评论等冗余内容

支持长内容分页合并、编码自适应、乱码修复

3.2.3 质量校验算法

引用有效性校验:URL可达性、内容相关性、发布时间验证

来源多样性校验:至少N个不同域名、覆盖不同类型来源

信息充分性校验:回答覆盖问题维度、无关键信息缺失

一致性校验:不同来源信息无矛盾、结论可被多源佐证

3.2.4 技术栈清单

开发语言:Python 3.11+

Web框架:FastAPI(高性能异步API)

LLM适配:LiteLLM(统一接口)

浏览器:Playwright(无头Chrome)

数据处理:Pandas、BeautifulSoup、Jinja2

配置:PyYAML、Pydantic Settings

存储:SQLite、本地文件系统

部署:Uvicorn、Docker(可选)

3.3 代码仓库结构

SearchClaw/ ├── config/ # 配置文件目录 │ └── settings.yaml # 核心配置(模型、搜索、质量、浏览器等) ├── src/ # 主源码目录 │ ├── agent/ # 智能体核心逻辑 │ ├── tools/ # 搜索、抓取、解析、生成工具 │ ├── hooks/ # 质量校验钩子 │ ├── memory/ # 记忆系统 │ ├── server/ # FastAPI服务与Web UI │ └── utils/ # 通用工具函数 ├── report/ # 技术文档与报告 │ └── SearchClaw.pdf # 完整技术报告 ├── tests/ # 单元测试与集成测试 ├── examples/ # 使用示例与演示脚本 ├── requirements.txt # 基础依赖 ├── setup.py # 安装脚本 └── README.md # 项目说明文档

四、应用场景

4.1 学术科研场景

文献综述自动化:输入研究主题,自动检索中英文论文、整理摘要、梳理研究脉络、生成综述初稿

论文选题调研:分析领域热点、研究空白、最新进展、权威团队,辅助选题决策

实验结论验证:检索相关研究、对比方法与结果、验证结论可靠性、补充引用文献

学位论文辅助:章节内容拓展、数据来源查找、引用格式规范化、查重前信息补全

4.2 行业分析与市场调研

竞品分析报告:自动搜集竞品动态、产品信息、用户评价、市场份额、技术路线

行业趋势研究:整合新闻、研报、论坛、公众号,提炼趋势、机遇、风险、政策

用户需求挖掘:分析社交媒体、评论区、问答平台,汇总用户痛点、偏好、反馈

投资尽职调查:检索企业信息、财务数据、行业地位、风险因素、合规情况

4.3 内容创作与写作

深度文章撰写:公众号、知乎、专栏长文,自动搜集素材、构建框架、填充内容、标注引用

报告生成:行业报告、市场分析、解决方案、白皮书,结构化输出+权威来源

文案素材搜集:产品介绍、营销文案、宣传材料,搜集案例、数据、观点、案例

翻译与本地化:检索多语言资料、对比版本、辅助精准翻译、补充文化背景

4.4 学习与教育场景

课题研究辅助:中小学/大学课题作业,自动搜集资料、整理知识点、生成报告

论文写作指导:开题报告、文献综述、正文撰写,提供思路、素材、引用支持

知识体系构建:围绕知识点,自动关联概念、原理、案例、应用、最新研究

考试复习资料:整理考点、搜集例题、汇总易错点、生成复习提纲

4.5 企业与办公场景

情报监测:行业动态、政策法规、竞争对手、技术突破、舆情信息实时监控

方案设计:项目方案、技术方案、解决方案,搜集最佳实践、案例、技术选型

合规审查:检索法律法规、行业标准、监管要求、合规案例、风险提示

培训材料制作:课程内容、课件、手册,自动整理知识点、案例、数据、图表

五、使用方法

5.1 环境要求

操作系统:Windows 10+/macOS 12+/Linux(Ubuntu 22.04+)

Python版本:3.11、3.12(推荐)

内存:≥8GB(推荐16GB)

存储:≥10GB可用空间

网络:可访问互联网(支持国内/国际网络)

5.2 安装步骤

5.2.1 克隆仓库

git clone https://github.com/RUC-NLPIR/SearchClaw.git cd SearchClaw

5.2.2 安装基础依赖

# 创建虚拟环境(推荐) python -m venv venv source venv/bin/activate # macOS/Linux # 或 Windows venv\Scripts\activate # 安装核心依赖 pip install -e .

5.2.3 可选:浏览器集成(推荐)

用于抓取JS渲染、需登录的复杂页面:

pip install -e '.[browser]' playwright install chromium

5.3 配置API密钥

5.3.1 必选:LLM模型密钥(至少一个)

# Anthropic Claude(推荐,中文效果好) export ANTHROPIC_API_KEY="sk-ant-xxxxxxxxxxxxxxxxxxxxxxxx" # 或 OpenAI GPT export OPENAI_API_KEY="sk-xxxxxxxxxxxxxxxxxxxxxxxx" # 或 Google Gemini export GOOGLE_API_KEY="AIzaSyxxxxxxxxxxxxxxxxxxxxxxxx"

5.3.2 可选:搜索/抓取API密钥(提升能力)

# Serper(网页搜索,替代Google) export SERPER_API_KEY="xxxxxxxxxxxxxxxxxxxxxxxx" # Jina(网页内容提取,提升抓取质量) export JINA_API_KEY="jina_xxxxxxxxxxxxxxxxxxxxxxxx" # NewsAPI(新闻搜索) export NEWSAPI_KEY="xxxxxxxxxxxxxxxxxxxxxxxx"

5.4 启动服务

# 方式1:直接启动(推荐) python -m src.main # 方式2:指定端口/主机 python -m src.main --host 0.0.0.0 --port 8080 # 方式3:后台运行(Linux/macOS) nohup python -m src.main &

5.5 使用Web UI

打开浏览器访问:

http://localhost:8000(默认端口)输入研究问题/主题(支持中文/英文)

点击「开始研究」,等待自动执行(进度实时显示)

研究完成后,查看完整报告+引用列表

支持导出PDF/Markdown、重新研究、调整参数

5.6 核心配置说明(config/settings.yaml)

# LLM配置 llm: provider: anthropic # openai/google model: claude-3-sonnet-20240229 temperature: 0.1 # 越低越精准,越高越创意 max_tokens: 4096 # 搜索配置 tools: search: engines: [serper, duckduckgo] max_results: 10 # 每轮搜索数量 timeout: 30 # 超时时间 # 质量校验 hooks: min_references: 3 # 最小引用数 min_domains: 2 # 最小来源域名数 min_length: 500 # 回答最小长度 # 浏览器配置 browser: enabled: true # 启用浏览器 headless: true # 无头模式 timeout: 60 # 页面加载超时

六、竞品对比

与主流AI搜索/研究工具对比,SearchClaw核心优势为自托管+强质量管控+多源学术覆盖+本地隐私安全:

| 对比维度 | SearchClaw | Perplexity Pro | ChatGPT Plus(联网) | OpenClaw |

|---|---|---|---|---|

| 开发主体 | 中国人民大学NLPIR实验室 | 美国Perplexity AI | OpenAI | 开源社区 |

| 部署方式 | 完全自托管(本地/私有云) | 云端SaaS | 云端SaaS | 本地+云端混合 |

| 数据隐私 | 100%本地掌控,无泄露 | 数据上传云端 | 数据上传云端 | 本地优先,部分云端 |

| 核心定位 | 深度研究+学术调研+报告生成 | 实时搜索+问答 | 通用对话+联网搜索 | 通用AI智能体+多技能 |

| 学术支持 | 强(arXiv/Semantic Scholar/DBLP) | 中(基础论文) | 弱(有限文献) | 中(插件扩展) |

| 中文覆盖 | 极强(微信+国内学术+新闻) | 中(国际为主) | 中(通用内容) | 强(中文插件丰富) |

| 质量管控 | 内置多重钩子+强制引用校验 | 基础引用+简单校验 | 弱(易幻觉) | 中(插件可选) |

| 浏览器集成 | 原生支持(Playwright/CDP) | 有限(基础抓取) | 无(仅API搜索) | 强(插件支持) |

| 持久记忆 | 跨会话本地持久化 | 会话内记忆 | 会话内记忆 | 强(本地存储) |

| 自定义程度 | 极高(全配置+源码开放) | 低(SaaS固定) | 低(API有限) | 高(插件+配置) |

| 使用成本 | 开源免费(仅API密钥成本) | 付费订阅($20/月) | 付费订阅($20/月) | 开源免费(插件付费) |

| 适用人群 | 研究员/学生/分析师/隐私用户 | 普通用户/快速查询 | 通用用户/日常办公 | 开发者/技术用户 |

七、常见问题解答

Q:SearchClaw是否完全免费?

A:是的,项目本身100%开源免费(MIT协议),可自由使用、修改、分发。仅需承担调用第三方LLM(Claude/GPT)、搜索API(Serper)的费用,基础使用免费额度足够日常需求。

Q:没有国外API密钥能否使用?

A:可以。支持国内大模型(通义千问、文心一言等,通过LiteLLM配置),搜索可使用DuckDuckGo(免费无密钥)、百度搜索(国内API),完全适配国内网络环境。

Q:安装依赖失败如何解决?

A:1. 确认Python版本≥3.11;2. 升级pip:pip install --upgrade pip;3. 换国内源:pip config set global.index-url https://pypi.tuna.tsinghua.edu.cn/simple;4. 浏览器安装失败:手动下载Chromium或关闭browser功能。

Q:研究速度慢、耗时较长怎么办?

A:1. 降低max_results(搜索数量);2. 关闭浏览器集成(适合静态页面);3. 选择更快的LLM模型(如Claude 3 Haiku);4. 提升网络速度与设备配置。

Q:生成的报告引用不完整、来源单一?

A:1. 调高min_references/min_domains配置;2. 增加搜索引擎数量;3. 补充更多API密钥(Serper/NewsAPI);4. 问题描述更具体,缩小研究范围。

Q:能否部署到服务器,远程访问使用?

A:完全可以。启动时指定--host 0.0.0.0,配置防火墙/端口映射,支持公网/内网远程访问,可设置密码保护提升安全性。

Q:支持批量处理多个研究任务吗?

A:支持。可通过命令行模式、API调用、脚本批量执行,适合企业级批量调研、定期情报采集、自动化报告生成。

Q:如何导出研究报告,用于二次编辑?

A:Web UI提供PDF、Markdown导出功能,Markdown格式可直接在Word/Notion/Obsidian中编辑,保留所有文本、格式与引用链接。

Q:项目是否持续维护,遇到问题如何获取支持?

A:项目由人大NLPIR实验室持续维护更新,可通过GitHub提交Issue、Discussion,社区活跃、文档完善,同时提供技术报告与示例参考。

八、相关链接

九、总结

SearchClaw作为中国人民大学信息检索实验室研发的开源自托管AI深度研究智能体,以“自主研究、质量可控、多源整合、隐私安全”为核心,通过“工具+钩子”双层架构与闭环式研究流程,有效解决传统AI搜索的幻觉、引用缺失、信息片面等痛点,为科研、分析、创作、学习、办公等场景提供可追溯、可复现、可定制的自动化深度调研能力。相比云端SaaS工具,其100%本地部署、数据自主掌控、高度自定义、学术资源深度覆盖、中文优化等优势显著,既适合个人用户提升信息处理效率,也满足企业与机构对数据安全、隐私合规、批量自动化的需求,是当前AI时代专业级信息研究与报告生成的优质开源方案。

版权及免责申明:本文由@dotaai原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/searchclaw.html