Seeduplex:字节跳动推出的全双工语音交互大模型,豆包已全量落地

一、Seeduplex是什么

Seeduplex(Seed Unified Duplex Speech Model,内部代号Duplex-2B) 是字节跳动Seed团队发布的原生全双工语音大模型,基于自研Seed基座打造,是业界首个实现规模化落地的全双工语音大模型,已在豆包App全量上线。

该模型彻底打破传统AI语音“半双工、一问一答、听完再说”的交互桎梏,在单一神经网络内同步完成语音识别、语义理解、语音合成与对话控制,实现听、说、控三流并行,让人机对话具备真人般“边听边说、随时打断、自然停顿”的流畅体验,标志着语音大模型从“文本中心”迈向“语音原生”的关键拐点。

核心定位:以全双工架构为核心,解决传统语音AI延迟高、打断难、抗干扰差、对话生硬等行业痛点,为消费级与企业级场景提供低延迟、高自然度、强鲁棒性的实时语音交互能力。

二、功能特色

1. 原生全双工并行架构

听流、说流、控流同步运行,无需等待用户说完即可处理与生成内容

端到端响应延迟≤500ms,核心打断延迟低至50ms级

支持连续50轮+无中断对话,一次唤醒全程交互

2. 动态判停与自然节奏控制

联合声学+语义双特征判断用户意图,区分说话、思考停顿、噪音

误回复率、误打断率较半双工模型降低50%

适配犹豫、插话、补充说明等真人对话习惯

3. 精准抗干扰与强环境鲁棒性

持续感知声学环境,精准分离目标语音与背景噪音、无关对话

地铁、商场、咖啡厅等复杂场景识别准确率≥95%

多人对话中可锁定目标说话人,不被旁支对话干扰

4. 多模态与跨语种兼容能力

支持普通话+粤语、川渝话等多方言混合识别,方言准确率提升35%

中英双语实时混读理解,适配国际化场景

语音与文本跨模态统一解码,无缝衔接多模态交互

5. 实时打断与情绪自适应

词级实时打断准确率**97.3%**,插话修正无卡顿

感知用户语气情绪,调整应答语速与语调

支持语音通话场景全双工流转,媲美真人通话体验

核心性能指标表

| 指标项 | 实测数据 | 行业对比优势 |

|---|---|---|

| 端到端延迟 | ≤500ms | 较半双工模型提速40% |

| 实时打断准确率 | 97.3% | 词级精准打断 |

| 复杂场景识别率 | ≥95% | 抗干扰能力提升1倍 |

| 连续对话轮次 | 50+轮 | 无中断持久交互 |

| 方言识别提升 | 35% | 覆盖主流方言场景 |

三、应用场景

1. 智能语音助手(消费级核心场景)

豆包App语音对话:边说边答、随时打断,告别机械回合制

手机语音操控:无需反复唤醒,连续指令一气呵成

语音通话助理:全双工流转,自然接听与应答

2. 智能客服与企业服务

呼叫中心:嘈杂环境稳定交互,减少误判与重复问询

在线客服机器人:多轮流畅对话,提升转化率与满意度

政务热线:7×24小时全双工应答,降低人工成本

3. 车载智能交互

车机语音:穿透风噪、胎噪、乘客对话,精准识别驾驶员指令

连续操控:导航+空调+音乐一站式语音调度

行车安全:免触屏交互,减少驾驶分心

4. 教育与口语训练

口语陪练:感知学生思考停顿,自然引导不抢话

外语对话:实时纠错、多语种混读交互

少儿陪伴:温和节奏适配儿童表达习惯

5. 智能家居与物联网

全屋语音控制:多人环境锁定指令,无误触发

电视/音箱交互:边看边说、随时插话切换内容

老人陪护:低学习成本,自然对话式操控

6. 实时翻译与会议场景

同声传译:全双工流转,无延迟双向翻译

会议助理:实时记录、插话提问不中断

跨国沟通:消除语言间隔,自然流畅交流

四、使用方法

(一)消费端使用(豆包App)

下载并打开最新版豆包App,登录账号

点击首页语音图标,开启全双工语音模式

直接说话,无需等待,可随时打断、补充、修正

对话中可切换文本/语音,支持连续多轮交互

退出:点击结束按钮或自动超时关闭

(二)企业端接入(API/SDK)

访问字节跳动开放平台,申请Seeduplex调用权限

获取API Key与接口文档,选择SDK(Android/iOS/Web/服务端)

集成核心接口:

// 全双工语音流初始化示例

const duplex = new Seeduplex({

apiKey: "your_key",

mode: "duplex_live", // 全双工实时模式

interrupt: true, // 开启实时打断

noiseSuppress: high // 高等级抗干扰

});

duplex.startStream();配置场景参数(延迟、打断灵敏度、方言开关)

测试环境:嘈杂/安静/多人场景验证

正式部署与按量计费调用

(三)参数配置建议

车载:高抗干扰+高打断灵敏度

客服:中等延迟+自然判停+情绪适配

教育:低打断灵敏度+温和语速

翻译:超低延迟+双语混读模式

五、竞品对比

主流语音AI模型对比表

| 维度 | Seeduplex | 传统半双工语音模型 | 国外全双工试验模型 |

|---|---|---|---|

| 架构 | 原生全双工三流并行 | 半双工串行处理 | 实验室级全双工 |

| 落地状态 | 规模化全量上线 | 广泛商用 | 未大规模落地 |

| 端到端延迟 | ≤500ms | 800-1500ms | 600-1000ms |

| 实时打断 | 词级97.3%准确率 | 句级,误打断高 | 词级,稳定性不足 |

| 抗干扰 | 复杂场景≥95% | 嘈杂环境准确率骤降 | 中等鲁棒性 |

| 方言支持 | 主流方言+多语种 | 有限支持 | 以英语为主 |

| 生态 | 豆包+字节开放平台 | 各厂商独立生态 | 生态不完善 |

核心优势总结

落地性领先:唯一规模化上线的原生全双工模型,非实验室方案

体验更自然:动态判停+抗干扰双突破,接近真人对话

全场景适配:消费+企业全覆盖,方言与环境鲁棒性更强

延迟更低:500ms内端到端响应,打断无感知

生态完善:依托字节开放平台,快速集成与迭代

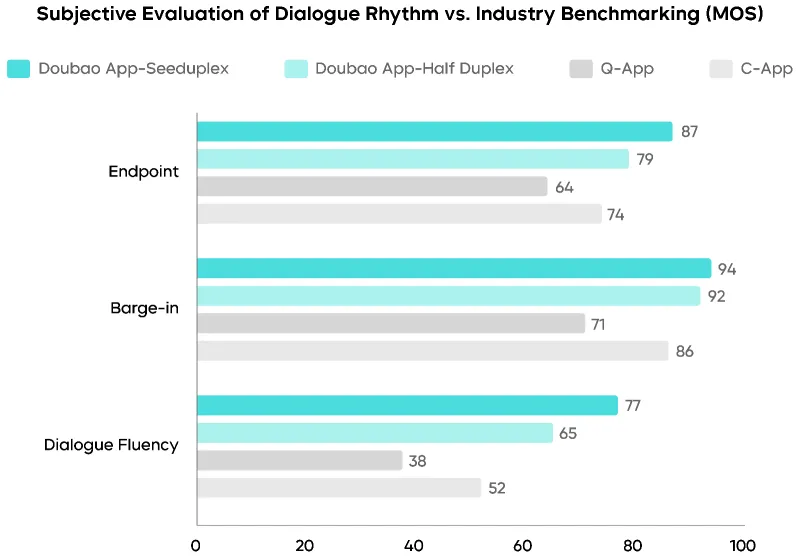

(图片来源于字节跳动官网)

六、常见问题解答

Seeduplex与传统语音助手的核心区别是什么?

传统语音助手为半双工模式,必须等用户说完停顿后才响应,延迟高、易误打断、对话生硬;Seeduplex是原生全双工,边听边处理、随时打断、自然判停,体验更接近真人对话。

Seeduplex的响应延迟具体是多少?

端到端语音对话延迟≤500ms,核心打断延迟低至50ms级,日常对话无明显等待感。

在嘈杂环境下Seeduplex能否正常使用?

可以。模型具备持续声学感知与噪声分离能力,地铁、商场、咖啡厅等复杂场景识别准确率≥95%,远优于传统半双工模型。

是否支持方言与多语种混合对话?

支持。覆盖普通话、粤语、川渝话等主流方言,方言识别准确率提升35%;同时支持中英双语混读理解。

能否随时打断AI的回答并修正指令?

可以。词级实时打断准确率97.3%,插话、补充、修正均流畅无卡顿,无需等待AI说完。

Seeduplex是否支持连续多轮对话?

支持,可实现50轮以上无中断连续对话,一次唤醒即可全程交互,无需重复唤醒。

企业如何接入Seeduplex能力?

企业可通过字节跳动开放平台申请API/SDK,提供服务端、Web、Android、iOS多端集成方案,按调用量计费。

Seeduplex是否支持语音通话场景?

支持,已在豆包语音通话中全量落地,实现全双工流转,接听与应答自然流畅,媲美真人通话。

动态判停功能会误判用户停顿吗?

通过声学+语义联合判断,误回复率与误打断率较半双工模型降低50%,可有效区分思考停顿、说话中断与环境噪音。

Seeduplex对设备性能有要求吗?

消费端在主流智能手机即可流畅运行;企业端可根据场景选择云端全双工或端云协同模式,适配低功耗设备。

七、相关链接

字节跳动Seeduplex官方发布页:https://seed.bytedance.com/zh/seeduplex

豆包官网地址:https://www.doubao.com

八、总结

Seeduplex作为字节跳动推出的行业首个规模化落地原生全双工语音大模型,以三流并行架构、低延迟响应、动态判停、精准抗干扰为核心能力,彻底解决传统语音AI交互生硬、延迟高、打断难、抗干扰差等痛点,已在豆包App全量上线并面向企业开放接入,广泛覆盖智能助手、车载、客服、教育、智能家居、实时翻译等场景,凭借优秀的环境鲁棒性、方言适配能力与自然对话体验,成为当前语音交互领域落地性最强、体验最接近真人对话的全双工解决方案,为人机语音交互从“命令式”向“自然对话式”升级提供了成熟技术支撑。

相关软件下载

豆包

版权及免责申明:本文由@AI工具箱原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/seeduplex.html