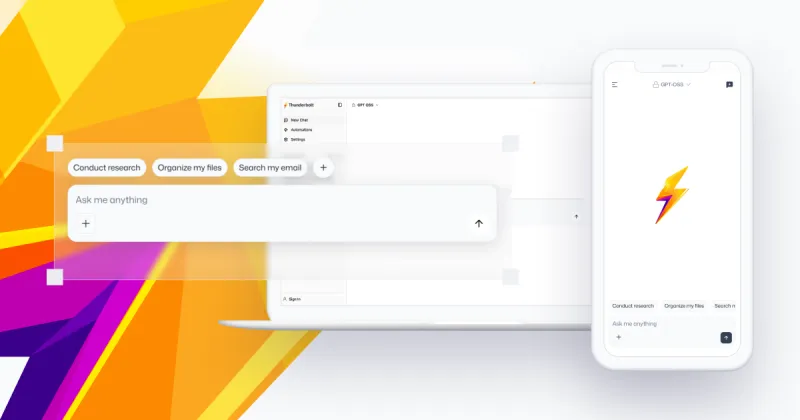

Thunderbolt:开源跨平台AI客户端,自主可控数据隐私与模型选择

一、Thunderbolt是什么

Thunderbolt是由Mozilla基金会旗下MZLA Technologies(Thunderbird邮件客户端开发团队)打造的开源、跨平台、自托管AI客户端,核心定位为“主权AI客户端”,核心理念是“AI You Control — Choose your models. Own your data. Eliminate vendor lock-in”(由你掌控的AI:选择模型、拥有数据、消除供应商锁定)。

该项目诞生于2025年7月,2026年4月正式引发广泛关注,基于Mozilla Public License 2.0开源,允许自由使用、修改和分发,同时提供企业级商业支持服务。不同于ChatGPT、Claude等云端AI服务,Thunderbolt不依赖第三方云服务器,支持在本地设备或企业内网部署,让用户完全掌控AI交互数据与模型选择,彻底规避数据泄露与供应商锁定风险。

二、功能特色

Thunderbolt聚焦隐私可控、模型兼容、跨平台适配与企业级能力,核心功能特色如下:

1. 全平台覆盖,无缝适配多设备

桌面端:支持Windows、macOS、Linux三大主流系统,提供原生客户端,适配x86/ARM架构设备;

移动端:兼容iOS、Android系统,可通过应用商店安装,支持离线使用核心功能;

网页端:提供Web客户端,无需安装即可通过浏览器访问,适配各类设备屏幕。

2. 全模型兼容,灵活切换无限制

本地模型适配:完美支持Ollama、llama.cpp等本地推理框架,可无缝接入Llama 3、Mistral、Qwen等开源大模型,实现免费本地AI交互;

商业模型兼容:支持OpenAI、Anthropic、DeepSeek等主流商业模型API,一键切换ChatGPT、Claude等服务,无需重复配置;

自定义模型接入:兼容任意OpenAI兼容接口的私有化部署模型,支持企业自定义模型集成。

3. 数据绝对可控,全链路隐私保护

端到端加密(E2E):采用AES-256-GCM加密算法,数据在离开设备前完成加密,服务器仅存储密文,私钥由用户掌控(ECDH P-256 + ML-KEM-768加密标准);

离线优先:内置SQLite本地数据库,支持完全离线使用,对话数据仅存储在用户设备,无需上传云端;

自托管部署:后端(PostgreSQL、PowerSync、MongoDB、Keycloak)可通过Docker Compose一键部署,企业数据全程留存在内网环境,满足GDPR、HIPAA等合规要求。

4. 企业级能力,高效办公与合规适配

统一AI工作台:集成对话聊天、智能搜索、任务自动化、文档分析等功能,一站式满足企业AI办公需求;

全磁盘加密(FDE):支持设备级全磁盘加密,防止数据物理泄露,适配金融、医疗、法律等敏感行业;

团队协作管理:支持多用户权限配置、对话历史同步、团队知识库共享,适配企业团队协作场景;

安全审计日志:记录所有AI交互行为,支持操作追溯与合规审计,满足企业安全管理需求。

5. 开源开放,灵活扩展无束缚

完全开源:基于MPL 2.0协议开源,代码透明可审计,无隐藏后门,支持社区自由二次开发;

模块化架构:采用前后端分离设计,核心功能模块化,支持自定义插件开发,按需扩展功能;

无供应商锁定:不绑定特定模型或服务,用户可随时切换模型提供商,无需迁移数据或重构工作流。

三、技术细节

Thunderbolt采用现代化技术栈构建,融合跨平台开发、加密通信、本地存储与AI模型适配技术,核心技术架构如下:

1. 整体技术栈

前端:基于Tauri + React + TypeScript开发,Tauri替代传统Electron,大幅降低内存占用(比Electron轻约60%),同时支持原生系统调用,兼顾跨平台兼容性与性能;

后端:采用Node.js + Express构建API服务,搭配PostgreSQL(主数据库)、MongoDB(非结构化数据存储)、Redis(缓存),支持分布式部署;

本地存储:内置SQLite数据库,结合PowerSync实现跨设备数据同步,同步过程全程加密;

加密技术:端到端加密采用AES-256-GCM(数据加密)+ ECDH P-256(密钥交换)+ ML-KEM-768(后量子加密),保障数据传输与存储安全;

模型适配层:自研模型适配中间件,兼容OpenAI API、Ollama API、ACP(智能体客户端协议)、MCP(模型上下文协议),实现多模型无缝接入。

2. 核心工作流程

用户交互:通过客户端(桌面/移动/网页)输入问题或上传文档;

本地处理:客户端先在本地SQLite数据库检索历史对话或本地知识库,优先离线响应;

模型调用:如需外部模型,客户端通过加密通道(TLS 1.3)发送请求至自托管后端,后端转发至指定模型(本地/Ollama/商业API);

数据加密:模型返回结果经AES-256-GCM加密后回传客户端,仅客户端本地解密显示;

数据存储:对话数据仅加密存储在本地SQLite数据库,自托管服务器仅存储密文与必要元数据。

3. 部署架构(Docker Compose)

# 核心服务组件 services: # 前端客户端 thunderbolt-web: image: thunderbird/thunderbolt-web:latest ports: - "3000:3000" depends_on: - thunderbolt-api # 后端API服务 thunderbolt-api: image: thunderbird/thunderbolt-api:latest environment: - DATABASE_URL=postgres://user:pass@postgres:5432/thunderbolt - REDIS_URL=redis://redis:6379 - ENCRYPTION_KEY=your-256-bit-secret-key depends_on: - postgres - mongodb - redis - keycloak # 数据库与中间件 postgres: image: postgres:15 volumes: - postgres-data:/var/lib/postgresql/data mongodb: image: mongo:6 volumes: - mongodb-data:/data/db redis: image: redis:7-alpine keycloak: image: keycloak:22 environment: - KEYCLOAK_ADMIN=admin - KEYCLOAK_ADMIN_PASSWORD=admin

四、应用场景

Thunderbolt凭借隐私可控、模型兼容与跨平台优势,适配个人、企业与特殊行业等多类场景:

1. 企业隐私办公(核心场景)

金融行业:银行、证券机构用于客户数据分析、风险报告生成,避免客户敏感财务数据泄露;

医疗行业:医院、医疗机构处理患者病历、医学文献分析,满足HIPAA医疗数据合规要求;

法律行业:律所用于案件资料整理、合同审查,保障案件信息与客户隐私安全;

普通企业:内部文档总结、会议纪要生成、员工培训,防止商业机密通过云端AI服务泄露。

2. 个人隐私优先使用

隐私敏感用户:日常聊天、知识问答、内容创作,无需担心对话数据被服务商收集用于模型训练;

本地AI爱好者:搭配Ollama部署Llama 3、Qwen等开源模型,免费享受高性能AI服务,无需依赖云端;

离线办公场景:无网络环境下(如出差、野外办公),通过本地模型实现AI辅助工作。

3. 私有化AI部署项目

政府/事业单位:政务数据处理、政策文件分析,满足国产化替代与数据自主可控要求;

教育机构:校园知识库搭建、学生学习辅导,保护学生个人信息与校园数据安全;

开源社区/开发者:二次开发定制AI客户端,适配特定行业需求(如工业质检、农业数据分析)。

五、使用方法

Thunderbolt支持本地部署与企业自托管两种使用模式,以下为快速上手步骤:

1. 环境准备

硬件要求:

本地模型(Ollama):CPU 4核+、内存8GB+(运行7B模型)/16GB+(运行13B模型);

自托管服务器:CPU 8核+、内存16GB+、硬盘500GB+(SSD优先);

软件依赖:Docker 20.10+、Docker Compose v2+、Git(可选)。

2. 快速部署(Docker Compose)

克隆仓库(或直接创建

docker-compose.yml文件):

git clone https://github.com/thunderbird/thunderbolt.git cd thunderbolt/deploy

配置环境变量(复制

.env.example为.env,修改加密密钥、数据库密码等):

cp .env.example .env # 编辑.env文件,设置ENCRYPTION_KEY、DATABASE_URL等参数

启动服务:

docker-compose up -d

访问客户端:浏览器打开

http://localhost:3000,或安装桌面客户端,注册登录后使用。

3. 模型配置

本地模型(Ollama):

安装Ollama并启动本地模型(如

ollama run llama3);在Thunderbolt客户端“模型设置”中,添加Ollama地址(默认

http://host.docker.internal:11434),保存后即可切换本地模型。商业模型(以OpenAI为例):

进入“模型设置”,选择“OpenAI”;

填写API Key、模型名称(如gpt-4o)、API地址(默认https://api.openai.com);

保存配置,一键切换至ChatGPT模型。

4. 基础使用

对话聊天:首页直接输入问题,支持文本、图片(多模态模型)输入,实时获取AI回复;

文档分析:上传PDF、Word、TXT文档,支持总结、翻译、问答;

历史管理:查看/删除本地对话历史,支持导出加密对话记录;

离线使用:关闭网络后,本地模型可正常响应历史对话与基础问答。

六、竞品对比(2-3个具体产品)

选取ChatGPT Enterprise、Microsoft Copilot、Open WebUI三款主流AI客户端/服务,从核心定位、数据隐私、模型兼容、部署方式、价格等维度与Thunderbolt对比:

| 对比维度 | Thunderbolt | ChatGPT Enterprise | Microsoft Copilot | Open WebUI |

|---|---|---|---|---|

| 核心定位 | 开源自托管AI客户端,数据自主可控 | 企业级云端AI服务,OpenAI私有部署 | 微软生态集成AI助手,办公协同优先 | 开源自托管AI前端,轻量模型适配 |

| 数据隐私 | 端到端加密,离线优先,数据留本地/内网 | 云端加密存储,OpenAI可控,企业专属隔离 | 数据上传微软云端,合规隔离,生态数据互通 | 基础加密,本地存储,无强制加密标准 |

| 模型兼容 | 本地(Ollama/llama.cpp)+商业(OpenAI/Claude)+自定义模型 | 仅OpenAI系列模型(GPT-4o/GPT-3.5) | 仅微软/OpenAI模型(GPT-4o/定制模型) | 主流开源模型(Llama/Mistral),少量商业模型 |

| 部署方式 | Docker/K8s自托管,跨平台原生客户端 | OpenAI云端托管,无本地部署选项 | 微软365云端集成,无独立部署 | Docker部署,仅Web/轻量桌面端 |

| 跨平台支持 | Web+Windows/macOS/Linux+iOS/Android | Web+浏览器插件,无原生客户端 | Windows/macOS+Web+Office插件,移动端弱适配 | 仅Web端,无原生客户端 |

| 价格模式 | 开源免费,企业支持$15/用户/月 | $20+/用户/月,按企业规模定价 | Microsoft 365订阅($30+/用户/月) | 完全免费,无企业支持服务 |

| 开源状态 | 完全开源(MPL 2.0),代码可审计 | 闭源,无公开代码 | 闭源,深度绑定微软生态 | 开源(MIT),轻量二次开发 |

核心差异总结

Thunderbolt:唯一兼顾全平台原生客户端+端到端加密+全模型兼容+企业级支持的开源方案,平衡隐私、灵活性与企业能力;

ChatGPT Enterprise:模型性能强,但闭源+云端部署,数据控制权归OpenAI,成本高;

Microsoft Copilot:办公生态集成度高,但绑定微软365+闭源,数据需上传微软云端,隐私可控性弱;

Open WebUI:开源免费、轻量,但无原生客户端+企业级能力缺失,仅适合个人/小型团队使用。

七、常见问题解答

Q1:Thunderbolt和Thunderbird邮件客户端是什么关系?

A:两者同属MZLA Technologies公司开发,但为独立产品。Thunderbird是邮件客户端,Thunderbolt是AI客户端,共享同一开发团队与开源理念,但代码、功能与定位完全独立,无直接关联。

Q2:Thunderbolt是否完全免费使用?

A:Thunderbolt核心代码基于MPL 2.0协议完全免费开源,个人用户可免费部署、使用所有基础功能,无功能限制或广告。企业用户如需专业技术支持、定制开发、SLA保障等服务,需购买企业版授权($15/用户/月),基础功能仍免费。

Q3:使用Thunderbolt时,数据是否会被Mozilla收集?

A:默认情况下,Mozilla不收集任何用户交互数据。Thunderbolt内置遥测功能(Telemetry),但默认关闭,开启后仅收集匿名使用统计数据(如功能使用率),无对话内容、个人信息等敏感数据,遥测数据收集规则见仓库TELEMETRY.md文档,用户可随时关闭。

Q4:Thunderbolt支持多模态功能(图片、语音)吗?

A:支持。Thunderbolt已适配支持多模态的模型(如GPT-4o、Llava、Qwen-VL),用户上传图片后,可进行图片描述、OCR识别、图文问答等操作;语音功能需搭配支持语音的模型或第三方语音转文字服务,当前版本已支持基础语音输入输出。

Q5:Thunderbolt运行本地模型时,性能受哪些因素影响?

A:主要受三大因素影响:一是硬件配置,CPU核心数、内存大小(建议16GB+运行13B模型)、硬盘读写速度(SSD优先)直接决定推理速度;二是模型大小,7B模型速度最快,13B模型平衡性能与效果,34B+模型需GPU加速;三是推理框架,Ollama、llama.cpp针对CPU优化,速度优于原生框架,建议优先搭配使用。

Q6:是否支持团队多人协作使用Thunderbolt?

A:支持企业团队协作。自托管部署后,管理员可通过Keycloak配置多用户账号、角色权限(管理员/普通用户/只读用户),支持团队对话历史同步、知识库共享、协作编辑文档等功能,满足企业团队协作需求。

八、相关链接

九、总结

Thunderbolt是Mozilla Thunderbird团队推出的开源跨平台AI客户端,以数据自主可控、全模型兼容、跨平台适配为核心优势,打破传统云端AI服务的供应商锁定与数据隐私泄露风险,兼顾个人隐私使用与企业合规需求。它基于MPL 2.0协议开源,提供Docker/K8s自托管部署方案,适配本地开源模型与主流商业模型,内置端到端加密与离线优先能力,平衡了灵活性、安全性与易用性,为隐私敏感用户、企业与开发者提供了一款自主可控的AI工具选择。

版权及免责申明:本文由@AI铺子原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/thunderbolt.html