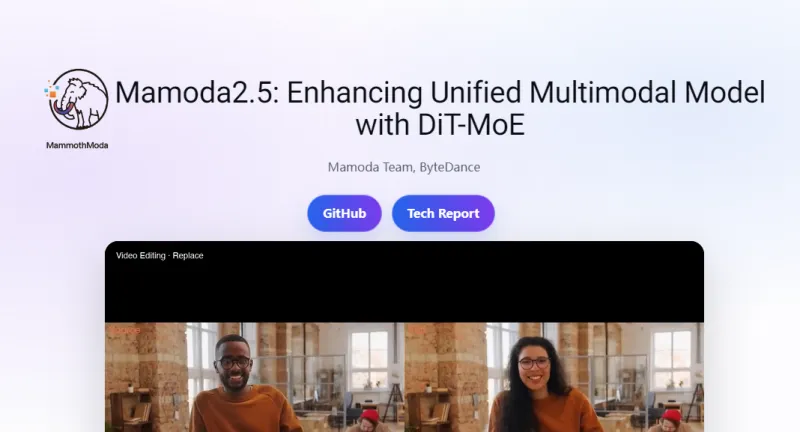

Mamoda2.5:字节跳动开源的多模态AI生成编辑一体化框架

一、Mamoda2.5 是什么

Mamoda2.5 是字节跳动 Mamoda 团队自研推出的开源统一多模态大模型,依托 DiT-MoE 稀疏混合专家架构 打造,采用 AR-Diffusion 统一建模范式,实现多模态理解、内容生成、智能编辑三大能力一体化融合。

该模型整体参数量达 25B,通过专家路由机制实现稀疏激活推理,仅小部分参数参与单次运算,兼顾超大模型能力与轻量化推理速度,是当前开源领域视频生成、视频编辑、图像创作赛道的标杆级产品,在多项国际权威多模态基准评测中登顶榜首,同时具备低硬件门槛、全场景适配、高生成画质等核心优势,面向开发者、创作者、企业机构提供可私有化部署、可二次开发的多模态AI底层能力。

二、功能特色

Mamoda2.5 打破传统多模态模型单一任务局限,一套模型覆盖全链路创作与理解需求,核心功能特色如下:

全任务统一能力

支持文生图像、文生视频、图像智能编辑、视频精细化编辑四大核心任务,无需切换不同模型,一套架构完成多场景创作需求,大幅降低开发与使用成本。极致视频生成能力

原生支持 720p 高清视频生成,最高可生成 93 帧长时序视频,画面连贯性、人物肢体一致性、场景逻辑合理性达到开源顶尖水准,适配电影感、胶片风、赛博朋克、二次元、纪实风等多种风格生成。极速视频编辑体验

内置蒸馏加速版本与标准版本,480p 视频编辑最快仅需 9秒 完成,支持画面元素替换、物体移除、场景新增、风格迁移、镜头特效重塑、人物形象微调等精细化编辑操作。稀疏高效推理特性

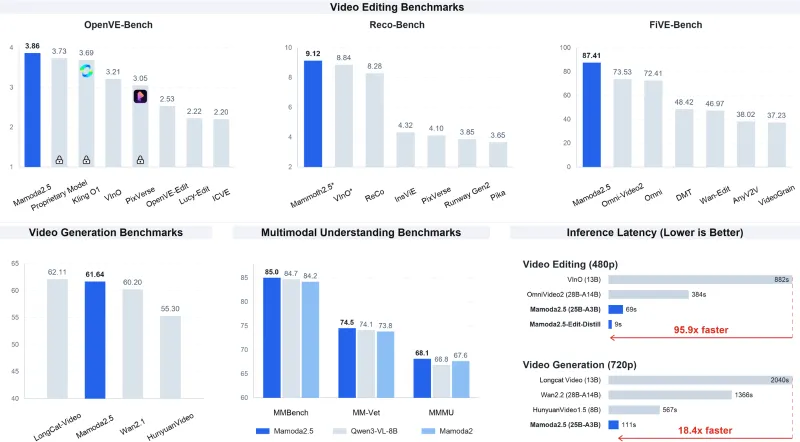

采用 128 路由专家架构,单次推理仅激活约 3B 参数量,激活占比仅 12% 左右,在保留 25B 大模型能力的同时,推理速度远超同规格密集型模型。多基准权威领跑

在 OpenVE-Bench、FiVE-Bench、Reco-Bench 三大视频编辑权威榜单稳居第一,VBench 2.0 视频生成评测位列开源 SOTA,多模态理解评测 MMBench、MM-Vet、MMMU 均表现优异。开源可商用可二次开发

项目完整开源,提供模型权重、部署代码、调用示例,支持本地私有化部署、定制化微调、行业场景二次开发,适配个人创作、企业落地、科研实验等多元需求。

三、技术细节

3.1 整体架构设计

Mamoda2.5 采用理解+生成双模块耦合架构,底层基座与生成主干深度协同:

多模态理解基座:基于 Qwen3-VL-8B 视觉语言模型,负责图文语义理解、画面内容识别、用户指令解析、编辑意图精准捕捉,为生成和编辑任务提供语义支撑。

生成主干网络:自研细粒度 MoE DiT 架构,配置 128 个专业路由专家,采用 Top-8 动态路由机制,根据任务类型自动激活对应专家模块,实现任务差异化算力分配。

统一建模范式:引入 AR-Diffusion 统一自回归扩散框架,摒弃传统生成与编辑分离的建模方式,用同一套网络逻辑兼容图像、视频的生成与编辑任务。

3.2 参数与推理机制

模型总参数量:250 亿(25B)

单次前向激活参数量:约 30 亿(3B),激活比例仅 12%

收敛效率:同等激活参数量下,相比传统密集型模型收敛速度提升 2.2 倍

视频生成规格:原生支持 720p 分辨率、最长 93 帧连续视频生成

视频编辑规格:标准支持 480p 高清编辑,提供 4 步蒸馏极速版与 30 步高清标准版双模式

3.3 核心技术创新点

DiT-MoE 融合创新

将扩散Transformer 与混合专家网络深度结合,解决大模型推理速度慢、硬件要求高的痛点,实现“大模型能力、小模型算力消耗”。动态智能路由算法

128 个专家按场景、风格、编辑类型精细化分工,路由算法可实时解析用户提示词,精准匹配最优专家组合,提升生成画质与指令遵循度。蒸馏轻量化优化

针对视频编辑场景做模型蒸馏压缩,在几乎无损画质的前提下,将推理耗时压缩至秒级,适配普通消费级显卡本地运行。长时序一致性约束

内置时序对齐算法,生成长帧视频时,保障人物动作、场景背景、光影色调连续不跳变,杜绝开源模型常见的肢体畸变、画面闪烁问题。

3.4 部署技术依赖

项目基于主流深度学习框架开发,依赖环境简洁易配置:

Python >= 3.9 PyTorch >= 2.1 Transformers、Diffusers、Accelerate CUDA >= 11.8

支持 Windows、Linux 双系统部署,适配单卡、多卡推理,支持命令行调用、API 接口封装、Web 界面集成三种接入方式。

四、应用场景

Mamoda2.5 凭借多模态全能力特性,可覆盖个人、企业、开发者、科研四大类应用场景:

短视频内容创作

自媒体博主、短视频创作者可通过文生视频快速生成剧情片段、口播背景、创意特效视频,也可对已有视频做元素替换、风格美化、镜头二次编辑,降低剪辑创作门槛。电商视觉内容生产

电商商家一键生成商品宣传图、产品展示短视频,对商品图片、视频做背景替换、细节修图、风格统一化处理,批量产出电商营销素材。影视与动漫辅助制作

影视从业者生成分镜动态预览、场景概念视频,动漫创作者生成二次元角色动态短片、画风迁移,辅助前期创意落地与后期剪辑优化。企业私有化AI部署

政企机构、科技企业可私有化部署模型,搭建内部AI创意平台、智能剪辑系统、多模态客服理解模块,保障数据不外泄,实现业务定制化赋能。教育与科普内容制作

教师、科普创作者生成教学动画、原理演示短视频,将文字知识点转化为可视化视频内容,提升教学与科普传播效果。AI 二次开发与科研

AI 开发者基于开源权重做微调、定制化功能开发,科研人员用于多模态大模型、稀疏MoE架构、视频生成算法的学术研究与实验验证。

五、使用方法

5.1 在线体验方式

直接访问项目官方在线地址,无需本地部署即可快速体验全部功能:

https://mamoda25.github.io/

打开网页后,支持输入文字提示词生成图片/视频、上传本地图片做编辑、上传视频做二次创作,可视化操作界面,零基础可直接上手。

5.2 本地部署步骤

克隆项目官方代码仓库,配置上述代码依赖环境;

下载官方发布的 Mamoda2.5 模型权重文件,放入指定模型目录;

执行启动命令,运行本地 Web 服务:

python app.py

浏览器访问本地端口地址,进入私有化操作界面,即可离线使用文生图、文生视频、图像编辑、视频编辑全部功能。

5.3 API 调用方式

项目内置标准 API 接口,支持开发者接入自有系统、小程序、网站平台,通过 HTTP 请求传入提示词、素材文件、生成参数,即可异步获取生成结果,支持批量任务调度与接口权限配置。

六、竞品对比

选取当前开源视频生成与多模态领域主流产品 HunyuanVideo1.5、Kling、Wan2.2 三款产品,从架构、推理速度、编辑能力、开源属性、硬件门槛五个维度做横向对比:

| 对比维度 | Mamoda2.5 | HunyuanVideo1.5 | Kling | Wan2.2 |

|---|---|---|---|---|

| 核心架构 | DiT-MoE 稀疏混合专家 | 密集DiT架构 | 自研时序扩散架构 | 传统扩散Transformer |

| 720p视频生成速度 | 基准领先,较Wan2.2快18.4倍 | 中等水平,推理耗时偏高 | 画质优但推理速度慢 | 同规格最慢 |

| 视频编辑能力 | 多基准榜单第一,支持精细化编辑 | 仅基础剪辑,无深度编辑 | 编辑功能有限,无极速蒸馏版 | 以生成为主,编辑能力薄弱 |

| 模型激活机制 | 稀疏激活,仅12%参数参与运算 | 全参数密集推理 | 全参数密集推理 | 全参数密集推理 |

| 硬件部署门槛 | 支持普通显卡本地部署 | 需高端专业显卡 | 硬件要求极高 | 显存占用大,入门显卡无法运行 |

| 开源与二次开发 | 完全开源,支持商用微调 | 部分开源,权限受限 | 闭源为主,无开源权重 | 开源但定制化难度高 |

对比总结:Mamoda2.5 在架构先进性、推理速度、视频编辑实力、部署门槛、开源自由度上全面领先同级别竞品,兼顾画质、速度与落地实用性,是综合性价比最高的开源统一多模态模型。

七、常见问题解答

Q1:Mamoda2.5 是否完全开源,可用于商业项目吗?

A1:项目由字节跳动 Mamoda 团队正式开源,提供完整模型权重与代码工程,允许个人非商用及企业商业二次开发、私有化部署,只需遵循官方开源协议即可正常使用。

Q2:本地部署 Mamoda2.5 对电脑硬件有什么要求?

A2:基础体验可使用 16G 显存中端显卡,流畅运行 720p 视频生成建议 24G 及以上显存;480p 极速编辑版本优化完善,12G 显存显卡即可流畅运行,普通消费级电脑也能部署体验。

Q3:Mamoda2.5 生成的视频会不会出现人物畸变、画面闪烁问题?

A3:模型内置长时序一致性约束算法,针对人体肢体、面部细节、场景时序做专项优化,大幅减少开源模型常见的肢体畸变、画面跳变、光影闪烁问题,长帧视频生成稳定性极强。

Q4:新手没有AI基础,能不能直接使用这个项目?

A4:可以。官方提供在线网页体验端,无需部署、无需代码基础,输入文字就能生成图文视频;本地部署也提供傻瓜式脚本,按教程几步即可完成配置,零基础用户也能快速上手。

Q5:是否支持自定义风格、行业专属场景微调?

A5:支持。开源版本开放微调接口与训练脚本,开发者可导入行业专属素材,对模型进行风格、场景、行业话术的定制化微调,适配电商、教育、影视等垂直领域需求。

Q6:相比其他视频生成模型,Mamoda2.5 最大优势是什么?

A6:核心优势是大一统架构+稀疏极速推理+编辑能力领跑,一套模型搞定生成与编辑,速度远超竞品,同时开源无使用限制、硬件门槛更低,综合落地能力更强。

八、相关链接

项目在线体验地址:https://mamoda25.github.io/

项目官方论文预印本:https://arxiv.org/abs/2605.02641

九、总结

Mamoda2.5 作为字节跳动 Mamoda 团队推出的开源统一多模态大模型,凭借创新的 DiT-MoE 稀疏混合专家架构与 AR-Diffusion 统一建模范式,实现了多模态理解、图文视频生成、智能编辑的全能力整合,不仅在推理速度、生成画质、视频编辑性能上领跑开源同类产品,还具备低硬件门槛、全平台部署、开源可商用、支持二次开发等落地优势,能够广泛适配自媒体创作、电商素材生产、影视动漫制作、企业私有化部署、教育科普内容产出等多元场景,为普通创作者、AI 开发者、政企机构提供了一套低成本、高效率、高性能的多模态AI底层解决方案。

版权及免责申明:本文由@AI工具集原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/mamoda2-5.html