Voice-Pro:轻量型开源语音工具集,集成识别、克隆与多语言配音

一、Voice-Pro是什么

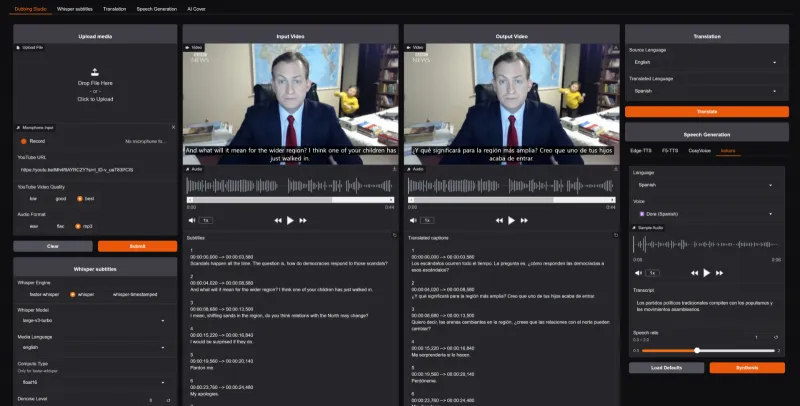

Voice-Pro是一款基于Python开发的AI驱动型语音处理网页应用,集成Whisper、F5-TTS、Demucs等主流模型,提供语音识别、零样本语音克隆、多语言文本转语音、音频分离、YouTube音频提取等全流程功能。该项目依托Gradio框架实现简洁易用的可视化交互界面,无需复杂的代码编写即可完成高精度的语音处理任务。

作为ElevenLabs的优质替代方案,Voice-Pro摒弃了商业化工具的付费壁垒,整合了当前开源社区中主流的语音模型与处理技术,覆盖语音识别、语音克隆、文本转语音、音频分离、多语言翻译、YouTube音频处理六大核心场景。无论是自媒体创作者、科研人员,还是多语言从业者,都能借助该工具高效完成音频内容的制作与优化。同时,项目支持Windows、Mac、Linux多平台部署(其中Windows NVIDIA GPU环境验证充分),遵循LGPL开源许可证,允许用户自由下载、修改、分发代码,极大降低了语音技术的使用门槛。

二、功能特色

Voice-Pro的核心优势在于全流程、模块化、低成本的语音处理能力,其功能覆盖从音频输入到输出的完整链路,具体特色可分为以下六大模块:

1. 高精度多模型语音识别

语音识别是Voice-Pro的基础功能,该模块集成了四款行业主流的开源模型,满足不同精度与速度的需求,具体参数对比如下:

| 模型名称 | 核心优势 | 适用场景 |

|---|---|---|

| Whisper | OpenAI经典模型,支持99+语言,识别准确率高 | 通用场景语音转文字 |

| Faster-Whisper | Whisper的优化版本,推理速度提升2-4倍,显存占用更低 | 大批量音频快速转写 |

| Whisper-Timestamped | 支持精准时间戳标注,可定位语音对应的文本片段 | 字幕制作、音频片段检索 |

| WhisperX | 基于Whisper升级,支持说话人分离,多角色语音转写 | 访谈、会议录音处理 |

借助上述模型,用户可将各类音频文件(如MP3、WAV)或实时语音转换为文本,同时支持多语言识别,满足跨境内容处理需求。

2. 零样本语音克隆

语音克隆是Voice-Pro的特色功能,区别于传统需要大量训练数据的克隆技术,该项目集成的三款模型支持零样本/少样本克隆,即仅需一段5-10秒的目标语音,即可生成音色高度相似的合成语音。

F5-TTS:开源轻量级模型,克隆速度快,生成语音自然度高,适合个人用户快速克隆;

E2-TTS:支持情感语音克隆,可模拟不同情绪(如喜悦、平静)的语音输出,适用于有声读物制作;

CosyVoice:字节跳动开源模型,支持多语言克隆,兼顾音色相似度与语音流畅度。

该功能无需专业的训练环境,普通用户通过网页界面上传目标语音片段,即可完成克隆并生成新的语音内容。

3. 多语言文本转语音(TTS)

文本转语音模块为用户提供丰富的语音合成选择,内置多款模型满足不同需求:

基础免费模型:Edge-TTS(微软开源)、kokoro,支持多语言合成,语音风格自然,适合日常文本转语音场景;

付费增强模型:Azure TTS(需配置API密钥),提供更多音色选择,支持自定义语速、语调,适用于商业化内容制作。

用户可输入任意文本,选择目标语言与音色,一键生成合成语音,同时支持批量文本处理,提升内容生产效率。

4. YouTube音频处理

针对自媒体创作者的需求,Voice-Pro集成yt-dlp工具,支持直接输入YouTube视频链接,实现视频下载、音频提取、格式转换等功能。用户无需额外安装下载工具,即可将YouTube视频中的音频提取为MP3、WAV等格式,无缝衔接后续的语音识别、翻译或配音任务,极大简化了跨境视频内容的二次创作流程。

5. 100+语言即时翻译

语音与文本的多语言翻译是Voice-Pro的重要延伸功能,依托两大翻译引擎实现:

基础版:集成Deep-Translator,支持100+语言的文本互译,无需API密钥,免费使用,满足普通用户的翻译需求;

付费版:集成Azure Translator,翻译准确率更高,支持专业术语翻译,适用于学术、商业场景的高精度翻译任务。

该功能可与语音识别模块联动,实现“语音转文字→文字翻译→翻译文本转语音”的全流程自动化处理。

6. 精细化音频分离

针对音频编辑需求,Voice-Pro集成Demucs、MDX-Net、UVR-MDX-NET三款主流音频分离模型,可将混合音频中的人声、伴奏、鼓点、贝斯等轨道精准分离。用户上传一首歌曲或一段混合音频,即可一键提取纯人声或纯伴奏,适用于卡拉OK制作、音乐翻唱、音频降噪等场景。

三、技术细节

1. 核心技术栈

Voice-Pro的技术架构围绕“前端可视化+后端模型推理+多模块集成”展开,具体技术栈如下:

| 技术层面 | 核心工具/框架 | 功能作用 |

|---|---|---|

| 前端交互 | Gradio | 构建网页可视化界面,实现用户与模型的交互操作 |

| 后端推理 | Python | 项目核心开发语言,负责模型调用与逻辑处理 |

| 加速支持 | CUDA | 利用NVIDIA GPU加速模型推理,提升处理速度 |

| 音频处理 | Demucs、MDX-Net、UVR-MDX-NET | 实现音频轨道分离、降噪等处理 |

| 语音模型 | Whisper系列、F5-TTS、E2-TTS、CosyVoice | 提供语音识别、克隆、合成能力 |

| 辅助工具 | yt-dlp、Deep-Translator | 实现YouTube音频下载、多语言翻译 |

2. 项目架构

Voice-Pro的仓库结构清晰,模块化设计便于开发者二次开发与功能扩展,核心目录结构如下:

voice-pro/ ├── .env.example # 环境变量示例文件,配置API密钥(如Azure TTS) ├── configure.bat/.sh # 环境配置脚本,自动安装依赖(区分Windows/Linux) ├── start.bat/.sh # 应用启动脚本,一键启动Gradio网页服务 ├── one_click.py # 一键式配置与运行脚本,简化新手操作流程 ├── requirements-voice-*.txt # 依赖清单,分CPU/GPU版本,适配不同硬件环境 ├── app/ # 应用核心逻辑目录 │ ├── abus_hf_files-*.json # Hugging Face模型下载配置文件 │ ├── gradio_gulliver.py # Gradio界面核心代码,实现kokoro TTS功能 │ └── abus_files.py # 配音文件处理逻辑,管理音频输入输出 ├── src/ # 底层模块目录 │ ├── demucs/ # Demucs音频分离模型实现代码 │ ├── js/ # 前端辅助JS代码,实现JSON文件下载等功能 │ └── rvc/ # RVC语音转换模块,支持音色转换 ├── third_party/ # 第三方依赖目录,存放Matcha-TTS等外部模型 ├── docs/ # 多语言文档目录,含中/英/日/韩/德等语言使用说明 └── cosyvoice/ # CosyVoice语音克隆模块专用目录

3. 模型部署方式

Voice-Pro的模型部署采用自动下载+本地推理的方式:用户启动应用后,首次使用某一模型时,系统会自动从Hugging Face仓库下载预训练模型权重至本地,后续使用无需重复下载。同时,项目支持CPU与GPU两种推理模式:

GPU模式:需安装NVIDIA显卡驱动与CUDA工具包,推理速度快,适合大批量音频处理;

CPU模式:无需显卡,适配低配设备,推理速度较慢,适合小文件测试使用。

四、应用场景

Voice-Pro的功能覆盖个人、团队、商业等多类场景,具体应用方向如下:

1. 自媒体内容创作

对于短视频、有声读物创作者,Voice-Pro可实现“视频音频提取→语音转文字→文字翻译→翻译文本配音→音频合成”的全流程自动化。例如,创作者可下载YouTube英文视频,提取音频后转写为英文文本,再翻译为中文,最后用中文语音克隆功能生成配音,快速完成跨境视频的本地化改造。同时,音频分离功能可提取视频中的纯伴奏,用于二次创作。

2. 科研与教学

在科研领域,研究人员可借助Voice-Pro的多模型语音识别功能,对访谈录音、会议记录进行转写与分析;语音克隆功能可用于语音合成模型的对比实验,降低科研成本。在教学场景中,教师可利用文本转语音功能生成多语言听力材料,或通过语音克隆模拟不同口音的语音,帮助学生提升听力水平。

3. 多语言办公

对于跨国企业或外贸从业者,Voice-Pro可用于会议录音的转写与翻译,快速生成多语言会议纪要;同时,文本转语音功能可将外文邮件、文档转换为语音,方便用户在移动场景下收听。

4. 音频编辑与制作

音乐爱好者可利用音频分离功能提取歌曲的纯人声或纯伴奏,用于翻唱、混音制作;配音演员可借助语音克隆功能备份自己的音色,或模拟特定音色完成配音任务。

五、使用方法

Voice-Pro的使用流程简洁易懂,无需专业技术背景,具体步骤如下:

1. 环境准备

硬件要求:推荐使用配备NVIDIA GPU的设备(显存≥4GB),CPU模式可运行但速度较慢;

系统要求:Windows(推荐)、Mac、Linux均可,Windows系统需安装Git与Python 3.8+。

2. 安装部署

克隆仓库:打开终端,执行命令

git clone https://github.com/abus-aikorea/voice-pro.git,将仓库下载至本地;配置环境:进入仓库目录,运行对应系统的配置脚本:

Windows系统:双击

configure.bat,自动安装依赖包;Linux/Mac系统:在终端执行

sh configure.sh;启动应用:配置完成后,运行启动脚本:

Windows系统:双击

start.bat;Linux/Mac系统:在终端执行

sh start.sh;访问界面:脚本运行成功后,终端会输出一个本地网址(如

http://localhost:7860),在浏览器中打开该网址即可进入Voice-Pro的网页界面。

3. 核心功能使用示例(以语音克隆为例)

上传目标语音:在网页界面找到“语音克隆”模块,上传一段5-10秒的清晰目标语音片段(支持MP3、WAV格式);

选择克隆模型:根据需求选择F5-TTS、E2-TTS或CosyVoice模型;

输入合成文本:在文本框中输入需要合成的内容,选择目标语言;

生成语音:点击“生成”按钮,等待模型推理完成,即可播放或下载合成的语音文件。

其他功能(如语音识别、音频分离)的使用流程类似,均通过网页界面的可视化操作完成,无需编写代码。

六、常见问题解答

1. 启动应用时提示依赖包安装失败怎么办?

答:首先检查Python版本是否为3.8及以上,推荐使用3.9版本;其次,删除仓库目录下的installer_files文件夹,重新运行configure.bat/.sh脚本;若仍失败,可手动安装依赖包,执行命令pip install -r requirements-voice-gpu.txt(GPU版本)或pip install -r requirements-voice-cpu.txt(CPU版本)。

2. 模型下载速度慢或下载失败如何解决?

答:Voice-Pro的模型从Hugging Face下载,若速度较慢,可配置Hugging Face的国内镜像源;若下载失败,可手动从Hugging Face官网下载对应模型权重,放入仓库指定目录(具体路径参考docs文件夹中的模型部署文档)。

3. 语音克隆的效果不理想,如何优化?

答:提升克隆效果的关键是上传高质量的目标语音:① 语音片段需清晰无杂音,避免背景噪音;② 语音时长控制在5-10秒,包含完整的语句;③ 选择适合的模型,如需要情感语音可选择E2-TTS,需要多语言克隆可选择CosyVoice。

4. 应用支持哪些音频格式?

答:目前支持的输入音频格式包括MP3、WAV、FLAC、OGG,输出格式默认为MP3,可在设置中调整为WAV格式。

5. 商业使用该项目是否需要授权?

答:Voice-Pro遵循LGPL开源许可证,商业使用时需遵守许可证条款:① 若修改了项目代码,需开源修改后的代码;② 若仅使用该项目的二进制文件(未修改代码),可直接商业使用,无需开源。

七、相关链接

八、总结

Voice-Pro是一款功能全面、易用性高的开源AI语音处理套件,凭借集成多主流模型的优势,实现了语音识别、克隆、合成、音频分离、多语言翻译等全流程服务,为不同领域的用户提供了低成本的语音技术解决方案。其模块化的架构设计便于开发者二次开发,多平台适配的特性降低了使用门槛,而LGPL开源许可证则赋予了用户自由使用、修改、分发的权利。无论是自媒体创作者快速完成内容本地化,还是科研人员开展语音技术研究,亦或是普通用户处理日常音频需求,Voice-Pro都能凭借强大的功能与简洁的操作满足使用需求,是开源语音处理领域的一款极具实用价值的工具。

版权及免责申明:本文由@dotaai原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/voice-pro.html