Continue(开源AI编程插件)

- 软件版本:1.2.4

- 软件类型:编程开发

- 软件语言:英文

- 运行环境:插件

- 软件大小:76.4 MB

- 发布时间:

Continue是什么

Continue是一款专为开发者打造的开源 AI 编程助手,支持 Visual Studio Code(VSCode) 和 JetBrains 系列 IDE(如 IntelliJ IDEA、PyCharm 等)。它本身不提供 AI 模型,而是作为一个强大的“中间层”平台,允许用户接入多种主流或本地部署的大语言模型(LLM),实现智能代码生成、自动补全、上下文理解与高效编辑。

成为当前最受欢迎的开源 AI 编程工具之一。其灵活性、可扩展性和对本地模型的良好支持,使其在注重隐私和定制化的开发团队中广受青睐。

Continue 并非一个封闭的商业 AI 工具,而是一个高度模块化、开放架构的 AI 助手框架。它的核心设计理念是:

“让开发者自由选择最适合自己的 AI 模型,并将其无缝集成到日常编码流程中。”

为此,Continue 构建了一个完整的 AI 模型生态系统,涵盖以下四类关键模型:

聊天模型(Chat Model):用于对话式编程、代码解释、重构建议。

自动补全模型(Autocomplete Model):实现实时代码补全,提升输入效率。

嵌入模型(Embeddings Model):将代码转化为向量,用于语义搜索。

重排序模型(Reranking Model):优化搜索结果的相关性排序。

通过这四大模型协同工作,Continue 能够实现从“写代码”到“理解整个项目”的全方位智能辅助。

此外,Continue 支持多种运行方式:

连接云端 API(如 GPT-4、Claude、Gemini)

接入本地运行的模型(如通过 Ollama 运行 DeepSeek、Qwen-Coder)

自定义配置模型路径与参数

这让它既适合个人开发者探索 AI 编程,也适用于企业级私有化部署场景。

软件功能

1. 聊天功能(Chat)

在 VSCode 侧边栏中直接与 AI 对话

可上传当前文件、选中代码块作为上下文

支持多轮对话、代码解释、错误诊断、测试用例生成等

2. 实时自动补全(Autocomplete)

基于 FIM(Fill-in-the-Middle)技术,在光标前后均有代码时仍能准确预测中间内容

补全响应速度快,延迟低,体验接近原生 IntelliSense

支持多种语言:Python、JavaScript、TypeScript、Go、Rust、Java 等

3. 智能代码编辑(Edit)

无需切换文件即可直接修改代码

输入自然语言指令(如“把这段函数改成异步版本”),AI 自动生成并应用变更

支持批量修改多个文件

4. 快捷操作(Actions)

提供预设快捷命令,例如:

/test:为当前函数生成单元测试

/doc:添加注释文档

/fix:修复报错

/explain:解释代码逻辑

支持自定义 Slash Commands 扩展功能

5. @Codebase 全局代码搜索

利用嵌入模型 + 向量数据库索引整个项目代码库

使用 @codebase 指令进行语义级搜索(如:“找出所有调用数据库连接的地方”)

结合重排序模型精准匹配最相关代码片段

软件特色

| 特色 | 说明 |

|---|---|

| 开源免费 | 完全开源(MIT 协议),可在 GitHub 自由下载、审查源码、参与贡献 |

| 多模型支持 | 支持 OpenAI、Anthropic、Google、HuggingFace、Ollama、Local LLM 等多种模型接入 |

| 高度可定制 | 可分别配置 Chat Model、Autocomplete Model、Embedding Model 等,满足个性化需求 |

| 本地运行支持 | 支持通过 Ollama 在本地运行 DeepSeek、Qwen-Coder 等开源模型,保护代码隐私 |

| 上下文管理强大 | 支持 Context Providers,自动提取 Git 差异、相关文件、文档等信息作为上下文 |

| 插件生态丰富 | 支持 MCP(Model Control Protocol)服务器扩展,未来可对接更多外部服务 |

使用方法(以 VSCode + DeepSeek 为例)

步骤 1:安装插件

打开 VSCode

进入 Extensions 商店,搜索 “Continue”

点击 Install 安装插件

或手动下载 .vsix 安装包后通过命令行安装:code --install-extension continue.continue

步骤 2:启动并配置模型

安装完成后,左侧边栏会出现 Continue 图标

点击图标打开面板,点击右上角齿轮⚙️进入设置界面

配置模型选项:

方式一:使用本地 Ollama + DeepSeek 模型

# configuration.yml 示例 models: - name: deepseek-chat provider: ollama model: deepseek-r1 type: chat - name: qwen-autocomplete provider: ollama model: qwen2.5-coder-1.5b-fim type: completion

⚠️ 提示:需提前安装 Ollama 并拉取对应模型:

ollama pull deepseek-r1 ollama pull qwen2.5-coder-1.5b-fim

方式二:使用云端模型(如 GPT-4)

models: - name: gpt-4-turbo provider: openai model: gpt-4-turbo apiKey: sk-xxxxxxxxxxxxxx

步骤 3:开始使用

打开任意代码文件,选中一段代码 → 右键选择 “Continue: Edit with AI”

或打开侧边栏 Chat 面板,输入问题如:“帮我优化这个算法”

使用 /test、/doc 等快捷命令快速生成内容

💡 建议将 Continue 移动至右侧边栏以便更佳浏览体验(右键图标 → Move to Panel Right)

收费价格

| 项目 | 是否收费 | 说明 |

|---|---|---|

| Continue 插件本身 | ❌ 免费 | MIT 开源协议,完全免费使用 |

| 第三方 AI 模型费用 | 视情况而定 | 若使用 OpenAI、Claude 等云端服务,按 API 调用量计费 |

| 本地模型运行成本 | ❌ 免费 | 使用 Ollama + 开源模型(如 DeepSeek、Qwen)无需支付费用,仅消耗本地算力 |

✅ 总结:Continue 是一款真正意义上的“零门槛 + 高自由度”AI 编程工具,你可以完全免费地搭配本地模型使用,也可以根据需要接入付费高性能模型。

常见问题解答(FAQ)

Q1:Continue 支持哪些 IDE?

A:目前主要支持:

Visual Studio Code(完整功能)

JetBrains 系列 IDE(IntelliJ、WebStorm、PyCharm 等,部分功能可能受限)

Q2:是否必须联网?能否离线使用?

A:可以离线使用!只要配置本地模型(如通过 Ollama 运行 DeepSeek 或 Qwen),即可在无网络环境下使用全部功能。

Q3:如何提高代码补全准确性?

A:建议:

使用专为代码设计的 FIM 模型(如 Codestral、Qwen2.5-Coder)

开启上下文提供器(Context Providers),让 AI 更好理解项目结构

合理使用 @codebase 搜索增强上下文

Q4:支持中文吗?

A:支持。虽然底层模型的语言能力取决于所选模型,但 Continue 界面及指令系统均支持中文输入,且多数现代 LLM(包括 DeepSeek)对中文编程指令响应良好。

Q5:如何更新 Continue?

A:VSCode 中可通过 Extensions 商店自动更新。

Q6:为什么推荐使用 Voyage AI 的 rerank 和 embedding 模型?

A:因为它们是目前在代码语义理解和检索任务上表现最佳的专用模型,比通用 LLM 更快、更准、成本更低。

总结

Continue 不只是一个 AI 插件,更是一个面向未来的 AI 编程操作系统雏形。它打破了传统 AI 助手“绑定单一模型”的局限,赋予开发者前所未有的控制权和自由度。

🎯 适合人群:

想尝试 AI 编程但担心数据泄露的开发者

希望使用本地大模型进行私有开发的技术团队

追求极致效率的高级程序员

教学、科研场景下的代码辅助工具使用者

🚀 核心优势总结:

开源免费,社区活跃

支持本地模型,保障安全

功能全面:聊天、补全、编辑、搜索一体化

高度可配置,支持深度定制

持续迭代,紧跟 AI 发展前沿

无论你是想用 GPT-4 写出优雅代码,还是用 DeepSeek 在本地安静地完成项目,Continue 都是你值得信赖的 AI 编程伙伴。

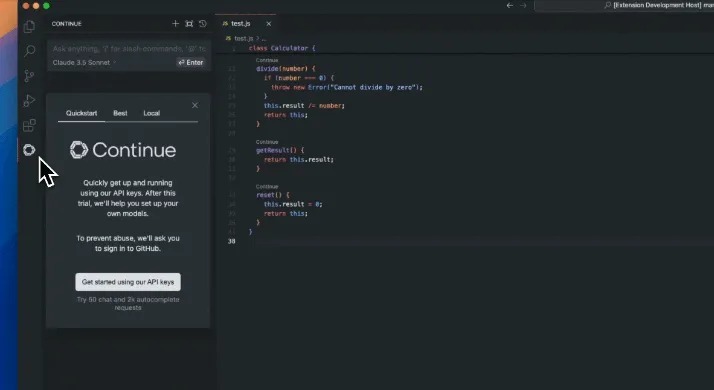

软件截图

Continue下载地址

版权与来源声明:AI铺子提供的Continue电脑客户端/APP,均转载自官方下载网站或经授权的可信分发渠道。相关软件的所有权、版权及知识产权均归原作者所有。本站不对任何软件进行二次修改或附加捆绑,确保文件的原始性与完整性。我们强烈建议用户支持正版软件,并通过官方渠道获取Continue最新版本和专业技术支持。