LLaMA-2 vs Mixtral 提示词调优全指南:从模型特性到8大实战技巧(含结构化指令、专家引导、长文本分段等)

在开源大模型落地实践中,一个被长期低估却决定成败的关键环节是:提示词是否真正“适配模型”——而非仅适配任务。LLaMA-2 与 Mixtral 虽同属高性能开源LLM,但架构迥异:前者是参数规模分层、指令敏感度低的通用基座;后者是混合专家(MoE)、长上下文友好、多语言原生的并行专才系统。用同一套提示词“一招鲜”调优二者,轻则输出质量波动,重则逻辑错位、信息遗漏。本文摒弃泛泛而谈的Prompt模板,直击底层差异,系统拆解两大模型的核心特性→适配原则→8大可复用实战技巧(LLaMA-2 5技 + Mixtral 3技 → 合计8大),覆盖结构化指令、Few-Shot分层设计、上下文窗口管理、温度协同调优、否定约束防偏移、专家模块引导、长文本分段标注、多任务优先级调度等真实开发场景,助你把Prompt从“能用”升级为“精准可控”。

一、引言

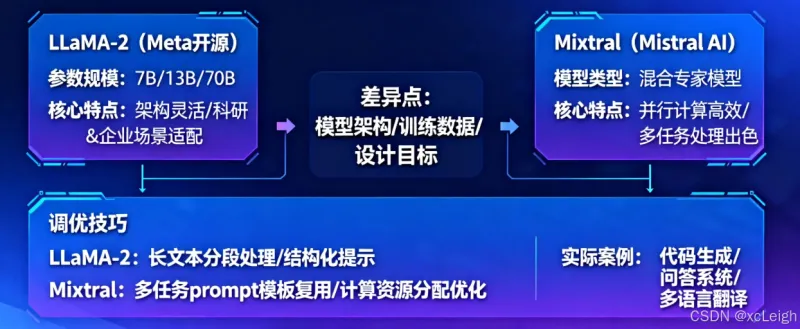

在大语言模型(LLM)的应用实践中,提示词是连接用户需求与模型输出的关键桥梁。LLaMA-2 作为 Meta 推出的开源大模型,凭借不同参数规模(7B/13B/70B)的灵活性,在科研与企业场景中广泛应用;而 Mixtral 作为 Mistral AI 推出的混合专家模型,以高效的并行计算能力和出色的多任务处理表现,成为众多开发者的首选。

由于两者在模型架构、训练数据和设计目标上存在差异,通用的提示词模板难以充分发挥其性能。本文将从模型特性出发,系统拆解 LLaMA-2 与 Mixtral 的提示词调优技巧,结合实际案例提供可落地的方案,帮助开发者避开调优误区,实现模型输出质量的显著提升。

二、LLaMA-2 模型特性与提示词适配原则

要做好 LLaMA-2 的提示词调优,首先需明确其核心特性,再针对性制定适配策略,这是后续所有技巧的基础。

(一)LLaMA-2 核心特性拆解

参数规模差异显著:7B 模型轻量、推理快,但上下文理解和复杂任务处理能力较弱;70B 模型性能接近闭源大模型,可处理长文本和逻辑推理任务,但对硬件资源要求更高。

训练数据偏向通用领域:模型训练数据以英文为主,涵盖互联网文本、书籍等通用内容,在专业领域(如法律、医疗)的知识储备有限,需通过提示词补充领域信息。

对指令的敏感度较低:相比 ChatGPT 等经过大量指令微调的模型,LLaMA-2 对模糊指令的容错率更低,若提示词缺乏明确约束,易出现输出冗长、偏离主题的问题。

(二)提示词适配三大核心原则

按参数规模分层设计:针对 7B 模型,提示词需简化任务目标,减少逻辑步骤,例如“总结文本”需明确“总结字数控制在 200 字以内”;针对 70B 模型,可增加任务复杂度,如“先分析文本中的观点,再对比不同观点的逻辑漏洞”。

补充领域知识与上下文:在专业任务中,需在提示词中嵌入关键概念定义或背景信息。例如进行“医学病例分析”时,先在提示词中说明“急性肺炎的典型症状包括发热、咳嗽、呼吸困难”,再要求模型基于病例文本判断病情。

强化指令的明确性与约束:避免使用“帮我处理一下这份数据”这类模糊指令,需明确任务类型、输出格式和评价标准。例如“对以下用户反馈数据进行情感分类,输出格式为‘反馈内容:[文本],情感标签:[正面/负面/中性],判断依据:[1-2 句话说明]’”。

三、LLaMA-2 提示词调优实战技巧

基于上述适配原则,本节提供 5 个可直接落地的调优技巧,每个技巧均配套案例,帮助开发者快速理解与应用。

(一)结构化指令:用“任务目标+步骤+格式”框架约束输出

LLaMA-2 对无结构指令的响应易混乱,通过“任务目标+步骤+格式”的结构化框架,可让模型明确任务边界和输出要求。

案例:使用结构化指令进行数据分类

原始提示词(效果差):

“帮我给这些产品评论分类,看看哪些是好评,哪些是差评。评论内容:1. 这个手机续航太差,用半天就没电了;2. 相机拍照很清晰,性价比很高;3. 系统卡顿严重,后悔买了。”

优化后提示词(效果优):

任务目标:对3条产品评论进行情感分类,区分正面评论和负面评论。 任务步骤: 1. 逐句阅读每条评论,提取用户对产品的核心评价(如续航、相机、系统); 2. 根据评价内容判断情感倾向:正面评价(肯定产品优点)标注为“正面”,负面评价(抱怨产品缺点)标注为“负面”; 3. 为每条分类结果补充1句话的判断依据。 输出格式: 评论1: - 核心评价:[提取的评价内容] - 情感标签:[正面/负面] - 判断依据:[1句话说明] 评论2: ...(同评论1格式) 评论3: ...(同评论1格式)

技巧点分析:优化后的提示词明确了“做什么(分类)”“怎么做(3个步骤)”“怎么输出(固定格式)”,LLaMA-2 可按照框架逐步执行任务,避免分类标准不统一或遗漏判断依据的问题。

(二)Few-Shot 示例:用“高质量示例”引导模型理解任务

LLaMA-2 在处理复杂任务(如实体识别、文本摘要)时,仅靠指令难以完全理解任务逻辑,提供 2-3 个高质量示例,可让模型快速掌握任务规律。

案例:使用 Few-Shot 示例进行实体识别(提取文本中的“产品名称”和“价格”)

优化提示词:

任务目标:从给定文本中提取“产品名称”和“价格”两类实体,若文本中无对应实体,标注为“无”。 示例1: 文本:我买了一台华为Mate 60 Pro手机,花了6999元,还送了一个耳机。 提取结果: - 产品名称:华为Mate 60 Pro手机、耳机 - 价格:6999元 示例2: 文本:今天去超市买了牛奶和面包,一共花了50元。 提取结果: - 产品名称:牛奶、面包 - 价格:50元 现在请处理以下文本: 文本:这款小米笔记本Pro 15的屏幕很清晰,我在官网看到售价是5499元,比线下店便宜200元。 提取结果:

技巧点分析:示例需覆盖任务的典型场景(如单产品多价格、多产品单价格),且标注准确无误。LLaMA-2 通过学习示例中的实体提取规律,可在新文本中精准定位目标实体,尤其适用于 7B 等小参数模型。

(三)上下文窗口管理:合理分配“输入文本”与“指令”占比

LLaMA-2 的上下文窗口有限(7B/13B 模型通常为 4k tokens,70B 模型支持 8k tokens),若输入文本过长,会挤压指令的空间,导致模型忽略关键约束。需根据文本长度调整指令与输入的占比,确保指令完整传递。

案例:长文本摘要的上下文窗口分配

场景:需总结一篇 3000 字的行业报告(约 600 tokens),使用 LLaMA-2 13B 模型(4k 上下文窗口,约 2000 中文字符)。

优化提示词:

任务目标:总结以下行业报告的核心内容,包括“行业规模”“主要趋势”“关键挑战”3个部分,总结字数控制在 500 字以内。 指令说明: 1. 优先提取报告中明确给出的数据(如“2024年行业规模达到XX亿元”); 2. 趋势部分需区分“短期趋势(1-2年)”和“长期趋势(3-5年)”; 3. 挑战部分需说明每个挑战的具体表现(如“人才短缺:行业专业人才缺口达XX万人”)。 报告文本:[此处插入 3000 字报告文本,约 600 tokens] 输出格式: 一、行业规模:[总结内容] 二、主要趋势: 1. 短期趋势:[内容] 2. 长期趋势:[内容] 三、关键挑战:[分点说明每个挑战]

技巧点分析:该提示词中,指令部分约 300 字(60 tokens),报告文本约 600 tokens,剩余上下文空间可满足 500 字(100 tokens)的总结输出,避免因文本过长导致指令被截断。同时,通过“优先提取数据”“区分趋势周期”等约束,确保总结内容的精准性。

(四)温度参数(Temperature)与提示词的协同调优

温度参数控制模型输出的随机性(0 为确定性输出,1 为高随机性),LLaMA-2 的温度参数需与提示词配合使用,才能在“准确性”和“多样性”之间找到平衡。

不同任务的参数与提示词搭配策略

| 任务类型 | 温度参数建议 | 提示词设计重点 | 案例 |

|---|---|---|---|

| 事实性问答(如“地球半径是多少”) | 0.1-0.3 | 明确要求“基于事实回答,避免猜测,若不确定需说明‘无明确数据支持’” | 提示词:“回答‘地球平均半径约为多少千米’,需引用权威数据来源(如科学机构发布的信息),若无法确定准确数值,标注为‘无明确数据支持’。” |

| 创意写作(如“写一段科幻故事开头”) | 0.7-0.9 | 鼓励“发挥想象力,加入独特的场景设定(如‘未来城市的空中交通系统’),避免俗套情节” | 提示词:“创作一段 200 字的科幻故事开头,需包含‘AI 管家与人类主人的互动’场景,加入1个独特设定(如‘AI 可感知人类的情绪波动并调整服务’),避免‘外星人入侵’等常见情节。” |

| 逻辑推理(如“数学题解答”) | 0.2-0.4 | 要求“分步骤推导,每一步说明依据(如‘根据勾股定理 a²+b²=c²’)” | 提示词:“解答‘直角三角形的两条直角边分别为 3cm 和 4cm,求斜边长度’,需分步骤推导,每一步说明使用的数学定理或公式,最终给出准确结果。” |

(五)避免输出偏移:添加“否定约束”明确禁区

LLaMA-2 在无明确否定约束时,可能输出与任务无关的内容(如冗余解释、敏感信息)。在提示词中添加“否定约束”,可明确模型的输出禁区。

案例:法律文书起草中的否定约束

优化提示词:

任务目标:起草一份简单的借款合同,包含“借款金额”“借款期限”“还款方式”3个核心条款。 输出要求: 1. 条款内容简洁,避免使用复杂法律术语(如不用“流质条款”“不安抗辩权”等专业表述); 2. 仅包含上述3个核心条款,不添加“违约责任”“争议解决”等额外条款; 3. 不出现任何与借款无关的内容(如不提及“抵押物品”“担保人”); 4. 语言正式,避免口语化表达(如不用“到时候还钱”“借多少”等表述)。 输出格式: # 借款合同 1. 借款金额:[填写具体金额,示例:人民币壹万元整(¥10000.00)] 2. 借款期限:[填写期限,示例:自2024年1月1日起至2024年12月31日止] 3. 还款方式:[填写方式,示例:每月10日前偿还本金500元及当月利息,利息按年利率4%计算]

技巧点分析:通过“不添加额外条款”“不出现无关内容”等否定约束,LLaMA-2 可聚焦核心任务,避免因模型自主扩展条款导致合同内容冗余或偏离需求。

四、Mixtral 模型特性与提示词适配原则

Mixtral 作为混合专家(MoE)模型,其架构设计与 LLaMA-2 差异较大,需针对性分析特性并制定适配原则,才能充分发挥其高效处理多任务的优势。

(一)Mixtral 核心特性拆解

混合专家架构优势:模型包含多个“专家模块”,每个模块专注于特定任务类型(如文本生成、逻辑推理、代码生成),推理时会根据输入内容调用对应专家模块,实现“专才处理专事”,多任务处理效率远超传统模型。

上下文窗口支持更长文本:主流版本的 Mixtral 支持 8k-32k tokens 的上下文窗口,可处理长文档(如整本电子书、完整代码库)的分析与生成任务。

多语言处理能力较强:相比 LLaMA-2,Mixtral 对中文、日文等多语言的支持更优,可处理多语言混合输入的任务(如“将中文技术文档翻译成英文并补充注释”)。

指令跟随性较好:经过针对性的指令微调,Mixtral 对模糊指令的理解能力更强,无需过度细化步骤即可完成任务,但在复杂逻辑任务中仍需明确约束。

(二)提示词适配三大核心原则

利用专家架构:按任务类型匹配“专家引导”:在提示词中明确任务类型(如“代码生成”“逻辑推理”),帮助模型快速调用对应专家模块。例如代码生成任务中,添加“请调用代码生成专家模块,确保代码语法正确、可直接运行”。

发挥长上下文优势:合理嵌入长文本与多源信息:针对长文档任务,可直接在提示词中插入完整文本(如 10000 字的小说),并要求模型进行“全局分析”(如“分析整本书的人物关系变化,按章节梳理关键转折点”)。

简化基础指令,聚焦复杂约束:对于基础任务(如“总结文本”),无需细化步骤,仅需明确输出要求(如“总结字数 300 字以内”);对于复杂任务(如“多语言代码生成”),则需补充关键约束(如“代码需同时支持 Python 和 Java 语法,添加详细注释”)。

五、Mixtral 提示词调优实战技巧

基于 Mixtral 的特性与适配原则,本节提供 4 个实战技巧,助力开发者充分发挥模型的多任务与长文本处理能力。

(一)专家引导指令:明确任务类型,激活对应专家模块

Mixtral 的专家模块需通过明确的任务类型引导才能高效激活,若提示词未说明任务类型,模型可能调用错误专家模块,导致输出质量下降。

案例:代码生成任务中的专家引导

原始提示词(效果差):

“帮我处理一下这个需求:用户输入两个数字,输出它们的和,还要有错误处理(如输入非数字时提示错误)。”

优化后提示词(效果优):

任务类型:Python 代码生成(需调用代码生成专家模块) 需求描述:编写一个 Python 函数,实现以下功能: 1. 接收用户输入的两个参数(均为数字); 2. 计算并返回两个参数的和; 3. 添加错误处理:若输入为非数字类型(如字符串、None),需捕获异常并返回“输入错误:请输入有效数字”。 输出要求: 1. 代码需包含函数定义、注释(说明函数功能、参数、返回值); 2. 提供 2 个测试用例(如输入 3 和 5,输入“a”和 2)及预期输出; 3. 确保代码可直接复制运行,无语法错误。

技巧点分析:通过“任务类型:Python 代码生成(需调用代码生成专家模块)”的引导,Mixtral 可快速激活代码生成专家模块,优先调用代码相关的训练知识,确保代码语法正确、逻辑完整,避免出现“仅文字描述功能而不生成代码”的问题。

(二)长文本处理:用“分段标注+全局指令”实现精准分析

Mixtral 支持长上下文窗口,但直接输入无结构的长文本,模型仍可能遗漏关键信息。通过“分段标注+全局指令”的方式,可让模型按段落梳理信息,再进行全局整合。

案例:长文档(5000 字行业报告)的要点提取

优化提示词:

任务目标:提取以下 5000 字行业报告的核心要点,涵盖“行业现状”“竞争格局”“未来机遇”3个维度。 处理方式: 1. 文档已按章节分段,每段标注为“章节1:[标题]”“章节2:[标题]”...; 2. 先逐章节提取该章节与“行业现状”“竞争格局”“未来机遇”相关的信息,标注为“章节X-现状:[内容]”“章节X-竞争:[内容]”“章节X-机遇:[内容]”; 3. 整合所有章节的提取结果,按“行业现状”“竞争格局”“未来机遇”3个维度汇总,去除重复信息,每个维度用分点说明。 报告文本: 章节1:2024年中国人工智能行业市场规模 [此处插入章节1文本,约 800 字] 章节2:人工智能行业主要企业竞争策略 [此处插入章节2文本,约 1000 字] 章节3:人工智能行业政策支持与未来发展方向 [此处插入章节3文本,约 1200 字] ...(后续章节依次标注并插入文本) 输出格式: 一、行业现状(整合各章节信息): 1. [要点1] 2. [要点2] ... 二、竞争格局(整合各章节信息): 1. [要点1] 2. [要点2] ... 三、未来机遇(整合各章节信息): 1. [要点1] 2. [要点2] ...

技巧点分析:分段标注让模型明确文本的结构逻辑,避免因长文本信息混乱导致的要点遗漏;全局指令则引导模型从“局部提取”到“全局整合”,确保最终输出的要点全面且有条理。

(三)多语言任务:用“语言切换标记+术语统一”确保输出质量

Mixtral 支持多语言处理,但在多语言混合任务(如翻译、跨语言摘要)中,若缺乏语言切换标记和术语统一约束,易出现语言混用、术语翻译不一致的问题。

案例:中文技术文档的英文翻译与注释

优化提示词:

任务目标:将以下中文技术文档翻译成英文,并为文档中的关键术语添加英文注释(格式:术语(英文):[简要说明])。 语言要求: 1. 翻译使用正式的技术英文,避免口语化表达; 2. 关键术语(如“机器学习模型”“神经网络”)的翻译需统一,首次出现时添加注释,后续使用统一英文表述; 3. 若中文句子存在歧义(如“该系统支持多用户访问”未说明“多用户”是否指“同时访问”),需根据技术文档上下文补充说明,确保英文翻译准确。 中文技术文档: “机器学习模型在图像识别领域的应用日益广泛。其中,神经网络是常用的模型架构之一,它通过模拟人类大脑的神经元连接方式,实现对图像特征的提取与分析。该系统支持多用户访问,可同时处理 100 个以上的图像识别任务。” 输出格式: 1. 英文翻译:[完整的英文翻译文本] 2. 关键术语注释: - 机器学习模型(Machine Learning Model):一种通过学习数据模式来完成特定任务(如图像识别)的算法框架。 - 神经网络(Neural Network):一种模拟人类大脑神经元连接结构的机器学习模型架构,常用于特征提取与模式识别。 - 图像识别(Image Recognition):通过技术手段让计算机识别图像中的目标(如物体、人物)并分类的任务。

技巧点分析:“语言切换标记”(如“英文翻译:”“关键术语注释:”)明确了不同语言的输出区域,避免语言混用;“术语统一”要求确保了技术文档的专业性和一致性,尤其适用于多章节、长篇幅的跨语言任务。

(四)多任务并行:用“任务分隔符+优先级说明”提升处理效率

Mixtral 可同时处理多个关联任务(如“先总结文本,再根据总结生成问答对”),但需通过“任务分隔符”明确任务边界,通过“优先级说明”确保核心任务优先完成。

案例:文本总结与问答对生成的多任务处理

优化提示词:

任务目标:同时完成以下两个关联任务,任务1为核心任务,优先确保任务1的输出质量,再进行任务2的处理。 任务分隔符:使用“---任务1---”“---任务2---”分隔两个任务,每个任务的输出按指定格式编写。 ---任务1:文本总结--- 输入文本:“Prompt 工程是提升大语言模型输出质量的关键技术。它通过设计精准的提示词,引导模型理解用户需求,避免输出偏离主题或冗余的内容。Prompt 工程的核心包括指令设计、示例提供、约束添加三个方面,不同模型(如 LLaMA-2、Mixtral)的提示词调优技巧存在差异。” 输出要求:总结字数控制在 150 字以内,涵盖“Prompt 工程的定义”“核心内容”“模型差异”3个要点。 输出格式:文本总结:[总结内容] ---任务2:问答对生成--- 基于任务1的总结内容,生成 3 个问答对,问答对需覆盖总结中的核心要点(如“Prompt 工程的核心包括哪些方面?”)。 输出要求: 1. 问题需简洁明确,避免歧义; 2. 答案需基于任务1的总结内容,不添加总结外的信息; 3. 问答对按“问题1:[内容] 答案1:[内容]”的格式编写。 输出格式: 问答对1: 问题1:[内容] 答案1:[内容] 问答对2: ...(同问答对1格式) 问答对3: ...(同问答对1格式)

技巧点分析:“任务分隔符”让 Mixtral 清晰区分两个任务的边界,避免任务混淆;“优先级说明”(任务1为核心任务)确保模型优先投入资源完成总结,再基于总结生成问答对,避免因同时处理多个任务导致核心任务输出质量下降。

六、LLaMA-2 与 Mixtral 提示词调优对比与场景选择

在实际应用中,需根据任务场景选择适配的模型与调优技巧。本节通过对比两者的调优重点与适用场景,帮助开发者快速决策。

(一)调优重点对比

| 对比维度 | LLaMA-2 | Mixtral |

|---|---|---|

| 指令设计 | 需结构化、详细化,明确步骤与格式 | 基础任务可简化指令,复杂任务需补充约束 |

| 示例需求 | 小参数模型(7B/13B)需大量 Few-Shot 示例 | 仅复杂任务(如多语言代码生成)需示例 |

| 上下文管理 | 需控制输入文本长度,避免挤压指令空间 | 支持长文本输入,可直接嵌入多源信息 |

| 专家引导 | 无专家架构,无需引导 | 需明确任务类型,激活对应专家模块 |

(二)场景选择建议

轻量型任务(如简单文本分类、短问答):优先选择 LLaMA-2 7B 模型,搭配“结构化指令+少量示例”,平衡性能与推理速度。

专业型长文本任务(如行业报告分析、长文档总结):优先选择 Mixtral 模型,利用其长上下文优势,搭配“分段标注+全局指令”,实现精准分析。

代码生成与多语言任务:优先选择 Mixtral 模型,通过“专家引导指令+术语统一约束”,确保代码质量与多语言输出的一致性。

资源受限场景(如边缘设备部署):选择 LLaMA-2 7B 模型,简化提示词结构,降低模型推理的硬件需求。

复杂逻辑推理任务(如数学题解答、多步骤分析):选择 LLaMA-2 70B 或 Mixtral 模型,搭配“详细步骤指令+温度参数调优”,提升推理准确性。

七、调优误区与避坑指南

在 LLaMA-2 与 Mixtral 的提示词调优过程中,开发者易陷入一些共性误区,导致调优效果不佳。本节梳理 4 个常见误区,并提供避坑方案。

(一)误区1:忽略模型参数规模,使用统一提示词

表现:为 LLaMA-2 7B 模型使用为 70B 模型设计的复杂提示词,导致模型无法理解任务逻辑,输出混乱。

避坑方案:

按参数规模分层设计提示词:小参数模型(7B/13B)的提示词需简化任务目标,减少逻辑步骤;大参数模型(70B)可增加任务复杂度。

测试不同参数模型的响应:针对同一任务,先在小参数模型上测试提示词效果,再逐步调整复杂度,适配大参数模型。

(二)误区2:过度依赖示例,导致提示词冗长

表现:为 Mixtral 模型提供大量基础任务示例(如文本分类),导致提示词过长,挤压上下文空间。

避坑方案:

按需提供示例:仅在复杂任务(如多语言实体识别)中提供 2-3 个示例,基础任务无需示例。

示例简洁化:每个示例仅包含“输入+输出”,不添加冗余解释,减少提示词长度。

(三)误区3:长文本任务中直接输入无结构文本

表现:为 Mixtral 模型输入无分段、无标注的长文本(如 10000 字小说),要求模型提取要点,导致模型遗漏关键信息。

避坑方案:

对长文本进行预处理:按章节、段落标注文本,明确文本结构。

分阶段处理:先让模型逐段提取信息,再整合全局要点,避免一次性处理导致的信息遗漏。

(四)误区4:忽视温度参数与提示词的协同

表现:在事实性问答任务中,使用高温度参数(如 0.8),同时提示词未添加“基于事实回答”的约束,导致模型输出猜测性内容。

避坑方案:

根据任务类型匹配温度参数:事实性任务使用低温度(0.1-0.3),创意任务使用高温度(0.7-0.9)。

提示词与参数协同:低温度参数搭配“明确事实依据”的约束,高温度参数搭配“鼓励创新”的引导,确保输出质量。

八、总结与后续实践建议

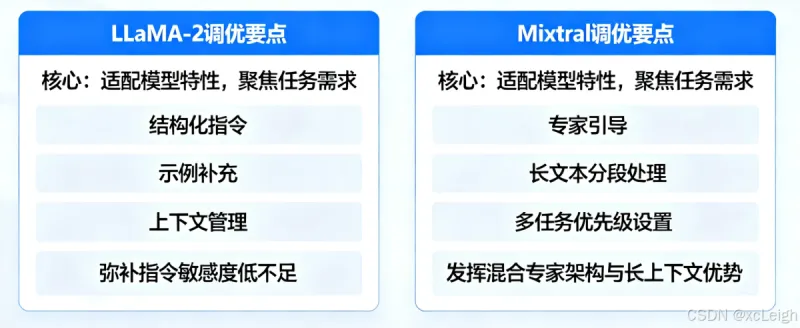

LLaMA-2 与 Mixtral 的提示词调优,核心是“适配模型特性,聚焦任务需求”。LLaMA-2 需通过结构化指令、示例补充和上下文管理,弥补其对指令敏感度低的不足;Mixtral 则需通过专家引导、长文本分段处理和多任务优先级设置,充分发挥其混合专家架构与长上下文优势。

后续实践建议

建立提示词模板库:针对不同任务类型(如文本分类、代码生成、长文档总结),分别为 LLaMA-2 和 Mixtral 建立标准化提示词模板,提高调优效率。

持续测试与迭代:针对同一任务,测试不同提示词技巧的效果(如有无示例、不同温度参数),记录最优方案,逐步迭代优化。

结合模型微调:对于长期、固定的专业任务(如医疗领域的病例分析),可先通过提示词调优验证任务可行性,再结合模型微调(如 LLaMA-2 的 LoRA 微调),进一步提升输出质量。

关注模型更新:随着 LLaMA-2 和 Mixtral 版本的更新(如 Mixtral 8x22B 等新版本),及时了解模型特性的变化,调整提示词调优策略,适应新模型的能力。

通过本文的技巧与方案,开发者可系统性地开展 LLaMA-2 与 Mixtral 的提示词调优,避开常见误区,充分发挥模型性能,为不同场景的应用提供高质量的 Prompt 解决方案。

提示词调优不是文字游戏,而是对模型“认知操作系统”的深度协同。LLaMA-2 的优化本质是补足其指令鲁棒性短板:靠结构化框架锚定任务边界,靠领域知识注入弥补训练盲区,靠否定约束守住输出底线;Mixtral 的优化关键则在于释放其MoE架构红利:用任务类型显式引导专家路由,用分段+全局指令驾驭万字长文,用语言标记与术语统一保障多语一致。二者无优劣之分,只有场景之适——轻量部署选LLaMA-2 7B+精简指令,专业分析选Mixtral+长文本分治,代码/多语任务必启专家引导。文末提供的对比决策表、避坑清单与模板库建议,可即刻融入你的AI工程流水线。真正的Prompt工程力,始于理解模型如何“听懂你”,而非仅仅教会它“如何回答”。

版权及免责申明:本文来源于#xcLeigh,由@97ai整理发布。如若内容造成侵权/违法违规/事实不符,请联系本站客服处理!该文章观点仅代表作者本人,不代表本站立场。本站不承担相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-tutorial/791.html