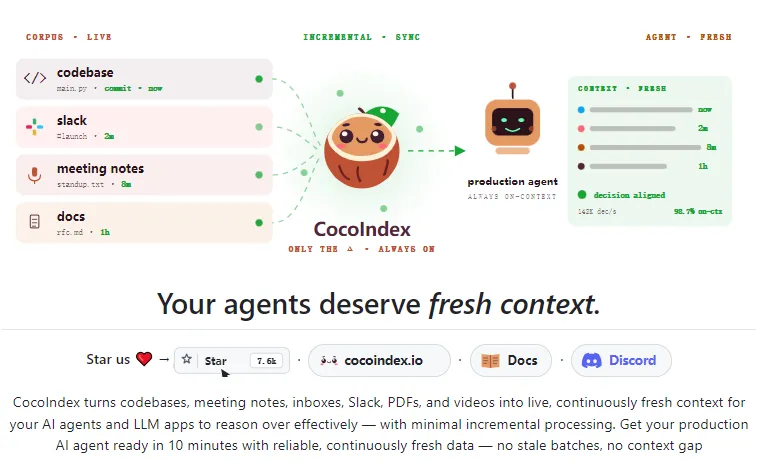

CocoIndex:开源AI增量数据索引框架,极简搭建RAG智能知识库

一、CocoIndex 是什么

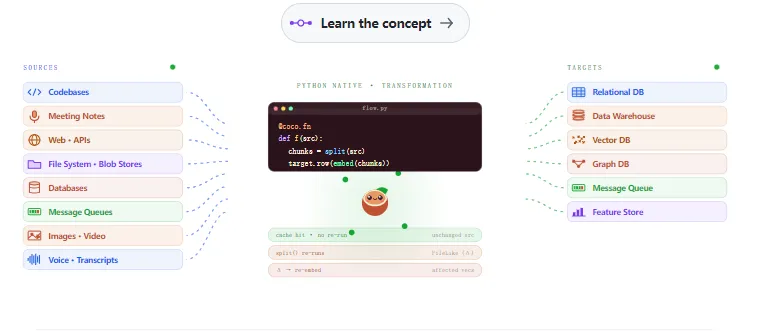

CocoIndex 是一款开源、面向AI工作负载的高性能增量数据转换与索引构建框架,底层核心基于 Rust 语言开发,上层提供友好的 Python 编程接口,专为 RAG 知识库、语义检索、知识图谱、多模态数据索引等大语言模型应用场景量身打造。

传统AI数据索引方案普遍存在明显短板:每次数据更新都需要全量重新计算、全量重新向量化、全量重建索引,不仅消耗大量 Token 与算力资源,还会造成数据更新延迟高、实时性差、运维成本居高不下等问题。

而 CocoIndex 核心设计理念是增量计算+数据血缘追踪,无需人工编写复杂的增量同步逻辑,只需通过极简的 Python 代码定义数据流转规则,即可实现源数据变更后最小粒度重算、自动同步更新向量索引与知识图谱,完美适配本地文件、对象存储、关系数据库、向量数据库、图数据库等多类数据源与存储目标,是搭建生产级AI数据管道、企业级RAG知识库的轻量化高性能底层框架。

二、功能特色

1. 智能增量计算引擎

内置精细化增量调度机制,仅对新增、修改、删除的数据进行重处理与向量化,无变化数据直接复用缓存结果。

自动感知业务逻辑变更、数据源结构变更,智能触发局部索引重建,彻底摒弃传统方案全量刷新的低效模式。

自带完整数据血缘追溯能力,每一条索引数据均可溯源原始来源、转换流程与更新记录,便于生产环境故障排查与数据治理。

2. 低代码流式开发体验

采用声明式数据流编程模型,开发者只需定义「数据源→数据转换→结构化抽取→索引入库」流程,无需关注底层调度、缓存、同步细节。

极简 Python API 设计,百行以内代码即可搭建完整AI索引管道,降低AI数据工程开发门槛,新手也能快速上手落地项目。

无隐性状态设计,整个数据流转过程可观测、可调试、可复现,适配企业规范化开发流程。

3. 组件化生态,多源多端适配

内置丰富可插拔组件,覆盖数据源、转换算子、解析器、向量库、图库、关系数据库全链路。

原生支持本地文件、PDF、Markdown、代码仓库、S3 对象存储、PostgreSQL 等主流数据源;兼容主流向量数据库与知识图谱数据库,组件可无缝替换、即插即用。

支持自定义扩展组件,开发者可按需接入私有存储、自研解析模型,生态灵活性极强。

4. 双栈性能兼顾:Rust底层 + Python上层

核心调度、增量计算、数据解析底层由 Rust 实现,具备高并发、低延迟、内存安全、高吞吐的特性,适配大规模企业级数据量。

上层封装简洁易用的 Python 接口,贴合AI开发者日常开发习惯,无需学习 Rust 语法即可享受底层高性能能力。

原生支持部署到本地服务器、Docker、云服务器等多环境,开箱即可投入生产使用。

5. 专为AI场景深度优化

原生适配文本分块、Embedding 向量生成、LLM 结构化信息抽取、多模态数据解析等AI核心流程。

自动适配 RAG 知识库更新、文档语义检索、企业知识图谱构建、代码知识库索引、商品多模态检索等高频场景。

减少 LLM 重复调用与 Embedding 重复生成,大幅节约 API 调用成本与算力开销。

三、技术细节

1. 整体架构分层

CocoIndex 采用分层解耦架构,整体分为三层:

底层内核层:基于 Rust 开发增量调度引擎、数据血缘引擎、缓存管理模块、数据解析内核,负责高性能任务调度、增量校验、数据版本管理。

中间适配层:统一抽象数据源、数据转换、索引存储标准接口,屏蔽不同数据库、存储服务、文件格式的底层差异。

上层应用层:提供 Python SDK 与声明式编程接口,开发者通过链式调用定义数据管道,无需感知底层架构细节。

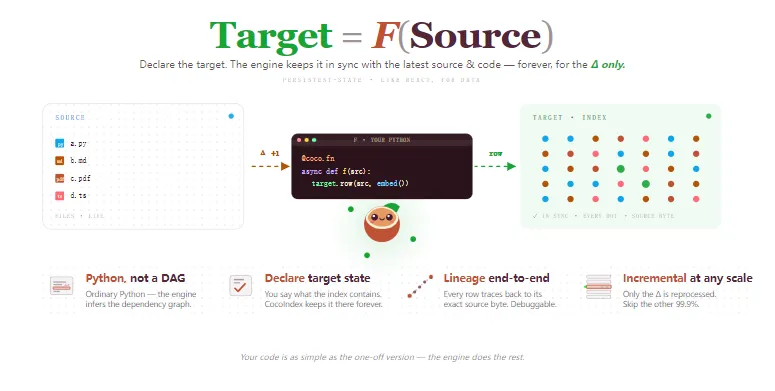

2. 增量计算核心原理

框架内置数据版本快照机制,会自动记录每一份原始数据的哈希值、修改时间与转换状态。当监测到数据源发生变更时,引擎自动比对版本差异,精准定位变更数据范围,仅对变更部分执行分块、Embedding、结构化抽取、入库操作,其余历史有效数据直接复用本地缓存与索引记录。

同时内置血缘图谱,记录数据从原始文件到向量索引的每一步转换节点、依赖关系、更新时间,支持一键溯源,满足企业数据合规与运维排查需求。

3. 依赖与运行环境

编程语言:底层 Rust,上层 Python 3.8+

必备依赖:PostgreSQL,用于存储元数据、数据版本、血缘信息与任务调度记录。

部署方式:支持 Pip 本地安装、Docker 容器部署、源码编译部署三种模式。

扩展能力:支持接入任意开源/闭源 Embedding 模型、LLM 大模型、第三方向量数据库。

4. 核心代码结构示例

import cocoindex

# 1. 定义本地文档数据源

docs = cocoindex.source.file_folder("./docs")

# 2. 文档解析、文本分块处理

chunks = docs.parse_markdown().chunk_by_size(chunk_size=512)

# 3. 生成向量Embedding并构建语义索引

chunks.embed().index_vector_db()

# 4. 启动增量监听,自动同步更新

cocoindex.run()极简代码即可完成文档读取、解析、分块、向量化、向量索引构建与增量实时同步,体现框架低代码、高封装的技术优势。

四、应用场景

企业RAG知识库搭建

企业内部文档、手册、培训资料、PDF 文档自动化入库,增量更新知识库,实现智能问答、语义检索,无需每次新增文档全量重建索引。文档与代码语义检索

对技术文档、开源代码仓库、项目资料做增量索引,支持按语义检索代码片段、技术知识点,适配研发团队内部知识库场景。知识图谱自动化构建

通过 LLM 抽取文本实体与关系,增量同步构建企业行业知识图谱,数据更新时局部刷新图谱,降低图谱维护成本。多模态数据索引

支持图文、文档混合数据的增量处理,构建多模态向量索引,应用于商品检索、素材库智能检索、媒体资源管理等场景。云端存储数据智能管理

对接 S3 等对象存储服务,自动监听文件新增与修改,增量完成解析与向量化,搭建云端智能检索系统。业务数据结构化抽取

对接 PostgreSQL 等业务数据库,增量抽取业务数据并结构化、向量化,赋能智能分析、智能客服、业务决策问答。

五、使用方法

1. 安装依赖

使用 Pip 一键安装 CocoIndex 核心库:

pip install -U cocoindex

2. 环境准备

部署并启动 PostgreSQL 数据库,配置好数据库地址、账号、密码,作为框架元数据存储基础依赖。

3. 定义数据处理管道

新建 Python 脚本,依次配置数据源、数据解析、分块、Embedding 生成、索引入库规则,采用链式编程写法,简洁直观。

4. 启动增量服务

调用 cocoindex.run() 启动监听服务,框架会自动轮询或事件监听数据源变更,自动执行增量计算与索引同步,全程无需人工干预。

5. 自定义扩展

如需接入私有数据源、自定义解析规则、对接自研大模型,可基于框架提供的标准接口开发自定义组件,无缝接入现有数据流管道。

六、竞品对比

选取 LlamaIndex、LangChain、Dify 三款主流AI数据框架进行横向对比:

| 对比维度 | CocoIndex | LlamaIndex | LangChain |

|---|---|---|---|

| 核心定位 | 增量数据索引专用框架 | AI应用编排与检索框架 | 大模型应用开发编排框架 |

| 增量计算能力 | 原生内置精细化增量 | 需自行开发增量逻辑 | 无原生增量,依赖第三方插件 |

| 开发门槛 | 低,声明式低代码 | 中等,需自行编排数据流 | 偏高,配置复杂度高 |

| 底层性能 | Rust底层,高并发低延迟 | Python为主,大规模数据性能一般 | Python生态,大数据量吞吐偏弱 |

| 数据血缘 | 原生自带溯源能力 | 无内置血缘,需额外开发 | 无原生血缘支持 |

| 适用场景 | RAG索引、增量知识库、知识图谱 | 通用AI检索、智能问答 | 大模型Agent、复杂流程编排 |

| 资源消耗 | 仅重算变更数据,Token开销低 | 全量处理居多,资源消耗高 | 全量刷新常见,运维成本高 |

通过对比可清晰看出:CocoIndex 在增量索引、数据血缘、性能开销上具备明显差异化优势,专注解决AI场景下数据索引实时性与成本问题;而 LlamaIndex、LangChain 更偏向通用AI应用编排,缺少原生增量能力,需要开发者二次开发补齐。

七、常见问题解答

Q:CocoIndex 必须依赖 PostgreSQL 才能运行吗?

A:是的,PostgreSQL 是框架核心依赖,主要用于存储元数据、数据版本快照、数据血缘信息和任务调度记录,目前暂不支持替换为其他数据库,这是保障增量计算和数据溯源能力的基础。

Q:新手没有 Rust 基础可以使用该项目吗?

A:完全可以。框架底层 Rust 内核对开发者透明,日常开发只需要使用 Python 接口,只需掌握基础 Python 语法即可搭建完整数据索引管道,无需学习 Rust 相关知识。

Q:CocoIndex 支持接入私有化部署的大模型和向量数据库吗?

A:支持。框架采用组件化设计,兼容所有开源、私有化部署的 Embedding 模型、LLM 大模型以及主流私有化向量数据库,可通过自定义配置完成对接。

Q:和传统手动脚本做文档索引相比,CocoIndex 的优势在哪里?

A:传统手动脚本需要自己写文件监听、比对更新、重复向量化逻辑,代码量大且维护困难;CocoIndex 原生封装增量监听、版本比对、缓存复用能力,代码量大幅减少,且自带数据血缘,生产环境稳定性和可维护性远高于手动脚本。

Q:能否用于大规模企业级海量数据场景?

A:可以。底层 Rust 保障高并发与吞吐能力,加上增量计算避免全量重算,能够支撑十万级、百万级文档的长期增量索引维护,适配企业生产级大规模数据场景。

Q:是否支持 Docker 一键部署?

A:官方提供 Docker 部署方案,可通过容器快速搭建运行环境,简化服务器部署与环境配置流程,适合云服务器、集群化部署场景。

八、相关链接

GitHub 开源地址:https://github.com/cocoindex-io/cocoindex

官方文档地址:https://cocoindex.io/docs

九、总结

CocoIndex 作为一款专注AI场景的开源增量数据索引框架,以 Rust 高性能内核搭配简洁 Python 上层接口为技术底座,凭借原生增量计算、完整数据血缘追踪、组件化多生态适配、低代码开发等核心优势,精准解决了传统RAG与语义索引方案全量重算、资源消耗高、数据更新滞后、开发运维复杂等行业痛点,无需复杂二次开发即可快速落地企业知识库、语义检索、知识图谱、多模态数据索引等各类AI应用,轻量化的部署方式与极简的开发模式,既适合个人开发者快速搭建项目原型,也能满足中大型企业生产级、海量数据长期维护的使用需求,是当前AI数据管道与增量索引领域极具实用价值的开源工具框架。

版权及免责申明:本文由@dotaai原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/cocoindex.html