DreamID-Omni:清华大学联合字节跳动开源的可控人本音视频生成统一框架

一、DreamID-Omni是什么

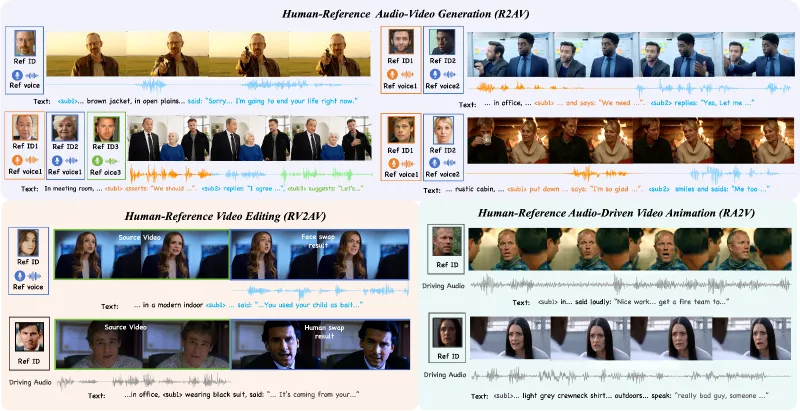

DreamID-Omni是一款由清华大学与字节跳动智能创作团队联合研发的可控以人为中心的音视频生成统一开源框架,是面向高保真人本音视频创作的新一代AI模型,核心研发者包括Xu Guo、Fulong Ye等研究者,Qichao Sun、Bingchuan Li为项目负责人,Songtao Zhao、Xiangwang Hou为通讯作者。该框架打破了传统音视频生成领域中“生成、编辑、动画”三大任务相互孤立的技术壁垒,首次将三类核心能力无缝整合到单一模型范式中,实现了从“参考内容生成全新音视频”到“编辑现有视频身份与声音”,再到“音频驱动静态形象生成唇形同步动画”的全流程创作能力。

在技术层面,DreamID-Omni基于扩散Transformer架构进行创新设计,通过对称条件注入、双层次解耦、多任务渐进训练等核心技术,彻底解决了行业长期存在的多角色场景下身份-音色绑定失效、说话人混淆、音视频不同步等关键问题。该项目于2026年2月13日正式发布相关论文,前期成果DreamID-V的代码已于2026年1月5日开源,而DreamID-Omni的v1版本代码正完成开源前的最终准备,待公司内部审批后计划于2026年3月在GitHub正式发布,项目仓库目前已上线README.md、assets等基础文件,为开发者提前提供了项目基础指引。

与传统音视频生成工具相比,DreamID-Omni具备“单模型多任务、高保真高可控、跨场景强适配”三大核心优势,不仅能降低企业和开发者的技术部署成本,替代多个专用任务模型,还能提升音视频创作效率,为虚拟数字人、影视特效、互动媒体等领域提供了全新的技术支撑,是生成式AI在人本音视频创作领域的重要突破。

二、功能特色

DreamID-Omni作为一款统一的人本音视频生成框架,其核心特色体现在“任务统一化、控制精准化、性能领先化”三个维度,既实现了多任务的无缝整合,又解决了行业痛点,同时在各项核心指标上达到SOTA水平,具体功能特色可分为以下五大方面:

(一)单模型整合三大核心任务,实现一站式音视频创作

DreamID-Omni无需修改模型结构,仅通过切换输入条件,即可无缝支持三大以人为中心的音视频任务,真正实现“一个模型搞定全流程创作”,三大核心任务的具体能力如下:

R2AV(生成):输入人物参考图像和语音音色样本,模型可直接生成音画高度同步的全新视频与音频,生成内容既保留参考图像的人物身份特征,又与输入音色完美匹配,无需额外的后期同步处理;

RV2AV(编辑):基于参考图像和语音音色,对现有源视频进行精准编辑,可替换源视频中的人物身份和声音,同时完整保留源视频的动作、场景、镜头等结构信息,实现“换脸换声不换动作”的编辑效果;

RA2V(动画):以静态的人物参考图像为基础,通过音频输入驱动人物形象生成动画,实现毫秒级精准唇形同步,同时可根据音频的语义和情绪调整人物表情,让静态图像“开口说话”且表情自然。

(二)解决多角色场景核心痛点,实现精准的身份-音色绑定

多角色对话场景中“张三说话李四开口”的说话人混淆、身份与音色绑定失效,是传统音视频生成技术的核心痛点,而DreamID-Omni通过双层次解耦策略,从信号层和语义层双重解决该问题,将说话人混淆率从传统模型的0.38降至0.08,实现了多角色场景下的精准身份-音色匹配,即使是多人复杂对话,也能保证每个角色的声音、口型、身份完全对应,无任何混淆情况。

(三)高保真人本生成,音视频同步性与一致性拉满

DreamID-Omni专为“高保真人本生成”设计,在人物身份保留、音频质量、音视频同步性等方面均表现优异。在身份一致性上,单角色ID-Sim评分达0.674,多角色达0.603,远超闭源模型Wan2.6的0.523/0.455;在音视频同步性上,Sync-C评分达6.226,实现唇形与语音的毫秒级同步;同时视频质量AES达0.618,音频质量PQ达6.290,生成内容的真实感和自然度接近真人拍摄效果。

(四)灵活的条件输入,适配多样化创作需求

模型支持多种异构条件信号的输入,包括参考图像、语音音色、源视频、驱动音频、结构化字幕等,不同输入条件可自由组合,适配多样化的创作场景。例如,既可以输入“图片+音频”生成动画,也可以输入“图片+音色+源视频”编辑视频,还可以通过结构化字幕定义多角色的属性和对话,让模型精准理解创作意图,实现高度可控的音视频生成。

(五)多任务协同性能优异,超越开源与部分闭源模型

DreamID-Omni通过多任务渐进训练策略,实现了三大任务的跨任务协同,避免了直接联合训练导致的任务冲突,在保留生成任务高创造性的同时,保证了编辑和动画任务的高约束性。在研究团队提出的IDBench-Omni基准测试中,该模型在所有任务上均达到SOTA性能,不仅超越了Qwen-Image+Ovi等开源组合模型,还在身份一致性、说话人混淆率等核心指标上显著超越Wan2.6等闭源商业模型,成为人本音视频生成领域的标杆性模型。

三、技术细节

DreamID-Omni的技术核心围绕“统一架构设计、痛点问题解决、高效模型训练”三大方向展开,基于双流扩散Transformer(DiT)架构进行创新,提出了对称条件扩散Transformer、双层次解耦策略、多任务渐进训练三大核心技术,同时构建了全新的IDBench-Omni测试基准,全方位验证模型性能,以下为具体技术细节的深度解析:

(一)整体架构:双流扩散Transformer+对称条件注入

DreamID-Omni的基础架构为双流扩散Transformer,分别搭建视频流和音频流处理分支,两个分支通过双向交叉注意力层实现细粒度的信息交互,确保视频和音频在时间维度和语义维度上的高度同步,从架构底层解决音视频不同步的问题。

在双流架构的基础上,模型创新提出对称条件注入机制,这是实现“单模型支持多任务”的核心技术。该机制将输入条件分为参考特征(参考图像、语音音色)和结构条件(源视频、驱动音频)两类,采用不同的注入方式实现解耦:

参考特征注入:将人物身份和语音音色的参考特征与噪声潜变量进行拼接,让模型牢牢记住需要保留的核心特征,保证生成/编辑内容的身份和音色一致性;

结构条件注入:将源视频、驱动音频等结构条件通过元素级加法注入模型,让模型在保留参考特征的基础上,遵循结构条件的引导(如源视频的动作、驱动音频的节奏)。

这种对称的条件注入方式,让模型无需修改任何结构,仅通过切换输入的参考特征和结构条件,即可实现R2AV、RV2AV、RA2V三大任务的无缝切换,彻底打破了传统多任务模型的架构壁垒。

(二)双层次解耦策略:从信号层和语义层解决多角色混淆问题

为解决多角色场景下的身份-音色绑定失效和说话人混淆问题,DreamID-Omni提出双层次解耦策略,分别从信号层和语义层进行优化,实现多角色特征的精准分离和绑定:

信号层:同步旋转位置编码(Syn-RoPE)

在信号处理层面,模型为每个参考身份分配独立的RoPE位置编码区间,通过周期性投影将不同角色的视觉和音频特征限定在专属的注意力空间中,抑制跨身份的注意力干扰,同时让同一角色的视觉特征(人脸、动作)和音频特征(音色、语音)实现刚性绑定。简单来说,就是给每个角色分配“专属的特征通道”,让模型能清晰区分不同角色的音视频特征,避免特征混合。实验证明,移除Syn-RoPE会导致音色相似度下降46%,足以见得该技术的核心作用。语义层:结构化字幕

在语义理解层面,模型引入结构化字幕技术,通过锚点标记为每个角色建立明确的“属性-主体-对话”映射关系。与传统模糊的文本描述不同,结构化字幕会精准定义角色的身份、外貌特征、动作和对话内容,例如“角色1,中年男性,蓝色西装,走向办公桌并说:会议推迟到明天”。这种精准的语义描述,让模型能明确理解每个角色的特征和行为,消除多角色场景的语义歧义,将说话人混淆率从0.38降至0.08,提升幅度达225%。

(三)多任务渐进训练:三阶段训练实现跨任务协同

传统多任务模型直接联合训练所有任务时,会出现“任务冲突”问题——强约束的编辑/动画任务会压制弱约束的生成任务的创造性,导致生成内容缺乏多样性。为解决该问题,DreamID-Omni设计了三阶段多任务渐进训练策略,遵循“从基础到复杂、从单一到综合”的训练逻辑,让模型逐步掌握三大任务的能力,实现跨任务协同,具体三阶段如下:

第一阶段:配对重建训练

这是基础训练阶段,模型仅学习R2AV生成任务,通过“掩码重构”技术,让模型根据参考图像和音色,重建对应的音视频内容。该阶段的核心目标是让模型掌握身份-音色的基础绑定能力,理解人本音视频的基本生成逻辑,为后续训练打下基础。第二阶段:跨对解耦训练

该阶段提升训练难度,让模型学习将“甲视频的人物身份”与“乙视频的语音音色”结合,生成全新的音视频内容。核心目标是让模型脱离对具体视频片段的记忆,真正理解人物身份和语音音色的抽象特征,提升模型的泛化能力,实现特征的灵活解耦与重组。第三阶段:全任务微调训练

这是综合训练阶段,在模型掌握基础生成和特征解耦能力后,引入RV2AV编辑和RA2V动画任务进行联合微调。该阶段的核心目标是让模型学会根据不同的输入条件,自动切换任务模式,实现三大任务的跨任务协同,同时通过合理的损失函数设计,避免任务之间的相互干扰,保证每个任务的性能表现。

实验证明,直接联合训练所有任务会导致R2AV任务的ViCLIP评分下降34%,而通过三阶段渐进训练,模型的ViCLIP评分提升42%,同时保持了编辑和动画任务的高保真度,实现了多任务性能的协同提升。

(四)性能验证:IDBench-Omni基准测试与多维度对比

为全面验证DreamID-Omni的性能,研究团队构建了全新的IDBench-Omni测试基准,该基准包含200个高质量测试样本,其中100组R2AV、50组RV2AV、50组RA2V,覆盖单人独白、多角色对话、复杂场景转换等多种挑战性场景,是目前人本音视频生成领域最全面的测试基准之一。

在IDBench-Omni基准上,研究团队将DreamID-Omni与7种SOTA方法进行对比,包括闭源模型Wan2.6和开源组合Qwen-Image+Ovi等,核心性能指标对比如下:

| 模型名称 | 视频质量(AES) | 身份一致性(ID-Sim)单/多角色 | 音频质量(PQ) | 说话人混淆率(Spk-Conf) |

|---|---|---|---|---|

| Wan2.6 | 0.632 | 0.523 / 0.455 | 6.391 | 0.380 |

| DreamID-Omni | 0.618 | 0.674 / 0.603 | 6.290 | 0.080 |

从表格中可以看出,DreamID-Omni虽然在视频质量和音频质量上略低于闭源模型Wan2.6,但在身份一致性和说话人混淆率两个核心指标上实现了质的突破,单角色身份一致性提升29%,多角色提升32.5%,说话人混淆率降低78.9%。此外,模型在音视频同步性(Sync-C 6.226)、音频语义一致性(CLAP 0.278)等指标上均全面领先其他模型,用户研究显示,在文本-视频对齐、身份一致性、音视频同步等7个维度中,DreamID-Omni的平均得分达4.02/5,显著优于其他方法。

同时,消融实验验证了各核心组件的有效性:移除Syn-RoPE导致音色相似度下降46%,移除结构化字幕使说话人混淆率提升225%,充分证明了双层次解耦策略的核心价值;而渐进训练的必要性也通过实验得到验证,确保了模型的多任务协同性能。

四、应用场景

DreamID-Omni凭借“高保真、高可控、多任务、多场景适配”的核心优势,打破了传统音视频创作的技术壁垒和成本限制,为多个行业的内容创作带来了全新的解决方案,其应用场景覆盖虚拟数字人、影视创作、教育培训、广告营销、互动媒体等多个领域,具体应用场景及落地方式如下:

(一)虚拟数字人领域:打造高逼真、可交互的虚拟形象

在虚拟主播、虚拟偶像、虚拟客服等虚拟数字人场景中,DreamID-Omni可实现“一张图片+一段音频”快速生成虚拟数字人的动态视频,还能根据实时音频驱动虚拟形象实现唇形同步和表情变化,支持24小时不间断的虚拟直播。同时,模型的多角色支持能力,可实现多个虚拟数字人的实时对话和互动,打造沉浸式的虚拟互动体验。此外,通过模型的编辑功能,可快速修改虚拟数字人的身份特征和声音,无需重新训练模型,大幅降低虚拟数字人的制作和迭代成本。

(二)影视创作领域:降低特效制作成本,提升创作效率

在影视制作中,DreamID-Omni可应用于虚拟演员生成、影视特效制作、老片修复与重制等场景。例如,对于历史剧、科幻剧中的虚拟角色,可通过参考图像生成高逼真的虚拟演员视频,替代真人拍摄,降低特效制作成本;对于需要“换脸换声”的影视片段,可通过RV2AV编辑功能,在保留原片动作和场景的基础上,替换演员身份和声音,无需重新拍摄;对于经典老片,可通过模型修复人物的音视频同步问题,或重新生成高清的人物画面,提升老片的视觉效果。同时,模型的多角色生成能力,可快速制作多人对话的影视片段,大幅提升影视创作的效率。

(三)教育培训领域:生成生动的个性化教学视频

在在线教育、企业培训等领域,DreamID-Omni可帮助教师和培训师快速生成个性化的教学视频。教师只需上传自己的参考照片和课程音频,模型即可生成唇形同步的教学视频,还能根据音频的内容调整表情和动作,让教学视频更生动,提升学生的注意力。同时,对于需要多角色讲解的课程(如情景教学、对话教学),模型可生成多角色的教学动画,让抽象的知识更直观。此外,通过模型的编辑功能,可快速修改教学视频的讲解者和声音,适配不同的教学场景和受众。

(四)广告营销领域:定制高适配的虚拟代言人与广告视频

在广告营销领域,品牌可通过DreamID-Omni定制专属虚拟代言人,根据品牌风格上传参考图像,生成符合品牌调性的虚拟形象,同时可根据不同的产品和宣传场景,快速修改虚拟代言人的声音和动作,无需重新设计形象。此外,模型可快速生成产品宣传的音视频内容,例如,将产品图片与广告音频结合,生成虚拟代言人讲解产品的广告视频,或编辑现有广告视频的人物和声音,适配不同的投放渠道和受众,大幅提升广告创作的效率和灵活性。

(五)互动媒体领域:打造沉浸式的互动音视频体验

在游戏、元宇宙、互动短剧等互动媒体领域,DreamID-Omni可实现用户自定义的音视频生成,提升用户的沉浸式体验。例如,在游戏中,玩家可上传自己的照片,生成游戏中的虚拟角色,同时通过游戏内的音频驱动虚拟角色实现动作和表情变化;在元宇宙中,模型可支持多个用户的虚拟形象实时对话和互动,打造真实的元宇宙社交体验;在互动短剧中,用户可通过选择不同的参考图像和音频,生成个性化的短剧内容,实现“定制化互动”。

(六)其他领域:音视频内容创作的全场景适配

除上述核心领域外,DreamID-Omni还可应用于有声书配套动画、自媒体内容创作、非遗数字化等场景。例如,为有声书生成人物动画,让有声书更具视觉效果;自媒体创作者可快速生成口播视频,无需真人出镜;对于非遗文化,可通过模型生成非遗传承人的虚拟形象,将非遗讲解内容转化为动态视频,实现非遗文化的数字化传播。

五、常见问题解答

问:DreamID-Omni目前是否已经开源?可以直接使用吗?

答:DreamID-Omni目前尚未正式开源,项目正完成开源前的最终准备,待字节跳动内部公司审批后,计划于2026年3月在GitHub发布v1版本代码。目前项目仓库仅上线了README.md、assets等基础文件,无法直接下载使用,开发者可关注项目GitHub仓库,等待官方的开源通知。此外,该项目的前期成果DreamID-V的代码已于2026年1月5日正式开源,可作为参考进行学习。

问:DreamID-Omni支持非真人形象的音视频生成吗?比如动漫角色、卡通形象。

答:支持。DreamID-Omni的核心技术是身份特征和语音音色的绑定与生成,不仅适用于真人形象,也可适配动漫角色、卡通形象、3D虚拟形象等非真人形象,只需输入对应的非真人参考图像,即可生成对应的音视频内容,同时保持唇形同步和身份一致性,适合虚拟偶像、动漫创作等场景。

问:使用DreamID-Omni时,对输入的参考图像和音频有什么要求?

答:对参考图像的要求:建议使用清晰的正脸图像,JPG/PNG格式,分辨率≥512×512,避免模糊、侧脸、遮挡严重的图像,否则会影响身份特征的提取和生成质量;对音频的要求:建议使用MP3/WAV格式,采样率≥16kHz,无明显噪音,音色样本建议时长≥5秒,驱动音频建议时长≤60秒(正式开源后可能支持更长时长),多角色音频需分轨保存,便于模型识别。

问:DreamID-Omni必须使用GPU吗?CPU可以运行吗?

答:DreamID-Omni基于扩散Transformer架构构建,模型参数量较大,必须使用支持CUDA的NVIDIA GPU进行加速,否则无法正常运行,建议GPU显存≥16G,32G及以上显存可支持更高分辨率、更长时长的音视频生成。CPU仅可用于项目的环境配置和代码编辑,无法运行模型的推理和生成任务。

问:多角色场景下,如何让DreamID-Omni精准区分不同的角色?

答:在多角色场景中,需通过结构化字幕为每个角色建立明确的映射关系,结构化字幕需包含角色的唯一标识、参考图像路径、音色样本路径、对话内容和属性描述,模型将根据结构化字幕中的锚点标记,为每个角色分配独立的特征通道,实现精准的角色区分。同时,模型的Syn-RoPE技术会从信号层为每个角色分配独立的位置编码区间,进一步避免角色混淆。

问:DreamID-Omni生成的音视频时长有限制吗?

答:从目前的技术测试来看,DreamID-Omni的驱动音频建议时长≤60秒,生成的视频时长与输入音频时长一致,正式开源后,研发团队可能会通过技术优化支持更长时长的音视频生成。对于超过60秒的音视频需求,可将音频分段处理,生成多个短视频后,通过后期工具拼接,不影响整体的音视频同步性。

问:DreamID-Omni与传统的音视频生成工具相比,部署成本如何?

答:DreamID-Omni的部署成本远低于传统的音视频生成工具。传统工具需要为生成、编辑、动画三个任务分别部署专用模型,需要多台服务器和多个GPU,而DreamID-Omni将三大任务整合到单一模型中,仅需一台配置符合要求的服务器即可部署,大幅降低了硬件和服务器成本。同时,模型提供预训练权重,无需开发者自行训练,节省了大量的训练时间和计算资源。

问:非技术人员可以使用DreamID-Omni吗?是否需要掌握编程知识?

答:DreamID-Omni目前的定位是面向开发者的开源框架,正式开源后主要提供命令行和Python API调用方式,需要使用者具备基础的Python编程知识和深度学习环境配置能力。后续研发团队可能会基于该框架开发可视化的操作界面,降低使用门槛,让非技术人员也能轻松使用,目前暂不支持无编程基础的直接使用。

问:DreamID-Omni生成的音视频内容是否有版权问题?

答:DreamID-Omni是开源的技术框架,本身不产生任何有版权的内容,生成的音视频内容的版权归使用者所有。但使用者在使用时,需确保输入的参考图像、音频、源视频等素材拥有合法的版权,不得侵犯他人的肖像权、著作权等合法权益,否则由此产生的版权问题由使用者自行承担。

问:如果在使用过程中遇到模型报错、生成质量不佳等问题,该如何解决?

答:正式开源后,项目GitHub仓库将提供官方issue区和技术文档,开发者可在issue区提交问题,研发团队会定期解答;同时,项目将提供详细的故障排查指南,针对常见的报错(如环境配置错误、模型权重缺失、输入格式错误等)给出解决方案。对于生成质量不佳的问题,可参考官方文档调整输入素材和模型参数,例如更换更清晰的参考图像、调整扩散步数和引导尺度等。

六、相关链接

项目GitHub仓库:https://github.com/Guoxu1233/DreamID-Omni

前期成果DreamID-V开源仓库:https://github.com/Guoxu1233/DreamID-V

七、总结

DreamID-Omni是清华大学与字节跳动智能创作团队联合研发的可控以人为中心的音视频生成统一开源框架,是生成式AI在人本音视频创作领域的重要技术突破,该框架首次将参考式音视频生成、视频编辑、音频驱动动画三大核心任务整合至单一模型范式,通过对称条件扩散Transformer、双层次解耦策略和多任务渐进训练三大核心技术,从架构底层打破了传统音视频生成任务相互孤立的壁垒,同时彻底解决了多角色场景下身份-音色绑定失效、说话人混淆、音视频不同步等行业长期存在的痛点,在IDBench-Omni基准测试中,该模型在身份一致性、说话人混淆率等核心指标上显著超越现有开源模型和部分闭源商业模型,实现了高保真、高可控的人本音视频生成。项目于2026年2月发布官方论文,前期成果DreamID-V已开源,主框架v1版本计划2026年3月在GitHub发布,其部署成本低、创作效率高、场景适配性强的特点,让单模型即可实现音视频创作的全流程覆盖,可广泛应用于虚拟数字人、影视创作、教育培训、广告营销等多个领域,为音视频内容创作提供了全新的技术解决方案,也为生成式AI在人本音视频领域的落地和发展奠定了坚实的技术基础。本框架的开源将进一步降低音视频生成的技术门槛,推动行业的创新与发展,让更多开发者和创作者能够借助AI技术实现高效、高质量的音视频创作。

版权及免责申明:本文由@dotaai原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/dreamid-omni.html