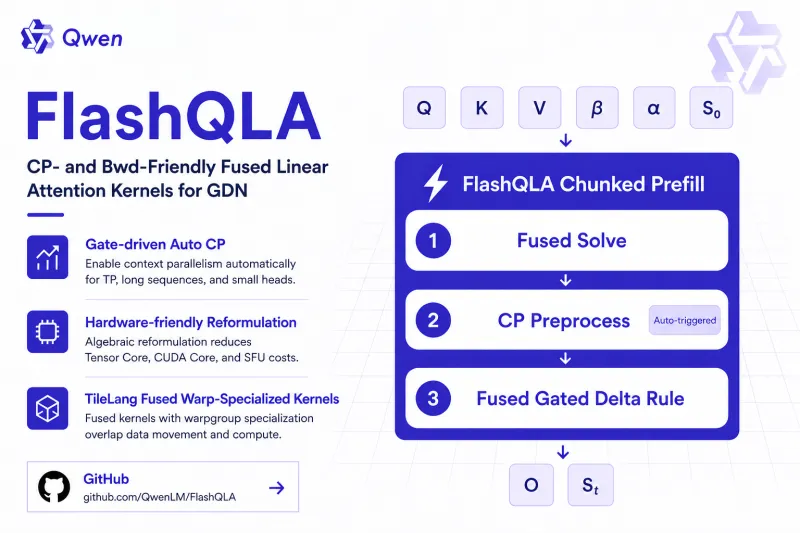

FlashQLA:通义千问开源的高性能线性注意力算子库,Hopper架构专属算力优化工具

一、FlashQLA 是什么

FlashQLA 是由阿里通义千问QwenLM团队开源,基于TileLang编程语言深度开发的高性能线性注意力算子库,专门针对 GDN(Gated Delta Network) 架构的Chunked Prefill阶段前向与反向计算进行底层极致优化。

项目面向NVIDIA新一代GPU硬件架构而生,聚焦长序列大模型预训练、端侧大模型推理、线性注意力模型部署等核心场景,通过代数公式重构、硬件指令级优化、Warp分组特化、计算与访存重叠等底层技术,突破传统Triton实现的性能瓶颈,为线性注意力模型提供更低时延、更高吞吐的算子解决方案,也是当前GDN类线性注意力模型最优的官方底层加速内核实现。

二、功能特色

极致性能加速

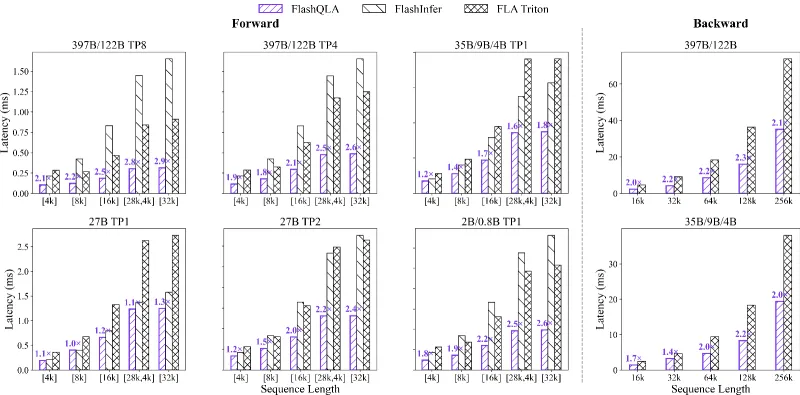

针对GDN Chunked Prefill 前向、反向传播全链路优化,在同硬件环境下,相较传统FLA Triton内核实现前向计算提速2~3倍,反向计算提速2倍以上,大幅降低长序列训练与推理的算力消耗。原生适配Hopper架构

原生兼容NVIDIA SM90及以上 Hopper架构GPU,深度适配Tensor Core、CUDA Core、SFU硬件单元调度,最大化挖掘新一代GPU的并行计算潜力。门控自适应上下文并行

依托GDN门控指数衰减的算法特性,自动实现卡内上下文并行(CP),在张量并行TP、超长序列、小注意力头数场景下,自动提升GPU流式多处理器SM利用率,无需人工调参干预。无损精度代数重构优化

在完全不损失模型精度的前提下,对线性注意力数学表达式进行等价代数重构,削减冗余计算逻辑,降低Tensor Core、通用计算核心与特殊函数单元的资源开销。TileLang融合内核设计

基于TileLang构建端到端融合计算内核,同时手动完成Warp组特化编排,实现数据搬运与计算任务硬件级重叠,掩盖访存延迟,进一步拉高硬件利用率。双层API灵活调用

项目封装高层简易API与底层自定义API,既支持开发者一键快速集成调用,也允许高阶开发者拆分前向、反向逻辑做二次定制开发,原生支持变长序列输入场景。完备基准与校验能力

内置正确性校验脚本与性能基准测试工具,可和FLA、FlashInfer等主流算子库做精度对齐、时延、吞吐多维度对比,方便开发者验证部署可靠性。

三、技术细节

1. 硬件适配底层约束

FlashQLA 做了明确硬件边界约束,仅针对 NVIDIA Hopper SM90+ 架构做指令级优化,不向下兼容旧款安培、阿达诺夫架构,专注新一代高性能算力集群与端侧旗舰GPU部署场景。

2. 核心技术栈依赖

开发语言:TileLang 定制内核开发

深度学习框架:PyTorch 2.8及以上版本

编译环境:CUDA 12.8+ 工具链

依赖生态:兼容主流大模型训练推理生态,可无缝接入Transformer、GDN类线性注意力模型训练链路。

3. 核心优化技术原理

数学层:对GDN Chunked Prefill 计算公式做等价变形,消去冗余矩阵运算、冗余指数计算,在保持推理、训练精度不变的前提下减少计算量。

调度层:采用Warp分组特化调度策略,对线程块、Warp做精细任务划分,适配GPU硬件调度逻辑。

访存层:通过计算与数据搬运重叠执行,隐藏全局内存访问延迟,解决长序列场景下访存瓶颈大于计算瓶颈的行业痛点。

并行层:内置自适应CP上下文并行逻辑,根据序列长度、注意力头数、TP分支数量自动开启并行策略,无需手动配置分布式参数。

4. 项目代码结构核心逻辑

项目源码分为内核实现层、API封装层、测试基准层三大模块:

内核层:基于TileLang编写GDN前向、反向专用优化内核;

API层:封装高层调用接口与底层拆分接口,适配PyTorch张量输入输出;

测试层:提供精度对齐测试、性能Benchmark脚本,支持自定义参数压测。

四、应用场景

大模型长序列预训练:适配GDN架构大模型超长文本预训练,降低训练时延、节约GPU算力成本。

端侧/服务器大模型推理:用于线性注意力部署场景,提升对话、文档解析、长文本摘要等任务推理速度。

科研算法落地:高校、科研机构开展线性注意力、GDN网络算法研究,快速做高性能工程落地。

算力集群部署:企业AI算力集群部署线性注意力大模型,提升集群吞吐、降低单任务能耗。

二次开发定制:开发者基于底层API修改内核逻辑,适配自定义线性注意力变体模型。

五、使用方法

1. 环境依赖准备

提前部署依赖环境:CUDA 12.8+、PyTorch 2.8+、Python 3.10及以上版本。

2. 源码安装

git clone https://github.com/QwenLM/FlashQLA.git cd FlashQLA pip install -v .

3. 基础调用示例

import torch import flashqla # 构造符合要求的张量输入 x = torch.randn(1, 4096, 512).cuda().half() # 调用高层API执行GDN Chunked Prefill计算 out = flashqla.gdn_chunked_prefill(x) print(out.shape)

4. 基准测试与精度校验

进入项目tests目录,执行官方基准脚本,一键完成性能测速与和标准实现的精度对齐校验:

python tests/benchmark_gdn.py

六、竞品对比

选取业内主流 FLA Triton、FlashInfer 两款线性注意力/推理算子库,与FlashQLA进行多维度对比:

| 对比维度 | FlashQLA | FLA Triton | FlashInfer |

|---|---|---|---|

| 开发团队 | 阿里通义千问QwenLM团队 | 开源社区 | 字节跳动推理团队 |

| 核心适配模型 | GDN门控线性注意力 | 通用线性注意力 | Transformer主流模型、稀疏注意力 |

| 硬件最优适配 | Hopper SM90+ | 多架构兼容 | 多架构全兼容 |

| 前向性能提升 | 较FLA提速2~3倍 | 基准参考值 | 通用场景性能中等 |

| 反向性能提升 | 较FLA提速2倍 | 基准参考值 | 侧重推理、反向优化较弱 |

| 开发语言 | TileLang | Triton | C++/CUDA |

| 特色能力 | 自适应上下文并行、无损代数重构 | 通用适配、生态成熟 | 推理调度优化、批处理能力强 |

| 适用场景 | GDN模型训练+推理 | 通用线性注意力科研部署 | 大模型高并发在线推理 |

从对比可看出:FlashQLA 是GDN架构专属最优加速方案,在专用模型场景性能碾压通用型算子库;FLA胜在通用性,FlashInfer胜在在线推理调度,三者定位形成差异化互补。

七、常见问题解答

Question 1:FlashQLA 可以在RTX 3090、A100等旧架构GPU上使用吗?

不可以。项目仅针对NVIDIA Hopper SM90及以上架构做深度指令级优化,旧款安培、Ada架构无法适配优化内核,强行安装可编译通过,但无法发挥性能优势且可能出现运行异常。

Question 2:部署FlashQLA 必须使用PyTorch 2.8以上版本吗?

建议严格使用PyTorch 2.8及以上版本,低版本PyTorch的张量调度、CUDA交互接口存在差异,会导致内核调用失败或精度偏移,官方仅对指定版本做适配维护。

Question 3:FlashQLA 能否用于非GDN架构的普通Transformer模型?

项目核心为GDN Chunked Prefill定制优化,普通标准Transformer无适配逻辑,不建议直接使用;通用Transformer场景可选择FLA Triton或FlashInfer。

Question 4:使用FlashQLA 会不会造成模型精度下降?

不会。项目所有性能优化均基于无损代数等价重构,未做任何量化、截断近似处理,训练与推理精度和原生标准实现完全对齐。

Question 5:新手开发者如何快速上手二次开发?

可先使用高层API完成基础集成,再参考项目tests目录示例代码,理解张量输入输出格式,再研读TileLang内核源码,按需修改调度逻辑与计算逻辑即可。

八、相关链接

九、总结

FlashQLA 是通义千问团队面向GDN门控线性注意力模型推出的专用高性能开源算子库,依托TileLang底层开发能力,结合代数重构、硬件指令级优化、Warp分组特化、计算访存重叠等核心技术,在Hopper架构GPU上实现远超传统FLA Triton的前向与反向计算性能,同时具备自适应上下文并行、无损精度、双层API、完备基准测试等实用特性,精准适配GDN大模型长序列预训练、端侧推理、科研算法落地等场景,是目前GDN架构线性注意力模型工程化部署的最优底层加速工具之一,差异化填补了专用线性注意力高性能算子的市场空白。

版权及免责申明:本文由@人工智能研究所原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/flashqla.html