One-Eval:开源大模型智能评测框架,自然语言驱动全自动基准测评

一、One-Eval 是什么

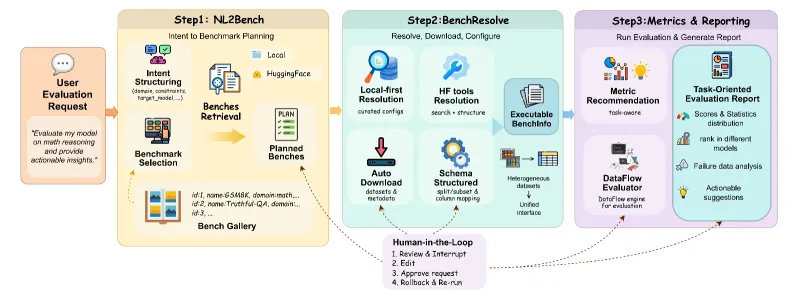

One-Eval 是由北大 OpenDCAI 团队开源打造的大语言模型一站式智能评测框架,基于智能工作流与 Agent 思想设计,主打自然语言驱动自动化评测核心能力。项目彻底打破传统大模型评测需要手动编写脚本、配置复杂参数、手动适配基准数据集的繁琐流程,实现输入自然语言评测需求,全自动完成从数据集加载、模型推理、指标计算到评测报告生成的全链路闭环。

One-Eval 面向算法工程师、大模型研发人员、AI 评测从业者、科研人员打造,支持本地私有化部署、自定义评测任务、接入私有模型与私有数据集,是轻量化、高灵活、易扩展的 LLM 专用评测开源解决方案。

二、功能特色

NL2Eval 自然语言评测驱动

无需编写代码和配置文件,直接用日常自然语言描述评测需求,框架自动解析评测意图、匹配对应评测维度、筛选适配基准任务,零基础也能快速上手大模型评测。全链路自动化评测流程

内置完整评测流水线:基准任务推荐 → 数据集自动下载与预处理 → 模型批量推理 → 多维度指标打分 → 可视化评测报告生成,全程无人值守自动执行。人机协同可控评测机制

支持流程中断、人工干预、任务参数手动调整,关键评测节点可人工审核校验,兼顾自动化效率与人工精准把控,适配专业严谨的科研与工业评测场景。丰富内置评测基准库

项目原生集成主流中英文大模型评测基准,覆盖多能力维度:

逻辑数学推理:GSM8K、MATH、BBH、AIME

通识知识考核:MMLU、C-Eval、CMMLU

指令遵循能力:IFEval 等经典基准任务

高可扩展自定义能力

支持接入本地私有大模型、私有化数据集、自定义评测指标、自定义评测工作流,开发者可基于原有架构扩展新增评测任务,适配行业定制化评测需求。前后端一体化部署

配套独立 Web 前端可视化界面,支持网页端操作评测任务、查看实时进度、浏览可视化报告;后端基于接口服务设计,可对接第三方系统做二次集成。

三、技术细节

1. 整体技术栈

核心引擎:基于 LangGraph 构建智能工作流,依托 DataFlow 算子实现任务编排与状态流转管理。

后端服务:采用 FastAPI 搭建高性能接口服务,异步处理多任务评测请求,支持高并发批量评测。

前端界面:Vite + React 开发轻量化 Web 管理端,交互流畅,支持任务管理、结果展示、报告预览。

运行环境:适配 Python 3.11 及以上版本,支持本地 conda、uv 等虚拟环境部署,兼容性强。

2. 核心架构设计

整体采用模块化分层架构,分为意图解析层、任务编排层、评测执行层、结果生成层四层:

意图解析层:接收自然语言指令,通过语义理解拆解评测维度、任务类型、模型参数;

任务编排层:借助 LangGraph 维护评测状态,调度各子任务有序执行,支持断点续跑;

评测执行层:对接大模型推理接口,加载基准数据集,完成样本推理与结果校验;

结果生成层:聚合各项指标数据,自动生成文本评测报告与可视化统计内容。

3. 部署与运行核心命令

项目支持源码本地安装与服务启动,核心操作命令如下:

# 克隆项目源码 git clone https://github.com/OpenDCAI/One-Eval.git cd One-Eval # 本地项目依赖安装 pip install -e . # 启动后端服务 uvicorn one_eval.server.app:app --host 0.0.0.0 --port 8000 # 前端启动 cd one-eval-web npm install npm run dev

4. 极简代码调用示例

无需启动网页,直接通过命令行发起自然语言评测任务:

python -m one_eval.graph.workflow_all "评测大模型数学推理和通识知识能力"

四、应用场景

大模型研发自测:AI 研发团队快速自测自研大模型推理、知识、指令遵循等基础能力,迭代模型版本。

科研学术评测:高校、科研机构开展大模型相关论文实验,标准化基准评测,生成规范实验数据报告。

企业选型测评:企业对比多款开源/商用大模型综合能力,低成本完成横向评测选型。

教学学习实训:AI 相关专业教学实训,帮助学生理解大模型评测流程与基准体系。

私有化定制评测:政企内部私有大模型、行业专属数据集的离线私有化评测,保障数据安全不外泄。

五、使用方法

环境准备

搭建 Python 3.11 虚拟环境,推荐使用 conda 或 uv 管理环境,避免依赖版本冲突。源码拉取与安装

通过 Git 克隆项目到本地,进入项目根目录执行pip install -e .完成本地源码安装。服务启动

分别启动后端 FastAPI 接口服务和 React 前端页面,默认本地端口访问 Web 管理界面。发起评测任务

两种使用方式可选:

网页端:在前端界面输入自然语言评测需求,选择待评测模型,一键启动自动评测;

命令行:直接执行预设命令,传入评测描述,后台自动运行全流程任务。

查看评测结果

任务完成后,可在线查看各项指标得分、对比数据、综合评测报告,支持报告导出留存。

六、竞品对比

选取 2 款主流开源大模型评测框架与 One-Eval 进行横向对比:

| 对比维度 | One-Eval | LM Evaluation Harness | EvalPlus |

|---|---|---|---|

| 核心交互方式 | 自然语言NL2Eval驱动,低代码无代码操作 | 需编写命令行参数、配置脚本 | 需自定义配置文件,依赖代码调用 |

| 自动化程度 | 全链路全自动,无需人工干预中间流程 | 仅负责基准打分,需手动准备数据集与任务 | 侧重代码模型评测,通用LLM自动化较弱 |

| Web可视化界面 | 原生配套前后端一体化Web界面 | 无官方前端,仅命令行输出 | 无可视化管理界面,纯脚本运行 |

| 扩展能力 | 支持私有模型、私有数据集、自定义指标 | 支持基准扩展,定制流程复杂度高 | 偏向代码评测场景,通用能力扩展有限 |

| 上手门槛 | 零基础友好,自然语言即可操作 | 需掌握命令行与评测参数配置 | 有一定代码基础门槛 |

七、常见问题解答

Question 1:One-Eval 支持商用私有化部署吗?

Answer:项目采用 Apache-2.0 开源协议,允许个人、企业免费使用、修改和私有化部署,可用于商业项目内部评测场景,无需额外授权费用。

Question 2:是否可以接入本地开源大模型而非在线API模型?

Answer:完全支持,框架预留模型接入接口,可适配本地部署的 Llama、Qwen、DeepSeek 等各类开源大模型,离线完成整套评测流程。

Question 3:新手没有代码基础,能不能正常使用该项目?

Answer:可以,依托 Web 前端界面和 NL2Eval 自然语言评测能力,无需编写任何代码,仅通过文字描述评测需求即可完成全部操作。

Question 4:评测任务中途关闭终端,是否需要重新开始?

Answer:框架基于 LangGraph 做状态管理,支持断点续跑,中断后重新启动服务可继续未完成的评测任务,无需从头执行。

Question 5:能否新增自定义的行业专属评测数据集?

Answer:支持,项目架构预留自定义数据集接入入口,按照规范格式导入私有数据集后,即可配置为专属评测任务使用。

八、相关链接

GitHub 源码地址:https://github.com/OpenDCAI/One-Eval

九、总结

One-Eval 作为一款面向大模型领域的开源智能评测框架,以自然语言驱动评测为核心亮点,整合了主流中英文评测基准,构建了从需求输入到报告输出的全链路自动化流程,同时配备可视化 Web 操作界面与高可扩展架构,大幅降低了大模型评测的技术门槛与操作成本。它兼顾新手简易使用与专业场景定制扩展需求,适配科研、企业研发、模型选型、教学实训等多元场景,凭借低门槛、全自动化、易部署、可私有化的优势,成为轻量化大模型评测领域实用性极强的开源工具。

版权及免责申明:本文由@dotaai原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/one-eval.html