GLM-5.1:智谱AI开源的8小时级自治工程大模型,超长上下文与强代码能力双突破

一、GLM-5.1是什么

GLM-5.1是智谱AI发布的新一代旗舰开源大模型,属于GLM-5系列的迭代优化版本,4月2日全面面向GLM Coding Plan全量用户开放。它与GLM-5、GLM-5-Turbo共同构成智谱旗舰推理矩阵,官方定位为"高阶推理旗舰",专为专业开发者、复杂工程场景设计,核心目标是实现AI能力从"被动响应"到"主动完成项目"的质变。

1.1 核心基础参数

模型架构:采用MoE(混合专家)稀疏架构,总参数规模744B,实际激活参数40B,兼顾性能与计算效率

上下文窗口:支持204,800 tokens(200K+)超长上下文,可一次性载入超大型代码仓库、整本API文档

最大输出:单次输出上限达131,072 tokens(128K+),告别内容截断痛点

训练数据:预训练数据达28.5T tokens,知识储备丰富,覆盖多领域专业知识

开源协议:采用MIT协议完全开源,支持个人与企业免费商用,无隐藏门槛

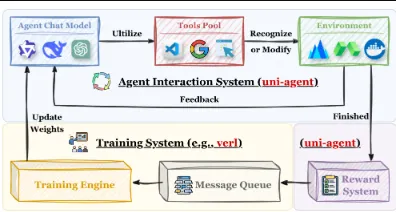

核心突破:融合智谱自主研发的异步强化学习框架Slime与DeepSeek稀疏注意力机制(DSA),实现长程任务自主执行

1.2 核心定位与价值

区别于传统大模型仅能处理单轮、短时、碎片化任务的局限,GLM-5.1具备完整的**"规划—执行—调试—迭代"**闭环能力:

无需人工频繁干预即可自主推进复杂工程

覆盖从需求分析、架构设计到代码编写、漏洞修复、性能优化的全链路流程

官方数据显示,单次任务可稳定持续工作超8小时,完成超1200个操作步骤,等效于4人开发团队一周的工作量

实力对标国际顶级闭源模型(GPT-5.4、Claude Opus 4.6),标志国产大模型正式从"追赶者"迈入"并跑甚至领跑"新阶段

二、功能特色

GLM-5.1的核心竞争力集中在三大维度的跨越式提升,每一项突破都精准解决行业痛点,兼顾性能与实用性。

2.1 超长文本处理能力

超大上下文承载

支持200K tokens上下文窗口,可一次性载入100万字级文档、完整大型项目代码库、多卷技术手册

无需频繁切分文档,避免上下文丢失导致的逻辑断裂

集成DSA稀疏注意力机制,长文本计算成本降低20%+,token效率提升15%

超长内容生成

最大输出128K tokens,可完整生成大型项目代码、多模块技术方案、完整行业报告

支持一次性输出整套软件系统、数据库架构、API文档集合

解决传统模型输出截断、内容碎片化问题

2.2 高阶推理与自主执行能力

8小时级长程自治

全球唯一能实现8小时持续独立作业的开源模型,自主完成全流程工程任务

具备InterleaveThinking交叉思考模式,实现"思考—执行—复盘"循环逻辑

可自主处理1200+连续操作步骤,无需人工监控与干预

高精度复杂推理

幻觉率较GLM-5降低**42%**,复杂逻辑推理稳定性大幅提升

支持多步骤数学推导、业务逻辑分析、系统架构设计

在经营模拟测试(Vending Bench 2)中成绩接近Claude顶级模型

2.3 超强代码与工程能力

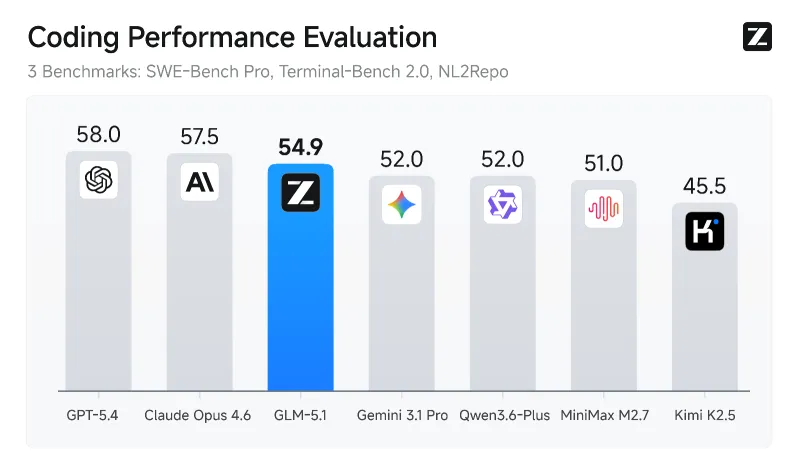

顶级代码性能

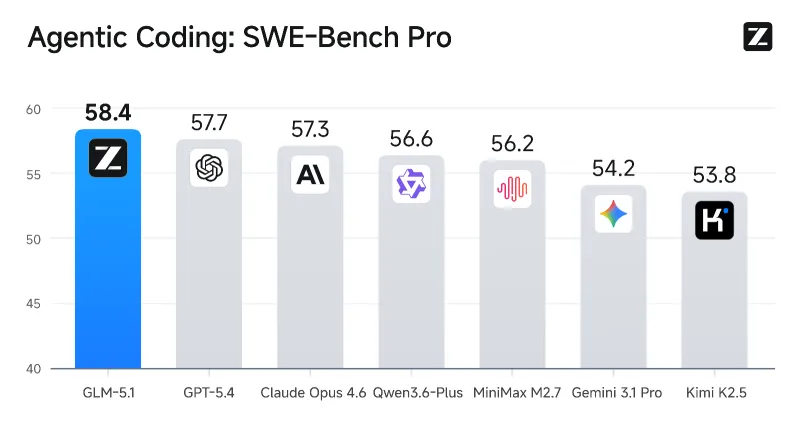

在SWE-bench Pro测试中得分58.4,超越GPT-5.4(57.5)与Claude Opus 4.6(57.3),全球第一

在ClaudeCode评测框架下得分45.3,较GLM-5提升近10分,涨幅超28%

在Terminal-Bench 2.0、NL2Repo等代码评测中位列国产及开源模型第一

全栈工程开发

支持全栈代码生成:前端、后端、数据库、移动端全平台代码

可独立构建完整系统:8小时全自动构建Linux桌面系统(含窗口管理器、文件浏览器、终端等)

擅长遗留系统重构、数据库优化、GPU内核加速(KernelBench Level 3实现3.6倍加速比)

工具集成与生态兼容

原生支持Function Calling,可无缝集成各类开发工具、API接口

兼容OpenAI接口规范,现有项目无需修改代码,仅更换接口地址即可迁移

深度适配ClaudeCode、OpenCode等主流编程工具,支持IDE内直接调用

2.4 功能特色对比表

| 能力维度 | GLM-5.1 | GLM-5 | GLM-5-Turbo | 传统开源模型 |

|---|---|---|---|---|

| 持续工作时长 | 8小时+ | 2小时 | 30分钟 | 10-30分钟 |

| 上下文窗口 | 200K tokens | 200K tokens | 128K tokens | 32K-64K tokens |

| 最大输出 | 128K tokens | 64K tokens | 32K tokens | 8K-16K tokens |

| SWE-bench Pro | 58.4(全球第一) | 53.8 | 49.2 | <40 |

| 代码能力 | 顶级(对标Opus 4.6) | 优秀 | 良好 | 中等 |

| 自主执行能力 | 全闭环自治 | 半自主 | 辅助执行 | 被动响应 |

| 计算效率 | 高(DSA优化) | 中 | 极高 | 低 |

三、应用场景

GLM-5.1的能力特性决定其更适配技术研发、工程落地、系统优化、学术研究等专业场景,同时覆盖企业服务、内容创作等多元领域。

3.1 企业级软件开发场景

大型项目全流程开发

独立完成Web应用、移动App、桌面软件的需求分析、架构设计、代码编写、测试部署

自动生成完整项目文档、API说明、部署手册

案例:8小时构建完整电商系统(含用户中心、商品管理、订单支付、物流模块)

遗留系统重构与优化

分析百万行级 legacy 代码,自动重构为现代化架构

优化系统性能,修复潜在漏洞,提升运行效率

数据库架构优化、SQL语句性能调优

自动化测试与质量保障

生成全面测试用例、单元测试、集成测试代码

自动执行测试、分析结果、定位bug、生成修复方案

持续集成/持续部署(CI/CD)流程自动化

3.2 科研与高性能计算场景

科研文献与数据处理

快速阅读分析海量学术论文,提炼核心观点、研究方法、实验数据

自动生成文献综述、研究报告、学术论文初稿

实验数据统计分析、可视化图表生成、结论推导

高性能计算优化

GPU/CPU内核代码优化,提升计算密集型任务效率

机器学习模型架构设计、训练代码生成、超参数调优

并行计算、分布式系统开发与优化

行业手册与标准制定

将零散研究资料转化为结构化行业手册、技术标准

案例:灵巧手行业手册生成,耗时从1周缩短至2小时

3.3 企业服务与智能体场景

企业级智能体开发

构建7×24小时无人值守自动化智能体,处理数据采集、文档整理、报表生成

客户服务自动化、业务流程自动化、财务报表自动化

跨系统数据整合、业务逻辑分析、决策支持

长文档处理与知识管理

企业海量文档自动分类、摘要、关键词提取、知识图谱构建

合同审核、法律文书分析、合规检查

培训资料、产品手册、技术文档自动生成与更新

3.4 内容创作与多模态场景

专业内容创作

技术白皮书、行业报告、产品说明书、解决方案撰写

代码教程、技术博客、开发文档、API说明编写

短视频脚本、营销文案、产品宣传材料生成

多模态内容处理

图文结合分析报告、设计方案、产品原型说明

代码+注释+文档一体化生成,支持图文并茂的技术说明

数据可视化+分析报告组合生成

3.5 教育与开发者生态场景

编程教育与辅助

编程教学、代码讲解、错误分析、学习路径规划

编程作业自动批改、代码优化建议、学习资料生成

零基础编程指导、项目实战教学

开源生态贡献

开源项目代码贡献、bug修复、功能扩展

开源文档完善、API说明补充、使用教程编写

开发者社区问题解答、技术支持、案例分享

四、使用方法

GLM-5.1提供在线API调用、本地部署、工具集成三种使用方式,覆盖从新手到专业开发者全层级需求,操作简单、迁移便捷。

4.1 在线API调用(零门槛,推荐普通用户)

适合快速体验、轻量开发,无需高端算力,通过智谱开放平台调用即可。

4.1.1 准备工作

注册与认证

访问智谱开放平台:https://open.bigmodel.cn/

完成注册与个人/企业认证

新用户可领取2000万tokens免费额度,有效期3个月

获取API Key

进入控制台 → API密钥 → 创建新密钥

复制保存API Key(格式:xxx.xxxxxxxxxxxx),严格保密

4.1.2 Python SDK调用

# 1. 安装官方SDK

pip install zhipuai

# 2. 初始化客户端

from zhipuai import ZhipuAI

client = ZhipuAI(api_key="你的API_KEY")

# 3. 基础调用示例

response = client.chat.completions.create(

model="glm-5.1", # 指定模型

messages=[

{"role": "user", "content": "详细解释GLM-5.1的核心技术优势"}

],

temperature=0.1, # 降低随机性,提升准确性

max_tokens=8192 # 最大输出长度

)

# 4. 输出结果

print(response.choices[0].message.content)4.1.3 长程代码任务调用

# 长程工程任务示例:开发完整Flask博客系统

response = client.chat.completions.create(

model="glm-5.1",

messages=[

{"role": "user", "content": """基于Python开发一个完整的Flask博客系统,包含:

1. 用户注册、登录、权限管理

2. 文章发布、编辑、删除、分类

3. 评论功能、点赞功能

4. MySQL数据库存储

5. 后台管理界面

输出可直接部署的完整代码及详细部署说明"""}

],

temperature=0.1,

max_tokens=16384 # 长文本输出

)

# 保存结果到文件

with open("flask_blog_system.py", "w", encoding="utf-8") as f:

f.write(response.choices[0].message.content)4.2 本地部署(隐私优先,专业开发者)

适合对数据隐私有要求、需要离线使用、自定义优化的场景。

4.2.1 环境要求

硬件:推荐多卡GPU(A100/H100/4090),显存≥48GB

系统:Linux(Ubuntu 20.04+),CUDA 11.7+

框架:Python 3.10+,PyTorch 2.0+,vLLM(推荐)

4.2.2 模型获取

Hugging Face:https://huggingface.co/zai-org/glm-5.1

ModelScope:https://modelscope.cn/models/zhipuai/glm-5.1

GitHub:https://github.com/zai-org/glm-5

# ModelScope下载示例

pip install modelscope

from modelscope import snapshot_download

model_dir = snapshot_download("zhipuai/glm-5.1", cache_dir="./glm-5.1-model")4.2.3 本地部署启动

# vLLM部署示例

from vllm import LLM, SamplingParams

# 加载模型

llm = LLM(

model="./glm-5.1-model",

tensor_parallel_size=4, # GPU数量

trust_remote_code=True

)

# 设置采样参数

sampling_params = SamplingParams(

temperature=0.1,

max_tokens=16384,

stop=["<|endoftext|>"]

)

# 推理请求

prompts = ["基于Rust开发一个高性能向量数据库,包含完整的索引结构、查询接口、性能优化代码"]

outputs = llm.generate(prompts, sampling_params)

# 输出结果

for output in outputs:

prompt = output.prompt

generated_text = output.outputs[0].text

print(f"生成代码:{generated_text}")4.3 工具集成(开发场景,高效开发)

深度适配主流开发工具,实现IDE内直接调用。

4.3.1 ClaudeCode集成

安装ClaudeCode插件

打开设置 → 模型选择 → 自定义模型

配置API地址:

https://open.bigmodel.cn/api/paas/v4/填入API Key,选择GLM-5.1模型

重启IDE即可在编码界面直接调用

4.3.2 VS Code集成

安装"智谱AI Coding"插件

插件设置中配置API Key

选中代码 → 右键 → 选择GLM-5.1功能(优化/解释/生成测试/重构)

支持批量代码生成、文件级重构、项目级优化

4.4 使用技巧与最佳实践

任务分配策略

复杂推理、大型工程任务 → GLM-5.1

日常开发、常规任务 → GLM-4.7(节省成本)

快速响应、简单查询 → GLM-5-Turbo

参数优化建议

# 工程代码任务推荐参数 temperature=0.1 # 低随机性,高准确性 top_p=0.9 # 控制输出多样性 max_tokens=16384 # 充分利用长输出能力 stop=["<|end|>"] # 自定义停止符

成本控制技巧

非高峰期(每日18:00-次日14:00)调用享受1倍额度(限时至4月底)

高峰期(14:00-18:00)为3倍额度,尽量避免

合理拆分任务,复杂任务用GLM-5.1,简单任务用基础模型

五、竞品对比

5.1 核心竞品性能对比

| 对比维度 | GLM-5.1 | GPT-5.4 | Claude Opus 4.6 | GLM-5 | Llama 3 70B |

|---|---|---|---|---|---|

| 开源状态 | 开源(MIT) | 闭源 | 闭源 | 开源 | 开源 |

| SWE-bench Pro | 58.4(全球第一) | 57.5 | 57.3 | 53.8 | 42.1 |

| 持续工作时长 | 8小时+ | 2小时 | 3小时 | 2小时 | 30分钟 |

| 上下文窗口 | 200K | 128K | 200K | 200K | 128K |

| 代码能力 | 顶级 | 顶级 | 顶级 | 优秀 | 良好 |

| 中文能力 | 极强 | 优秀 | 良好 | 极强 | 中等 |

| API价格 | 中等(国产平价) | 极高 | 高 | 中低 | 免费(自部署) |

| 部署成本 | 中高(GPU) | 无(云服务) | 无(云服务) | 中高 | 高 |

5.2 核心优势分析

对比闭源模型(GPT-5.4/Claude Opus 4.6)

开源优势:完全开源可商用,无使用限制,可二次开发、私有化部署

价格优势:API调用成本仅为闭源模型的1/3-1/5,性价比极高

长程优势:8小时自治能力全球独有,远超闭源模型的小时级限制

中文优势:中文理解、生成、代码能力全面优于海外模型

对比其他开源模型(Llama 3/GLM-5)

性能优势:SWE-bench Pro领先Llama 3 70B超16分,领先GLM-5超4分

工程优势:完整自治工程能力,其他开源模型仅具备辅助编码能力

生态优势:兼容OpenAI接口,无缝迁移现有项目,工具生态完善

优化优势:DSA稀疏注意力机制,计算效率提升15%,成本降低20%+

5.3 选型建议

选择GLM-5.1的场景

企业级软件开发、大型项目重构、复杂系统开发

需要8小时级长程自治任务、全流程自主执行

预算有限但需要顶级代码能力、重视性价比

中文场景为主、需要私有化部署、数据隐私敏感

开源生态开发者、二次开发需求

选择闭源模型的场景

超大规模通用内容生成、创意写作、多模态综合场景

对价格不敏感、追求极致通用能力

无需长程自治、仅需短时交互

六、常见问题解答

GLM-5.1与GLM-5的核心区别是什么?

GLM-5.1是GLM-5的专项优化版本,核心差异在于:

1. 长程能力:从2小时提升至8小时+,自主执行稳定性大幅增强;

2. 代码性能:SWE-bench Pro从53.8提升至58.4,超越GPT-5.4和Claude Opus 4.6;

3. 推理效率:融合DSA稀疏注意力机制,计算成本降低20%+;

4. 幻觉率:降低42%,复杂任务准确性更高。

本地部署GLM-5.1需要什么硬件配置?

推荐配置:多卡GPU(A100/H100/4090),单卡显存≥48GB,建议4卡并行;系统为Linux(Ubuntu 20.04+),CUDA 11.7+;内存≥128GB,存储≥1TB(SSD)。最低可运行配置:单卡4090(24GB)需启用量化,性能会有一定损失。

使用GLM-5.1如何控制成本?

1. 时段优化:非高峰期(18:00-次日14:00)调用享1倍额度(限时至4月底),高峰期(14:00-18:00)为3倍,尽量避开;

2. 模型搭配:复杂任务用GLM-5.1,日常开发用GLM-4.7,简单查询用GLM-5-Turbo;

3. 任务拆分:将超大任务合理拆分,避免不必要的长文本调用。

GLM-5.1支持哪些编程语言?

全面支持主流编程语言:Python、Java、C/C++、Rust、Go、JavaScript/TypeScript、PHP、Ruby、Swift、Kotlin等。尤其擅长Python、Rust、C++等高性能语言,在系统级开发、内核优化场景表现突出。

现有OpenAI项目如何迁移到GLM-5.1?

无需修改代码,仅需两步:

1. 将API地址从

https://api.openai.com/v1/改为https://open.bigmodel.cn/api/paas/v4/;2. 将API Key替换为智谱开放平台的API Key;

3. 模型名称指定为"glm-5.1"。完全兼容OpenAI接口规范,迁移过程一分钟完成。

GLM-5.1的长文本处理有什么限制?

标称支持200K上下文,但在实际高压环境下,处理5-7万token以上的超大型代码库时,偶尔可能出现逻辑混乱。建议:1. 超大型项目分模块处理;2. 关键核心代码单独提取处理;3. 复杂任务增加中间检查步骤。

GLM-5.1可以商用吗?有什么限制?

完全可以商用。GLM-5.1采用MIT开源协议,个人与企业均可免费商用、二次开发、私有化部署,无隐藏条款、无授权费用、无使用限制。仅需保留原版权声明即可。

GLM-5.1支持多模态功能吗?

当前版本主打文本与代码能力,多模态(图像、音频、视频)能力为可选扩展。可通过Function Calling集成多模态模型,或等待后续GLM-5.1V多模态版本发布。

GLM-5.1的推理速度如何?

在A100 4卡并行配置下,文本生成速度约80-120 tokens/秒;代码生成速度约50-80 tokens/秒。相比GLM-5提升约30%,得益于DSA稀疏注意力优化。

七、相关链接

智谱开放平台(API调用入口):https://open.bigmodel.cn/

GLM-5.1官方文档:https://docs.bigmodel.cn/cn/guide/models/text/glm-5.1

Z.ai官方博客:https://z.ai/blog/glm-5.1

GLM Coding Plan入口:https://open.bigmodel.cn/glm-coding

Hugging Face:https://huggingface.co/zai-org/glm-5.1

ModelScope:https://modelscope.cn/models/zhipuai/glm-5.1

GitHub仓库:https://github.com/zai-org/glm-5

八、总结

GLM-5.1作为智谱AI推出的高阶推理旗舰开源大模型,凭借8小时级长程自治能力、200K超长上下文窗口、顶级代码性能(SWE-bench Pro全球第一)三大核心突破,重新定义了开源大模型的能力边界,实现了从"被动响应工具"到"主动工程智能体"的范式跨越。它采用744B总参数、40B激活的MoE稀疏架构,融合异步强化学习与稀疏注意力机制,在保持高性能的同时兼顾计算效率。相比GPT-5.4、Claude Opus 4.6等闭源顶级模型,GLM-5.1具备完全开源可商用、价格仅为1/3-1/5、8小时长程能力独有、中文能力更强四大核心优势;对比Llama 3等其他开源模型,其工程能力、代码性能、生态兼容性全面领先。GLM-5.1提供API调用、本地部署、工具集成三种便捷使用方式,无缝适配企业级软件开发、科研高性能计算、企业智能体、专业内容创作等多元场景,通过合理的模型搭配与时段选择可实现成本最优控制。作为全球首个能独立完成8小时级复杂工程任务的开源模型,GLM-5.1不仅是国产大模型的里程碑式突破,更为开发者与企业提供了性价比极高的顶级AI能力选择,推动开源大模型真正具备企业级落地能力。

版权及免责申明:本文由@97ai原创发布。该文章观点仅代表作者本人,不代表本站立场。本站不承担任何相关法律责任。

如若转载,请注明出处:https://www.aipuzi.cn/ai-news/glm-5-1.html